Estou Cancelando Meu Plano de $200 do Claude Code Depois de Duas Semanas com o Codex

Duas semanas depois da minha comparacao original, as duas ferramentas lancaram grandes atualizacoes. O Codex desafiou minha estrategia de produto de formas que o Claude Code nao fez. O Claude Code lancou Agent Teams e AutoMemory. O resultado: estou cortando meu plano Max de $200/mes — e obtendo resultados melhores por menos dinheiro.

Duas semanas atras, escrevi sobre usar Codex e Claude Code juntos. Aquele post teve mais repercussao do que qualquer coisa que eu ja escrevi — parece que muita gente esta fazendo o mesmo experimento.

Na epoca, meu modelo de trabalho era claro: Claude Code para qualidade de execucao e QA, Codex para raciocinio arquitetural e planos de longo prazo. As duas ferramentas, forcas diferentes, revisao cruzada entre modelos para trabalhos importantes.

Duas semanas depois, as duas ferramentas lancaram atualizacoes significativas e o equilibrio mudou. Nao dramaticamente — mas o suficiente para valer a pena escrever sobre. (Para registro, estou redigindo este post no Claude Code — nao por lealdade, mas porque meu ciclo de cobranca atual ainda esta ativo e nao quero desperdicar dinheiro ja comprometido. Esse tipo de calculo pratico e exatamente o ponto deste post.)

Marco de 2026 foi intenso para as duas plataformas. O Codex lancou plugins com integracoes para Slack, Gmail, Linear, Figma, Sentry e mais — alem de Triggers para fluxos automatizados no GitHub, modelos GPT-5.4 mini e nano, e suporte nativo para Windows. O Claude Code lancou Agent Teams (orquestracao multi-agente, ainda experimental), AutoMemory, Computer Use (apenas macOS, planos Pro/Max), Scheduled Tasks via /loop, e cerca de 10 lancamentos so em marco. As duas plataformas estao evoluindo rapido.

A Historia da Newsletter (Por Que Isso Nao E So Sobre Codigo)

A observacao que mudou meu pensamento nao teve nada a ver com escrever codigo.

Meu site tem um sistema completo de newsletter — formulario de inscricao, CTAs nos posts, email de boas-vindas, cron diario, double opt-in, suporte a 13 idiomas. Tecnicamente, tudo funciona. O problema: zero assinantes verificados.

Elaborei um plano para resolver isso: extrair um lead magnet em PDF do meu curso, colocar o Modulo 1 atras de um gate de email, adicionar CTAs no meio dos artigos, conectar o chatbot de IA ao fluxo de inscricao, redistribuir pelo YouTube e LinkedIn. Sete coisas novas.

Construi esse plano com o Claude Code. Pareceu produtivo.

Entao dei o mesmo briefing ao Codex. A contestacao foi imediata.

O lead magnet era redundante — o Modulo 1 ja e gratuito. Muitas superficies de uma vez — se voce constroi todas as sete, nao consegue saber qual delas funciona. O problema nao e infraestrutura, e copy. "Fique por dentro" e generico. O email de verificacao nao e persuasivo o suficiente. A selecao de interesses adiciona friccao.

O plano do Codex: primeiro conserte o que ja existe (reescreva o copy, melhore o email de verificacao, reduza a friccao), adicione uma unica superficie nova (um CTA inline no blog), metrify com eventos GA antes de construir qualquer outra coisa.

Meu plano era "construir mais coisas." O plano do Codex era "faca as coisas existentes funcionarem melhor, depois teste uma coisa nova." O meu levaria uma semana sem nenhuma forma de saber o que funcionou. O do Codex pode ir ao ar em um dia e te diz exatamente onde investir a seguir.

Tenho que admitir — isso me pegou de surpresa. Nao porque o Claude seja ruim em estrategia. Acho que se eu tivesse promptado com mais cuidado — "desafie minhas premissas antes de executar" — talvez tivesse recebido uma contestacao similar. Mas o estilo de raciocinio padrao foi perceptivelmente diferente. O GPT-5.4 defaultou para "questione a premissa." O Claude defaultou para "execute o plano bem."

Essa distincao importa para decisoes de produto.

Velocidade e Direcionamento

Duas coisas que percebi e que afetam o fluxo de trabalho diario mais do que eu esperava.

Velocidade e eficiencia de tokens: O Codex com GPT-5.4 em high thinking e consistentemente mais rapido que o Opus 4.6 em high thinking para tarefas equivalentes. Comparacoes de terceiros sugerem que o Codex usa aproximadamente 3x menos tokens para trabalhos similares — um benchmark mediu 1,5 milhao de tokens em uma tarefa estilo Figma onde o Claude usou 6,2 milhoes. O Claude "pensa em voz alta" mais, o que produz raciocinio de maior qualidade mas consome os limites mais rapido. A partir de mais ou menos 20 de marco, o Opus parece estar fazendo mais chamadas de ferramentas do que o usual — mais passos intermediarios antes de chegar na resposta. Nao sei se isso e uma mudanca no modelo ou coincidencia, mas e perceptivel.

Direcionamento em tempo real: Quando envio uma nova mensagem enquanto a ferramenta esta trabalhando — "espera, nao nessa direcao, tenta isso" — o Codex le quase imediatamente e ajusta. O Claude Code tende a terminar a execucao atual antes de ler a correcao.

Isso parece pequeno. Nao e. Quando voce esta vendo um agente seguir pelo caminho errado e quer corrigir o rumo, a diferenca entre "le sua correcao agora" e "le depois de terminar a operacao atual" se acumula ao longo de uma sessao inteira de trabalho.

O Bug de SSE: Um Exemplo Concreto

Eu estava construindo um novo app para iOS. O Claude Code havia produzido 40 arquivos Swift cobrindo todas as funcionalidades — auth, agentes, chat, frameworks, dashboard, perfil. Amplitude impressionante. Mas um bug critico permanecia: o streaming SSE para chat em tempo real nao funcionava.

O backend estava ok. Curl funcionava. Mas URLSessionDataDelegate.didReceive(data:) nao disparava no cliente Swift. O Claude Code trabalhou nisso por horas. Multiplas abordagens, multiplas sessoes de debugging.

Dei o mesmo problema ao Codex. Algumas tentativas depois: commit 7f592152 — "fix(ios): restore real-time chat streaming."

Isso e representativo? Talvez nao. Toda ferramenta tem dias bons e ruins. Mas pela minha experiencia, quando o Claude Code fica preso em um loop de debugging — tentando variacoes cada vez mais engenhosas da mesma abordagem — trocar para o Codex frequentemente quebra o impasse porque o GPT-5.4 enquadra o problema de forma diferente desde o inicio.

Onde o Claude Code Ainda Ganha

Seria facil ler este post e concluir que o Codex esta se distanciando em todas as frentes. Isso seria errado. O Claude Code tambem lancou forte este mes, e varias de suas vantagens na verdade cresceram.

Agent Teams. Lancado em fevereiro e amadurecendo ao longo de marco. Multiplas instancias do Claude Code trabalhando em paralelo — um explorador, um revisor de codigo, um implementador, um executor de testes — com rastreamento de dependencias e listas de tarefas compartilhadas. Ainda e experimental e desabilitado por padrao, mas quando habilitado, e genuinamente impressionante. O Codex tambem tem suporte multi-agente (tarefas rodam em containers cloud isolados), mas os Agent Teams do Claude Code parecem mais coordenados. Para grandes refatoracoes tocando muitos arquivos, Agent Teams sao atualmente a melhor experiencia.

AutoMemory. O Claude Code agora escreve automaticamente regras de memoria baseadas nos seus habitos. Depois de algumas sessoes, ele conhece a estrutura do seu projeto, suas convencoes de nomenclatura, suas preferencias. E sutil, mas o efeito cumulativo e que as sessoes do Claude Code ficam mais produtivas ao longo do tempo de uma forma que as sessoes do Codex atualmente nao ficam.

Design de frontend. O Claude Code com o plugin /frontend-design ainda produz UI notavelmente mais polida e consciente do design system do que o Codex com a skill equivalente. Testei isso diretamente durante um redesign do site em 26 de marco. A saida do Claude tinha melhor composicao espacial, estilizacao mais consistente e um resultado mais coeso. Isso pode ser uma vantagem do harness (o sistema de plugins do Claude executa a skill com mais contexto), mas o resultado pratico e claro.

Qualidade de codigo. Uma analise da comunidade com mais de 500 comentarios de desenvolvedores no Reddit descobriu que desenvolvedores preferiram a saida do Claude Code em cerca de 67% das comparacoes cegas — notando codigo mais limpo, mais idiomatico e melhor estruturado. Isso bate com minha experiencia. Quando o codigo precisa ser mantivel, nao apenas funcional, o Claude Code tem uma vantagem.

QA automatico. Ainda e a funcionalidade matadora. Depois de completar o trabalho, o Claude Code automaticamente despacha agentes de revisao — revisao de codigo, checagens de consistencia, analise de lacunas — sem eu pedir. O Codex ainda nao faz isso. Para qualquer coisa onde corretude importa mais que velocidade, isso por si so mantem o Claude Code no fluxo de trabalho.

A Questao da Confiabilidade

Quero compartilhar algo que a maioria dos posts comparativos evita.

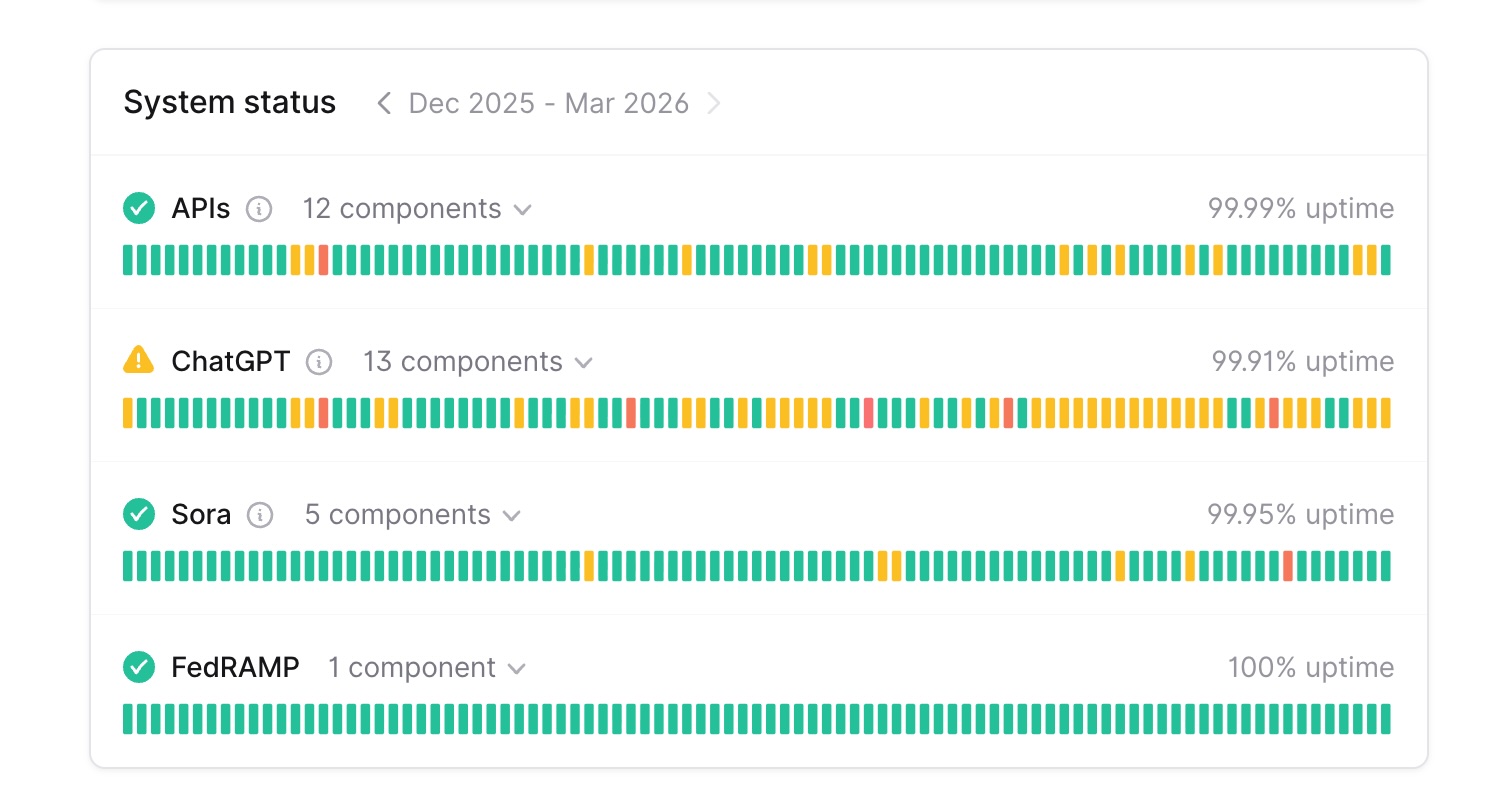

Aqui estao os numeros de uptime de 90 dias das paginas de status de ambas as plataformas, ate o final de marco de 2026:

| Servico | Anthropic | OpenAI |

|---|---|---|

| Plataforma principal | claude.ai: 99,16% | ChatGPT: 99,91% |

| API | api.anthropic.com: 99,24% | APIs: 99,99% |

| Ferramentas de desenvolvedor | Claude Code: 99,48% | — |

| Console | platform.claude.com: 99,41% | — |

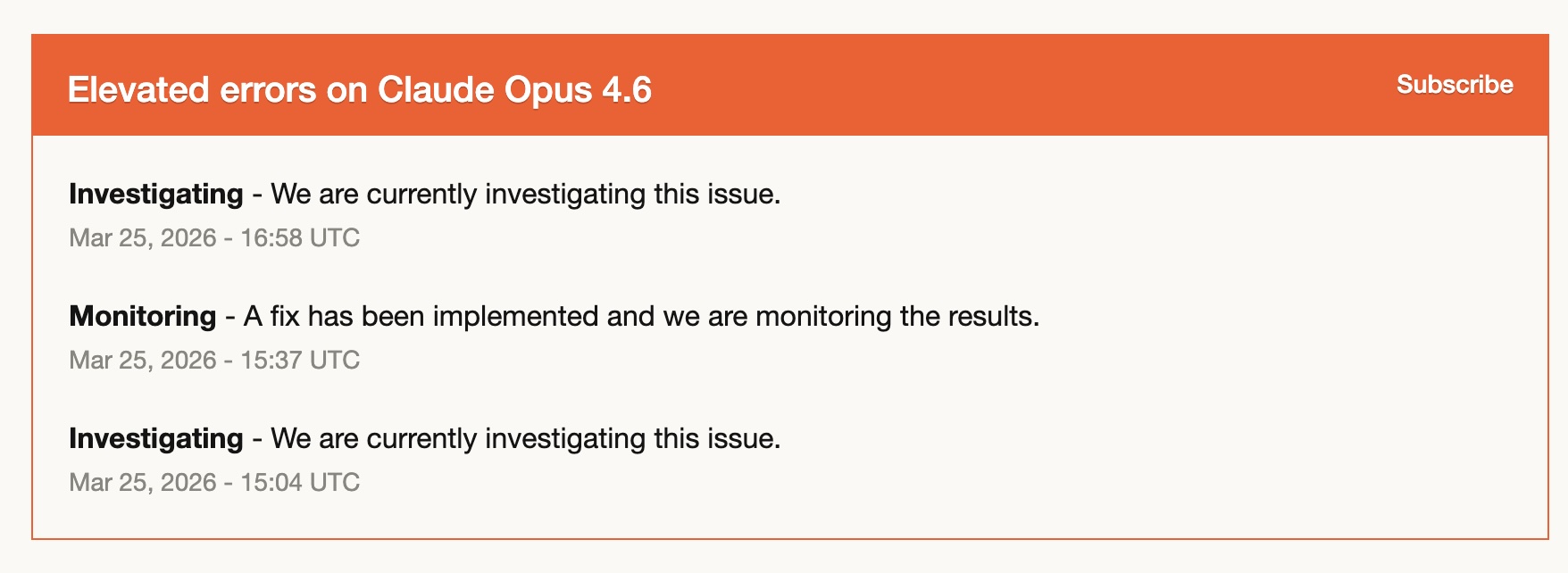

A diferenca e real. Em 90 dias, os servicos da Anthropic tiveram aproximadamente 8-10x mais downtime do que os da OpenAI. Em 25 de marco, houve um incidente especifico — "Elevated errors on Claude Opus 4.6" — com um ciclo de investigacao-correcao-investigacao que durou quase duas horas.

Para ser justo, isso nao e o quadro completo. Confiabilidade nao e apenas uptime. O Phantom Labs da BeyondTrust divulgou publicamente uma vulnerabilidade de injecao de comando no Codex que poderia ter exposto tokens de autenticacao do GitHub atraves da manipulacao de nomes de branches. A falha afetava a UI web, CLI, SDK e integracoes com IDEs — um nome de branch controlavel pelo usuario era passado diretamente para um comando shell sem sanitizacao. A OpenAI corrigiu, mas e um lembrete de que estabilidade e seguranca sao dimensoes diferentes de confiabilidade, e ambas importam.

Estou compartilhando os dados de uptime nao para criticar a Anthropic. Uso o Claude Code todo dia e ele continua excelente. Mas para qualquer pessoa construindo seu fluxo de trabalho profissional em torno dessas ferramentas, os numeros valem a pena conhecer. E e exatamente por isso que usar as duas nao e apenas algo bom de ter — quando um servico tem uma tarde ruim, voce troca e continua trabalhando. Fiz isso tres vezes em duas semanas.

A Diferenca de Plugins Esta Diminuindo

No meu post original, observei que o ecossistema de plugins do Claude Code era mais maduro. Isso era verdade duas semanas atras. E menos verdade hoje.

O Codex lancou seu sistema de plugins em 27 de marco com integracoes para Slack, Gmail, Google Drive, Linear, Figma, Sentry, Notion e Hugging Face. Alem de skills, hooks (incluindo eventos SessionStart e UserPromptSubmit), servidores MCP e um diretorio de plugins tanto no app quanto na CLI.

O conjunto de funcionalidades esta convergindo. As duas ferramentas agora tem: plugins/skills para fluxos reutilizaveis, hooks para automacao orientada a eventos, integracao com servidores MCP e integracoes no nivel do app com servicos externos.

Onde o Claude Code ainda lidera: o ecossistema de plugins existente e mais profundo. Plugins como Superpowers (planejamento estruturado), /feature-dev (desenvolvimento guiado) e /frontend-design foram refinados ao longo de meses. O diretorio de plugins do Codex e mais novo e os plugins individuais sao menos testados em batalha.

Onde o Codex esta se destacando: Triggers. O Codex pode responder automaticamente a eventos do GitHub — uma issue chega, o Codex corrige automaticamente, abre um PR. Essa e uma nova categoria de automacao que o Claude Code ainda nao oferece. Para times que querem fluxos de engenharia autonomos, Triggers sao um diferencial significativo.

Meu Modelo de Trabalho Atualizado

Duas semanas atras, eu dividia o trabalho aproximadamente 60/40 Claude Code/Codex. Tinha um modelo mental claro: use o Claude Code quando precisar de qualidade, use o Codex quando precisar de raciocinio arquitetural.

Essa divisao limpa se dissolveu. Agora uso os dois ao longo do dia, trocando mais por intuicao do que por regras. Codex para uma tarefa, Claude Code para a proxima, as vezes os dois revisando o mesmo plano. As ferramentas estao proximas o suficiente em capacidade para que a pergunta "qual devo usar para isso?" importe menos do que importava duas semanas atras.

O que mudou e a economia.

O plano Plus da OpenAI custa $20/mes com limites cada vez mais generosos. Tenho me visto usando o Codex cada vez mais — nao porque seja dramaticamente melhor em qualquer coisa especifica, mas porque a combinacao de velocidade, eficiencia de tokens e aquele preco de $20 remove a friccao. Nao ha calculo mental de "essa tarefa vale a pena queimar tokens do Claude Code?"

Estou inclinado a reduzir meu plano do Claude Code do tier Max de $200/mes para o plano de $100/mes, possivelmente ate o plano Pro de $20/mes. Duas semanas atras, isso teria parecido arriscado. Agora parece pratico. O trabalho em que preciso que o Claude Code seja excelente — design de frontend, orquestracao de Agent Teams, o QA automatico que pega coisas que eu perderia — essas sao vantagens reais. Mas talvez nao exijam $200/mes se o Codex lida com metade da minha carga de trabalho por $20.

Estou ciente de que essa aposta tem riscos. O tier de $20 do Claude Code tem limites reais de uso — se eu bater neles durante uma sessao critica, vou me arrepender do downgrade. E os limites generosos de $20 da OpenAI provavelmente sao uma jogada de market share que pode nao durar para sempre. Mas agora, a economia favorece usar as duas.

O custo total ($20 Codex + $100 ou ate $20 Claude Code) seria menor do que eu estava pagando pelo Claude Code sozinho. E a saida combinada e melhor do que qualquer ferramenta solo a qualquer preco.

Esse e talvez o aprendizado mais pratico de duas semanas usando as duas ferramentas: a competicao nao esta apenas tornando as ferramentas melhores. Esta tornando-as mais baratas. E mais barato significa que voce pode pagar pelas duas.

O Que Espero a Seguir

As duas plataformas estao acelerando. O Codex acabou de lancar plugins, triggers e um cliente Windows. O Claude Code acabou de lancar Agent Teams, AutoMemory, Computer Use e Scheduled Tasks. Nenhum dos dois esta parado.

Um tema recorrente nas comunidades de desenvolvedores no Reddit — e acho que captura algo real — e que "o Claude Code e de maior qualidade, mas voce bate nos limites. O Codex e de qualidade levemente inferior, mas mais usavel no dia a dia." O equilibrio muda conforme ambos melhoram.

Meu conselho continua o mesmo do primeiro post, mas mais forte agora: experimente a outra ferramenta por uma semana. Nao para trocar — para somar. O fluxo de trabalho de revisao cruzada entre modelos ainda e a melhor descoberta que fiz. E a resiliencia operacional de ter duas ferramentas em que voce confia vai te salvar no dia em que uma delas cair.

Como usuario, essa e a melhor situacao possivel. Duas ferramentas excelentes ficando melhores rapido, cada uma empurrando a outra para frente. O ritmo da competicao e tao feroz que nao acho que nenhuma empresa consiga ficar confortavelmente na frente por muito tempo — e e exatamente por isso que apostar em uma so ferramenta parece cada vez mais arriscado e apostar no fluxo de trabalho (usar as duas, revisao cruzada entre modelos) parece cada vez mais certo.

Perguntas Frequentes

Sua opiniao mudou desde o primeiro post?

A tese central — usar as duas ganha de escolher uma vencedora — so ficou mais forte. O que mudou foi a divisao (60/40 virou 50/50) e as razoes. A forca do Codex em raciocinio estrategico me surpreendeu mais do que suas melhorias em codificacao.

O Codex e mais rapido que o Claude Code?

Em high thinking, sim — consistentemente mais rapido, e comparacoes de terceiros sugerem que usa aproximadamente 3x menos tokens para tarefas equivalentes. Em default thinking, a diferenca e menor. Para trabalho iterativo onde voce vai e volta com frequencia, a velocidade e eficiencia de tokens se acumulam.

Devo me preocupar com o uptime do Claude Code?

Os numeros de 90 dias mostram uma diferenca real (99,2% vs 99,9%). Se o Claude Code e sua unica ferramenta e voce esta trabalhando contra um prazo, tenha um plano B. Mas a Anthropic lancou cerca de 10 atualizacoes do Claude Code so em marco — estao iterando rapido em funcionalidades mesmo que a confiabilidade esteja atras da OpenAI.

E sobre a vulnerabilidade de seguranca do Codex?

Uma falha de injecao de comando no Codex poderia ter exposto tokens do GitHub atraves de nomes de branches. Foi descoberta e corrigida. Vale saber, mas tambem vale notar que pesquisadores de seguranca testam ativamente essas ferramentas — o que e bom para o ecossistema.

A historia da estrategia de newsletter e realmente sobre as ferramentas?

Em parte. Modelos diferentes tem estilos de raciocinio padrao diferentes. O GPT-5.4 tinha mais probabilidade de desafiar minhas premissas. O Claude tinha mais probabilidade de ajudar a executar meu plano bem. Ambos sao uteis — mas para estrategia de produto, "voce esta resolvendo o problema certo?" e frequentemente mais valioso do que "aqui esta uma boa implementacao."

Qual ferramenta devo comprar?

As duas. Isso nao e uma evasiva — e genuinamente a melhor resposta. Codex a $20/mes mais Claude Code a $20-100/mes te da resultados melhores do que qualquer ferramenta sozinha a qualquer preco. Estou inclinado a cair de $200/mes no Claude Code para $100 ou ate $20, e adicionar o Codex a $20. O custo total diminui e a saida melhora. Dito isso, os limites generosos da OpenAI podem nao durar — entao mantenha flexibilidade.

E isso da minha parte. Se voce tem feito seu proprio experimento com as duas ferramentas, gostaria genuinamente de saber como sua divisao esta evoluindo. Mesmos padroes, ou algo completamente diferente?

Cheers, Chandler