Em 3 de abril de 2026, eu disse que voltaria em 30 dias para contar a verdade sobre o que tinha acontecido depois de cancelar o Claude Max.

Estou voltando onze dias antes.

Não porque eu esteja impaciente. Mas porque o padrão já se assentou, e ficar segurando a resposta até 2 de maio seria principalmente teatro.

A conclusão soa errada no começo. Uma ferramenta chamada Claude Code agora é a ferramenta que eu uso para quase tudo menos code.

A versão curta é esta:

- O Codex com GPT-5.4 em xHigh thinking ficou com a cadeira de coding.

- O Claude Code com Opus 4.7 em xHigh ficou com todas as outras cadeiras da minha mesa.

- A história do "Codex barato" desmoronou no momento em que os limites reais apareceram.

Se eu tivesse que resumir na tese mais limpa possível, seria algo assim:

Codex-GPT-5.4 em xHigh para tudo que é relacionado a code. Claude Code com Opus 4.7 em xHigh para todo o resto.

É uma divisão mais nítida do que eu esperava dezenove dias atrás.

Também é uma resposta mais cara, e psicologicamente mais reveladora, do que eu imaginava.

O que quebrou primeiro não foi a qualidade do code

Quando escrevi o post do cancelamento, a história simples era atraente:

- Claude Max: $200/mês

- Codex / ChatGPT: $20-25/mês

- a diferença de qualidade de execução estava diminuindo rápido

- a confiabilidade da OpenAI parecia mais forte

Aquilo parecia um downgrade fácil.

Não foi.

A primeira coisa que quebrou não foi arquitetura, nem qualidade de plano, nem disciplina de execução.

Foi a história dos limites.

Minha linha do tempo real ficou mais ou menos assim:

- Apr 6: assinei dois assentos de ChatGPT Business por $25/mês cada, com cobrança mensal.

- Apr 6: eu já estava pensando em termos de workaround. Para manter mais ou menos o mesmo ritmo de coding, eu suspeitava que talvez precisasse de umas três contas com capacidade de Codex.

- Apr 10: depois de alguns dias tentando viver dentro dessa configuração, eu já tinha evidência suficiente para dizer em voz alta: três contas baratas ainda não recriavam o que o plano Claude Max tinha me dado no seu melhor momento.

- Apr 12: comprei ChatGPT Pro por $100/mês porque, quanto mais eu usava Codex para trabalho puro de coding, mais eu queria GPT-5.4 em raciocínio high e xHigh, não menos.

Essa é a primeira correção honesta ao post de 3 de abril.

O substituto não foi "$200 de Claude Max viram $20 de Codex".

Foi mais algo assim:

- "Eu não preciso mais do mesmo plano da Anthropic que eu precisava antes."

- "Eu preciso, sim, de mais capacidade de Codex do que a faixa barata entrega."

- "A comparação real é qualidade de workflow sob limites reais, não screenshot de benchmark."

Minha leitura atual é que a OpenAI provavelmente está sendo agressiva com limites porque quer ganhar market share. Isso é uma inferência, não informação interna. Se isso for verdade, essa janela talvez não fique aberta para sempre.

Então, se você está baseando toda a sua decisão na economia de $20 de hoje, pelo menos vale admitir que o ambiente de pricing pode ser tático, não estável.

O Codex ficou com a cadeira de coding

A maior coisa que eu aprendi é que GPT-5.4 em xHigh thinking parece um especialista em coding.

Não um especialista carismático.

Não um especialista caloroso.

E nem particularmente interessado em virar seu amigo.

Mas um especialista.

Existe uma sobriedade no Codex de que eu acabei gostando mais do que esperava. Parece trabalhar com um engenheiro sem frescura, cuidadoso, metódico, que não está tentando performar personalidade na sua frente.

Isso importa mais do que eu imaginava em dias longos de trabalho.

O momento mais claro para mim foi 17 de abril. Dei ao Codex-GPT-5.4 em xHigh um plano já combinado e deixei ele trabalhar. Ele rodou continuamente por trinta a quarenta e cinco minutos em uma única sessão, seguindo o plano de perto, escrevendo e executando unit tests, integration tests e browser tests em local, sem eu precisar ficar em cima o tempo inteiro.

Eu não tive outra ferramenta fazendo isso por mim com a mesma consistência.

Isso mudou a forma como eu penso sobre o Codex. Não é só "bom o bastante para tarefas pequenas". Ele consegue executar por muito tempo, com disciplina, quando o plano está claro.

Para trabalho puro de coding, agora eu recorro ao Codex quase sempre:

- arquitetura

- implementação

- debugging

- desenho de evals

- enquadramento de testes

- limpeza de pipeline

- lógica de produto com cabeça de produção

O melhor exemplo de abril é a Prova.

A maior parte do trabalho útil na Prova não foi glamourosa. Não foi "olha como o modelo é inteligente". Foi:

- avaliar sprints componíveis

- apertar a lógica de onboarding

- encontrar contradições entre a geração do roadmap e o estado do sprint atribuído

- melhorar o produto com base em linhas reais de usuários e comportamento real de produção

Esse tipo de trabalho acabou combinando muito bem com o Codex.

Ele é competente, minucioso e surpreendentemente afiado quando o trabalho é:

- identificar a contradição

- isolar o bug lógico

- separar correção de território de RFC

- recomendar o menor próximo passo que ainda seja defensável

Um dos exemplos mais claros saiu de uma única linha de produção da Prova para um usuário com intenção de builder.

O sistema tinha:

- rotulado um usuário com intenção de builder como

marketing_vp - atribuído

table-stakes-diagnostic - gerado um roadmap que começava mais tarde na jornada

- mostrado um card de Context Check logo depois do onboarding

O que tornou esse episódio útil não foi só o diagnóstico, mas o loop de revisão cruzada.

O Opus 4.7 me levou aos três primeiros problemas:

- um bug de cálculo de track

- um bug de timing

- uma questão de builder-opener / RFC

Depois o GPT-5.4 levou a análise mais longe e encontrou a contradição que o Opus tinha deixado passar:

- o primeiro sprint atribuído e o roadmap gerado já estavam dizendo duas verdades diferentes para o mesmo usuário

Isso importou. A conversa saiu de "devemos shippar o Builder RFC agora?" para "corrige primeiro a contradição ao vivo e depois volta para o RFC".

Não pareceu um modelo tentando me impressionar. Pareceu um senior SWE dizendo: arruma primeiro a contradição atual, depois a gente discute teoria de produto.

Esse padrão se repetiu vezes suficientes neste mês para eu parar de pensar no Codex como "a alternativa mais barata". Eu passei a pensar nele como meu instrumento principal de coding.

O Claude Code ficou com todas as outras cadeiras

Se a história terminasse aí, a resposta seria simples: troca para o Codex e segue.

Não foi isso que aconteceu.

O Claude Code com Opus 4.7 ainda é melhor para trabalho em que o resultado depende de gosto, ou em que o loop é longo, iterativo e pesado em contexto.

É aí que o título deste post deixa de soar contraditório e passa a soar preciso. Claude Code, a CLI para a qual eu instintivamente corria quando era hora de escrever code, agora é a ferramenta para a qual eu corro quando é hora de fazer qualquer coisa menos escrever code.

Por "todo o resto", eu quero dizer:

- escrita que soe como eu

- iterar em estrutura e ritmo

- naming e positioning

- taglines e linguagem de marca

- prompts de imagem para capas de posts

- exploração de logo e identidade

- passes melhores de

/frontend-designquando o trabalho precisa de julgamento visual, não só UI funcional - threads longas de pesquisa em que estou construindo um ponto de vista ao longo de várias sessões

Pela minha experiência nesses dezenove dias, isso continuou verdadeiro repetidamente.

O gap fica especialmente óbvio quando existe loop de feedback.

Tanto Claude quanto Codex conseguem ler posts antigos, inspecionar prompts passados e usar trabalho anterior como referência. Mas, quando eu estou fazendo múltiplas rodadas de refinamento com feedback depois de cada tentativa, o Claude ainda parece entender com mais confiabilidade a direção que eu quero seguir.

Isso vale para escrita.

Também vale para image prompting.

Também vale para naming.

O exemplo de produto mais claro é a Prova. Eu não cheguei nesse nome com Codex. Eu precisei do Opus para esse tipo de trabalho. E a mesma coisa vale para muita exploração de linguagem de marca. O GPT-5.4 me dá respostas sólidas, competentes. O Opus me deu amplitude criativa mais forte.

O mesmo padrão aparece no design do site.

O workflow de /frontend-design dentro do Superpowers ainda funciona melhor para mim no Opus do que no GPT-5.4 quando o trabalho é guiado por design em vez de engenharia. O Codex me dá algo funcional. O Claude mais frequentemente me dá algo que eu realmente teria orgulho de shippar.

Então, se a pergunta é:

"O Codex substituiu o Claude para tudo?"

Não.

Ele substituiu o Claude na cadeira de coding. Não substituiu para todo o resto.

Essa distinção importa.

A familiaridade era real, e a abstinência também

Eu vinha usando o Claude Code há cerca de 13 meses.

Esse tempo muda sua linguagem corporal no trabalho, não só sua lista de preferências.

Quando eu passei a usar o Codex de forma mais agressiva, percebi claramente uma espécie de efeito de abstinência.

Não porque o Codex fosse ruim.

Mas porque ele era diferente.

Os pontos de atrito eram pequenos, mas persistentes:

- certas confirmações de permissão

- a sensação de que, em alguns momentos, ele fazia uma pergunta a mais

- o tom estéril das respostas

- a ausência daquela "voz" familiar do Claude no loop

Esses não são defeitos objetivos.

São diferenças de workflow.

E a familiaridade muda a forma como você as sente.

Eu não quero fingir que passei por essa transição como um economista totalmente racional.

Não passei.

Em certo momento, eu me peguei passando trabalho pelo Claude só como uma revisão extra de segurança, não porque eu realmente precisasse da segunda opinião, mas porque a força de atração era maior do que a minha própria narrativa de "estou fazendo uma troca limpa".

O que isso me ensinou é que a dependência real não estava só na capacidade bruta do Claude. Estava também na sensação de segurança que vinha de ter outro sistema inteligente no loop, em que eu confiava de um jeito diferente.

É também por isso que, para mim, a resposta final nunca seria "escolha um para sempre".

A psicologia do workflow também importa.

O Codex tem seus próprios failure modes

Esse período não foi uma longa sequência de vitórias do Codex.

Eu também bati em problemas reais.

O primeiro que pareceu um problema genuinamente específico do Codex aconteceu em 14 de abril. Em duas sessões de terminal, eu bati neste erro:

{

"error": {

"message": "Unknown parameter: 'prompt_cache_retention'.",

"type": "invalid_request_error",

"param": "prompt_cache_retention",

"code": "unknown_parameter"

}

}

Esse tipo de coisa importa porque quebra a confiança na camada do harness, não na camada de raciocínio.

Também notei que o Codex parece mais rígido sobre o que o modelo tem permissão para fazer perto de deploy ou ao tocar produção, mesmo depois de aprovações já terem sido concedidas antes na sessão.

Às vezes isso é bom.

Às vezes é irritante.

Mas isso com certeza faz parte da experiência real de uso.

Um exemplo pequeno de que eu realmente gosto mais do lado do Codex: checar status e limites sem interromper o fluxo principal. Conseguir rodar /status sem esperar o trabalho atual terminar é uma coisinha, mas em dezenove dias essas pequenas ergonomias vão se acumulando.

É isso que eu quero dizer quando falo que as ferramentas não são diferentes só na qualidade da saída. Elas são diferentes na sensação do harness.

Confiabilidade ainda importa, e abril não ajudou o lado do Claude

Um dos motivos pelos quais eu me senti confortável para fazer a troca em primeiro lugar foi confiabilidade.

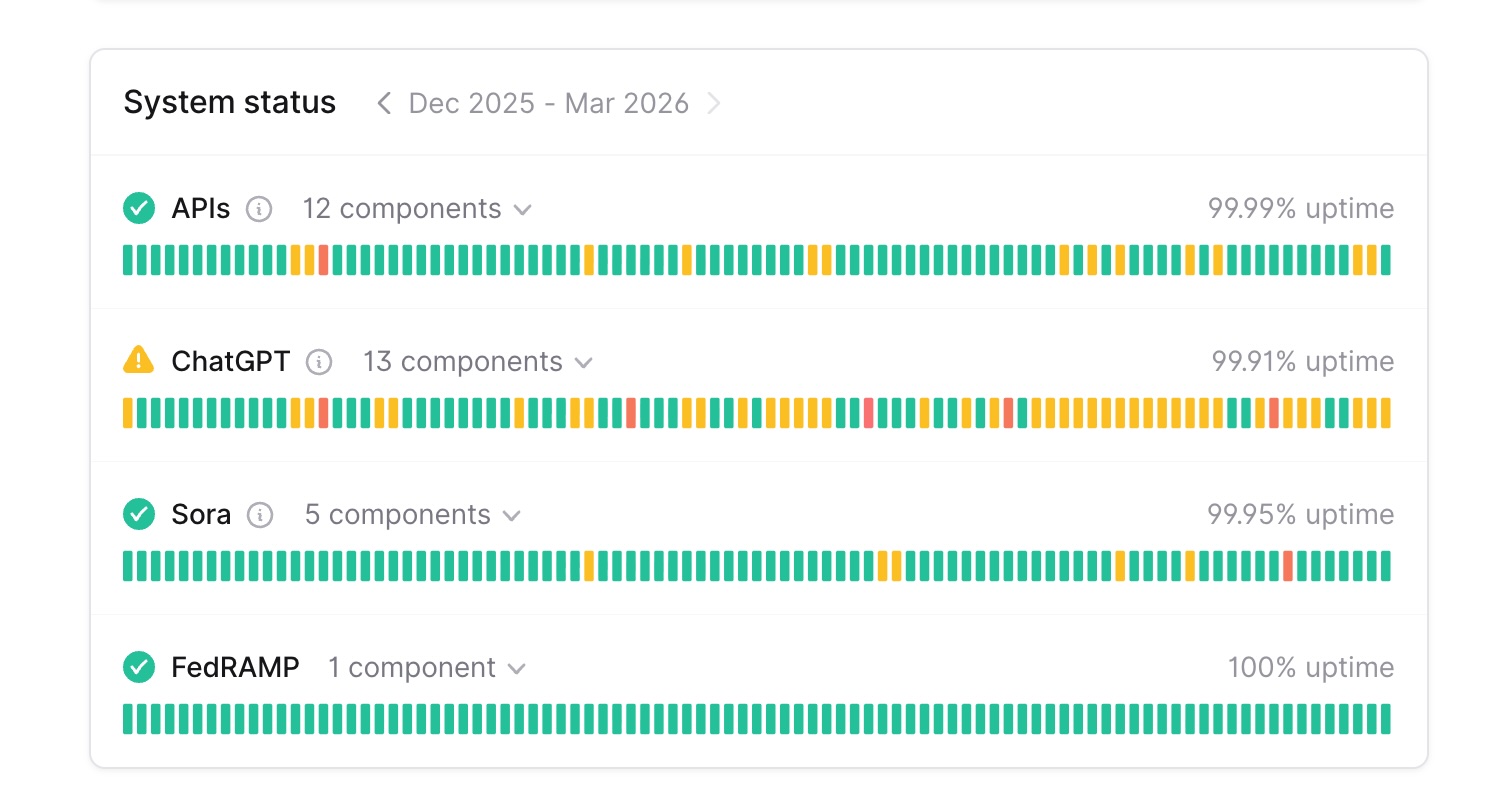

Eu já tinha escrito sobre a diferença de status em 90 dias entre Anthropic e OpenAI no follow-up de 31 de março. O quadro geral continua importando:

E abril ainda trouxe outro lembrete do mundo real.

Em 15 de abril, o Claude voltou a ter elevated errors em Claude.ai, na API e no Claude Code. O login foi afetado. A API se recuperou primeiro. Usuários do Claude Code que já estavam logados conseguiram continuar trabalhando, mas o próprio login ficou quebrado por um tempo.

Isso não apaga as qualidades do Claude.

Mas fortalece o caso prático de não apostar todo o seu workflow em um único fornecedor.

Essa continua sendo uma das lições mais duráveis do experimento inteiro:

Usar duas ferramentas não é só luxo. É resiliência operacional.

Quando um fornecedor tem uma tarde ruim, você continua shipando.

O Opus 4.7 deixou o padrão mais nítido; não virou a mesa

O Claude Opus 4.7 saiu em 16 de abril. Publicar qualquer veredito honesto sem testá-lo de verdade não seria justo.

Então eu o coloquei quase imediatamente diante de um diagnóstico real de coding na Prova.

O Opus 4.7 me deu um first pass sólido. Identificou o bug de track, o card Context Check fora do tempo e a questão mais ampla do Builder-opener.

Depois eu passei esse diagnóstico pelo GPT-5.4 como um critique pass, não como uma segunda opinião cega, mas como um reviewer olhando a análise escrita pelo Opus. O GPT-5.4 encontrou a contradição mais afiada que o Opus tinha deixado escapar: o produto já estava atribuindo um primeiro sprint enquanto gerava um roadmap começando em outro lugar. Isso não era só uma questão de builder fit. Era um problema real de correção em produção.

Depois empurrei o diagnóstico revisado de volta para o Opus, e ele convergiu.

A surpresa veio na direção oposta.

Em 19 de abril, notei algo que eu não esperava: para tarefas mais simples — uma passada curta de code review, uma execução focada em uma pequena mudança — o Opus 4.7 em xHigh está visivelmente mais lento do que o Codex-GPT-5.4 em xHigh. Eu esperava o contrário.

Esse detalhe sozinho reancorou meu padrão.

Onde o Opus continua claramente vencendo para mim é no trabalho carregado de gosto, iterativo e de contexto longo que descrevi acima. Onde o Codex continua claramente vencendo é no diagnóstico profundo de coding e também nos giros cotidianos de coding para os quais eu costumava chamar o Claude.

Então a versão honesta é:

- o Opus 4.7 ainda consegue me dar um bom first pass em análises de code mais profundas

- em giros mais leves de coding, ele hoje parece mais lento do que o GPT-5.4 no mesmo nível de thinking

- combinado com a experiência de execução contínua do dia 17 de abril, isso empurrou a cadeira de coding ainda mais para o Codex, em vez de trazê-la para perto de um empate

Onde eu realmente fui parar

Se você tirar o drama, os screenshots de preço, os screenshots de outage e o enquadramento de post social, em 22 de abril meu padrão de trabalho ficou assim:

Para qualquer coisa relacionada a code

Eu recorro primeiro ao Codex com GPT-5.4 em xHigh thinking.

Por quê:

- ele parece especializado

- ele é metódico

- ele é cuidadoso

- ele lida bem com arquitetura e execução

- ele consegue rodar um plano combinado completo, com unit tests, integration tests e browser tests, por trinta a quarenta e cinco minutos seguidos

- nos giros cotidianos de coding, ele está mais rápido do que o Opus 4.7 em xHigh neste momento

- ficou mais fácil para mim confiar nele em trabalho profundo de coding

Para todo o resto

Eu recorro ao Claude Code com Opus 4.7 em xHigh thinking.

Isso agora cobre:

- escrita que precisa soar como eu

- prompts de imagem para cover art

- naming, positioning e linguagem de marca

- passes de

/frontend-designque precisam de julgamento visual - threads longas de pesquisa em que estou construindo um ponto de vista ao longo de várias sessões

- revisar meus próprios planos antes de passá-los ao Codex

- este post

Por quê:

- ele segue melhor o meu estilo

- ele lida melhor com iteração criativa guiada por feedback

- ele é mais forte em gosto de marca e gosto de design

- continua sendo o modelo em que eu mais confio quando o trabalho é julgamento, não execução

Para planos importantes de coding

Eu continuo gostando do loop de revisão cruzada:

- pegar um plano de um

- fazer o outro criticar

- e apertar a partir daí

Esse workflow continua me parecendo mais robusto do que apostar na primeira resposta de um único modelo, por melhor que esse modelo seja. A linha de builder-intent que eu descrevi acima é exatamente o motivo de eu ainda gostar dessa configuração.

Para pricing

Eu não terminei numa troca simplista e barata.

Eu terminei aqui:

- sem querer mais a antiga estrutura de Claude Max a $200

- querendo mais capacidade de Codex, não menos

- aceitando o ChatGPT Pro a $100 como a resposta mais realista para meu plano de coding

- mantendo o Claude no loop para tudo que não é code

Para shipping

O ponto inteiro da troca era continuar shipando. Isso não foram dezenove dias de benchmarking de ferramenta sem nada para mostrar. Na mesma janela, a separação Operator/Builder da Prova foi ao ar com uma lane real de execução para Builder, dois posts longos foram publicados e eu rodei um pass completo de tradução em doze locales. A resposta para a pergunta se o experimento me custou output é não.

Se você quiser a versão mais comprimida:

Eu cancelei o Claude Max, mas não eliminei o Claude Code do meu trabalho. Eu movi o Claude Code para fora da cadeira principal de coding e dei a ele o resto da mesa.

Esse é o resumo mais verdadeiro que eu consigo dar.

Então: eu tomaria a mesma decisão de novo?

Sim.

Mas eu a descreveria de forma diferente agora.

Em 3 de abril, o framing era:

"Cancelei o Claude Max e estou testando se o Codex consegue substituí-lo."

Em 22 de abril, o framing está mais para isto:

"Cancelei o Claude Max, descobri que o Codex é agora o especialista em coding mais forte para mim e agora uso o Claude Code para todo o resto na minha mesa — onde ele continua sendo a melhor ferramenta que eu tenho."

Essa resposta é menos binária, mais cara do que a versão simples de post social e muito mais próxima da verdade.

Perguntas frequentes

O Codex realmente substituiu o Claude para coding?

Para mim, sim. Em trabalho puro de coding, o Codex com GPT-5.4 em xHigh thinking virou minha cadeira padrão. O Opus 4.7 em xHigh ainda consegue me dar um bom first pass em diagnóstico mais profundo, mas ele já não ocupa a cadeira principal de coding para mim e hoje parece mais lento nos giros mais leves.

A história do Codex barato se sustentou?

Não muito. No momento em que eu usei isso em volume real, a economia da faixa barata deixou de ser a história inteira. Eu fui para um plano mais caro da OpenAI porque queria mais capacidade, não porque o experimento tinha falhado.

Você ainda precisa do Claude?

Sim, se o seu trabalho inclui escrita, design, naming, image prompting, threads longas de pesquisa ou qualquer outro loop pesado em gosto ou julgamento. O Opus 4.7 em xHigh virou o padrão para tudo que não é code no meu workflow.

E a confiabilidade?

A diferença de confiabilidade continua importando. Abril reforçou isso. A resposta não é pânico. A resposta é cobertura de backup.

Por que publicar onze dias antes?

Porque o padrão se assentou. Segurar o post até 2 de maio só para honrar o número exato do título original teria sido teatro. A coisa honesta era dizer o que eu realmente faço agora e seguir em frente.

Então qual plano eu compraria hoje?

Se o seu trabalho é majoritariamente coding, eu olharia com muita seriedade para Codex / GPT-5.4 primeiro. Se o seu trabalho mistura coding com bastante trabalho criativo guiado por gosto, eu não gostaria de ficar sem Claude. E se $100 por mês estiver fora de alcance agora, a faixa de $20 do Codex ainda funciona para projetos individuais menores — só espere bater em limites mais rápido sob trabalho sustentado em múltiplos projetos. Minha resposta pessoal, neste momento, já não é uma resposta de ferramenta única.

Esse é o update honesto de dezenove dias.

O Codex ficou com a cadeira de coding.

O Claude Code ficou com todas as outras cadeiras.

É por isso que uma ferramenta literalmente chamada Claude Code agora é a ferramenta para a qual eu corro quando o trabalho é tudo, menos code.

E a lição real, mais uma vez, é que o workflow importa mais do que o fandom.

Se você fez uma troca parecida neste mês, eu realmente gostaria de saber onde você foi parar. Uma ferramenta venceu de vez para você, ou a sua própria divisão também ficou mais nítida?

Abraços,

Chandler