「Bing AIは信頼できない」への反応

Bing AIが財務データを捏造しているという主張をファクトチェックしてみました。結果、でたらめな数字の問題は本物で、期待していたよりも深刻でした。

この記事は2023年に書かれたものです。一部の情報が変更されている可能性があります。

今日この記事を見つけました — Bing AI can't be trusted。当然ながら、興味を引かれました。新しいBing chatが事実情報について多くのでたらめな事実を含んでいることを示すファクトチェック満載の良い記事です。投稿は比較的短いので、ぜひ読んでみてください。

私からいくつかの簡単な反応です:

驚きであり、同時に驚きではない

大規模言語モデル(LLM)の制限については一般的に認識しています。chatGPTはその一つです。主な3つの制限は:

- テキストデータ以外のWebをインデックスしない(動画、音声、画像など...)

- chatGPTのデータセットは本当に古い(2021年)

- これらのモデルは、どの情報ソースがより権威性/信頼性が高いかを知らないため、言葉をでっち上げます

そのため、Bing & OpenAIの統合により、Bing検索エンジンが上記のすべての制限を解決してくれることを期待していました。しかし、Dmitriの記事に基づくと、Bingはまだ解決していないようです。まったく解決できていません。

記事を再度ファクトチェックする

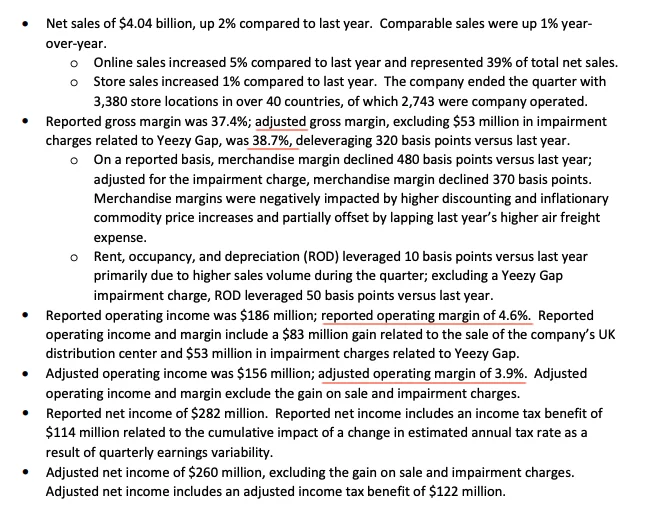

Dmitriが述べたことが事実として正しくないのも良くないでしょう。そこで、自分でいくつかのファクトチェックを行いました。最も確認しやすいと思われるGapの財務諸表から始めます。ソースとスクリーンショットを以下に含めていますので、この作業を繰り返す必要はありません:

- こちらがGapの2022年第3四半期の決算発表です。

- 以下のスクリーンショットはGapの声明から撮影し、重要な数字を赤でハイライトしました。Dmitriの言う通り、Bing chatは調整後粗利益率、営業利益率などの数字をでっち上げていました...

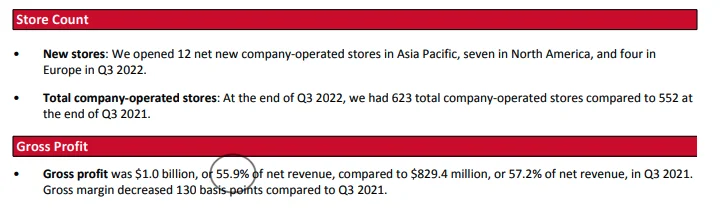

Lululemonの数字はどうでしょうか?

- こちらがLululemonの2022年第3四半期の財務報告です。同様に、Dmitriの記事で言及された重要な数字を以下のスクリーンショットでハイライトしました。彼の言う通り、Bing検索は数字をでっち上げていました。

メキシコシティの旅程については、このトピックの専門家ではないので、慎重にファクトチェックできません。例えば、「Primer Nivel Night Club - Antro」を検索したとき、このFacebookページを見つけました。しかし、Bing Searchの提案が有効かどうかを100%確実に検証する方法がありません。

ここからどこへ向かうか?

現時点で、Bing & OpenAIの統合は、大規模言語モデル(LLM)がとりあえず何かをでっち上げる問題を解決できていないことは明らかなようです。

この問題を解決することがどれほど難しいのか、技術的に十分理解していません。事実データでこれほど不正確であるなら、最高のレストラン/配管工/地元のサービス、個人の財務、健康、人間関係などのより主観的なトピックについては注意が必要です。

公平を期すため、BingとOpenAIは、プレゼンテーション中に新しい技術は多くのことを間違える可能性があることを理解していると述べ、ユーザーが簡単にフィードバックを提供できるように「いいね/よくないね」のインターフェースを設計しました。より多くのユーザーフィードバックによって、マシンが改善されることを期待しています。

LLMの出力をファクトチェックするアルゴリズム?

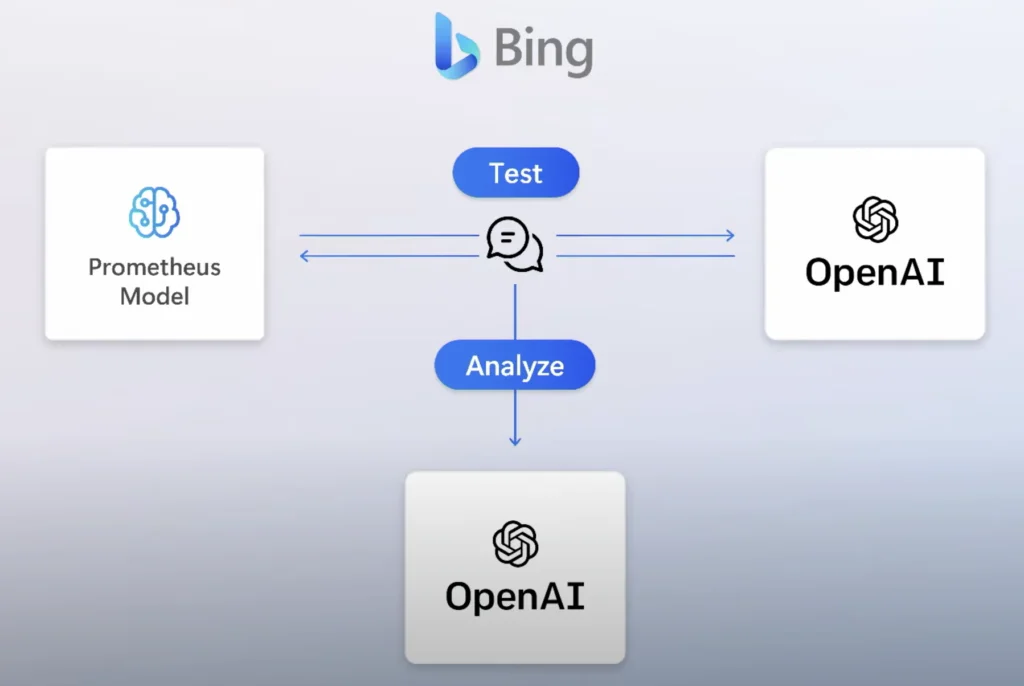

LLMがしばしば間違った出力を生成するため、出力を継続的にファクトチェックするアルゴリズムを作成してはどうでしょうか?これは、MicrosoftがPrometheusに組み込んだ安全アルゴリズムについて語ったことに似ており、悪意のある者のプロンプトをマシンにシミュレーションするものです。

人間の役割

この技術はまだ初期段階にあるようで、進歩は指数関数的ですが、人間の役割は重要です。Bing & OpenAIの統合があっても、まだ出力を信頼することはできません。マシンは望ましい結果の50%程度(多かれ少なかれ)を助けてくれますが、残りの50%は私たちが担う必要があります。

この技術の強みと限界を調整し、学び、効果的に使うための十分な時間があるようです。

これらのシステムを設計するエンジニアたちは、マシンが確信を持てないデータポイントや文章をエンドユーザーにもっとハイライトする必要があるでしょう。人間の脳はショートカットが好きなので、私たち多くの人(自分自身を含め)は怠惰なルートを取って、マシンが言うことを真実として受け入れてしまうでしょう :P 100%の時間ガードを上げ続けるのは私たちには難しいことです。

自信たっぷりに間違っていたAI生成の回答に遭遇したことはありますか?具体的な例を聞いてみたいです。

よろしくお願いします、Chandler