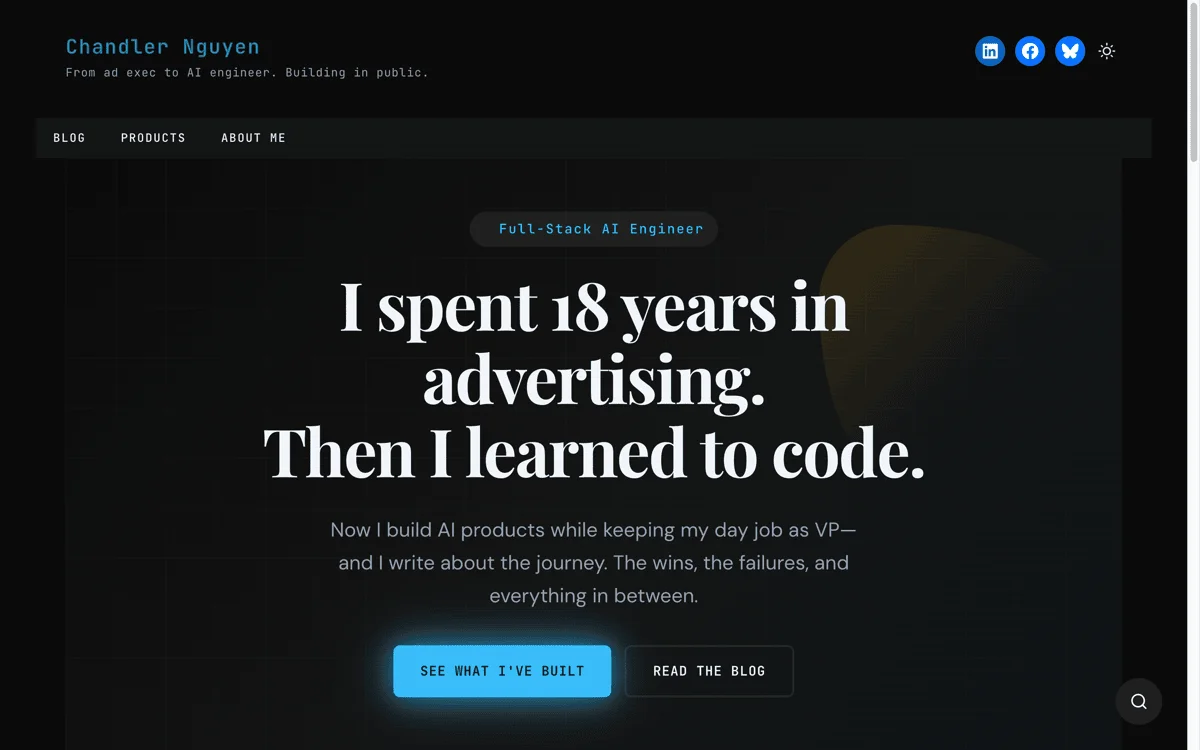

CrewAIはすごい! - 私のファーストインプレッション

CrewAIでAI生成ポッドキャストを10日間構築した結果、フレームワークは驚くほど使いやすいものの、高品質なコンテンツには依然として人間の真剣な努力が必要だと学びました。

数週間前、「Practical Multi AI Agents and Advanced Use Cases with crewAI」というコースを通じてCrewAIに出会いました。すでにエージェントSydneyにLanggraphを使用しているため、最初は試すのをためらっていましたが、2つのことが興味を引きました:

- ゼロからポッドキャストを作成する方法を探っていました。特に、記事をコピペするのではなく、15年分のブログコンテンツをGen AIに「推論」させる方法に注目していました。NotebookLLMでも試しました(まあまあの結果でした。ポッドキャストのエピソードはこちらで聴けます)が、会話の流れやオープニングフックをもっとコントロールしたかったのです。

- 新しいことを学び、OpenAIのtext-to-speechモデルを試してみたかったのです。

2025年11月の更新: エージェントフレームワークを卒業し、Claude CodeとGoogle Gemini CLIでゼロからコーディングを始めました。これにより、はるかに多くのコントロールが得られました。最新のリリースはSTRATUM(マーケットインテリジェンス)とDIALOGUE(AIポッドキャストジェネレーター)です。これらは以下のCrewAI実験から直接進化しました。

CrewAIで約10日間遊んだ後の主な所感は以下の通りです:

1. 良い点

1.1 驚くほど簡単に始められる

- 学習曲線は非常に短く、わずか数時間で使い始められました

- カスタムツールの設定(Weaviateをベクトルストアとして使用してブログからコンテンツを取得するなど)は簡単でした。ポッドキャストのスクリプトを音声出力に変換するのもかなり簡単に設定できます。

- YAMLファイルを使って自然言語でエージェントとタスクを記述できる機能はパワフルです(プロのヒント:Visual Studio Codeのオートコンプリートがここでとても役立ちます!)

1.2 柔軟なモデル選択

異なるLLM間の切り替えはcrew.pyを更新するだけです:

llm_openai_4o_mini = LLM(model="gpt-4o-mini", temperature=0)

llm_anthropic_35 = LLM(model="claude-3-5-sonnet-20240620", temperature=0)

llm_openai_4o = LLM(model="gpt-4o", temperature=0)

llm_gemini_15_pro = LLM(model="gemini/gemini-1.5-pro-002", temperature=0)

各モデルの強みに基づいて、異なるエージェントに特定のモデルを割り当てられます。例えば:

@agent

def content_researcher(self) -> Agent:

return Agent(

config=self.agents_config['content_researcher'],

llm=llm_anthropic_35,

tools=[BlogContentRetrievalTool()],

verbose=True

)

これらすべてにより、ポッドキャストの構成やスクリプトの作成方法について大きなコントロールが得られます。

1.3 Text-to-Speech:期待と限界

OpenAIのtext-to-speech APIは品質面で印象的ですが、現在はわずか6つのボイスモデルしか提供していません。ポッドキャスト制作においてはかなり制限的です。特に複数のホスト間の魅力的な会話を作ろうとする場合はなおさらです。ボイスのバリエーションが少ないため、同じテクノロジーを使用する他のポッドキャストと似た音になる可能性があります。OpenAIがボイスオプションを拡充するか、他のtext-to-speechプロバイダーとの統合を通じて、この分野の改善を期待しています。

AI安全性の懸念も理解できるので、各AIラボがあまり多くのボイスモデルを急いで提供しないのも理解できます。

2. 現実の確認:「クリック一つで作成」ではない

最初は、オンラインで見かけるAI生成コンテンツ(いわゆる「AI Slop」)の洪水に加担してしまうのではないかと心配しました。結局、約5分で15分間のポッドキャストスクリプトを生成できたのですから。(上記のDeepLearning.AIのトレーニングコースでは、Joaoが「大規模コンテンツ作成」のコード例を実際に紹介していました。)

しかし、最初のいくつかのスクリプトを実際に読んで/レビューした後、私の見方は変わりました。

高品質なコンテンツの制作にはまだ大きな労力が必要です!

2.1 考え抜かれたエージェント構成

AIクルーの構成を何度も見直し、追加の役割、特に「fact_checker」の役割を加える必要がありました。現在のポッドキャストクルーには:

- Content researcher(コンテンツリサーチャー)

- Script writer(スクリプトライター)

- Fact checker(ファクトチェッカー)

- Script editor(スクリプトエディター)

- Audio producer(オーディオプロデューサー)

2.2 継続的な改善

成功には以下が必要です:

- 業界固有の言語を使って各エージェントの目標とタスクを慎重に定義すること。ポッドキャストの実際の業界経験を持つ人は、業界固有の言語を使って各エージェントに非常に具体的なタスクを実行させることができます。その方が出力はずっと良くなります。

- ツールへのアクセスを選択的にすること(多ければ良いとは限りません)。エージェントが無限ループに陥りやすいです。

- エージェント間の明確な委任ルール

- 具体的な出力構造の要件

- 「良い仕事とはどのようなものか」の明確に定義された品質基準(娘にもここで協力してもらいました。彼女がクリエイティブ担当です! :D)

つまり、AIエージェントのクルーを使うことで作業が大幅にスピードアップしますが(リサーチからスクリプト作成、ファクトチェック、修正、オーディオ作成まで少なくとも5倍)、高品質なコンテンツを作るのは私次第です。

2.3 モデル選択が重要

異なるLLMモデルにはそれぞれの「個性」と指示に従うレベルの違いがあります。プロセスの各ステップでのニーズに合った異なるモデルの強みと弱みを理解するために実験が必要です。

いくつかの所感:

- 同じモデルでもAPIレスポンスとWebチャットインターフェースのレスポンスが異なることがあります

- 現在、APIを使った長文コンテンツにはAnthropicモデルを好みます。ただし、Webバージョンに関しては、claude-3-5-sonnet-20241022とGPT-4oは同等だと思います

- コーディングタスクにはOpenAIのo1-previewが私の頼りです

2.4 フィードバックとメモリーがゲームチェンジャー

AIクルーにフィードバックを提供する必要があります。指示に従うのは得意ですが、あなたが何を望んでいるかは知りませんし、心を読むこともできません(少なくともまだ haha)。フィードバックを通じてクルーをトレーニングする能力は極めて重要です。

CrewAIでは、クルーのトレーニングとフィードバックの提供は非常にシンプルで、以下を実行するだけです:

crewai train -n <n_iterations> <filename> (optional)

CrewAIのメモリー機能はまだ十分に探求していませんが、フィードバックとメモリーの組み合わせは、一貫した高品質な出力を作成するのに非常にパワフルなようです。

3. 結果を見せてください!

わかりました、わかりました。「Chandler、十分話したよ。AIクルーが生成したポッドキャストスクリプトのサンプルを見せて!」という声が聞こえます。

完全なワークフローの例はこちらです:

- リサーチフェーズ: Content Researcherエージェントがブログ記事から重要な情報を分析・抽出する様子

- ファクトチェックサマリー: Fact Checkerの詳細な検証レポート

- 初稿スクリプト: Script Writerのポッドキャスト会話の最初のテイク

- 最終洗練スクリプト: Script Editorが改善したフローとエンゲージメントの向上版

- 結果を聴く: Audio Producerエージェントによる最終音声版

上記の各リンクは、生のコンテンツから洗練されたポッドキャストへの進行を示し、異なるエージェントがどのように最終製品に貢献しているかを示しています。

パイプライン全体をさらに改善する方法についてまだ考えがありますが、上記が何が可能かの良いイメージを提供できれば幸いです。

最後に

CrewAIはシンプルさとパワーのバランスの良さで私を感銘させました。コンテンツ作成をより身近にしますが、魔法のボタンではありません。品質にはまだ専門知識、慎重な計画、継続的な改善が必要です。

CrewAIやLanggraphのようなマルチエージェントフレームワークを試したことはありますか?何を構築しているか聞きたいです。コメントを残すか、お気軽にご連絡ください。

よろしくお願いします、Chandler

2026年1月の更新: このCrewAI実験は最終的にDIALOGUEという本格的なプロダクションアプリになりました。上記で述べたボイスの制限は?最終的にGemini TTSに切り替え、7言語で30のボイスが使えるようになりました。6つのOpenAIボイスからかなりのアップグレードです!興味があれば、チェックしてみてください。