IA Sem Memória É Só um Chatbot Caro

Construí 9 agentes de IA que esqueciam tudo entre as conversas — desperdiçando 20 a 45 minutos por semana dos usuários que precisavam reexplicar seus negócios. Aqui está como fiz com que eles compartilhassem memória.

Já construí três produtos de IA — Sydney (meu chatbot pessoal), DIALØGUE (podcasts gerados por IA) e STRAŦUM (uma plataforma de inteligência de marketing com 9 agentes de IA). E tem uma lição que fico aprendendo do jeito difícil: IA sem memória é só um chatbot caro.

A primeira vez que isso realmente me pegou foi no início do desenvolvimento do STRAŦUM. Eu tinha dois agentes funcionando e gerando insights genuinamente úteis, mas eles não se falavam. Cada conversa começava do zero.

Você conta ao Agente de Estratégia sobre seus planos de expansão de mercado? Ótimos insights. Semana seguinte, você muda para o Agente de Conteúdo? Tem que explicar toda a estratégia de expansão de novo. Era como ter nove colegas brilhantes que tinham amnésia :P

Eu já tinha visto uma versão desse problema com a Sydney. Quando construí o sistema RAG dela, ela conseguia responder perguntas sobre minhas postagens, mas não se lembrava do que você tinha perguntado dois minutos antes. Cada pergunta era um começo fresco. Era... até que tudo bem, talvez? Mas não parecia uma conversa. Parecia interrogar um mecanismo de busca.

Com o STRAŦUM, esse problema era 9x pior. Nove agentes, zero contexto compartilhado.

Quando eu já tinha cerca de dois meses de desenvolvimento, descobri uma solução — o que chamo de "aprendizado progressivo". Conta a um agente sobre um objetivo de negócio e todos os nove agentes sabem sobre isso na próxima vez. Sem reexplicar. Sem perda de contexto. Acho que esse é o recurso que transformou o STRAŦUM de "9 ferramentas separadas" em algo que realmente parece uma plataforma inteligente e unificada.

Essa é a história de como construí isso. Posso estar errado sobre algumas das conclusões que tiro aqui — ainda estou aprendendo o que funciona e o que não funciona — mas quero compartilhar o que descobri até agora.

O Problema: Usuários Viraram Máquinas de Documentação

Deixa eu mostrar como eram as conversas iniciais no STRAŦUM:

Semana 1 com o Agente de Estratégia:

> Usuário: "Estamos planejando expandir para o mercado europeu no próximo trimestre"

> Agente: [Gera estratégia abrangente de entrada no mercado]

Semana 2 com o Agente de Conteúdo:

> Usuário: "Crie posts no LinkedIn para nossa campanha"

> Agente: "Quais temas esses posts devem abordar?"

> Usuário: "...nossa expansão europeia? Lembra? Da semana passada?"

> Agente: "Não tenho contexto sobre expansão europeia. Pode explicar?"

Tenho que admitir, quando vi isso acontecendo nos testes pela primeira vez, fiquei envergonhado. O usuário já tinha nos contado tudo. O Agente de Estratégia sabia. A informação estava bem ali no nosso banco de dados. Só não estávamos conectando os pontos.

Da minha experiência com os três produtos que construí, esse é o padrão: usuários não se importam de explicar as coisas uma vez. O que os incomoda é explicar de novo. Existe uma diferença fundamental entre "ensinar a IA" e "ser secretário da IA."

Fiz um cálculo aproximado de quanto tempo isso estava desperdiçando:

- Tempo médio de reexplicação: 2-3 minutos por conversa

- Conversas por semana: 10-15 em todos os agentes

- Tempo desperdiçado por usuário: 20-45 minutos semanais

- Perda anual de produtividade: 17-39 horas por usuário

Em escala, isso some rápido. Para uma plataforma com 10.000 usuários, são 170.000-390.000 horas de tempo humano desperdiçado anualmente. Mesmo que esses números estejam pela metade, é... muita gente se repetindo para uma máquina.

---

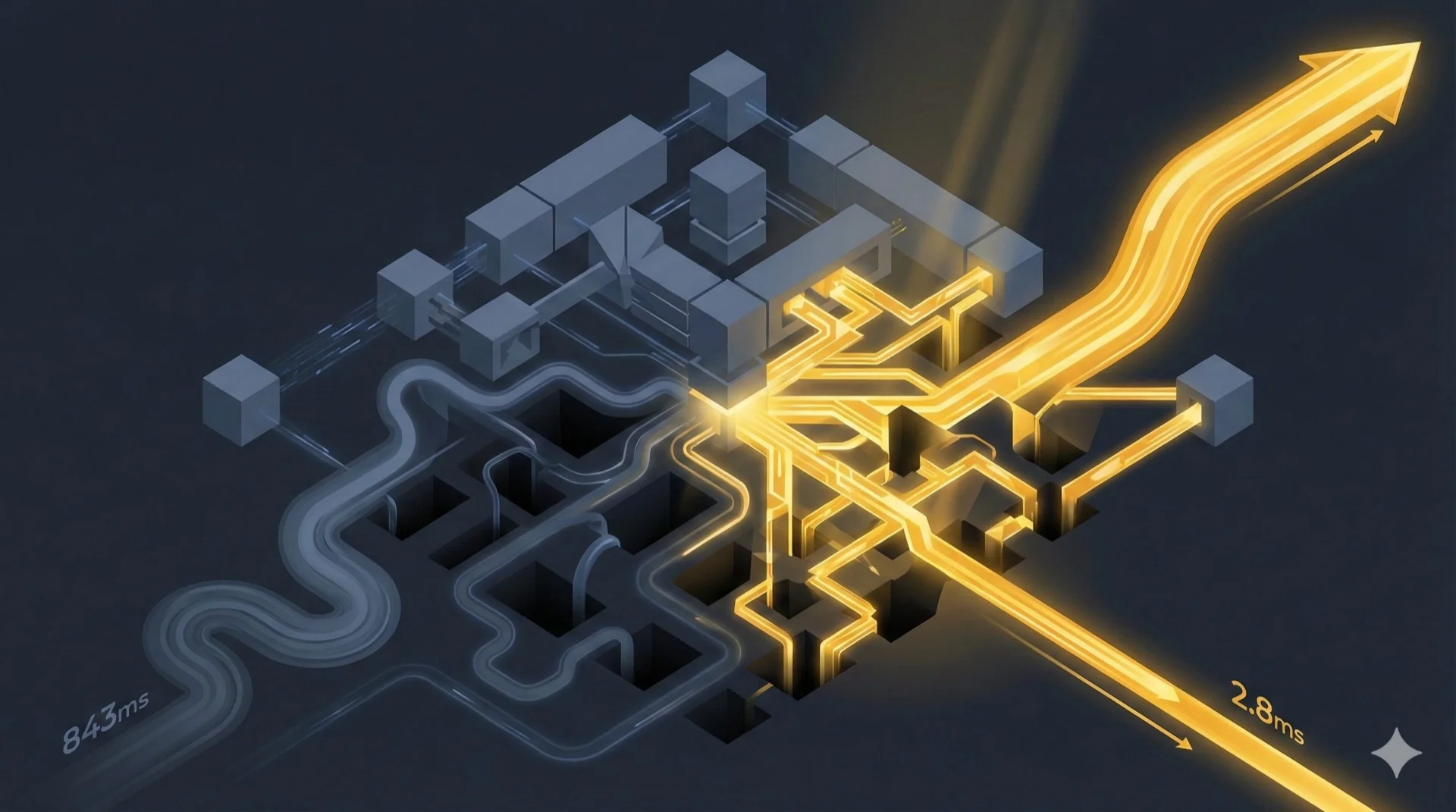

A Visão: "Conta a Um Agente, Informa os Nove"

Aí comecei a pensar — e se os agentes pudessem aprender com as conversas uns dos outros? Eu já tinha visto algo assim funcionar de forma mais simples com a Sydney: ela usa RAG para "lembrar" minhas postagens e histórico de carreira. Mas o STRAŦUM precisava de algo mais dinâmico — não apenas recuperar conteúdo estático, mas capturar novas informações de conversas ao vivo e compartilhá-las entre os agentes.

A experiência ideal que eu queria alcançar:

1. Usuário discute expansão de mercado com o Agente de Estratégia (Dia 1)

2. A plataforma captura automaticamente o insight-chave de negócio

3. Usuário fala com o Agente de Conteúdo (Dia 7)

4. O Agente de Conteúdo já sabe dos planos de expansão

5. Sem reexplicação. Só contexto inteligente.

Acho que é isso que faz a diferença entre uma ferramenta de IA que as pessoas usam às vezes e uma que elas realmente dependem. Não é sobre recursos sofisticados — é sobre a parte que lembra de você.

---

Como Funciona: A Experiência do Usuário

Aprendizado Automático

Essa foi a parte mais difícil de acertar, honestamente. Toda vez que você tem uma conversa significativa com qualquer agente, o STRAŦUM tenta identificar insights de negócio importantes que merecem ser lembrados:

- Planos de expansão de mercado

- Características do público-alvo

- Restrições orçamentárias

- Posicionamento competitivo

- Diretrizes de marca

- Estratégias de precificação

- etc

Você não precisa fazer nada. A plataforma aprende enquanto você trabalha. (Bom, esse é o objetivo. Ainda estou ajustando a parte de "o que vale lembrar" — mais sobre isso na seção de lições aprendidas.)

Inteligência Entre Agentes

Essa é a parte que me empolga :D A mágica acontece quando você muda de agente. Aquela restrição orçamentária que você mencionou ao Agente de Performance? O Agente de Campanha sabe sobre ela quando recomenda gastos com anúncios. A expansão de mercado que você discutiu com a Estratégia? O Agente de Conteúdo leva isso em conta nas recomendações de mensagens.

Nove agentes. Uma compreensão compartilhada do seu negócio.

Lembra do jeito que o DIALØGUE funciona, na verdade — quando gera um podcast, precisa lembrar a área de expertise do usuário, o estilo preferido, o público. Contexto diferente, mesmo princípio: IA que lembra de você é fundamentalmente diferente de IA que não lembra.

Aqui está como parece na prática — quando você começa uma nova conversa, o contexto relevante de interações passadas fica automaticamente disponível:

```python

# Toda conversa de agente começa com o contexto do seu negócio

async def get_business_context(org_id: str) -> str:

"""

Recupera insights relevantes de conversas anteriores.

Cada agente vê o que importa para o seu negócio.

"""

insights = await fetch_recent_insights(org_id)

# O contexto flui automaticamente para todos os agentes

return build_context_summary(insights)

```

A implementação real envolve filtragem cuidadosa e pontuação de relevância — mas o princípio é simples: seus agentes lembram do que importa.

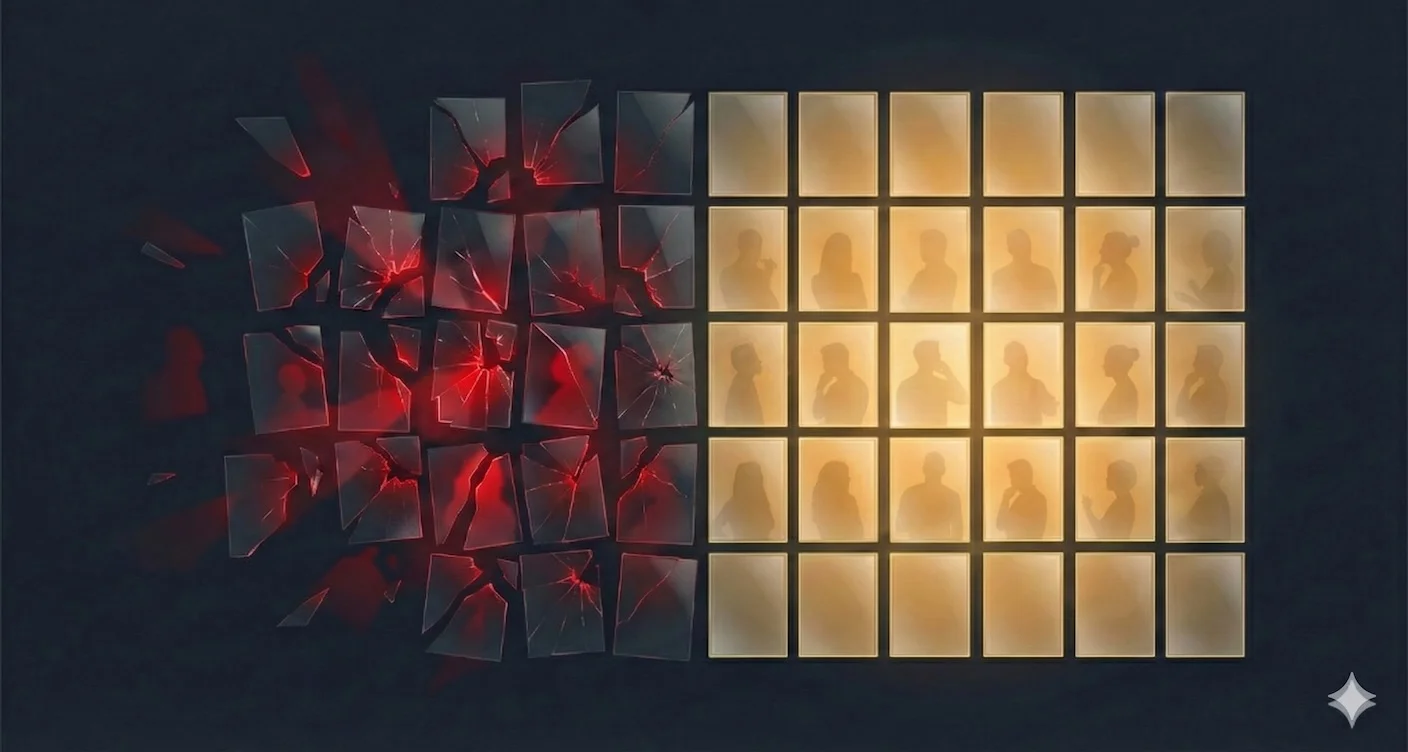

Transparência Total

Aqui tem algo que aprendi da maneira difícil: memória de IA pode parecer invasiva se você não sabe o que está sendo lembrado. No início dos testes, mostrei o sistema para alguém e a primeira reação foi "espera, o que mais ele sabe sobre mim?" Não é a reação que você quer.

Então construí transparência total no sistema. Aqui está o componente de UI que permite aos usuários ver e controlar sua inteligência de negócio:

```typescript

// Usuários veem exatamente o que a plataforma aprendeu

export function BusinessIntelligenceDashboard() \{

const { insights \} = useBusinessContext();

return (

<div className="space-y-4">

<h2>O Que o STRAŦUM Sabe Sobre Seu Negócio</h2>

{insights.map(insight => (

<InsightCard key={insight.id}>

<div className="flex justify-between">

<span className="font-medium">{insight.summary}</span>

<Badge>{insight.source_agent}</Badge>

</div>

<p className="text-sm text-muted">

Aprendido em \{formatDate(insight.created_at)\}

</p>

<Button

variant="ghost"

onClick={() => deleteInsight(insight.id)}

>

Remover este insight

</Button>

</InsightCard>

))}

</div>

);

}

```

- Ver tudo: Um painel dedicado mostra exatamente o que a plataforma aprendeu

- Atribuição de fonte: Saber qual agente aprendeu o quê, e quando

- Exclusão fácil: Um clique para remover qualquer insight que você não quer lembrado

- Sem aprendizado oculto: Tudo é visível e revisável

Os usuários confiam no sistema porque controlam ele.

---

Exemplos do Mundo Real

Exemplo 1: Expansão de Mercado

Dia 1 - Agente de Estratégia:

> Usuário: "Estamos planejando expandir para o mercado europeu no próximo trimestre, começando pela Alemanha e pelo Reino Unido."

> Agente: [Gera estratégia abrangente de entrada no mercado]

*Plataforma captura: Expansão para mercado europeu planejada, com foco na Alemanha e Reino Unido*

Dia 7 - Agente de Conteúdo:

> Usuário: "Crie posts no LinkedIn para o próximo mês"

> Agente: "Vejo que você está planejando expansão europeia. Esses posts devem preparar seu público para o lançamento internacional?"

Sem necessidade de reexplicar.

Exemplo 2: Consciência Orçamentária

Dia 5 - Agente:

> Usuário: "Nosso orçamento de marketing é em torno de $10k/mês"

> Agente: [Gera análise de alocação orçamentária]

*Plataforma captura: Orçamento mensal de marketing ~$10.000*

Dia 15 - Agente de Planejamento de Campanha:

> Usuário: "Devemos veicular anúncios pagos?"

> Agente: "Com base no seu orçamento mensal, recomendo uma alocação equilibrada entre canais pagos e criação de conteúdo..."

Contexto orçamentário lembrado.

---

O Desafio Multi-Tenant

O aprendizado progressivo fica complicado quando você atende tanto PMEs quanto agências.

Para PMEs: Simples. Toda a inteligência pertence à organização.

Para Agências: A inteligência de cada cliente deve ficar completamente isolada. Uma agência que gerencia o cliente A e o cliente B nunca pode ter a estratégia do cliente A influenciando acidentalmente as recomendações para o cliente B.

# O contexto de agência é sempre limitado ao cliente

def get_insights_for_conversation(org_id: str, client_id: str | None):

"""

PMEs: client_id é None, vê todos os insights da organização

Agências: client_id filtra apenas para o cliente específico

"""

if client_id:

# Usuário de agência trabalhando em cliente específico

# insights do cliente A NUNCA vazam para o contexto do cliente B

return fetch_client_insights(org_id, client_id)

else:

# Usuário PME, todos os insights da organização disponíveis

return fetch_org_insights(org_id)

Isso não é só um recurso — é um requisito de confiança. Um vazamento e os usuários de agência perdem a confiança para sempre.

Investimos muito em isolamento de dados em todos os níveis — lógica de aplicação, políticas de banco de dados e testes extensivos. A inteligência de negócio do Cliente A fica com o Cliente A. Sempre.

---

Por Que Isso Cria Uma Vantagem Real

Quero ser honesto sobre algo: não sou um estrategista de SaaS. Sou um construtor que passou 18 anos em publicidade antes de aprender a programar. Mas pela minha experiência construindo três produtos de IA, acho que o aprendizado progressivo cria uma vantagem real por algumas razões.

Retornos Crescentes

Quanto mais os usuários usam a plataforma, mais inteligente ela fica. Cada conversa adiciona contexto. Cada insight torna as conversas futuras melhores.

Ferramentas de IA tradicionais: Mesma experiência no Dia 1 e no Dia 100.

Aprendizado progressivo: Dia 1 = bom. Dia 100 = excepcional.

Já vi esse padrão com a Sydney também — o sistema RAG dela faz com que ela seja mais útil agora do que há seis meses, simplesmente porque há mais conteúdo do qual ela pode se valer. Memória se acumula.

Por Que as Pessoas Ficam

Uma vez que a plataforma conhece profundamente o seu negócio, mudar para um concorrente significa começar do zero. Você perde:

- Meses de inteligência acumulada

- Contexto sobre sua estratégia de mercado

- Insights de público construídos em todos os agentes

- Restrições orçamentárias e metas

Após 30 dias de uso regular, a plataforma captura a maioria do seu contexto de negócio. Acho que é por isso que as pessoas ficam — não porque estão presas, mas porque começar de novo em outro lugar genuinamente parece um retrocesso.

Efeitos de Rede Dentro das Organizações

Para agências que gerenciam múltiplos clientes (e isso é próximo ao meu coração — passei a maior parte da minha carreira em agências), o aprendizado progressivo se multiplica:

- A inteligência de cada cliente se acumula independentemente

- Cada relacionamento com cliente aprofunda o valor da plataforma

- O valor cresce com o tamanho do portfólio

Uma agência com 10 clientes tem 10x o benefício de um único usuário.

Difícil de Replicar

Posso estar errado sobre isso, mas acredito que construir aprendizado progressivo exige integração profunda em:

- Geração de respostas de IA

- Processamento em segundo plano

- Isolamento de dados multi-tenant

- Interfaces de controle do usuário

- Compartilhamento de contexto entre agentes

Não é algo que você adiciona depois. É tecido na arquitetura desde o início.

---

O Impacto nos Negócios

Aqui estão os números que estou acompanhando (sempre tento ser específico nessas coisas):

Tempo economizado por usuário:

- Antes: 2-3 minutos reexplicando por conversa

- Conversas por semana: 10-15

- Tempo economizado anualmente: 17-39 horas por usuário

O Que Espero para Retenção

Vou ser honesto — ainda não tenho dados suficientes para provar isso definitivamente. O STRAŦUM ainda está em alfa. Mas minha hipótese, baseada no que vi até agora:

- Usuários que acumulam insights salvos significativos têm menos probabilidade de mudar

- Quanto mais contexto investido, mais difícil fica começar de novo em outro lugar

- O aprendizado progressivo deve se correlacionar diretamente com a retenção

Estou acompanhando isso de perto. Se eu estiver errado, também vou escrever sobre isso :P

O que torna isso realmente útil (além dos números):

- Você não precisa mais ser o secretário da sua IA

- O contexto se acumula naturalmente ao longo do tempo

- A plataforma melhora quanto mais você a usa — sem esforço extra da sua parte

---

Lições Aprendidas (Do Jeito Difícil)

Esses não são insights teóricos — são erros que realmente cometi.

1. Memória de IA Exige Controle do Usuário

As versões iniciais pareciam vigilância. Mostrei para um amigo e as palavras exatas dele foram "isso é assustador". Não é o feedback que você quer.

A correção: Transparência total. Mostrar tudo. Deixar os usuários excluírem qualquer coisa. Sem aprendizado oculto.

Resultado: Os usuários confiam no sistema porque o controlam. (Eu deveria ter sabido disso — tive o mesmo instinto quando construí a interface de conversas da Sydney. As pessoas querem ver o que está acontecendo nos bastidores.)

2. Qualidade Sobre Quantidade

Meu primeiro instinto foi lembrar de tudo. Cada frase. Cada detalhe. Sou uma pessoa de "mais dados é melhor" — 18 anos em análise fazem isso com você. Mas ficou avassalador e sem foco.

A correção: Capturar apenas insights de alta confiança e relevância estratégica. Qualidade bate quantidade.

Resultado: Contexto focado que realmente melhora as conversas.

3. Menos Contexto Frequentemente É Melhor

Esse me surpreendeu. Injetar muito contexto nas conversas tornava as respostas lentas e dispersas. Acontece que quando você dá ao Claude uma parede de informações de fundo, ele tenta fazer referência a tudo — mesmo quando a maior parte não é relevante.

A correção: Curar com cuidado. Incluir apenas o que é relevante para a conversa atual.

Resultado: Respostas mais rápidas, recomendações mais focadas. Ainda estou descobrindo o equilíbrio certo aqui.

4. Isolamento Multi-Tenant Não É Negociável

Um bug no isolamento de dados poderia destruir a confiança do usuário permanentemente. Vindo do mundo das agências, sei o quão sério é a confidencialidade do cliente. Uma agência que gerencia o cliente A e o cliente B nunca pode ter dados vazando entre eles.

A correção: Defesa em profundidade. Múltiplas camadas de isolamento. Testes extensivos.

Resultado: Zero incidentes de vazamento entre clientes. (Essa é uma área onde não cedo — o isolamento tem que ser perfeito.)

---

Quando a Memória de IA Faz Sentido?

Se você está construindo um produto de IA e se pergunta se deve investir em memória, aqui está minha opinião honesta. O aprendizado progressivo faz sentido se:

✅ Você tem múltiplos pontos de contato de IA que poderiam se beneficiar de contexto compartilhado

✅ Usuários têm interações repetidas ao longo de dias/semanas/meses

✅ O contexto acumula valor (estratégia de negócio, preferências, restrições)

✅ Manter usuários importa mais do que adquirir novos

✅ Você atende organizações (equipes, agências, empresas)

❌ Pule se:

- Interações de uso único (sem engajamento repetido)

- O contexto não acumula valor

- Preocupações com privacidade superam conveniência

- Você não pode investir em isolamento de dados adequado (e eu digo realmente investir — não é algo que você faz pela metade)

---

Pensamentos Finais

O aprendizado progressivo transformou o STRAŦUM de "9 agentes de IA separados" em algo que realmente parece uma plataforma inteligente e unificada. Os usuários contam uma vez. O sistema lembra (ou até que excluam).

Acho que é essa a diferença entre uma ferramenta e uma plataforma. Entre uma transação e um relacionamento. Entre "uso isso às vezes" e "não consigo trabalhar sem isso". Mas ainda estou no início dessa jornada — o STRAŦUM está em alfa, e estou aprendendo coisas novas sobre o que funciona toda semana.

Construir memória de IA foi difícil. O isolamento multi-tenant adicionou complexidade. A fundação de multi-tenancy sobre a qual isso repousa foi sua própria aventura — desde a decisão de arquitetura do Dia 2 até reconstruí-la completamente no Dia 67. Mas o resultado? Uma plataforma que fica mais inteligente quanto mais você a usa.

Conta a um agente. Informa os nove.

Tenho curiosidade — se você está construindo produtos de IA, já enfrentou o problema da memória? Que abordagens funcionaram para você? Estou genuinamente interessado porque ainda estou descobrindo a melhor forma de decidir o que vale lembrar versus o que é ruído. Me conta.

---

Experimente Você Mesmo

Ler sobre aprendizado progressivo é uma coisa. Experenciar é outra.

STRAŦUM está atualmente em privado. Estou trabalhando com um pequeno grupo de fundadores de PMEs e equipes de agências para refinar a experiência antes do lançamento público.

Se você está cansado de reexplicar seu negócio para ferramentas de IA que esquecem tudo entre as sessões, adoraria que você experimentasse.

O que você receberá:

- Acesso total a todos os 9 agentes de IA

- Aprendizado progressivo que realmente lembra do seu negócio

- Linha direta comigo para feedback e pedidos de funcionalidades

Estou aceitando novos usuários alfa de forma contínua. As vagas são limitadas — quero dar atenção pessoal a todos durante essa fase.

Abraços,

Chandler