O Que As Agências Realmente Precisam Da AI Não É Mais Conteúdo

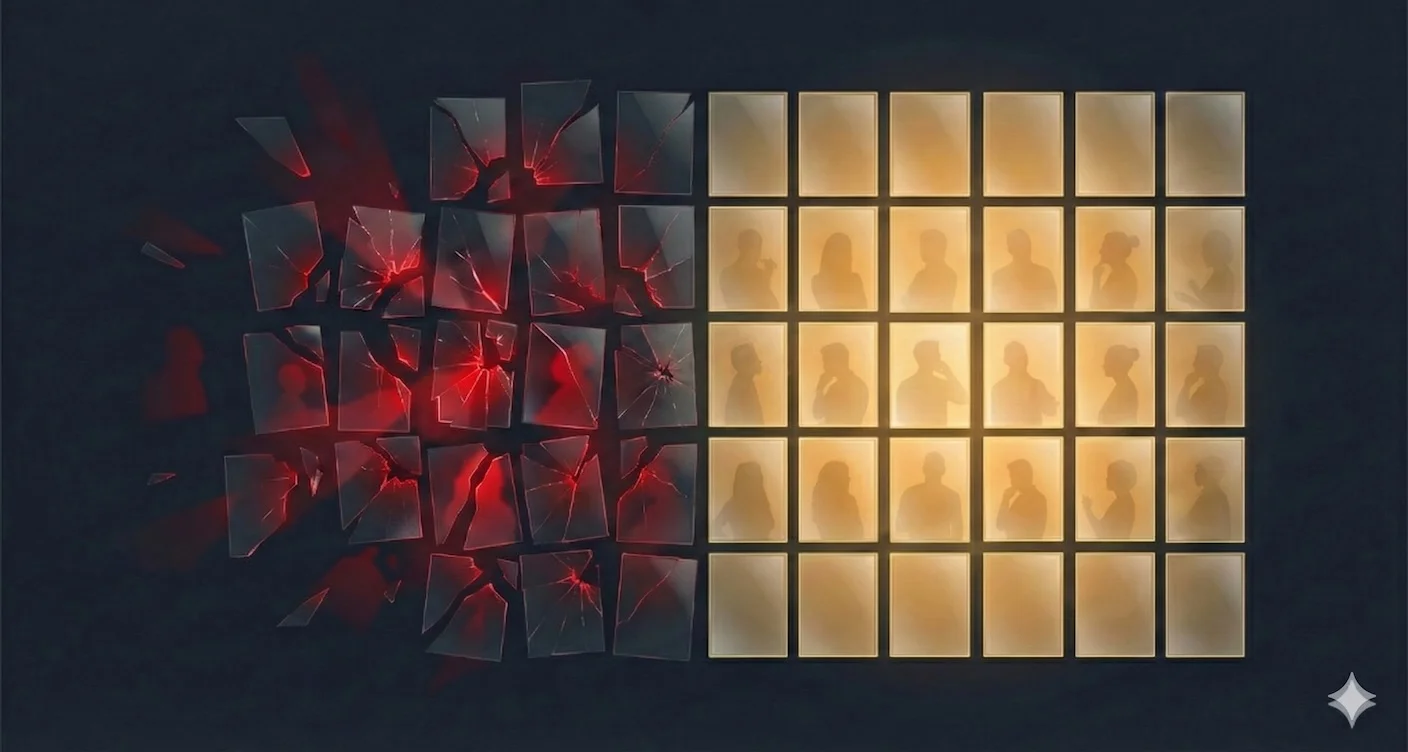

Continuo vendo ferramentas de AI venderem volume de conteúdo para agências. Mas, se você já gerenciou relações reais com clientes, sabe que o problema mais difícil é confiança: isolamento, permissões, contexto e não vazar o pensamento de um cliente para o trabalho de outro.

Eu soube que estava construindo a coisa errada no momento em que me peguei imaginando um dono de agência ficando empolgado com "50 ideias de posts para LinkedIn em 10 segundos".

Não porque ideias de conteúdo sejam inúteis. Não são.

Mas porque, se você já passou algum tempo real dentro de agências, sabe que essa não é a parte assustadora do trabalho.

A parte assustadora é confiança.

É o account manager se perguntando se um sistema pode misturar, sem querer, o Cliente A com o Cliente B.

É o estrategista pensando: "Posso usar isso com segurança em uma conta competitiva?"

É o dono da agência fazendo uma pergunta muito menos sexy do que qualquer homepage de AI quer responder:

O que acontece se essa coisa vazar a inteligência de um cliente para o trabalho de outro?

Essa pergunta importa muito mais do que "quantas legendas ela consegue gerar?"

Acho que uma parte grande do mercado de software com AI ainda entende mal agências porque entende mal o trabalho real. Agências não sofrem principalmente de falta de palavras. Elas sofrem de complexidade:

- vários clientes

- várias marcas

- vários papéis internos

- várias camadas de aprovação

- várias versões de "quem pode ver o que"

Entao, quando um vendedor de AI aparece e diz "otima noticia, agora voce pode fazer mais conteudo mais rapido", uma parte de mim quer responder: voce ja sentou de verdade dentro de um workflow de agencia?

Porque, quanto mais eu construia STRAŦUM, mais claro ficava que agencias nao precisam primeiro de mais conteudo.

Elas precisam de uma infraestrutura melhor para confianca.

O Problema Da Agencia Nao E Volume. E Risco

Acho que isso fica mais facil de entender se voce ja teve responsabilidade sobre trabalho de cliente com stakes reais.

Quando voce esta lidando com uma marca so, a vida e mais simples. Suas notas sao suas notas. Seu trabalho de posicionamento fica numa faixa so. Seus erros ainda doem, mas pelo menos sao locais.

Agencias nao vivem ai.

Agencias estao fazendo malabarismo com:

- vozes de marca diferentes

- categorias diferentes

- cadeias de aprovacao diferentes

- definicoes de sucesso diferentes

- clientes que podem ate competir entre si

Isso significa que o custo de um erro nao e "fizemos um rascunho mediocre".

As vezes o custo e:

- mandamos a coisa errada para o cliente errado

- expusemos o contexto errado no workspace errado

- fizemos a plataforma parecer insegura

- o cliente agora esta se perguntando que outras coisas podem estar desleixadas nos bastidores

E, uma vez que o cliente comeca a fazer essa ultima pergunta, voce ja entrou em territorio caro.

Por isso eu fico cético quando AI para agencias e vendida quase inteiramente por exemplos de output. Uma demo de conteudo gerado prova que o modelo consegue gerar conteudo. Ok. Mas, para agencias, a prova mais importante e arquitetural.

Me mostre:

- onde os dados vivem

- como o contexto de cliente e isolado

- quem pode acessar o que

- se aprovacoes estao integradas

- se o trabalho de um cliente pode contaminar o de outro

Essa e a historia de produto de que agencias realmente se importam, mesmo que seja muito menos divertida para colocar em um video de lancamento.

Acho Que Minha Bagagem Em Publicidade Tornou Isso Obvio Mais Rapido

Talvez, por eu vir da publicidade, eu nunca tenha acreditado de verdade na historia de que "conteudo e o gargalo" para agencias.

Nao me entenda mal: agencias, sim, produzem conteudo. Muito. E, sim, ha ganhos reais de eficiencia ai.

Mas o que torna o trabalho de agencia dificil normalmente nao e a ausencia de um primeiro rascunho.

E o ambiente operacional em torno do rascunho.

Quem revisou isso?

De qual cliente e isso?

Que contexto moldou essa recomendacao?

Isso foi gerado com as restricoes corretas de marca?

Alguem reutilizou premissas erradas por acidente?

Quem tem permissao para aprovar?

Se voce esta in-house, parte disso ainda importa.

Se voce esta em agencia, tudo isso importa todos os dias.

Por isso tomei uma decisao que parecia um pouco irracional bem cedo na vida de STRAŦUM: comecei a construir multi-tenancy quase imediatamente. Dia 2, basicamente. O que, olhando agora, foi ou disciplinado ou meio insano, dependendo do quanto voce quer ser gentil.

Na epoca eu so tinha um agente funcionando. Construir isolamento por cliente tao cedo parecia prematuro.

Tambem acabou sendo o certo.

Porque, quando voce enxerga agencias com clareza, percebe que elas nao sao apenas "SMEs com mais usuarios". Elas tem um modelo operacional fundamentalmente diferente.

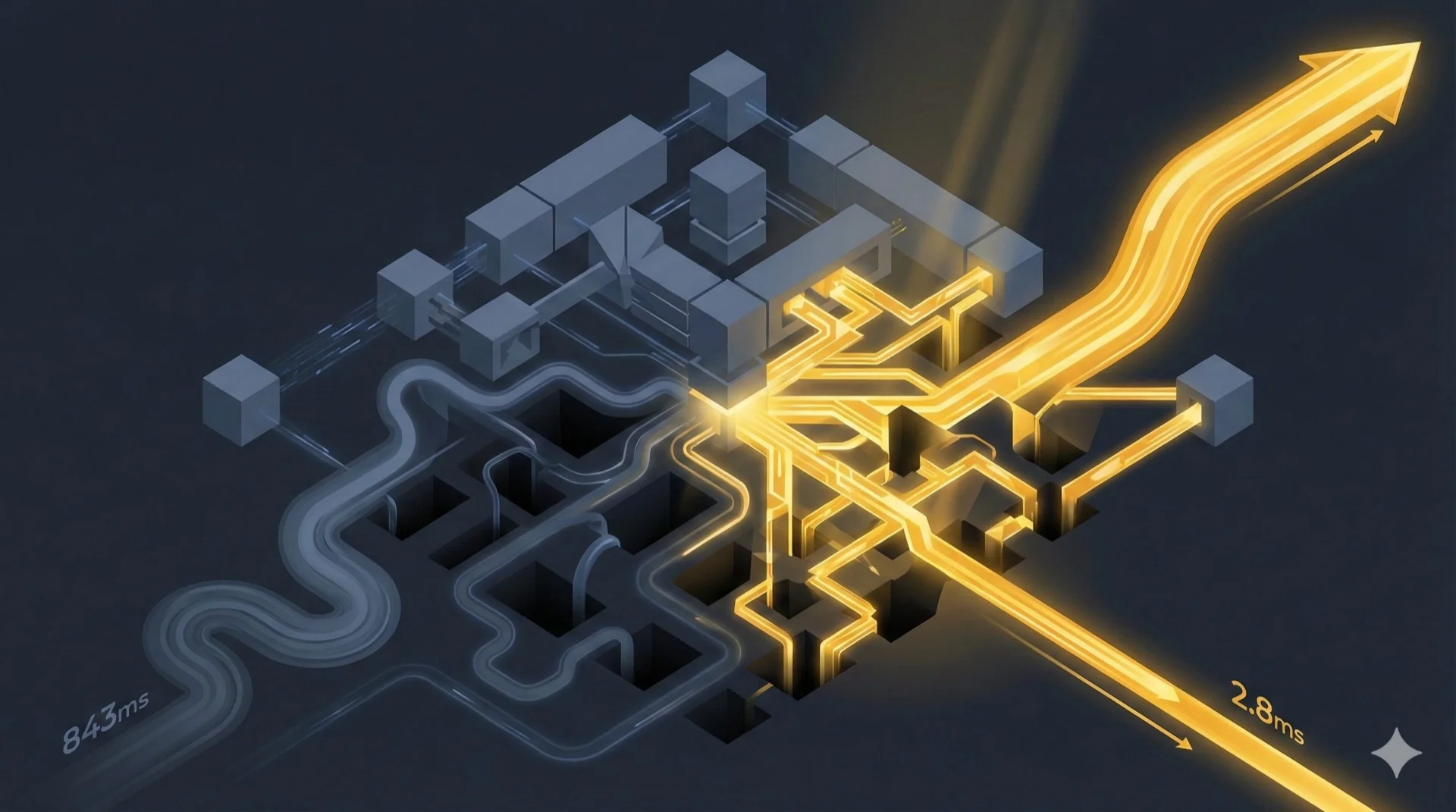

O Dia Em Que Percebi Que org_id Nao Ia Me Salvar

Minha primeira versao de multi-tenancy foi a versao classica do builder otimista.

Adicionar org_id em tudo.

Escrever as policies.

Confiar nos filtros.

Dar o problema como resolvido.

Isso funciona para uma quantidade surpreendente de software. E tambem te da a ilusao confortavel de que voce resolveu isolamento quando, na verdade, resolveu apenas escopo basico.

Para STRAŦUM, nao bastava.

Porque agencias nao tinham so uma camada organizacional. Elas tinham clientes dentro da organizacao. E cada cliente precisava do proprio contexto, dos proprios outputs, do proprio historico e das proprias fronteiras de seguranca.

Isso significava que eu estava tentando enfiar dois modelos de dados diferentes dentro de um unico atalho mental:

- SME: uma organizacao, um contexto de negocio

- Agencia: uma organizacao, varios contextos de cliente por baixo

Voce pode fingir isso por um tempo na logica da aplicacao. Muita gente faz. Mas, quanto mais eu olhava, mais eu percebia que estava construindo um sistema que podia parecer correto e ainda assim ser estruturalmente confiante demais.

Essa e uma combinacao ruim.

Precisou de um rebuild para ficar certo. Routing separado. Logica de schema separada. Mais guardrails no nivel de banco de dados. Mais tratamento explicito de contexto. Menos "e so lembrar de filtrar certo em todos os lugares".

Irritante? Sim.

Valer a pena? Tambem sim.

Sendo honesto — mesmo depois do rebuild, semanas depois encontrei outra brecha onde usuarios atribuidos a clientes especificos ainda conseguiam ver dados de outros clientes por um query path diferente. A arquitetura estava melhor, mas nao completa. Ainda nao tenho total confianca de que esteja tudo vedado.

Porque a confianca de uma agencia nao deveria depender de um developer lembrar de cada branch de if/else as 11:30 PM.

A AI Piora O Problema De Confianca, Nao Melhora

Essa e a parte que eu acho que a categoria ainda minimiza.

A AI nao e so mais uma camada de interface em cima do trabalho de agencia. Ela muda o perfil de risco porque agora voce tem um sistema que consegue sintetizar contexto, e nao apenas armazenar contexto.

O que e poderoso.

E tambem exatamente o motivo pelo qual fronteiras ruins sao inaceitaveis.

Se um sistema de AI tem acesso ao contexto errado, ele nao apenas expõe dados brutos. Ele pode remixar esse contexto. Pode deixar insights do Cliente A influenciarem, silenciosamente, a estrategia do Cliente B. Pode transformar erros de isolamento em outputs com cara de polidos, o que honestamente e pior do que um bug visivel, porque fica mais dificil de perceber.

Por isso ferramentas de AI de proposito geral me deixam nervoso em ambientes de agencia quando as pessoas comecam a usa-las casualmente em varias contas.

Voce consegue se virar assim por um tempo.

Ai um dia alguem percebe que a linguagem soa familiar.

Ou uma recomendacao inclui um framework competitivo que jamais deveria ter aparecido naquele workspace.

Ou um cliente ve algo que o faz se perguntar se os seus sistemas sao compartimentalizados de verdade.

Quando essa duvida entra na relacao, voce nao esta mais corrigindo um workflow de conteudo. Esta reparando crenca.

Boa sorte fazendo isso com algumas legendas extras de blog.

O Que As Agencias Realmente Precisam Em Vez Disso

Se eu tirar todo o teatro de AI da frente, acho que agencias precisam com muito mais urgencia de algumas coisas nada glamourosas:

1. Isolamento seguro de contexto por cliente

Nao apenas account switching.

Nao apenas pastas.

Nao apenas copy de "levamos privacidade a serio".

Separacao real — no nivel do banco de dados, nao no nivel da aplicacao. Quero dizer schemas separados ou routing separado, nao uma tabela compartilhada com uma coluna client_id e a reza de que cada query filtre corretamente.

2. Permissoes orientadas por papel

Pessoas diferentes precisam de niveis de acesso diferentes:

- strategist

- account manager

- approver

- client stakeholder

- admin

Sem isso, a ferramenta pode parecer "colaborativa" numa demo e caotica na vida real.

3. Workflows de aprovacao

Agencias nao sao criadores solo jogando ideias diretamente no mundo. Existem rascunhos, comentarios, revisoes, aprovacoes, ajustes e politica interna. Muita politica :P

Se o sistema de AI nao respeita isso, ele nao esta respeitando o trabalho de agencia.

4. Memoria compartilhada dentro da fronteira correta

Isso importa muito.

Dentro de um contexto de cliente especifico, o sistema deveria sim ficar mais inteligente com o tempo. E ai que a AI se torna util. Mas ela precisa compor dentro da cerca certa, e nao atravessando todo o trabalho de forma indiscriminada.

5. Inteligencia estrategica antes de execucao

De novo: eu nao sou anti-conteudo. Eu so sou contra conteudo-first como historia inteira.

Agencias precisam de ajuda para entender:

- o que o cliente deveria dizer

- o que o cliente deveria enfatizar

- o que esta acontecendo do ponto de vista competitivo

- onde a estrategia esta fraca

- como alinhar a equipe em torno de uma recomendacao

Isso vale muito mais do que produzir outra pilha de entregaveis genericos.

E Por Isso Que STRAŦUM Acabou Com Essa Cara

Muitas decisoes de produto em STRAŦUM fazem mais sentido quando voce olha para elas por essa lente.

Por que progressive learning?

Porque agencias ja repetem contexto demais.

Por que multi-tenant routing?

Porque contexto de cliente nao pode ser uma sugestao educada.

Por que aprovacoes e colaboracao?

Porque trabalho de agencia nao e uma pessoa conversando com um bot no vacuo.

Por que foco em intelligence over execution?

Porque agencias normalmente nao sao bem pagas por produzir mais ruido. Elas sao pagas quando criam confianca, direcao e decisoes melhores para os clientes.

Esse e o tipo de produto de AI que eu quero construir para elas.

Nao o que diz "olha como voce pode churnar mais rapido."

E o que diz "olha como seu trabalho estrategico pode ficar mais seguro e mais afiado."

Nao estou dizendo que acertei tudo. Estou dizendo que os problemas forcaram decisoes arquiteturais especificas que a maioria das ferramentas de AI de proposito geral ainda nao precisou tomar — ou nao escolheu tomar.

A Coisa Que Eu Gostaria Que Mais Fornecedores De AI Admitissem

Compradores de agencia geralmente estao avaliando dois produtos ao mesmo tempo:

- o produto na demo

- o problema futuro que aquele produto pode criar

Por isso output bonito de AI, sozinho, nao convence.

O comprador nao esta perguntando so "isso pode nos ajudar?"

Tambem esta perguntando "isso pode nos prejudicar depois?"

E, se voce nao responde bem a essa segunda pergunta, todo o seu belo output gerado e basicamente decoracao.

Nao acho que agencias precisem de mais decoracao.

Acho que elas precisam de sistemas em que possam confiar na frente dos clientes.

Esse e um produto muito mais dificil de construir.

E tambem, eu acho, um produto muito mais honesto.

E isso da minha parte.

Eu adoraria ouvir especialmente as pessoas de agencia sobre isso. As ferramentas de AI que voces viram realmente reduziram risco, ou principalmente aumentaram a quantidade de conteudo que sua equipe consegue produzir enquanto as dores operacionais reais continuam exatamente no mesmo lugar?

Cheers, Chandler