US o China: sino ang nangunguna sa AI research?

Dalawang malaking pag-aaral ang nagkaroon ng magkasalungat na konklusyon tungkol sa liderato ng US vs China sa AI—pero magkaiba pala ang sinusukat nila. Eto kung bakit pareho silang pwedeng tama.

Kamakailan lang, napadaan ako sa dalawang artikulo na magkaibang-magkaiba ang headline at konklusyon:

- China trounces U.S. in AI research output and quality. Sinulat ito nina Kotaro Fukuoka, Shunsuke Tabeta at Akira Okikawa, mga Nikkei staff writers.

- Must read: the 100 most cited AI papers in 2022 ng Zeta Alpha. Sinulat sa artikulo na "When we look at where these top-cited papers come from (Figure 1), we see that the United States continues to dominate and the difference among the major powers varies only slightly per year."

- Isa sa mga konklusyon ng artikulong ito ay "Earlier reports (link to the Nikkei article) that China may have overtaken the US in AI R&D seem to be highly exaggerated if we look at it from the perspective of citations."

Siyempre, naging curious ako kasi ang Nikkei ay isang reputable na news organization, at ang Japan ay military ally ng US. Sa madaling salita, wala masyadong incentive ang Nikkei na i-"spin" ang katotohanan pabor sa China. Kaya nag-decide akong mag-dig deeper.

Well, as it turned out, hindi ko naman pala kailangang mag-dig nang sobrang lalim para malaman na pwedeng tama silang dalawa sabay kasi magkaiba ang methodology nila para makuha ang kanilang mga konklusyon. Dahil mas late nag-publish ang Zeta Alpha at ni-cite nila ang Nikkei article, dapat sana ay ini-highlight ng Zeta Alpha ang mga pagkakaiba ng kanilang mga methodology nang direkta sa artikulo; at hayaan ang mga mambabasa na mag-decide para sa kanilang sarili.

Magkaibang mga methodology

Nikkei Methodology

Zeta Alpha methodology

Nakipagtulungan ang Nikkei sa Dutch scientific publisher na Elsevier para suriin ang mga academic at conference papers tungkol sa AI, gamit ang mga 800 AI-associated keywords para i-narrow down ang mga papers.

To create the analysis above, we have first collected the most cited papers per year in the Zeta Alpha platform, and then manually checked the first publication date, so that we place papers in the right year.

We supplemented this list by mining for highly cited AI papers on Semantic Scholar with its broader coverage and ability to sort by citation count. We then take for each paper the number of citations on Google Scholar as the representative metric and sort the papers by this number to yield the top-100 for a year.

Sa quantity, pumutok ang bilang ng AI papers mula sa mga 25,000 noong 2012 hanggang mga 135,000 noong 2021.

Ang Zeta Alpha article ay naka-focus lamang sa top 100 papers para sa bawat taon

Parehong gumagamit ng citations ang Nikkei at Zeta Alpha bilang indikasyon ng kalidad ng paper.

Pero ang unang malaking pagkakaiba ay mas maraming AI papers ang tiningnan ng Nikkei kaysa sa Zeta Alpha para makuha ang kanilang konklusyon. Nang isulat ng Nikkei na, "In 2021, China accounted for 7,401 of the most-cited papers, topping the American tally by 70% or so.", tinutukoy nila ang top 10% ng papers, kaya basically isang universe ng 13,500 papers noong 2021 (ang top 10% ng mga 135,000 AI papers noong 2021).

Lahat ng analysis ng Zeta Alpha sa kanilang artikulo ay tungkol lamang sa top 100 papers sa citation para sa bawat taon.

Kaya hindi talaga ito apple to apple comparison.

Aling method ang mas maganda, sa pagitan ng Nikkei at Zeta Alpha?

Wala akong malalim na background sa AI field, kaya hindi ko masasabi nang may confidence kung aling methodology ang mas maganda. Ang alam ko lang ay magkaiba sila.

Kung gusto mong sagutin ang tanong na ito, sa tingin ko kailangan mo:

- Una, i-define kung anong criteria ang ginagamit mo para i-evaluate ang "better"?

- Ang pag-cover ng mas maraming papers ay nangangahulugang mas malaki ang sample size mo at mas maraming niche areas sa loob ng AI ang naka-cover.

- Ang pag-focus sa top 100 papers ay pwedeng may sense kung sa tingin natin ang karamihan ng commercial o strategic values ay mapupunta sa iilang top papers/owners sa paglipas ng panahon. Pero duda ako na nagawa ng Zeta Alpha ang ganitong analysis.

- Pangalawa, humanap ng mas magandang paraan para ma-quantify ang value o impact ng bawat paper kaysa sa paggamit lang ng citations. Alam ko na medyo crude ang paggamit ng citations bilang pag-evaluate ng quality pero ito ba ang pinaka-magandang paraan?

- Pangatlo, ano ang relasyon sa pagitan ng AI capability ng isang bansa at ang percentage ng published paper nito sa top 100 o top 1000 cited papers sa isang taon?

- Halimbawa, sigurado akong may mga cutting-edge research na may military at high commercial values, na pinipili ng ilang research labs na huwag i-publish. Kasi bakit mo i-publish para matutunan ng iba, para tulungan ang kompetisyon na isara ang gap?

- Pwede ko pa itong ituloy, pero sana naiintindihan mo na ang punto ko

Ilang questionable conclusions/headlines

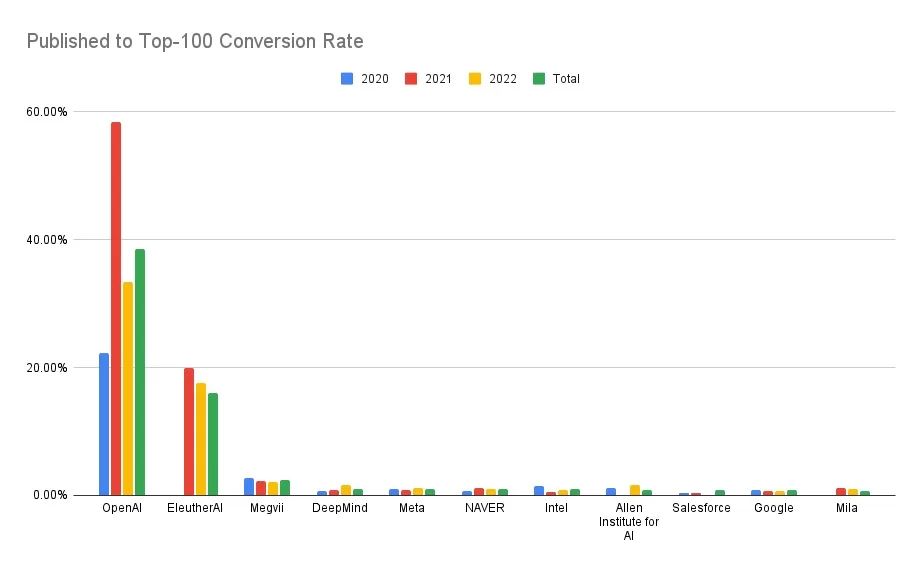

OpenAI is simply in a league of its own when it comes to turning publications into absolute blockbusters

Isinulat ng Zeta Alpha na "You won't see OpenAI or DeepMind among the top 20 in the volume of publications. These institutions publish less but with higher impact." at "Now we see that OpenAI is simply in a league of its own when it comes to turning publications into absolute blockbusters."

Bakit importante tingnan ang "conversion rate" na ito? Ano ang ibig sabihin nito? Isang simpleng paraan ng pag-interpret ng data ay:

- Ang OpenAI research ay naka-focus sa napakakitid na field ng AI, at pinili nilang mag-publish ng napaka-limitadong bilang ng papers.

- Ang Google o Meta at ibang mga kumpanya ay may malawak na interes sa AI, at sabay-sabay silang nag-re-research sa maraming iba't ibang areas. At pinili nilang mag-publish ng mas marami.

- Walang kinalaman ito sa pagiging magaling ng OpenAI sa pag-turn ng publications into blockbusters.

Aling paraan ng pag-trabaho ang mas maganda? Hindi ko masyadong sigurado

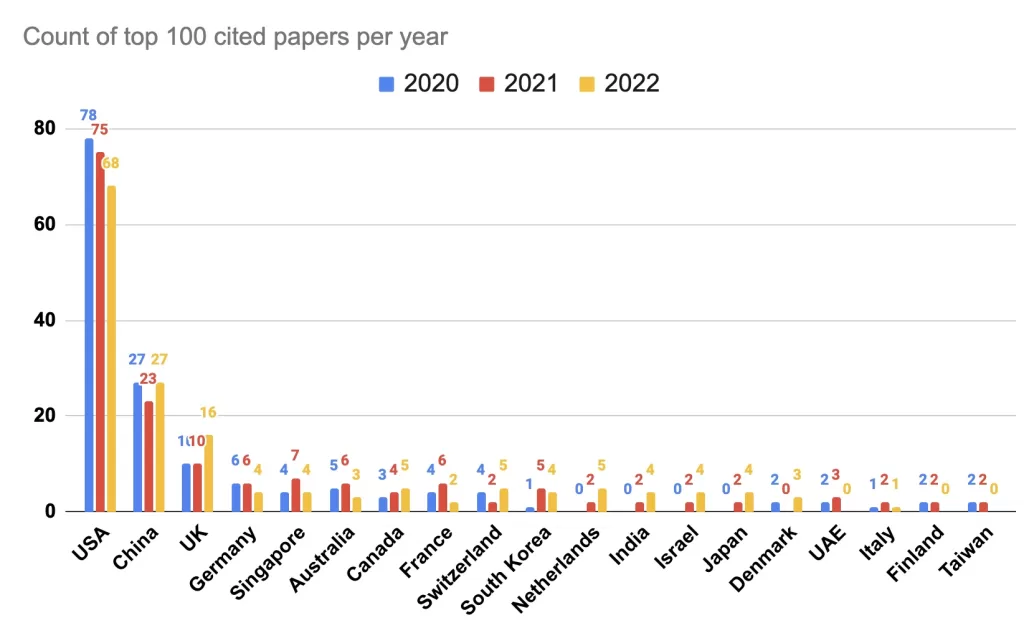

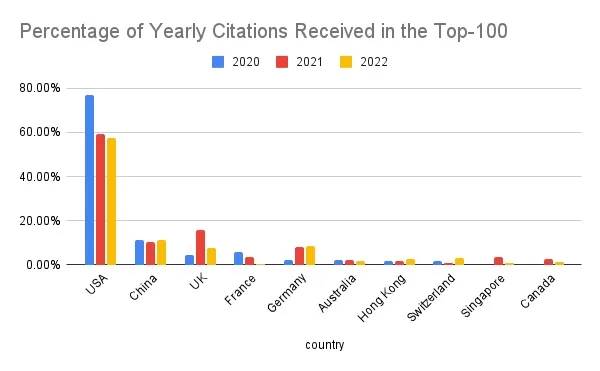

The US dominates AI research papers

Ang konklusyong ito ay base sa dalawang pangunahing data points sa ibaba

Gaya ng nabanggit sa itaas, habang sumasang-ayon ako na ang pagkakaroon ng malakas na presensya sa top 100 (o 1000 o kahit anong bilang) cited AI papers ay isang signal tungkol sa lakas ng isang bansa sa AI. Hindi ko iniisip na iyon lang dapat ang TANGING signal. Dapat may grupo ng data points o signals para makuha ang konklusyong iyon.

At saka bakit top 100 at hindi top 1000? Dahil ba ang methodology ng Zeta Alpha ay may manual checking kaya top 100 lang ang kaya nilang i-cover?

Konklusyon

Isa na naman itong halimbawa kung paano mas nuanced ang totoong buhay kaysa sa ipinapahiwatig ng ilang mga headline. Kaya habang pinapahalagahan ko ang effort na i-simplify ang kwento para sa audience, hindi natin dapat subukang "i-simplify ito nang sobra." :)

Sa tingin mo, ano ang mas magandang paraan para sukatin ang AI capability ng isang bansa? Sapat na ba ang bilang ng top-cited papers, o dapat ba tayong tumingin sa mas malawak na hanay ng mga signal? Gusto kong marinig ang iyong mga ideya.

Maraming salamat,

Chandler