Tôi Đang Hạ Gói Claude Code $200 Sau Hai Tuần Dùng Codex

Hai tuần sau bài so sánh đầu tiên, cả hai tool đều ship bản cập nhật lớn. Codex thách thức chiến lược sản phẩm của tôi theo cách mà Claude Code không làm. Claude Code ship Agent Teams và AutoMemory. Kết quả: tôi đang cắt gói Max $200/tháng — và nhận được output tốt hơn với chi phí thấp hơn.

Hai tuần trước tôi viết về việc dùng song song Codex và Claude Code. Bài đó được đón nhận nồng nhiệt hơn bất kỳ bài nào tôi từng viết — hóa ra rất nhiều người cũng đang chạy cùng thí nghiệm này.

Lúc đó, working model của tôi khá rõ: Claude Code cho chất lượng thực thi và QA, Codex cho suy luận kiến trúc và các plan dài hơi. Hai tool, thế mạnh khác nhau, cross-model review cho những việc quan trọng.

Hai tuần sau, cả hai tool đều ship những bản cập nhật đáng kể và cán cân đã dịch chuyển. Không phải quá kịch tính — nhưng đủ để đáng viết thêm. (Nói cho rõ nhé, tôi đang soạn bài này trong Claude Code — không phải vì trung thành, mà vì billing cycle hiện tại vẫn còn và tôi không muốn phí tiền đã trả rồi. Kiểu tính toán thực tế đó chính xác là điều bài viết này muốn nói.)

Tháng 3 năm 2026 rất dồn dập cho cả hai nền tảng. Codex ra mắt plugins tích hợp Slack, Gmail, Linear, Figma, Sentry, và nhiều hơn nữa — cộng thêm Triggers cho các GitHub workflow tự động, model GPT-5.4 mini và nano, và hỗ trợ Windows native. Claude Code ship Agent Teams (multi-agent orchestration, vẫn đang thử nghiệm), AutoMemory, Computer Use (chỉ macOS, gói Pro/Max), Scheduled Tasks qua /loop, và khoảng 10 bản release chỉ riêng trong tháng 3. Cả hai nền tảng đều đang chạy rất nhanh.

Câu Chuyện Newsletter (Vì Sao Đây Không Chỉ Là Chuyện Code)

Quan sát thay đổi suy nghĩ của tôi chẳng liên quan gì đến việc viết code cả.

Site của tôi có hệ thống newsletter đầy đủ — form đăng ký, CTA trong bài, email chào mừng, cron hàng ngày, double opt-in, hỗ trợ 13 ngôn ngữ. Về mặt kỹ thuật, mọi thứ đều hoạt động. Vấn đề là: không có subscriber xác nhận nào cả.

Tôi soạn một plan để sửa chuyện này: trích một lead magnet PDF từ khóa học, gate Module 1 sau email, thêm CTA giữa bài, hook chatbot AI vào luồng đăng ký, phân phối qua YouTube và LinkedIn. Bảy thứ mới.

Tôi xây plan này với Claude Code. Cảm giác rất productive.

Rồi tôi đưa cùng brief cho Codex. Phản hồi ngược lại ngay lập tức.

Lead magnet thừa — Module 1 đã miễn phí sẵn rồi. Quá nhiều bề mặt cùng lúc — nếu build cả bảy, bạn không biết cái nào hiệu quả. Vấn đề không phải hạ tầng, mà là copy. "Stay in the loop" quá chung chung. Email xác nhận chưa đủ thuyết phục. Phần chọn chủ đề quan tâm thêm ma sát.

Plan của Codex: sửa những gì đã có trước (viết lại copy, cải thiện email xác nhận, giảm ma sát), thêm một bề mặt mới (CTA inline trong blog), đo bằng GA events trước khi build thêm bất cứ thứ gì.

Plan của tôi là "build thêm nhiều thứ." Plan của Codex là "làm cho những thứ hiện có hoạt động tốt hơn, rồi test một thứ mới." Plan của tôi mất cả tuần mà không biết cái nào hiệu quả. Plan của Codex ship được trong một ngày và cho bạn biết chính xác nên đầu tư tiếp ở đâu.

Phải thừa nhận là tôi hơi bất ngờ. Không phải vì Claude dở về chiến lược. Tôi nghĩ nếu tôi prompt cẩn thận hơn — "hãy thách thức giả định của tôi trước khi thực thi" — có thể tôi cũng nhận được phản hồi tương tự. Nhưng phong cách suy luận mặc định khác nhau thấy rõ. GPT-5.4 mặc định là "đặt câu hỏi về tiền đề." Claude mặc định là "thực thi plan cho tốt."

Sự khác biệt đó quan trọng cho các quyết định sản phẩm.

Tốc Độ và Khả Năng Điều Hướng

Hai điều tôi nhận ra ảnh hưởng đến workflow hàng ngày nhiều hơn tôi tưởng.

Tốc độ và hiệu quả token: Codex với GPT-5.4 ở high thinking luôn nhanh hơn Opus 4.6 ở high thinking cho các task tương đương. Các so sánh từ bên thứ ba cho thấy Codex dùng ít hơn khoảng 3 lần token cho công việc tương tự — một benchmark đo được 1,5 triệu token cho một task kiểu Figma trong khi Claude dùng 6,2 triệu. Claude "suy nghĩ thành lời" nhiều hơn, điều đó tạo ra reasoning chất lượng cao hơn nhưng đốt limit nhanh hơn. Khoảng từ ngày 20 tháng 3, Opus dường như đang gọi nhiều tool call hơn bình thường — nhiều bước trung gian hơn trước khi đến câu trả lời. Tôi không chắc đó là thay đổi model hay trùng hợp, nhưng cảm nhận được.

Điều hướng real-time: Khi tôi gửi tin nhắn mới trong lúc tool đang chạy — "khoan, không phải hướng đó, thử cách này" — Codex đọc gần như ngay lập tức và điều chỉnh. Claude Code thường chạy xong phần đang làm rồi mới đọc tin sửa.

Nghe có vẻ nhỏ. Nhưng không nhỏ đâu. Khi bạn đang xem agent đi sai hướng và muốn chỉnh lại, khoảng cách giữa "đọc tin sửa ngay" và "đọc sau khi chạy xong phần hiện tại" cộng dồn lại qua cả buổi làm việc.

Bug SSE: Một Ví Dụ Cụ Thể

Tôi đang build một app iOS mới. Claude Code đã tạo ra 40 file Swift cho toàn bộ feature — auth, agents, chat, frameworks, dashboard, profile. Phạm vi ấn tượng. Nhưng có một bug quan trọng chưa sửa được: SSE streaming cho chat real-time không hoạt động.

Backend thì ổn. Curl chạy được. Nhưng URLSessionDataDelegate.didReceive(data:) không fire trong Swift client. Claude Code xử lý bug này hàng giờ. Nhiều cách tiếp cận, nhiều phiên debug.

Tôi đưa cùng bài toán cho Codex. Vài lần thử sau: commit 7f592152 — "fix(ios): restore real-time chat streaming."

Có đại diện không? Có thể không. Tool nào cũng có ngày tốt ngày xấu. Nhưng theo kinh nghiệm của tôi, khi Claude Code bị kẹt trong vòng lặp debug — thử các biến thể ngày càng thông minh của cùng một hướng tiếp cận — chuyển sang Codex thường phá được thế bế tắc vì GPT-5.4 nhìn nhận vấn đề khác ngay từ đầu.

Claude Code Vẫn Thắng Ở Đâu

Đọc bài này dễ dàng kết luận rằng Codex đang vượt lên toàn diện. Kết luận đó sai. Claude Code cũng ship mạnh tháng này, và nhiều lợi thế của nó thực tế còn lớn hơn.

Agent Teams. Tính năng này ra mắt tháng 2 và đã trưởng thành dần qua tháng 3. Nhiều instance Claude Code chạy song song — một explorer, một code reviewer, một implementer, một test runner — với dependency tracking và task list chung. Vẫn còn thử nghiệm và tắt mặc định, nhưng khi bật lên, thực sự ấn tượng. Codex cũng có multi-agent support (task chạy trong các cloud container cô lập), nhưng Agent Teams của Claude Code có cảm giác phối hợp tốt hơn. Cho các refactor lớn chạm nhiều file, Agent Teams hiện tại là trải nghiệm tốt hơn.

AutoMemory. Claude Code giờ tự động ghi lại các memory rule dựa trên thói quen của bạn. Sau vài phiên, nó biết cấu trúc project, naming convention, sở thích của bạn. Tinh tế thôi nhưng hiệu ứng tích lũy là các phiên Claude Code ngày càng productive hơn theo thời gian — điều mà Codex hiện chưa làm được.

Thiết kế frontend. Claude Code với plugin /frontend-design vẫn tạo ra UI bóng bẩy hơn, nắm design system tốt hơn so với Codex với skill tương đương. Tôi test trực tiếp khi redesign site vào ngày 26 tháng 3. Output của Claude có bố cục không gian tốt hơn, styling nhất quán hơn, và kết quả tổng thể gắn kết hơn. Có thể là lợi thế của harness (plugin system của Claude chạy skill với nhiều context hơn), nhưng kết quả thực tế thì rõ ràng.

Chất lượng code. Một phân tích cộng đồng từ hơn 500 bình luận developer trên Reddit cho thấy developer thích output của Claude Code trong khoảng 67% so sánh ẩn danh — ghi nhận code sạch hơn, đúng idiom hơn, cấu trúc tốt hơn. Khớp với trải nghiệm của tôi. Khi code cần dễ bảo trì chứ không chỉ chạy được, Claude Code có lợi thế.

QA tự động. Vẫn là killer feature. Sau khi hoàn thành công việc, Claude Code tự động dispatch review agent — code review, kiểm tra tính nhất quán, phân tích gap — mà tôi không cần yêu cầu. Codex chưa làm được vậy. Cho bất kỳ thứ gì mà tính đúng đắn quan trọng hơn tốc độ, riêng tính năng này đã giữ Claude Code trong workflow.

Câu Hỏi Về Độ Tin Cậy

Tôi muốn chia sẻ một điều mà hầu hết bài so sánh đều né.

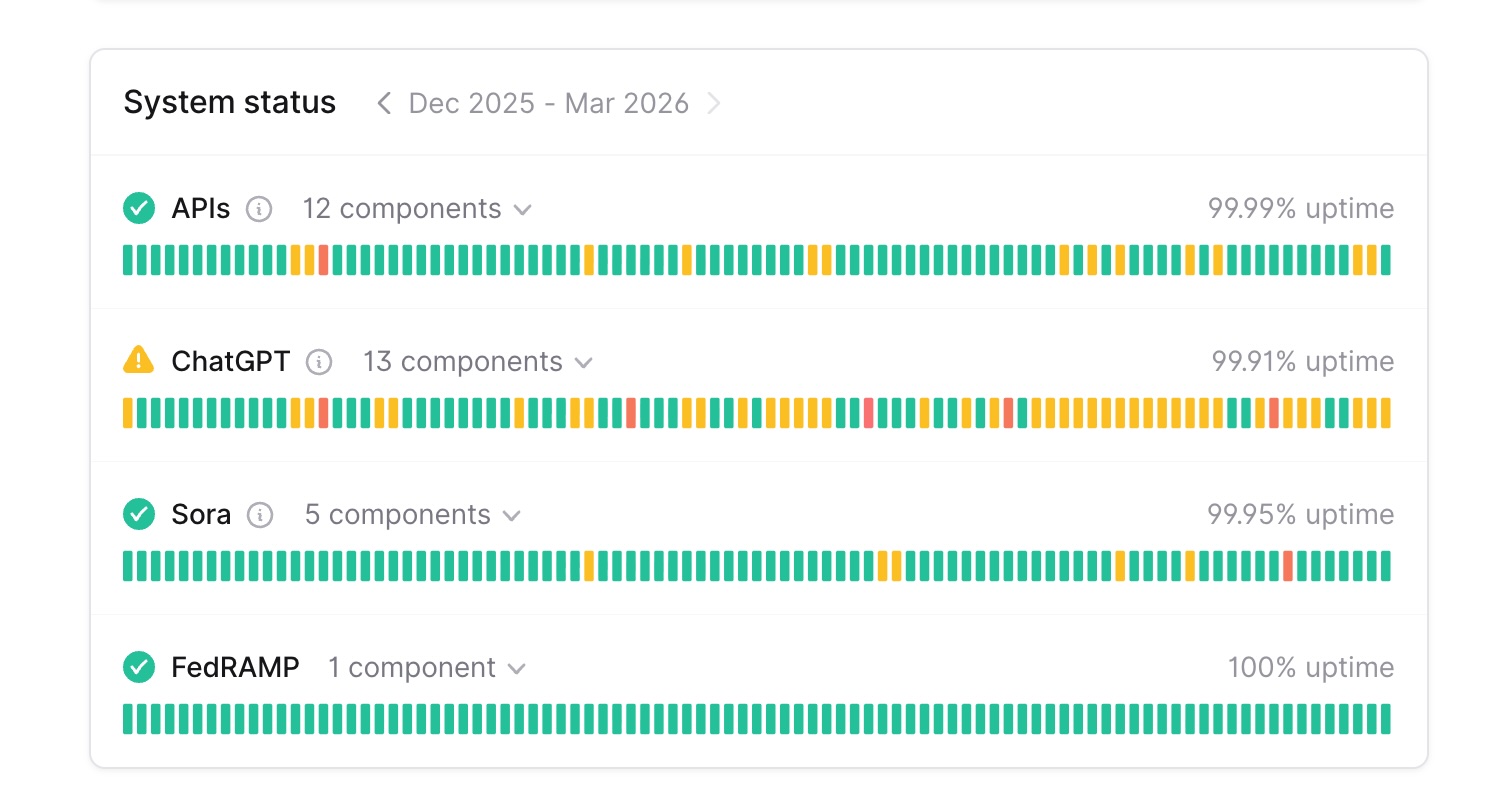

Đây là số uptime 90 ngày từ status page của cả hai bên, tính đến cuối tháng 3 năm 2026:

| Dịch vụ | Anthropic | OpenAI |

|---|---|---|

| Nền tảng chính | claude.ai: 99,16% | ChatGPT: 99,91% |

| API | api.anthropic.com: 99,24% | APIs: 99,99% |

| Developer tools | Claude Code: 99,48% | — |

| Console | platform.claude.com: 99,41% | — |

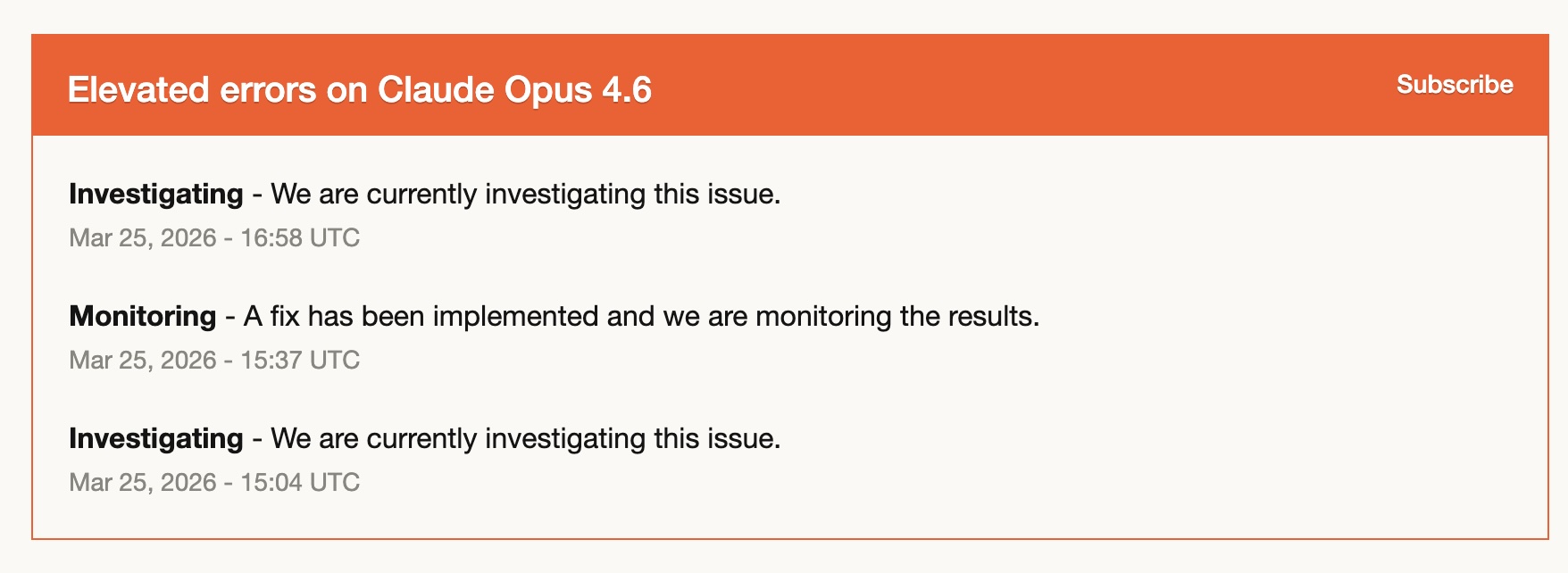

Khoảng cách là thực. Trong 90 ngày, dịch vụ của Anthropic gặp khoảng 8-10 lần downtime nhiều hơn OpenAI. Vào ngày 25 tháng 3, có một sự cố cụ thể — "Elevated errors on Claude Opus 4.6" — với chu kỳ investigating-fix-investigating kéo dài gần hai giờ.

Để công bằng, đây chưa phải bức tranh toàn cảnh. Độ tin cậy không chỉ là uptime. BeyondTrust's Phantom Labs đã công bố một lỗ hổng command injection trong Codex có thể lộ GitHub authentication token qua thao túng tên branch. Lỗ hổng ảnh hưởng web UI, CLI, SDK, và IDE integration — tên branch do người dùng kiểm soát được truyền thẳng vào shell command mà không sanitize. OpenAI đã vá, nhưng đây là lời nhắc rằng ổn định và bảo mật là hai chiều khác nhau của độ tin cậy, và cả hai đều quan trọng.

Tôi chia sẻ dữ liệu uptime không phải để chê Anthropic. Tôi dùng Claude Code mỗi ngày và nó vẫn xuất sắc. Nhưng cho bất kỳ ai đang xây workflow chuyên nghiệp quanh các tool này, những con số đáng biết. Và đây chính xác là lý do tại sao dùng song song không chỉ là "có thì tốt" — khi một dịch vụ có buổi chiều tệ, bạn chuyển sang cái kia và tiếp tục làm việc. Tôi đã làm vậy ba lần trong hai tuần.

Khoảng Cách Plugin Đang Thu Hẹp

Trong bài gốc, tôi ghi nhận hệ sinh thái plugin của Claude Code chín hơn. Đó là sự thật hai tuần trước. Giờ thì ít đúng hơn rồi.

Codex ra mắt hệ thống plugin vào ngày 27 tháng 3 với tích hợp Slack, Gmail, Google Drive, Linear, Figma, Sentry, Notion, và Hugging Face. Cộng thêm skills, hooks (bao gồm sự kiện SessionStart và UserPromptSubmit), MCP server, và thư mục plugin trong cả app lẫn CLI.

Bộ tính năng đang hội tụ. Cả hai tool giờ đều có: plugin/skill cho workflow tái sử dụng, hooks cho tự động hóa dựa trên sự kiện, tích hợp MCP server, và kết nối app-level với dịch vụ bên ngoài.

Chỗ Claude Code vẫn dẫn: hệ sinh thái plugin hiện có sâu hơn. Các plugin như Superpowers (lập kế hoạch có cấu trúc), /feature-dev (phát triển tính năng có hướng dẫn), và /frontend-design đã được trau chuốt qua nhiều tháng. Thư mục plugin của Codex mới hơn và từng plugin riêng lẻ chưa được thử thách nhiều.

Chỗ Codex đang vượt lên: Triggers. Codex có thể tự phản hồi GitHub event — issue đến, Codex tự sửa, mở PR. Đó là một thể loại tự động hóa mới mà Claude Code chưa có. Cho các team muốn workflow engineering tự trị, Triggers là một yếu tố khác biệt đáng kể.

Working Model Cập Nhật Của Tôi

Hai tuần trước, tôi chia công việc khoảng 60/40 Claude Code/Codex. Tôi có mental model rõ ràng: dùng Claude Code khi cần chất lượng, dùng Codex khi cần suy luận kiến trúc.

Sự phân chia gọn gàng đó đã tan rồi. Giờ tôi dùng cả hai xuyên suốt trong ngày, chuyển đổi theo cảm giác hơn là theo quy tắc. Codex cho task này, Claude Code cho task tiếp, đôi khi cả hai review cùng một plan. Hai tool gần nhau đủ về năng lực để câu hỏi "nên dùng cái nào cho việc này?" ít quan trọng hơn so với hai tuần trước.

Điều thay đổi là kinh tế.

Gói Plus của OpenAI là $20/tháng với limit ngày càng hào phóng. Tôi thấy mình với tay sang Codex ngày càng nhiều — không phải vì nó tốt hơn hẳn ở bất kỳ thứ gì, mà vì tổ hợp tốc độ, hiệu quả token, và mức giá $20 đó xóa bỏ ma sát. Không cần tính toán trong đầu "task này có đáng đốt token Claude Code không?"

Tôi đang nghiêng về việc hạ gói Claude Code từ tier Max $200/tháng xuống gói $100/tháng, thậm chí có thể xuống gói Pro $20/tháng. Hai tuần trước, điều đó sẽ cảm thấy mạo hiểm. Giờ thì thấy thực tế. Những việc tôi cần Claude Code phải xuất sắc — thiết kế frontend, orchestration Agent Teams, QA tự động bắt được những thứ tôi sẽ bỏ sót — đó là lợi thế thực sự. Nhưng chúng có thể không cần đến $200/tháng nếu Codex xử lý nửa workload với $20.

Tôi biết cái đặt cược này có rủi ro. Tier $20 của Claude Code có giới hạn sử dụng thực — nếu đụng limit trong phiên làm việc quan trọng, tôi sẽ hối hận vì hạ gói. Và limit hào phóng ở mức $20 của OpenAI nhiều khả năng là chiến thuật giành thị phần, không chắc kéo dài mãi. Nhưng ngay lúc này, kinh tế nghiêng về phía dùng song song.

Tổng chi phí ($20 Codex + $100 hoặc thậm chí $20 Claude Code) sẽ ít hơn số tôi đang trả cho riêng Claude Code. Và output kết hợp lại tốt hơn dùng từng tool đơn lẻ ở bất kỳ mức giá nào.

Đó có lẽ là takeaway thực tế nhất từ hai tuần dùng song song: cạnh tranh không chỉ làm tool tốt hơn. Nó làm tool rẻ hơn. Và rẻ hơn có nghĩa là bạn đủ khả năng dùng cả hai.

Tôi Dự Đoán Gì Tiếp Theo

Cả hai nền tảng đều đang tăng tốc. Codex vừa ra mắt plugin, trigger, và Windows client. Claude Code vừa ship Agent Teams, AutoMemory, Computer Use, và Scheduled Tasks. Không bên nào đứng yên.

Một chủ đề lặp đi lặp lại trong cộng đồng developer trên Reddit — và tôi nghĩ nó phản ánh đúng thực tế — là "Claude Code chất lượng cao hơn nhưng bạn hay đụng limit. Codex chất lượng thấp hơn chút nhưng dùng hàng ngày dễ hơn." Cán cân dịch chuyển khi cả hai cải thiện.

Lời khuyên của tôi vẫn như bài đầu, nhưng mạnh hơn giờ: hãy thử tool kia trong một tuần. Không phải để chuyển — mà để thêm. Workflow cross-model review vẫn là khám phá tốt nhất tôi từng tìm ra. Và sự bền bỉ vận hành khi có hai tool bạn tin tưởng sẽ cứu bạn vào cái ngày một trong hai bị sập.

Với tư cách người dùng, đây là tình huống tốt nhất có thể. Hai tool xuất sắc ngày càng tốt hơn, mỗi cái đẩy cái kia tiến lên. Tốc độ cạnh tranh khốc liệt đến mức tôi không nghĩ công ty nào có thể dẫn đầu thoải mái được lâu — chính vì vậy đặt cược vào một tool ngày càng rủi ro hơn và đặt cược vào workflow (dùng song song, cross-model review) ngày càng đúng hơn.

Câu Hỏi Thường Gặp

Quan điểm của bạn đã thay đổi so với bài đầu chưa?

Luận điểm cốt lõi — dùng song song tốt hơn chọn người thắng — chỉ càng vững hơn. Điều thay đổi là tỷ lệ (60/40 thành 50/50) và lý do. Sức mạnh suy luận chiến lược của Codex bất ngờ với tôi hơn cả những cải thiện về coding.

Codex có nhanh hơn Claude Code không?

Ở high thinking, có — luôn nhanh hơn, và so sánh từ bên thứ ba cho thấy dùng ít hơn khoảng 3 lần token cho task tương đương. Ở default thinking, khoảng cách nhỏ hơn. Cho công việc lặp đi lặp lại khi bạn qua lại thường xuyên, tốc độ và hiệu quả token cộng dồn lại.

Có nên lo về uptime của Claude Code không?

Số liệu 90 ngày cho thấy khoảng cách thực (99,2% vs 99,9%). Nếu Claude Code là tool duy nhất và bạn đang chạy deadline, hãy có plan B. Nhưng Anthropic ship khoảng 10 bản Claude Code release chỉ riêng tháng 3 — họ đang iterate rất nhanh về tính năng dù reliability vẫn đang đuổi theo OpenAI.

Còn lỗ hổng bảo mật của Codex thì sao?

Một lỗ hổng command injection trong Codex có thể lộ GitHub token qua tên branch. Nó đã được phát hiện và xử lý. Đáng biết, nhưng cũng đáng ghi nhận là các nhà nghiên cứu bảo mật đang tích cực test các tool này — điều đó tốt cho cả hệ sinh thái.

Câu chuyện chiến lược newsletter có thực sự là về tool không?

Một phần. Các model khác nhau có phong cách suy luận mặc định khác nhau. GPT-5.4 hay thách thức giả định của tôi hơn. Claude hay giúp thực thi plan cho tốt hơn. Cả hai đều hữu ích — nhưng cho chiến lược sản phẩm, "bạn có đang giải đúng bài toán không?" thường giá trị hơn "đây là một implementation tốt."

Nên mua tool nào?

Cả hai. Đó không phải né câu hỏi — đó thực sự là câu trả lời tốt nhất. Codex $20/tháng cộng Claude Code $20-100/tháng cho kết quả tốt hơn dùng riêng từng tool ở bất kỳ mức giá nào. Tôi đang nghiêng về việc hạ từ $200/tháng Claude Code xuống $100 hoặc thậm chí $20, và thêm Codex ở $20. Tổng chi phí giảm và output tăng. Tuy nhiên, limit hào phóng của OpenAI có thể không kéo dài — nên hãy linh hoạt nhé.

Vậy thôi nhé. Nếu bạn cũng đang chạy thí nghiệm dùng song song của riêng mình, tôi thực sự muốn nghe tỷ lệ chia của bạn đang dịch chuyển thế nào. Cùng pattern, hay hoàn toàn khác?

Cheers, Chandler