美国还是中国,谁在主导 AI 研究?

两篇有影响力文章对中美 AI 领先地位给出相反结论,但它们比较的样本与方法完全不同。争议本质不是“谁撒谎”,而是“谁在测量什么”。

本文写于2023年,部分内容可能已发生变化。

最近我看到两篇标题和结论差异很大的文章:

- China trounces U.S. in AI research output and quality(日经)

- Must read: the 100 most cited AI papers in 2022(Zeta Alpha)

Zeta Alpha 在文中写道:从 top-cited 论文来源看,美国仍占主导,并指出此前(引用日经)关于“中国可能已超越美国”的说法,从 citation 角度看“可能被夸大”。

这自然让我很好奇。

Nikkei 是可信媒体,日本又是美国盟友,理论上并没有明显动机“偏向中国叙事”。所以我决定看一下两篇到底差在哪。

结果是:其实不需要挖太深,就能发现两者可能同时为真——因为它们的研究方法和样本空间不同。

而 Zeta Alpha 既然在更晚发布时间里引用了日经,理应更明确地把方法差异直接写给读者,让读者自己判断。

方法论不一样,结论自然会分叉

Nikkei 的方法

Nikkei 与 Elsevier 合作,使用约 800 个 AI 相关关键词筛选学术与会议论文。

在数量层面,他们看到 AI 论文从 2012 年约 25,000 篇增长到 2021 年约 135,000 篇。

Zeta Alpha 的方法

Zeta Alpha 的做法是:

- 在平台里收集每年高引用论文

- 人工核对首发年份

- 再结合 Semantic Scholar 补齐高引用论文

- 用 Google Scholar 引用数做代表指标

- 最终排序得到每年的 Top 100

核心差异在于:Nikkei 看的是一个大得多的论文池;Zeta Alpha 只看每年 top 100。

两者都用 citation 作为“质量信号”,但样本边界完全不同。

例如 Nikkei 提到“2021 年中国在最被引用论文中达到 7,401 篇,比美国高约 70%”,这里对应的是Top 10% 论文池,即约 13,500 篇(基于 135,000 规模)。

而 Zeta Alpha 全文分析主要围绕“每年 top 100”展开。

这显然不是 apples-to-apples 对比。

哪个方法更好?

我不是 AI 学术方法论专家,没法武断说哪个一定更优。

但我确定它们不在同一口径。

如果要认真判断“哪个更好”,至少要先回答:

- 你定义“更好”的标准是什么?

- 更大样本覆盖更多 AI 细分领域。

- 只看 top 100 可能更贴近“头部商业/战略价值集中”的假设,但这个假设本身也需要证明。

- 除了 citation,是否有更好的论文价值衡量方式?

- citation 是常见指标,但并不完美。

- 一个国家 AI 能力与其 top 100 或 top 1000 引用论文占比之间,究竟是什么关系?

- 例如有些高军工或高商业价值研究可能根本不会公开发表。

这里还有很多可继续展开,我就先停在这里。

一些我认为值得再商榷的结论

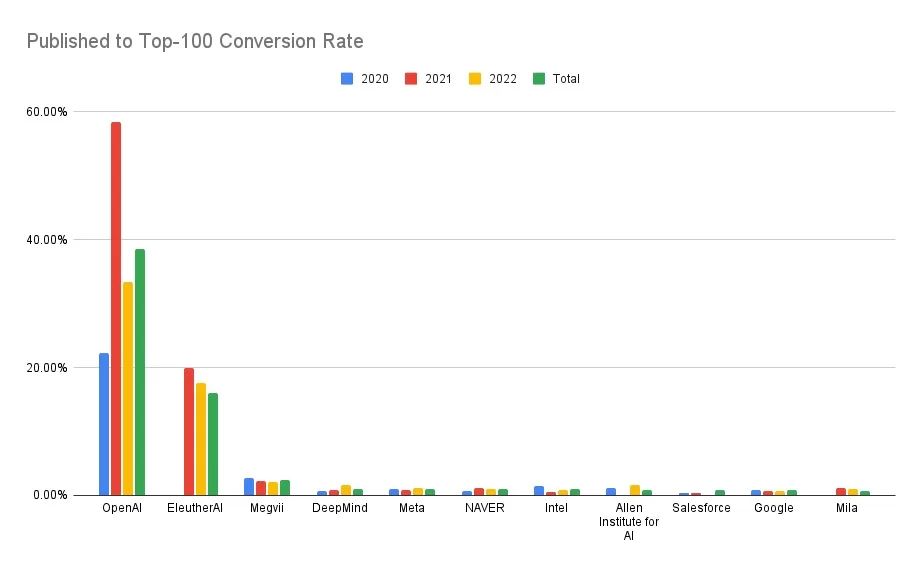

“OpenAI 在把论文变成 blockbuster 上独一档”

Zeta Alpha 文中提到:OpenAI、DeepMind 不在论文总量 top 20,但影响力高;并进一步提出 OpenAI 在“把论文变成 blockbuster”上独一档。

我会问:这个 conversion rate 为什么是关键指标?它到底代表什么?

另一种同样合理的解释是:

- OpenAI 研究范围更聚焦,发文数量更少

- Google、Meta 等机构研究面更宽,平行推进多个方向,因此发文更多

- 这不必然等于“OpenAI 更擅长把论文做成 blockbuster”

哪种组织方式更好?我不认为答案是单一的。

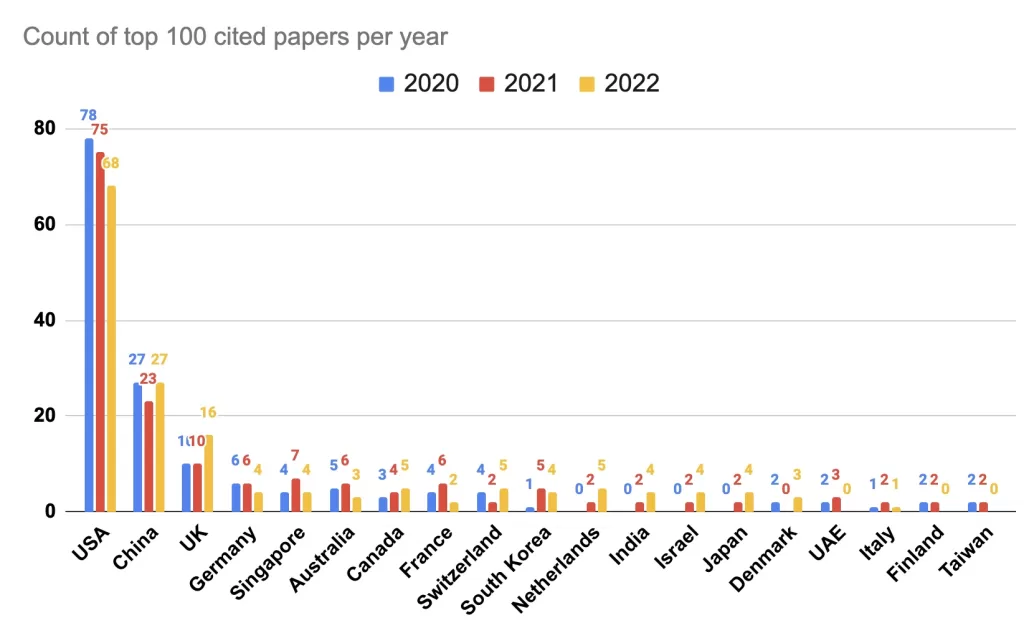

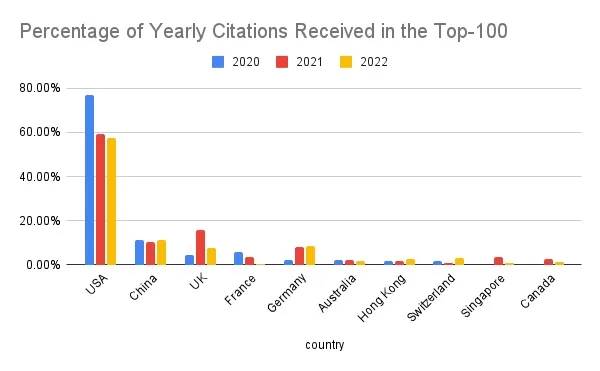

“美国主导 AI 研究论文”

这类结论在文中主要由以下图表支撑:

我同意:在 top 100(或 top 1000)里的强存在感,确实是国家 AI 实力的重要信号。

但我不认为它应是唯一信号。更合理的是使用一组指标(人才、算力、产业落地、专利、资本投入、关键系统部署等)综合判断。

还有一个方法问题:为什么是 top 100,不是 top 1000?

是理论上就应该看 100,还是因为人工核对工作量限制导致只能看 100?

结论

这又是一个典型案例:现实比标题复杂。

我理解媒体和研究报告会简化叙事帮助传播,但“过度简化”会带来误读。

你觉得评估一个国家 AI 能力,最合理的指标组合是什么?

只看高引用论文数量够吗,还是应加入更广泛的能力信号?欢迎交流。

致敬,

Chandler