Reaktionen auf "Bing AI Can't Be Trusted"

Ich habe die Behauptungen des Fakten-Checkers über Bing AIs fabrizierte Finanzdaten gegengeprüft – und das Problem der erfundenen Zahlen ist real und schlimmer als ich gehofft hatte.

Dieser Beitrag wurde 2023 geschrieben. Einige Details können sich seitdem geändert haben.

Ich bin heute auf diesen Artikel gestoßen: Bing AI can't be trusted – und er hat natürlich mein Interesse geweckt. Es ist ein guter Artikel voller Fakten-Checks, der zeigt, dass der neue Bing Chat viele erfundene Fakten über sachliche Informationen enthält. Der Beitrag ist relativ kurz, also lies ihn ruhig.

Hier sind meine schnellen Reaktionen dazu:

Gleichzeitig überrascht und nicht überrascht

Ich bin mir im Allgemeinen der Einschränkungen von Large Language Models (LLMs) bewusst, zu denen auch ChatGPT gehört. Die drei wichtigsten sind:

- Es indexiert das Web nicht über Textdaten hinaus (wie Videos, Audio, Bilder usw.)

- Der ChatGPT-Datensatz ist wirklich veraltet (2021)

- Diese Modelle erfinden Wörter, weil sie nicht wissen, welche Informationsquelle autoritativer/vertrauenswürdiger ist als andere.

Ich hatte also gehofft, dass mit der Bing & OpenAI-Integration die Bing-Suchmaschine all diese Einschränkungen lösen könnte. Nun, es scheint, dass Bing das laut Dmitris Artikel noch nicht gelöst hat. Nicht mal ansatzweise. 🙁

Den Artikel erneut fakten-checken

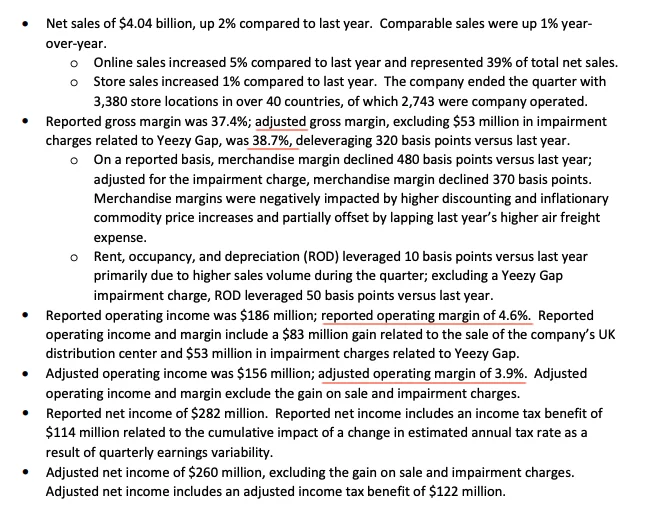

Es wäre nicht toll zu erfahren, dass das, was Dmitri erwähnt, auch nicht sachlich korrekt war. Also habe ich selbst ein paar Fakten-Checks vorgenommen. Ich beginne mit Gap-Finanzaussagen, weil es am einfachsten zu überprüfen scheint. Ich füge die Quellen und Screenshots unten ein, damit du diese Übung nicht wiederholen musst:

- Dies ist Gaps Q3 2022 Earnings Release.

- Den unten stehenden Screenshot habe ich aus der Gap-Aufstellung entnommen und die wichtigsten Zahlen rot markiert. Dmitri hat recht: Bing Chat hat Zahlen wie die bereinigte Bruttomarge, Betriebsmarge usw. erfunden.

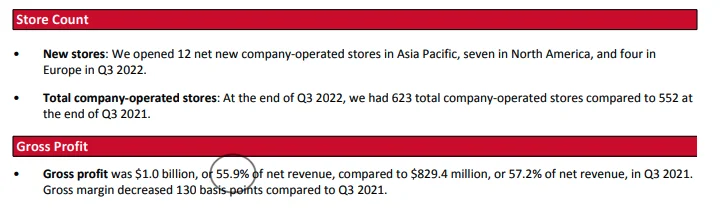

Was ist mit den Lululemon-Zahlen?

- Dies ist Lululemons Q3 2022 Finanzbericht. Gleiches Ergebnis: Ich habe die wichtigsten Zahlen aus Dmitris Artikel in den untenstehenden Screenshots markiert. Er hat recht – Bing Search hat Zahlen erfunden.

Was das Mexico City Reiseprogramm betrifft, bin ich in diesem Thema kein Experte und kann daher nicht sorgfältig fakten-checken. Als ich zum Beispiel nach "Primer Nivel Night Club - Antro" suchte, fand ich diese Facebook-Seite. Ich habe jedoch keine Möglichkeit, mit 100%iger Sicherheit zu überprüfen, ob die Vorschläge von Bing Search valid sind oder nicht.

Wie geht es von hier aus weiter?

Es scheint klar, dass Bing & OpenAI-Integration zu diesem Zeitpunkt das Problem, dass Large Language Models (LLMs) einfach Dinge erfinden, noch nicht behoben hat.

Ich bin nicht technisch genug, um zu verstehen, wie schwierig es ist, dieses Problem zu lösen. Wenn es bei sachlichen Daten so ungenau ist, müssen wir bei subjektiveren Themen wie besten Restaurants/Klempnern/lokalen Dienstleistungen, persönlicher Finanzen, Gesundheit, Beziehungen usw. vorsichtig sein.

Um fair gegenüber Bing und OpenAI zu sein: Sie sagten während der Präsentation, dass sie verstehen, dass die neue Technologie viele Dinge falsch machen kann. Daher haben sie die "Daumen hoch/Daumen runter"-Schnittstelle entworfen, damit Nutzer ihnen leicht Feedback geben können. Hoffentlich wird die Maschine mit mehr Nutzerfeedback besser.

Ein Algorithmus zum Fakten-Prüfen von LLM-Ausgaben?

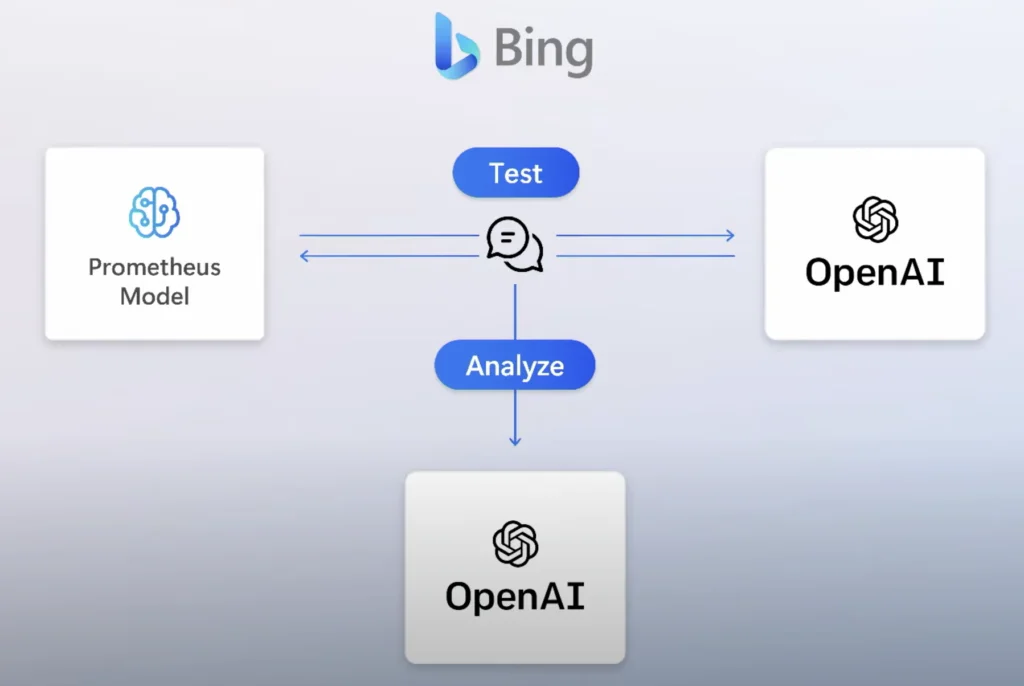

Da LLM oft falsche Ausgaben produzieren, wie wäre es, einen Algorithmus zu erstellen, um die Ausgaben kontinuierlich zu überprüfen? Das ähnelt dem, worüber Microsoft hinsichtlich des Sicherheitsalgorithmus sprach, den sie in Prometheus eingebaut haben, indem sie Prompts von schlechten Akteuren an die Maschine simulierten.

Die Rolle des Menschen

Diese Technologie scheint sich in einem frühen Stadium zu befinden, und während der Fortschritt exponentiell ist, ist die Rolle des Menschen entscheidend. Wir können der Ausgabe noch nicht vertrauen, auch nicht mit der Bing & OpenAI-Integration. Die Maschine kann uns bei 50% des gewünschten Ergebnisses helfen (mehr oder weniger), aber wir müssen noch weitere 50% beisteuern.

Es scheint genügend Zeit für uns zu geben, uns anzupassen, die Stärken und Einschränkungen dieser Technologie zu lernen und sie effektiv zu nutzen.

Was die Ingenieure betrifft, die diese Systeme entwerfen: Ihr müsst wahrscheinlich besser darin werden, den Endnutzern die Datenpunkte und Sätze, bei denen die Maschine unsicher ist, hervorzuheben. Unser menschliches Gehirn liebt Abkürzungen, also bin ich sicher, dass viele von uns (ich eingeschlossen) den faulen Weg nehmen und akzeptieren werden, was die Maschine sagt, als wäre es die Wahrheit :P Es ist schwer für uns, 100% der Zeit auf der Hut zu sein.

Hast du schon KI-generierte Antworten erwischt, die selbstbewusst falsch waren? Ich würde gerne deine Beispiele hören – je konkreter, desto besser.

Viele Grüße,

Chandler