USA oder China: Wer führt in der KI-Forschung?

Zwei große Analysen kamen zu gegensätzlichen Schlussfolgerungen über die KI-Führerschaft von USA vs. China – aber sie haben völlig unterschiedliche Dinge gemessen. Hier erkläre ich, warum beide recht haben könnten.

Kürzlich bin ich auf zwei Artikel mit sehr unterschiedlichen Überschriften und Schlussfolgerungen gestoßen:

- China trounces U.S. in AI research output and quality. Geschrieben von Kotaro Fukuoka, Shunsuke Tabeta und Akira Okikawa, Nikkei-Redakteuren.

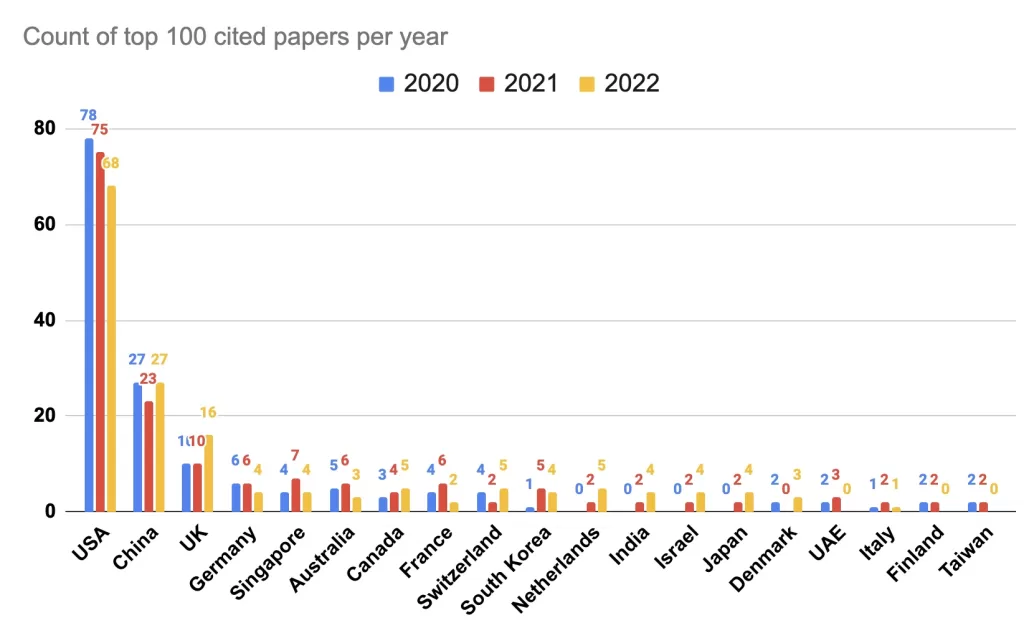

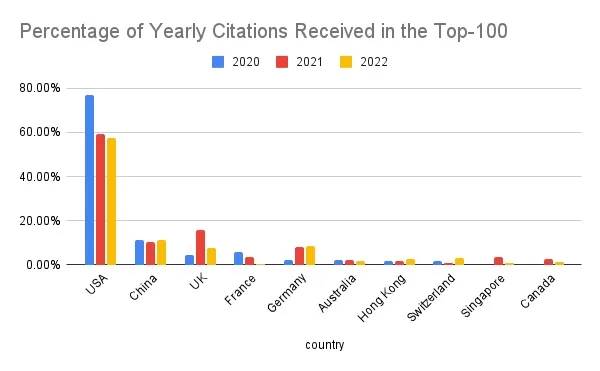

- Must read: the 100 most cited AI papers in 2022 von Zeta Alpha. Der Artikel schreibt: „Wenn wir uns anschauen, woher diese meistzitierten Papiere stammen (Abbildung 1), sehen wir, dass die Vereinigten Staaten weiterhin dominieren und der Unterschied zwischen den großen Mächten von Jahr zu Jahr nur leicht variiert."

- Eine der Schlussfolgerungen aus diesem Artikel ist: „Frühere Berichte (Link zum Nikkei-Artikel), dass China die USA in Forschung und Entwicklung von KI überholt haben könnte, scheinen stark übertrieben zu sein, wenn wir es aus der Perspektive der Zitationen betrachten."

Das macht mich natürlich neugierig, denn Nikkei ist eine seriöse Nachrichtenorganisation, und Japan ist ein US-Militärbündnispartner. Mit anderen Worten: Nikkei hat wenig Anreiz, die Wahrheit zugunsten Chinas zu „verdrehen". Also entschied ich mich, tiefer zu graben.

Nun, wie sich herausstellte, musste ich nicht sehr tief graben, um zu erkennen, dass beide gleichzeitig recht haben könnten, weil sie unterschiedliche Methoden zur Ableitung ihrer Schlussfolgerungen verwendet haben. Da Zeta Alpha ihren Artikel später veröffentlichte und den Nikkei-Artikel zitierte, hätte Zeta Alpha die Unterschiede in ihren Methoden direkt in ihrem Artikel hervorheben sollen, damit die Leser selbst entscheiden können.

Unterschiedliche Methoden

Nikkei-Methode

Zeta Alpha-Methode

Nikkei arbeitete mit dem niederländischen wissenschaftlichen Verlag Elsevier zusammen, um akademische Konferenzpapiere zu KI zu prüfen, und verwendete etwa 800 KI-bezogene Schlüsselwörter, um die Papiere einzugrenzen.

Um die obige Analyse zu erstellen, haben wir zunächst die meistzitierten Papiere pro Jahr auf der Zeta Alpha-Plattform gesammelt und dann manuell das erste Veröffentlichungsdatum überprüft, um die Papiere dem richtigen Jahr zuzuordnen.

Wir haben diese Liste ergänzt, indem wir hochzitierte KI-Papiere auf Semantic Scholar nach ihrer breiteren Abdeckung und der Möglichkeit, nach Zitationszahl zu sortieren, durchsucht haben. Wir nehmen dann für jedes Papier die Anzahl der Zitierungen auf Google Scholar als repräsentative Kennzahl und sortieren die Papiere nach dieser Zahl, um die Top 100 eines Jahres zu erhalten.

Quantitativ betrachtet explodierte die Anzahl der KI-Papiere von etwa 25.000 im Jahr 2012 auf ungefähr 135.000 im Jahr 2021.

Der Zeta Alpha-Artikel konzentriert sich ausschließlich auf die Top 100 Papiere für jedes Jahr

Sowohl Nikkei als auch Zeta Alpha verwenden Zitierungen als Indikator für die Qualität eines Papiers.

Der erste große Unterschied besteht jedoch darin, dass Nikkei eine viel größere Anzahl von KI-Papieren als Zeta Alpha betrachtet, um ihre Schlussfolgerung zu ziehen. Als Nikkei schrieb: „Im Jahr 2021 stammten 7.401 der meistzitierten Papiere aus China und übertrafen damit die amerikanische Zahl um etwa 70 %", bezogen sie sich auf die Top 10 % der Papiere, also im Wesentlichen ein Universum von 13.500 Papieren im Jahr 2021 (die Top 10 % von ungefähr 135.000 KI-Papieren im Jahr 2021).

Alle Analysen von Zeta Alpha in ihrem Artikel beziehen sich nur auf die Top 100 Papiere hinsichtlich der Zitierungen pro Jahr.

Das ist also überhaupt kein Äpfel-mit-Äpfeln-Vergleich.

Welche Methode ist besser, die von Nikkei oder von Zeta Alpha?

Ich habe keinen tiefen Hintergrund im KI-Bereich, daher kann ich nicht mit Sicherheit sagen, welche Methode besser ist. Ich weiß, dass sie unterschiedlich sind.

Wenn du diese Frage beantworten möchtest, musst du meiner Meinung nach:

- Erstens: Definiere, welche Kriterien du zur Bewertung von „besser" verwendest.

- Eine größere Anzahl von Papieren zu berücksichtigen bedeutet, dass deine Stichprobengröße viel größer ist und viele weitere Nischenbereiche innerhalb der KI abdeckt.

- Sich auf die Top 100 Papiere zu konzentrieren, könnte sinnvoll sein, wenn wir glauben, dass der größte kommerzielle oder strategische Wert langfristig auf die wenigen besten Papiere/Besitzer konzentrieren wird. Aber ich bezweifle, dass Zeta Alpha diese Analyse durchgeführt hat.

- Zweitens: Einen besseren Weg finden, den Wert oder die Auswirkung jedes Papiers zu quantifizieren, anstatt nur Zitierungen zu verwenden. Ich weiß, dass die Verwendung von Zitierungen eine grobe Methode zur Qualitätsbewertung ist, aber ist es der beste Weg?

- Drittens: Was ist die Beziehung zwischen den KI-Fähigkeiten eines Landes und dem Prozentsatz seiner veröffentlichten Papiere unter den Top 100 oder Top 1000 meistzitierten Papieren eines bestimmten Jahres?

- Zum Beispiel bin ich sicher, dass bei einigen der bahnbrechendsten Forschungen mit militärischen und hohen kommerziellen Werten manche Forschungslabore sich entscheiden, diese nicht zu veröffentlichen. Denn warum veröffentlichen, damit andere lernen und die Konkurrenz aufholen kann?

- Ich könnte noch weitermachen, aber ich hoffe, du verstehst meinen Punkt.

Einige fragwürdige Schlussfolgerungen/Überschriften

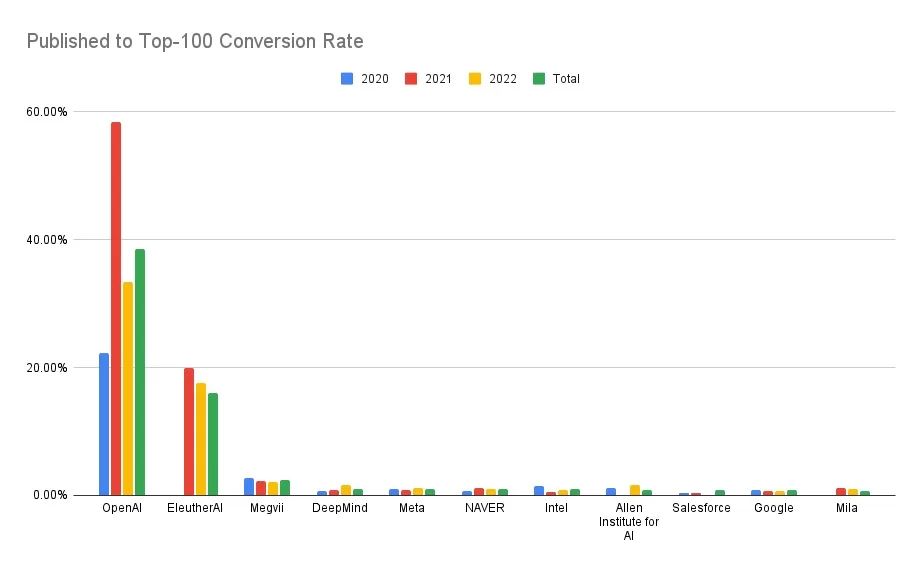

OpenAI ist schlicht in einer eigenen Liga, wenn es darum geht, Veröffentlichungen in absolute Blockbuster zu verwandeln

Zeta Alpha schrieb das: „Du wirst OpenAI oder DeepMind nicht unter den Top 20 im Volumen der Veröffentlichungen finden. Diese Institutionen veröffentlichen weniger, aber mit größerem Einfluss." und „Jetzt sehen wir, dass OpenAI schlicht in einer eigenen Liga ist, wenn es darum geht, Veröffentlichungen in absolute Blockbuster zu verwandeln."

Warum ist diese „Konversionsrate" wichtig zu betrachten? Was bedeutet das? Eine einfache Möglichkeit, die Daten zu interpretieren, ist:

- OpenAI-Forschung konzentriert sich auf ein sehr enges Feld der KI, und sie wählen, nur eine sehr begrenzte Anzahl von Papieren zu veröffentlichen.

- Google oder Meta und andere Unternehmen haben ein breites Interesse an KI und forschen gleichzeitig in vielen verschiedenen Bereichen. Und sie entscheiden sich, mehr zu veröffentlichen.

- Das hat nichts damit zu tun, dass OpenAI gut darin ist, Veröffentlichungen in Blockbuster zu verwandeln.

Welche Arbeitsweise besser ist? Da bin ich mir nicht so sicher.

Die USA dominieren KI-Forschungspapiere

Diese Schlussfolgerung basiert auf zwei Hauptdatenpunkten unten.

Wie oben erwähnt: Ich stimme zwar zu, dass eine starke Präsenz unter den Top 100 (oder 1000 oder welche Zahl auch immer) meistzitierten KI-Papieren ein Signal für die Stärke eines Landes in der KI ist. Ich glaube aber nicht, dass das das EINZIGE Signal sein sollte. Es sollte eine Reihe von Datenpunkten oder Signalen geben, um diese Schlussfolgerung abzuleiten.

Warum auch nur Top 100 und nicht Top 1000? Liegt es daran, dass die Methodik von Zeta Alpha manuelle Überprüfungen beinhaltet, sodass sie nur die Top 100 abdecken können?

Fazit

Dies ist ein weiteres Beispiel dafür, wie die Realität viel nuancierter ist als manche Überschriften vermuten lassen. Auch wenn ich den Aufwand schätze, die Geschichte für das Publikum zu vereinfachen, sollten wir nicht versuchen, sie „zu sehr zu vereinfachen." :)

Was denkst du, ist ein besserer Weg, die KI-Fähigkeiten eines Landes zu messen? Reicht die Anzahl der meistzitierten Papiere, oder sollten wir ein breiteres Set an Signalen betrachten? Ich würde gerne deine Gedanken hören.

Viele Grüße,

Chandler