¿EE.UU. o China: quién lidera la investigación en IA?

Dos análisis importantes llegaron a conclusiones opuestas sobre el liderazgo en IA de EE.UU. frente a China — pero midieron cosas completamente diferentes. Aquí te explico por qué ambos podrían tener razón.

Recientemente me topé con dos artículos con titulares y conclusiones muy diferentes:

- China trounces U.S. in AI research output and quality. Fue escrito por Kotaro Fukuoka, Shunsuke Tabeta y Akira Okikawa, redactores de Nikkei.

- Must read: the 100 most cited AI papers in 2022 de Zeta Alpha. El artículo escribió "Cuando miramos de dónde vienen estos artículos más citados (Figura 1), vemos que Estados Unidos continúa dominando y la diferencia entre las principales potencias varía solo ligeramente por año."

- Una de las conclusiones de este artículo es que "Informes anteriores (enlace al artículo de Nikkei) que sugieren que China puede haber superado a EE.UU. en I+D de IA parecen ser altamente exagerados si lo miramos desde la perspectiva de las citas."

Naturalmente, esto me generó curiosidad porque Nikkei es una organización de noticias respetable, y Japón es un aliado militar de EE.UU. En otras palabras, Nikkei tiene pocos incentivos para "torcer" la verdad a favor de China. Así que decidí profundizar más.

Pues bien, resultó que no necesité profundizar mucho para saber que ambos podían tener razón al mismo tiempo porque utilizaron metodologías diferentes para llegar a sus conclusiones. Dado que Zeta Alpha publicó su artículo más tarde y citó el artículo de Nikkei, Zeta Alpha debería haber destacado las diferencias en sus metodologías directamente en el artículo; y dejar que los lectores decidieran por sí mismos.

Metodologías diferentes

Metodología de Nikkei

Metodología de Zeta Alpha

Nikkei trabajó con la editorial científica holandesa Elsevier para revisar artículos académicos y de conferencias sobre IA, usando alrededor de 800 palabras clave asociadas con IA para filtrar los artículos.

Para crear el análisis anterior, primero hemos recopilado los artículos más citados por año en la plataforma de Zeta Alpha, y luego verificamos manualmente la primera fecha de publicación, para poder ubicar los artículos en el año correcto.

Complementamos esta lista minando artículos de IA altamente citados en Semantic Scholar con su cobertura más amplia y capacidad de ordenar por número de citas. Luego tomamos para cada artículo el número de citas en Google Scholar como métrica representativa y ordenamos los artículos por este número para obtener el top-100 de un año.

Mirando la cantidad, el número de artículos de IA se disparó de alrededor de 25,000 en 2012 a aproximadamente 135,000 en 2021.

El artículo de Zeta Alpha se centra solo en los 100 artículos principales de cada año

Tanto Nikkei como Zeta Alpha usan las citas como indicador de la calidad del artículo.

Pero la primera gran diferencia es que Nikkei analiza un número mucho mayor de artículos de IA que Zeta Alpha para llegar a su conclusión. Cuando Nikkei escribe "En 2021, China representó 7,401 de los artículos más citados, superando el recuento americano en un 70% aproximadamente", se refieren al top 10% de los artículos, básicamente un universo de 13,500 artículos en 2021 (el top 10% de aproximadamente 135,000 artículos de IA en 2021).

Todo el análisis de Zeta Alpha en su artículo trata sobre los 100 artículos principales en términos de citas para cada año solamente.

Así que esto no es en absoluto una comparación de manzanas con manzanas.

¿Qué método es mejor, entre Nikkei y Zeta Alpha?

No tengo una formación profunda en el campo de la IA, así que no puedo decir con confianza qué metodología es mejor. Sí sé que son diferentes.

Si quieres responder esta pregunta, creo que necesitas:

- Primero, definir qué criterios estás usando para evaluar "mejor":

- Cubrir un mayor número de artículos significa que tu tamaño de muestra es mucho mayor y cubre muchas más áreas nicho dentro de la IA.

- Enfocarse en los 100 artículos principales puede tener sentido si creemos que la mayoría del valor comercial o estratégico se acumulará en los pocos artículos/propietarios principales con el tiempo. Pero dudo que Zeta Alpha haya hecho este análisis.

- Segundo, encontrar una mejor manera de cuantificar el valor o impacto de cada artículo en lugar de solo usar citas. Sé que usar citas es una forma cruda de evaluar la calidad, pero ¿es la mejor manera?

- Tercero, ¿cuál es la relación entre la capacidad de IA de un país y el porcentaje de sus artículos publicados entre los 100 o 1000 más citados en un año determinado?

- Por ejemplo, estoy seguro de que para algunas de las investigaciones más vanguardistas con valores militares y comerciales muy altos, algunos laboratorios de investigación eligen no publicarlos. ¿Por qué publicarlos para que otros aprendan, ayudando a la competencia a cerrar la brecha?

- Podría continuar, pero espero que entiendas mi punto

Algunas conclusiones/titulares cuestionables

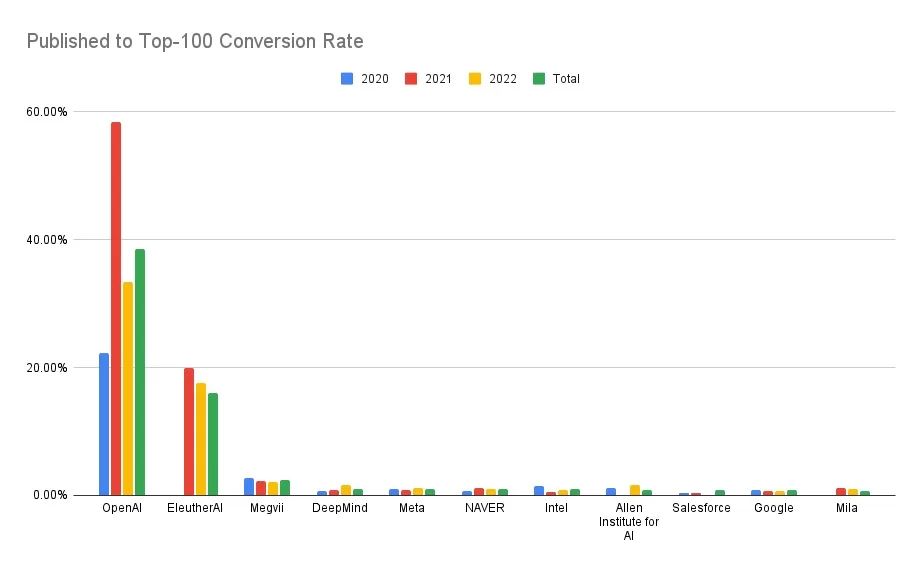

OpenAI está simplemente en una liga propia cuando se trata de convertir publicaciones en éxitos absolutos

Zeta Alpha escribió que "No verás a OpenAI o DeepMind entre los 20 principales en volumen de publicaciones. Estas instituciones publican menos pero con mayor impacto." y "Ahora vemos que OpenAI está simplemente en una liga propia cuando se trata de convertir publicaciones en éxitos absolutos."

¿Por qué es importante mirar esta "tasa de conversión"? ¿Qué significa eso? Una forma sencilla de interpretar los datos es:

- La investigación de OpenAI se enfoca en un campo muy estrecho de IA, y eligen publicar un número muy limitado de artículos.

- Google o Meta y otras empresas tienen un amplio interés en la IA, e investigan simultáneamente muchas áreas diferentes. Y eligen publicar más.

- Esto no tiene nada que ver con que OpenAI sea buena para convertir publicaciones en éxitos.

¿Qué forma de trabajar es mejor? No estoy tan seguro

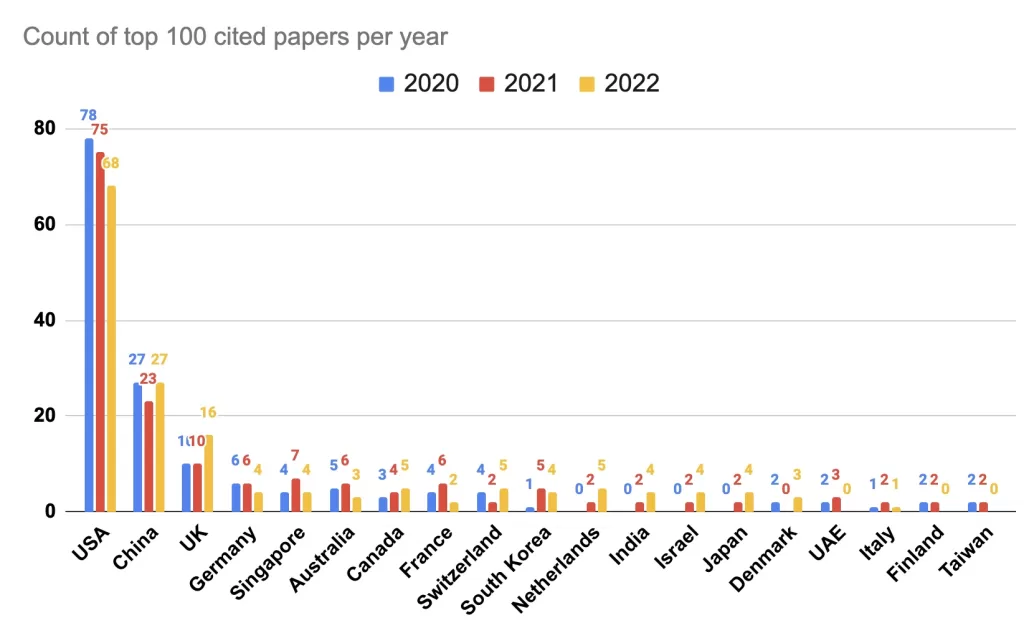

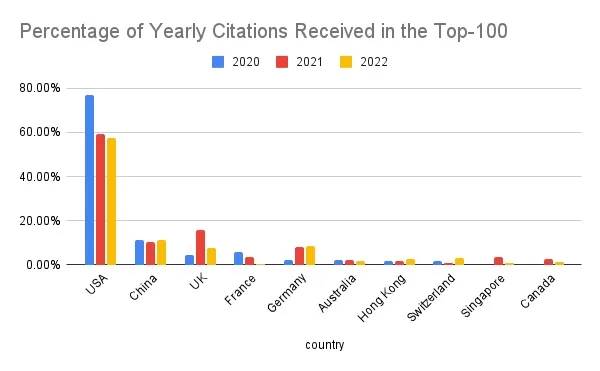

EE.UU. domina los artículos de investigación en IA

Esta conclusión se basa en los dos datos principales a continuación

Como se mencionó anteriormente, si bien estoy de acuerdo en que tener una fuerte presencia en los 100 artículos de IA más citados (o 1000 o el número que sea) es una señal sobre la fortaleza del país en IA. No creo que esa deba ser la ÚNICA señal. Debería haber un conjunto de puntos de datos o señales para llegar a esa conclusión.

Además, ¿por qué los 100 principales y no los 1000 principales? ¿Es porque la metodología de Zeta Alpha implica verificación manual para que solo puedan cubrir los 100 principales?

Conclusión

Este es otro ejemplo de cómo la situación real es mucho más matizada que algunos titulares indican. Así que aunque aprecio el esfuerzo por simplificar la historia para la audiencia, no deberíamos intentar "simplificarla demasiado." :)

¿Qué crees que es una mejor manera de medir la capacidad de IA de un país? ¿Es suficiente el número de artículos más citados, o deberíamos mirar un conjunto más amplio de señales? Me encantaría escuchar tus pensamientos.

Un abrazo,

Chandler