"Bing AI पर भरोसा नहीं किया जा सकता" — मेरी प्रतिक्रियाएं

मैंने उस fact-checker के दावों को fact-check किया जो कह रहे थे कि Bing AI वित्तीय आंकड़े गढ़ रहा है — और पता चला कि बनाए हुए नंबरों की समस्या real है और मुझे जितनी उम्मीद थी उससे कहीं बुरी।

यह पोस्ट 2023 में लिखी गई थी। तब से कुछ जानकारी बदल सकती है।

आज मुझे यह article मिला — Bing AI पर भरोसा नहीं किया जा सकता, और स्वाभाविक रूप से यह मेरी जिज्ञासा जगाता है। यह एक अच्छा article है जिसमें कई fact checks हैं जो दिखाते हैं कि नए Bing chat में factual information के बारे में कई बनाए हुए तथ्य शामिल हैं। यह post अपेक्षाकृत छोटी है, इसलिए जाकर पढ़ें।

तो मेरी कुछ त्वरित प्रतिक्रियाएं:

एक साथ हैरान भी और नहीं भी

मैं सामान्यतः large language model (LLM) की सीमाओं के बारे में जानता हूँ जिसमें ChatGPT भी शामिल है। तीन मुख्य सीमाएं हैं:

- यह web को text data से परे (जैसे video, audio, images, आदि) index नहीं करता।

- ChatGPT का data set काफी पुराना है (2021)।

- ये models शब्द बनाते हैं क्योंकि वे यह नहीं जानते कि कौन सा information source दूसरे से ज्यादा authoritative/trustworthy है।

इसलिए मुझे उम्मीद थी कि Bing और OpenAI के एकीकरण से Bing search machine ऊपर की सभी सीमाओं को हल कर सकेगी। खैर, Dmitri के article के आधार पर ऐसा लगता है कि Bing ने यह अभी तक हल नहीं किया है। बिल्कुल भी नहीं। 🙁

Article को फिर से fact-check करना

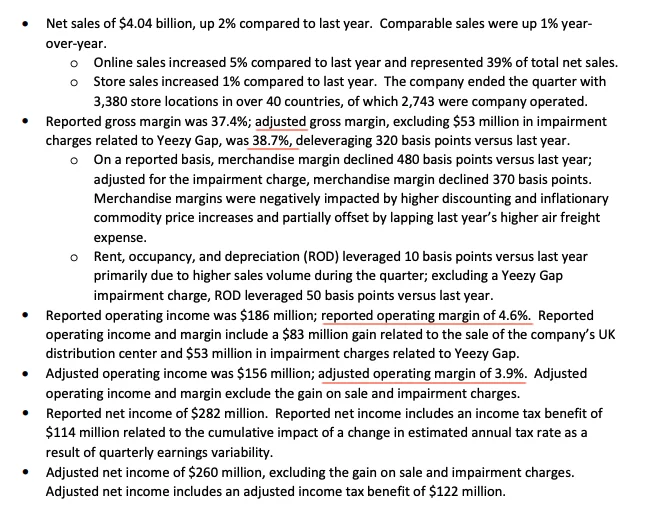

यह अच्छा नहीं होगा अगर Dmitri ने जो कहा वह भी factually correct नहीं था। इसलिए मैंने खुद कुछ fact-checks किए। मैंने Gap के financial statements से शुरुआत की क्योंकि यह check करना सबसे सीधा लगता है। मैं नीचे sources और screenshots शामिल कर रहा हूँ ताकि आपको यह exercise दोहरानी न पड़े:

- यह Gap का Q3 2022 earning release है।

- मैंने Gap के statement से नीचे screenshot लिया और key numbers को red में highlight किया। Dmitri सही है, Bing chat ने adjusted gross margin, operating margin जैसे numbers बनाए हैं।

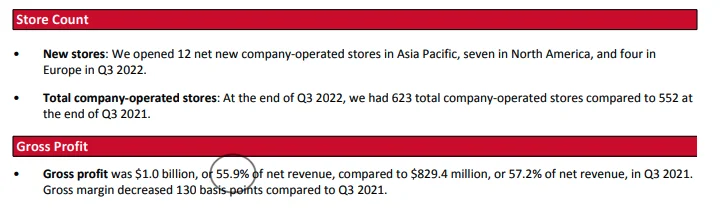

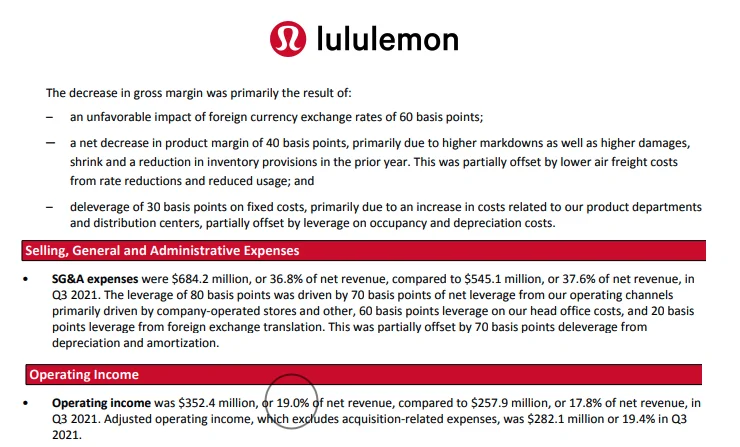

Lululemon के numbers के बारे में क्या?

- यह Lululemon की Q3 2022 financial report है। वही बात, मैंने Dmitri के article में उल्लिखित key numbers को नीचे screenshots में highlight किया है। वह सही है, Bing search ने numbers बनाए।

Mexico City itinerary के बारे में, मैं इस विषय का expert नहीं हूँ, इसलिए ध्यान से fact-check नहीं कर सकता।

आगे क्या?

यह स्पष्ट है कि इस समय, Bing और OpenAI का एकीकरण large language models (LLMs) की बनाए हुए तथ्यों की समस्या को अभी तक ठीक नहीं कर पाया है।

मैं इतना technical नहीं हूँ कि समझ सकूं कि इस समस्या को हल करना कितना मुश्किल है। अगर यह factual data के साथ इतना inaccurate है, तो हमें best restaurants/plumbers/local services, personal finance, health, relationship जैसे ज्यादा subjective topics के बारे में सावधान रहने की जरूरत है।

अब Bing और OpenAI के साथ fair होने के लिए, उन्होंने presentation के दौरान कहा था कि वे समझते हैं कि नई technology कई चीज़ें गलत कर सकती है, इसलिए उन्होंने "thumb up/thumb down" interface design किया ताकि users आसानी से feedback दे सकें। उम्मीद है, ज्यादा user feedback से machine बेहतर होगी।

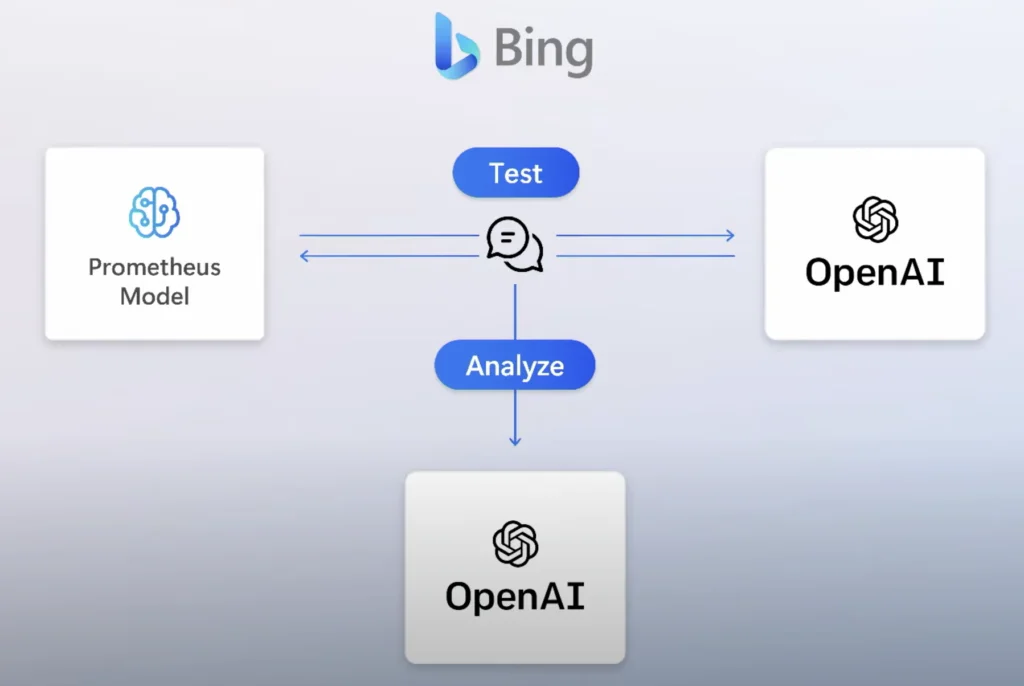

LLM output को fact-check करने के लिए एक algorithm?

चूंकि LLM अक्सर गलत output देती है, तो क्यों न continuously output को fact-check करने के लिए एक algorithm बनाया जाए? यह उसी तरह है जैसे Microsoft ने Prometheus में safety algorithm की बात की थी, जो machine को bad actors के prompts simulate करता है।

इंसान की भूमिका

यह technology अभी शुरुआती दौर में है, और जबकि प्रगति exponential है, इंसान की भूमिका critical है। हम अभी भी output पर trust नहीं कर सकते, Bing और OpenAI के एकीकरण के साथ भी। Machine हमें desired outcome का 50% (कम या ज्यादा) दे सकती है, लेकिन हमें बाकी 50% खुद लगानी होगी।

ऐसा लगता है कि हमारे पास इस technology की strengths और limitations को समझने और adjust करने और इसे प्रभावी ढंग से इस्तेमाल करने के लिए पर्याप्त समय है।

Engineers के लिए, जो इन systems को design करते हैं, आपको शायद end users को वे data points और sentences highlight करने में बेहतर काम करना होगा जिनके बारे में machine अनिश्चित है। हमारे इंसानी दिमाग shortcuts पसंद करते हैं इसलिए मुझे यकीन है कि हम में से कई (खुद सहित) lazy रास्ता लेंगे और machine की बात को सच मान लेंगे :P 100% समय पर guard पर रहना हमारे लिए मुश्किल है।

क्या आपने कभी AI-generated answers को confidently गलत पाया है? मुझे आपके examples सुनना अच्छा लगेगा — जितने specific, उतना बेहतर।

शुभकामनाओं सहित, Chandler