माइग्रेशन के बाद क्या होता है: 8 दिनों का चक्रवृद्धि रिटर्न

मैंने अपने ब्लॉग को Next.js पर माइग्रेट किया और सोचा कि मुश्किल हिस्सा खत्म हो गया। फिर चक्रवृद्धि प्रभाव शुरू हुआ — 6 मेगा गाइड, एक स्मार्ट AI असिस्टेंट, नेटिव न्यूज़लेटर, बॉट प्रोटेक्शन, और SEO ओवरहॉल 8 दिनों में।

आठ दिन पहले, मैंने अपने पूरे ब्लॉग बैकएंड को 4 दिनों में रीबिल्ड किया। मैंने 485 WordPress पोस्ट्स को Next.js पर माइग्रेट किया, Sydney (मेरा AI चैटबॉट) को वापस जीवित किया, और एक प्रोडक्शन साइट शिप की।

मैंने सोचा कि बस यही कहानी थी। माइग्रेशन पूरा, जश्न मनाओ, आगे बढ़ो।

मैं गलत था। माइग्रेशन मंज़िल नहीं थी — यह शुरुआती रेखा थी।

यहाँ देखिए कि 5 फरवरी बनाम आज मेरी साइट कैसी दिखती थी:

| फ़ीचर | 5 फरवरी (माइग्रेशन दिवस) | 13 फरवरी (आज) |

|---|---|---|

| ब्लॉग पोस्ट्स | 485 (WordPress से माइग्रेट) | 492 (6 नई मेगा गाइड) |

| Sydney AI | बेसिक RAG, अनटेस्टेड क्वालिटी | इवैल्यूएटेड, ऑप्टिमाइज़्ड, 81% हिट रेट |

| न्यूज़लेटर | Beehiiv एम्बेड (थर्ड-पार्टी) | नेटिव Supabase + Resend, इंटरेस्ट-बेस्ड |

| SEO | बेसिक sitemap + meta tags | Structured data, FAQ schema, llms.txt, AEO |

| सिक्योरिटी | सिर्फ Rate limiting | Cloudflare Turnstile + rate limiting |

| परफ़ॉर्मेंस | बेसिक Lighthouse चेक्स | Chrome DevTools MCP से सिस्टमैटिक प्रोफ़ाइलिंग |

| फ़ीचर्ड इमेजेज़ | मैन्युअल क्रिएशन | AI-जनरेटेड पाइपलाइन (Gemini + ऑटो-ऑप्टिमाइज़) |

इनमें से हर सुधार इसलिए हुआ क्योंकि पिछले सुधार ने अगले को आसान बना दिया। यही वह चक्रवृद्धि प्रभाव था जिसकी मुझे उम्मीद नहीं थी।

अनलॉक: आपका ब्लॉग अब कोड है

यहाँ वो बात है जो कोई नहीं बताता जब आप WordPress से कोड-बेस्ड स्टैक पर माइग्रेट करते हैं: माइग्रेशन अपने आप में मुद्दा नहीं है। मुद्दा यह है कि उसके बाद क्या संभव हो जाता है।

जब आपका ब्लॉग MySQL डेटाबेस में rows की जगह Git repo में 492 MDX फ़ाइलें हो, तो सब कुछ बदल जाता है:

- हर पोस्ट एक फ़ाइल है — Claude Code उन्हें बड़े पैमाने पर पढ़, सर्च और मॉडिफ़ाई कर सकता है

- हर बदलाव एक diff है — आप एक साथ 50 पोस्ट्स में हुए बदलाव सटीक रूप से रिव्यू कर सकते हैं

- हर फ़ीचर composable है — आपका न्यूज़लेटर सिस्टम वही पोस्ट मेटाडेटा पढ़ सकता है जो आपका AI चैटबॉट पढ़ता है

- हर डिप्लॉयमेंट एक कमांड है —

pnpm build && vercel --prod, बस

WordPress में 12 ब्लॉग पोस्ट्स अपडेट करने का मतलब था wp-admin में लॉगिन करना, हर एक पर क्लिक करना, बदलाव करना, अपडेट करना, दोहराना। MDX फ़ाइलों और Claude Code के साथ? मैं कह सकता था "सभी 12 मौजूदा पार्क गाइड्स में नेशनल पार्क्स पिलर पोस्ट का लिंक जोड़ो" और यह हर फ़ाइल पढ़ता, सही कॉन्टेक्स्ट में सही क्रॉस-लिंक जोड़ता, और मुझे diff दिखाता। मिनटों में सभी 12 अपडेट।

यही असली अनलॉक है। माइग्रेशन नहीं। उसके बाद आने वाली वेलॉसिटी।

चार दिनों में छह मेगा गाइड

माइग्रेशन के बाद पहली चीज़ जो मैंने बनाई? कंटेंट। बहुत सारा कंटेंट।

मैं महीनों से व्यापक एक्सपैट गाइड लिखना चाहता था — 2,000-4,000 शब्दों की पिलर पोस्ट्स जो US में शिफ्ट होने की उथल-पुथल में लोगों की सच में मदद करें। WordPress में यह काम दर्दनाक था। हर पोस्ट के लिए मैन्युअल फ़ॉर्मेटिंग, इमेज अपलोड्स, SEO प्लगइन कॉन्फ़िगरेशन, कैटेगरी मैनेजमेंट ज़रूरी थी।

अब? पाइपलाइन कुछ ऐसी दिखती है:

- ब्रेनस्टॉर्म — पोस्ट की संरचना और आउटलाइन

- लिखो — पूरी MDX, SEO/AEO ऑप्टिमाइज़ेशन बिल्ट-इन

- फ़ीचर्ड इमेज जनरेट करो — Claude पोस्ट पढ़ता है, प्रॉम्प्ट लिखता है, Gemini को भेजता है इमेज बनाने के लिए

- ऑप्टिमाइज़ — Python स्क्रिप्ट WebP में कन्वर्ट करती है, वेब के लिए कम्प्रेस करती है

- अपलोड — Vercel Blob पर

- पब्लिश —

git push,vercel --prod,pnpm db:publish - Sydney को तुरंत पता चल जाता है — पोस्ट embeddings के साथ Supabase में सिंक हो जाती है

उन 4 दिनों में जो शिप हुआ:

| पोस्ट | विषय | शब्द |

|---|---|---|

| हेल्थकेयर गाइड | HSA, FSA और HDHP समझाया | ~3,200 |

| क्रेडिट बिल्डिंग | ज़ीरो से 720+ क्रेडिट स्कोर | ~3,500 |

| सेविंग्स और इन्वेस्टिंग | T-Bills बनाम HYSA ब्रेकडाउन | ~2,800 |

| क्रेडिट कार्ड रिवॉर्ड्स | पॉइंट्स, माइल्स, कैशबैक रणनीति | ~3,000 |

| रीलोकेशन गाइड | US जाने की पूरी प्लेबुक | ~3,800 |

| नेशनल पार्क्स | 26 पार्क्स, 4 रोड ट्रिप्स | ~4,200 |

हर पोस्ट एक ही AEO पैटर्न फ़ॉलो करती है: answer-first ओपनिंग, कम्पेरिज़न टेबल्स, 120-180 शब्दों के सेक्शन, बोल्ड डेफ़िनिशन्स, नीचे FAQ schema। वह तरह की संरचना जो AI साइटेशन में 340% ज़्यादा हासिल करती है।

नेशनल पार्क्स गाइड सबसे बड़ी थी — एक पिलर पोस्ट जो 12 मौजूदा पार्क रिव्यूज़ से लिंक करती है। मैंने इसके लिए एक PhotoGallery कम्पोनेंट भी बनाया, क्योंकि 20 अलग-अलग इमेजेज़ को स्क्रॉल करना भयंकर था। अब यह एक साफ़-सुथरा ग्रिड है जिसमें लाइटबॉक्स है। सिंपल, लेकिन प्रभावी।

Sydney और स्मार्ट हो गई

जब मैंने माइग्रेशन के दौरान Sydney को वापस लाया, तो वह काम कर रही थी — और मैंने लॉन्च से पहले उसे मैन्युअली टेस्ट किया। वह सवालों का जवाब दे सकती थी, प्रासंगिक पोस्ट्स ढूँढ सकती थी, सोर्सेज़ साइट कर सकती थी। लेकिन मैन्युअल टेस्टिंग सिर्फ यह बताती है कि "ठीक लग रहा है।" यह नहीं बताती कि कितना ठीक, या कहाँ कमियाँ हैं, या कैसे बेहतर करें।

मेरे पास क्वालिटी मापने का कोई व्यवस्थित तरीका नहीं था — और बिना मापे, सुधार का कोई रास्ता नहीं था।

इसलिए मैंने एक RAG इवैल्यूएशन फ्रेमवर्क बनाया। 12 कैटेगरीज़ में 32 टेस्ट क्वेरीज़, हर एक के लिए मैंने हाथ से expected results तैयार किए। जैसे "एक्सपैट्स को कौन से क्रेडिट कार्ड लेने चाहिए?" से क्रेडिट बिल्डिंग गाइड आनी चाहिए। "Yosemite के बारे में बताओ" से Yosemite ट्रिप रिपोर्ट आनी चाहिए।

फिर मैंने 30 अलग-अलग कॉन्फ़िगरेशन कॉम्बिनेशन्स टेस्ट किए — 6 similarity thresholds × 5 result counts — और hit rate, precision, और temporal diversity मापी।

नतीजे चौंकाने वाले थे:

| मेट्रिक | पहले (डिफ़ॉल्ट) | बाद में (ऑप्टिमाइज़्ड) |

|---|---|---|

| Hit rate | ~30% | 81.2% |

| Zero-hit क्वेरीज़ | 30 में से 6 | 30 में से 0 |

| Temporal spread | 1.2 साल | 6.7 साल |

सबसे बड़ा फ़िक्स शर्मनाक था: OpenAI SDK Next.js के अंदर चलते समय चुपचाप dimensions पैरामीटर को ड्रॉप कर रहा था। Sydney 1536-dimension embeddings जनरेट कर रही थी लेकिन 384-dimension इंडेक्स में सर्च कर रही थी। कोई आश्चर्य नहीं कि रिज़ल्ट्स खराब थे। डायरेक्ट fetch() कॉल्स पर स्विच करने से यह रातोंरात ठीक हो गया।

मैंने Sydney के system prompt को भी विस्तार दिया ताकि वह सभी 490+ ब्लॉग टॉपिक्स कवर करे — अब वह नेशनल पार्क्स, क्रेडिट कार्ड्स, हेल्थकेयर, और पूरी एक्सपैट कंटेंट लाइब्रेरी के बारे में जानती है। सिर्फ AI और मार्केटिंग नहीं।

इसे खुद टेस्ट करने के लिए दो कमांड्स:

pnpm eval:rag # लोकल Supabase पर टेस्ट करें

pnpm eval:rag:prod # प्रोडक्शन पर टेस्ट करें

अब मैं वाकई में माप सकता हूँ कि Sydney कब स्मार्ट हो रही है। यह उस तरह का इन्फ्रास्ट्रक्चर है जो आप WordPress चलाते हुए कभी नहीं बनाते।

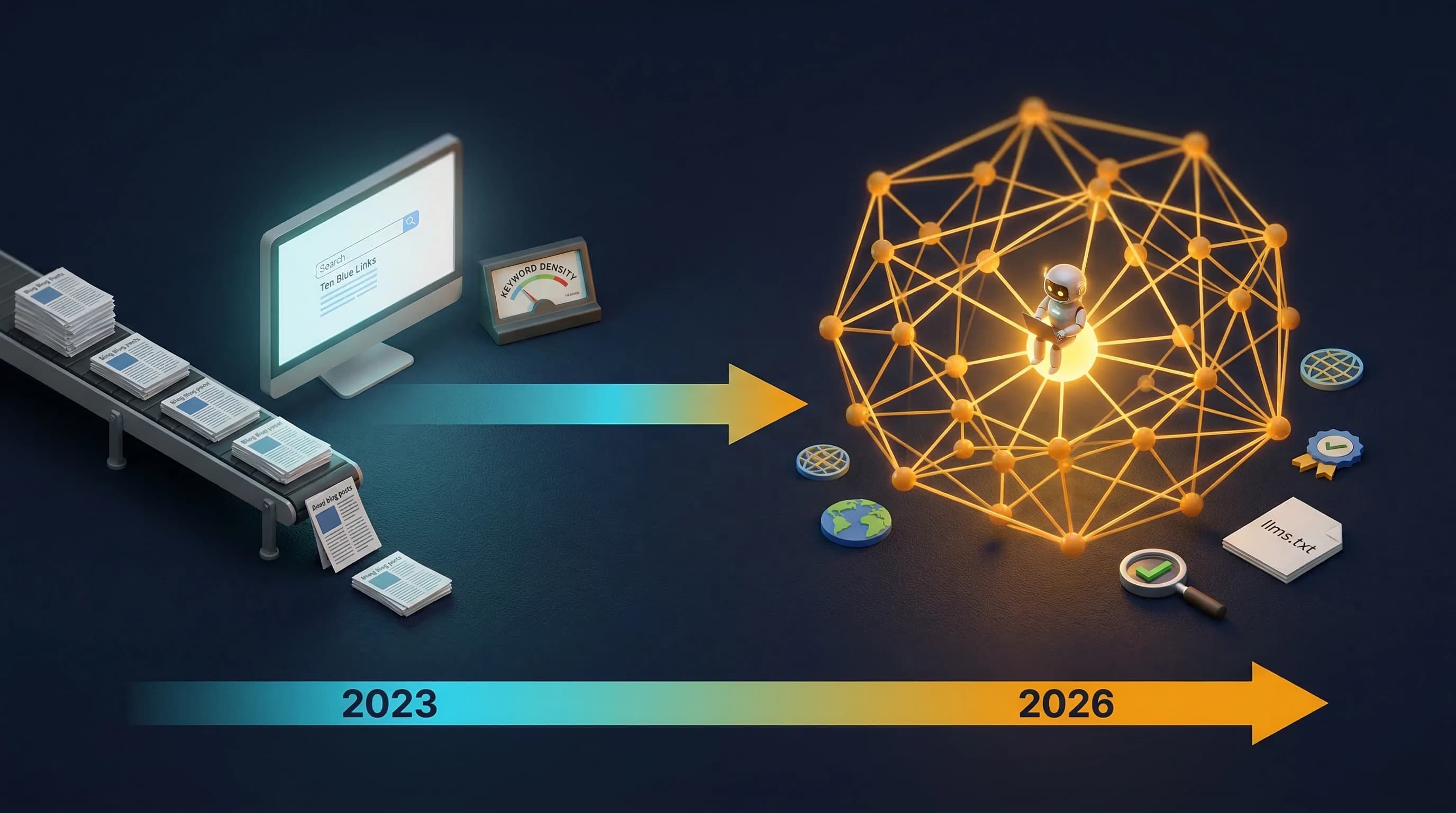

बड़े पैमाने पर SEO और AEO

2026 में SEO सिर्फ Google के बारे में नहीं है। यह इस बारे में है कि जब कोई ऐसा सवाल पूछे जिसका जवाब आपके कंटेंट में है, तो ChatGPT, Perplexity, और Claude आपको साइट करें।

मैंने एक ही वीकेंड में पूरा SEO/AEO स्टैक इम्प्लीमेंट किया:

ट्रेडिशनल सर्च के लिए:

- डायनामिक sitemap (639 पेज इंडेक्स)

- Structured data — Person, WebSite, Article, BreadcrumbList, FAQPage schemas

- सिंडिकेशन के लिए RSS feed

- Google Search Console वेरिफ़ाइड

AI इंजन्स (AEO/GEO) के लिए:

llms.txt— AI क्रॉलर्स के लिए प्रायोरिटी कंटेंट गाइड (GPTBot, Claude-Web, PerplexityBot सभीrobots.txtमें अलाउड)- हर सेक्शन की शुरुआत में Answer-first पैटर्न (पहले 150 शब्दों में बोल्ड key statement)

- Question-format H2s जो लोगों के AI असिस्टेंट से पूछने के तरीके से मिलते हैं

- FAQ सेक्शन्स ऑटो-डिटेक्ट और FAQPage schema के रूप में रेंडर

परफ़ॉर्मेंस के लिए:

मैंने Chrome DevTools MCP का उपयोग करके विभिन्न पेज टाइप्स को प्रोफ़ाइल किया — होमपेज, ब्लॉग लिस्टिंग, इंडिविजुअल पोस्ट्स, /ask पेज — और बॉटलनेक्स पहचाने। एक ही Claude Code सेशन में परफ़ॉर्मेंस ट्रेस रन करना, रिज़ल्ट्स एनालाइज़ करना, और इश्यू फ़िक्स करना... अविश्वसनीय रूप से कुशल है।

नतीजा? मेरे द्वारा लिखी गई हर नई पोस्ट को ऑटोमैटिकली structured data, FAQ schema (अगर इसमें FAQ सेक्शन है), और AI extraction के लिए फ़ॉर्मेटिंग मिलती है। कोई प्लगइन नहीं। कोई मैन्युअल कॉन्फ़िगरेशन नहीं। बस ऐसे ही साइट काम करती है अब।

Beehiiv बाहर, नेटिव न्यूज़लेटर अंदर

यह मुझे भी चौंका गया। Beehiiv पर मेरा न्यूज़लेटर काम कर रहा था। यह ईमेल कलेक्ट करता था। अपडेट भेजता था। फिर इसे बदलने की क्या ज़रूरत?

तीन कारण:

- कंट्रोल — मुझे इंटरेस्ट-बेस्ड सब्सक्रिप्शन चाहिए थे। "AI & Technology" सब्सक्राइबर्स को नेशनल पार्क्स कंटेंट नहीं मिलना चाहिए। Beehiiv के फ्री टियर में यह सपोर्ट नहीं था।

- इंटीग्रेशन — मेरा सब्सक्राइबर डेटा अब उसी Supabase डेटाबेस में है जहाँ Sydney का सर्च इंडेक्स है। एक सोर्स ऑफ़ ट्रुथ।

- कॉस्ट — Supabase (फ्री टियर) + Resend (कम वॉल्यूम के लिए फ्री टियर) = $0/महीना।

जो सिस्टम मैंने बनाया:

- डबल ऑप्ट-इन — सब्सक्राइब → वेरिफ़िकेशन ईमेल → कन्फ़र्म → पर्सनलाइज़्ड रेकमेंडेशन्स के साथ वेलकम ईमेल

- 5 इंटरेस्ट ग्रुप्स — AI, Expat Life, Leadership, Marketing, Travel & National Parks

- स्मार्ट मैचिंग — पोस्ट कैटेगरीज़ ऑटो-मैप होती हैं सब्सक्राइबर इंटरेस्ट्स से। जब मैं क्रेडिट कार्ड गाइड पब्लिश करता हूँ, सिर्फ "Expat Life" सब्सक्राइबर्स को नोटिफ़ाई किया जाता है।

- डेली cron — Vercel हर दिन 11 AM PST पर एक जॉब चलाता है, पिछले 48 घंटों की पोस्ट्स ढूँढता है, टार्गेटेड नोटिफ़िकेशन्स भेजता है

- डीडुप्लिकेशन —

notification_logटेबल डुप्लिकेट ईमेल्स रोकती है, हमेशा

सबसे अच्छी बात? हर ब्लॉग पोस्ट के नीचे सब्सक्राइब फ़ॉर्म पोस्ट की कैटेगरी के आधार पर रेलेवेंट इंटरेस्ट ऑटो-सेलेक्ट करता है। AI आर्टिकल पढ़ रहे हैं? जब आप सब्सक्राइब करने के लिए नीचे स्क्रॉल करते हैं तो "AI & Technology" पिल पहले से सेलेक्ट होता है।

स्क्रैच से यह सब बनाना बहुत काम लगता है। यह एक शाम की फ़ोकस्ड मेहनत थी। Supabase माइग्रेशन, API routes, ईमेल टेम्प्लेट्स, और cron job — Claude Code ने scaffolding संभाली जबकि मैंने लॉजिक और कॉपी पर ध्यान दिया।

सिक्योरिटी: अदृश्य जब तक ज़रूरत न हो

पब्लिक-फ़ेसिंग AI चैटबॉट और न्यूज़लेटर साइनअप के साथ, मेरे पास दो एंडपॉइंट्स थे जिनका बॉट्स दुरुपयोग करना पसंद करते हैं। Rate limiting पहले से थी (Upstash Redis, 5 रिक्वेस्ट प्रति मिनट), लेकिन मुझे दूसरी लेयर चाहिए थी।

Cloudflare Turnstile — एक अदृश्य CAPTCHA जो सिर्फ संदिग्ध गतिविधि पर चैलेंज दिखाती है। 99% असली विज़िटर्स के लिए, यह पूरी तरह अदृश्य है। बॉट्स के लिए? यह एक दीवार है।

मैंने इसे पहले /ask एंडपॉइंट (Sydney chat) में जोड़ा, फिर वही पैटर्न /api/subscribe के लिए रीयूज़ किया। वही वेरिफ़िकेशन लाइब्रेरी, वही graceful degradation:

- एनवायरनमेंट वेरिएबल्स कॉन्फ़िगर नहीं → बायपास (लोकल डेवलपमेंट बिना इसके काम करता है)

- Cloudflare API डाउन → fail-open (rate limiter फ़ॉलबैक है)

- टोकन मिसिंग लेकिन secret key सेट है → रिजेक्ट (फ्रंटएंड बायपास करने वाले बॉट्स पकड़ता है)

रीयूज़ ही इसे चक्रवृद्धि कहानी बनाता है। न्यूज़लेटर के लिए Turnstile इंटीग्रेशन मिनटों में हुआ, घंटों में नहीं, क्योंकि Sydney से इन्फ्रास्ट्रक्चर पहले से तैयार था।

चक्रवृद्धि प्रभाव

यहाँ वो है जो मैंने प्लान नहीं किया लेकिन नैचुरली हुआ:

Next.js पर माइग्रेशन (1-5 फरवरी)

└─→ MDX फ़ाइलें Claude Code को बड़े पैमाने पर कंटेंट पढ़ने/मॉडिफ़ाई करने देती हैं

└─→ SEO/AEO ऑप्टिमाइज़ेशन के साथ 6 मेगा गाइड लिखी गईं (6-11 फरवरी)

└─→ नए कंटेंट ने Sydney की सर्च क्वालिटी की कमियाँ उजागर कीं

└─→ RAG eval फ्रेमवर्क बना, Sydney ऑप्टिमाइज़ हुई (11 फरवरी)

└─→ ज़्यादा कंटेंट के लिए न्यूज़लेटर चाहिए (Beehiiv नहीं)

└─→ Supabase पर नेटिव न्यूज़लेटर बना (12 फरवरी)

└─→ पब्लिक एंडपॉइंट्स को बॉट प्रोटेक्शन चाहिए

└─→ Sydney + subscribe में Turnstile जोड़ा (12-13 फरवरी)

इनमें से कोई भी एक क्रम के रूप में प्लान नहीं किया गया था। हर एक ने अगली ज़रूरत उजागर की। माइग्रेशन ने कंटेंट क्रिएशन तेज़ किया। तेज़ कंटेंट क्रिएशन ने सर्च क्वालिटी की कमियाँ उजागर कीं। सर्च ठीक करने से मुझे बेहतर डिस्ट्रीब्यूशन की इच्छा हुई। बेहतर डिस्ट्रीब्यूशन को प्रोटेक्शन चाहिए था।

यही चक्रवृद्धि है। हर सुधार सिर्फ वैल्यू नहीं जोड़ता — यह पहले आए हर सुधार की वैल्यू को गुणा करता है। :)

और इस सबमें एक कॉमन थ्रेड? मेरी साइट का हर हिस्सा अब कोड है जिसे प्रोग्रामेटिकली पढ़ा, टेस्ट किया और मॉडिफ़ाई किया जा सकता है। यही असली अनलॉक है।

आँकड़े

क्योंकि मुझे पता है आप जानना चाहते हैं:

| मेट्रिक | वैल्यू |

|---|---|

| माइग्रेशन के बाद के दिन | 8 |

| नई ब्लॉग पोस्ट्स | 7 (इसे मिलाकर) |

| शिप किए गए नए फ़ीचर्स | 6 (न्यूज़लेटर, Turnstile ×2, RAG eval, SEO स्टैक, PhotoGallery) |

| अपडेट की गई ब्लॉग पोस्ट्स | 12+ (क्रॉस-लिंकिंग, टूटे लिंक फ़िक्स) |

| जोड़ी गई कोड लाइन्स | ~5,600 |

| जोड़ी गई डेटाबेस टेबल्स | 2 (subscribers, notification_log) |

| जोड़े गए API एंडपॉइंट्स | 4 (subscribe, verify, unsubscribe, cron) |

| कॉस्ट में बढ़ोतरी | $0/महीना (सब फ्री टियर) |

आगे क्या

मैं अभी रुका नहीं हूँ। चक्रवृद्धि रुकी नहीं है:

- और एक्सपैट गाइड्स — टैक्स स्ट्रैटेजी, वीज़ा टाइमलाइन्स, बैंकिंग कम्पेरिज़न। सीरीज़ में दम है।

- Sydney और स्मार्ट हो रही है — अब जब मैं क्वालिटी माप सकता हूँ, मैं hit rate को 90% से ऊपर ले जाना चाहता हूँ।

- AI के साथ बिल्डिंग पर और डीप डाइव्स — टूल्स हर हफ़्ते बदल रहे हैं। मैं चलते-चलते डॉक्यूमेंट कर रहा हूँ। (नवीनतम: बिना Swift जाने नेटिव iOS ऐप बनाना और यह खोजना कि AI आपको 60% तक ले जाता है — आखिरी 40% वहीं है जहाँ प्रोडक्ट असल में रहता है।)

लेकिन सच कहूँ? मैं बस लिखते रहने को लेकर उत्साहित हूँ। ब्लॉगिंग के 17 सालों में पहली बार, नई पोस्ट पब्लिश करना सच में मज़ेदार है — WordPress की 45-मिनट की मशक्कत नहीं। :D

क्या आपने किसी माइग्रेशन या बड़े टेक्निकल फ़ैसले के बाद इस तरह का चक्रवृद्धि प्रभाव अनुभव किया है? मुझे जानने की उत्सुकता है — पहला अप्रत्याशित अनलॉक कौन सा था जिसने आपको चौंकाया?

शुभकामनाओं सहित,

Chandler

अक्सर पूछे जाने वाले प्रश्न

वेबसाइट डेवलपमेंट में चक्रवृद्धि प्रभाव क्या है?

चक्रवृद्धि प्रभाव तब होता है जब आपकी साइट में हर सुधार अगले सुधार को तेज़ और आसान बना देता है। उदाहरण के लिए, कोड-बेस्ड स्टैक पर माइग्रेट करने से AI-असिस्टेड कंटेंट क्रिएशन संभव हुई, जिसने सर्च क्वालिटी की समस्याएँ उजागर कीं, जिससे इवैल्यूएशन फ्रेमवर्क बनाने की ज़रूरत पड़ी। हर कदम पिछले पर बना।

AI सर्च इंजन्स के लिए ब्लॉग पोस्ट्स कैसे ऑप्टिमाइज़ करें?

AI सर्च इंजन्स स्ट्रक्चर्ड, answer-first कंटेंट पसंद करते हैं जिसमें स्पष्ट हेडिंग्स और संक्षिप्त सेक्शन्स हों। मुख्य तकनीकें: पहले 150 शब्दों में बोल्ड डेफ़िनिशनल स्टेटमेंट्स, question-format H2 हेडिंग्स, कम्पेरिज़न टेबल्स, 120-180 शब्दों के सेक्शन, और FAQ schemas। ये पैटर्न AI साइटेशन में 340% तक की वृद्धि देते हैं।

RAG इवैल्यूएशन फ्रेमवर्क क्या है?

RAG इवैल्यूएशन फ्रेमवर्क टेस्ट करता है कि आपका AI असिस्टेंट कितनी अच्छी तरह प्रासंगिक कंटेंट ढूँढता और दिखाता है। यह पूर्वनिर्धारित क्वेरीज़ का उपयोग करता है जिनके expected results (ground truth) होते हैं और hit rate, precision, और temporal diversity जैसी मेट्रिक्स मापता है। इससे आप अनुमान लगाने के बजाय व्यवस्थित रूप से अपनी सर्च सेटिंग्स ऑप्टिमाइज़ कर सकते हैं।

Beehiiv की जगह कस्टम न्यूज़लेटर सिस्टम क्यों?

कस्टम न्यूज़लेटर सिस्टम आपको सब्सक्राइबर डेटा, इंटरेस्ट-बेस्ड टार्गेटिंग, और मौजूदा डेटाबेस के साथ इंटीग्रेशन पर पूरा कंट्रोल देता है। Supabase + Resend पर बिल्ड करके, मुझे इंटरेस्ट-बेस्ड सब्सक्रिप्शन, ऑटोमेटेड नोटिफ़िकेशन्स, और $0/महीना होस्टिंग मिली — सब Sydney के सर्च इंडेक्स के साथ इंटीग्रेटेड।

Cloudflare Turnstile ट्रेडिशनल CAPTCHAs से कैसे अलग है?

Cloudflare Turnstile एक अदृश्य बॉट डिटेक्शन सिस्टम है जो सिर्फ संदिग्ध विज़िटर्स को चैलेंज दिखाता है। ट्रेडिशनल CAPTCHAs के विपरीत जो हर यूज़र से पज़ल सॉल्व कराते हैं, Turnstile लेजिटिमेट यूज़र्स के लिए चुपचाप चलता है। यह यूज़र एक्सपीरियंस को बाधित किए बिना बॉट्स का पता लगाने के लिए ब्राउज़र सिग्नल्स का उपयोग करता है।

अभी भी कोड कर रहा हूँ, अभी भी सीख रहा हूँ, अभी भी चक्रवृद्धि ब्याज को बढ़ते देख रहा हूँ।