EUA ou China: quem está liderando na pesquisa de IA?

Duas grandes análises chegaram a conclusões opostas sobre a liderança em IA entre EUA e China — mas mediram coisas completamente diferentes. Aqui está o porquê de ambas poderem estar certas.

Recentemente me deparei com dois artigos com manchetes e conclusões muito diferentes:

- China ultrapassa EUA em volume e qualidade de pesquisa em IA. Foi escrito por Kotaro Fukuoka, Shunsuke Tabeta e Akira Okikawa, jornalistas do Nikkei.

- Leitura obrigatória: os 100 artigos de IA mais citados em 2022 da Zeta Alpha. O artigo escreveu "Quando olhamos de onde vêm esses artigos mais citados (Figura 1), vemos que os Estados Unidos continuam dominando e a diferença entre as grandes potências varia apenas ligeiramente por ano."

- Uma das conclusões deste artigo é que "Relatórios anteriores (link para o artigo do Nikkei) de que a China pode ter ultrapassado os EUA em P&D de IA parecem ser muito exagerados se olharmos pelo prisma das citações."

Naturalmente, isso me deixou curioso porque o Nikkei é uma organização de notícias respeitável, e o Japão é um aliado militar dos EUA. Em outras palavras, o Nikkei tem pouco incentivo para "distorcer" a verdade em favor da China. Então decidi investigar mais fundo.

Bem, como se descobriu, não precisei ir tão fundo para perceber que os dois poderiam estar certos ao mesmo tempo porque usaram metodologias diferentes para chegar às suas conclusões. Dado que a Zeta Alpha publicou seu artigo depois e citou o artigo do Nikkei, a Zeta Alpha deveria ter destacado as diferenças em suas metodologias diretamente no artigo e deixado os leitores decidir por si mesmos.

Metodologias diferentes

Metodologia do Nikkei

Metodologia da Zeta Alpha

O Nikkei trabalhou com a editora científica holandesa Elsevier para revisar artigos acadêmicos e de conferências sobre IA, usando cerca de 800 palavras-chave associadas à IA para restringir os artigos.

Para criar a análise acima, primeiro coletamos os artigos mais citados por ano na plataforma Zeta Alpha e depois verificamos manualmente a data de primeira publicação para colocar os artigos no ano correto.

Complementamos essa lista minerando artigos de IA altamente citados no Semantic Scholar com sua cobertura mais ampla e capacidade de classificar por contagem de citações. Em seguida, pegamos para cada artigo o número de citações no Google Scholar como métrica representativa e classificamos os artigos por esse número para obter o top 100 de um ano.

Olhando para a quantidade, o número de artigos de IA explodiu de cerca de 25.000 em 2012 para aproximadamente 135.000 em 2021.

O artigo da Zeta Alpha foca apenas nos top 100 artigos de cada ano

Tanto o Nikkei quanto a Zeta Alpha usam citações como indicação de qualidade do artigo.

Mas a primeira grande diferença é que o Nikkei analisa um número muito maior de artigos de IA do que a Zeta Alpha para chegar à sua conclusão. Quando o Nikkei escreveu, "Em 2021, a China respondeu por 7.401 dos artigos mais citados, superando o total americano em cerca de 70%.", eles se referiam ao top 10% dos artigos, ou seja, um universo de 13.500 artigos em 2021 (os 10% mais citados de aproximadamente 135.000 artigos de IA em 2021).

Toda a análise da Zeta Alpha em seu artigo é sobre os 100 artigos mais citados de cada ano apenas.

Então não é uma comparação de maçãs com maçãs de jeito nenhum.

Qual método é melhor, entre Nikkei e Zeta Alpha?

Não tenho um histórico profundo na área de IA, então não posso dizer com confiança qual metodologia é melhor. Sei que são diferentes.

Se você quiser responder a essa pergunta, acho que precisa:

- Primeiro, definir quais critérios você está usando para avaliar "melhor"?

- Cobrir um número maior de artigos significa que seu tamanho de amostra é muito maior e cobre muito mais áreas de nicho dentro da IA.

- Focar nos 100 principais artigos pode fazer sentido se acharmos que a maior parte do valor comercial ou estratégico acumulará aos poucos artigos/proprietários mais importantes ao longo do tempo. Mas duvido que a Zeta Alpha tenha feito essa análise.

- Segundo, encontrar uma forma melhor de quantificar o valor ou impacto de cada artigo em vez de apenas usar citações. Sei que usar citações é uma forma rudimentar de avaliar qualidade, mas é a melhor forma?

- Terceiro, qual é a relação entre a capacidade de IA de um país e a porcentagem de seus artigos publicados entre os top 100 ou top 1000 artigos mais citados em um determinado ano?

- Por exemplo, tenho certeza de que algumas das pesquisas de ponta com valor militar e comercial elevado, alguns laboratórios de pesquisa optam por não publicá-las. Porque por que publicá-las para que outros aprendam e ajudem a concorrência a fechar a diferença?

- Posso continuar, mas espero que você entenda meu ponto

Algumas conclusões/manchetes questionáveis

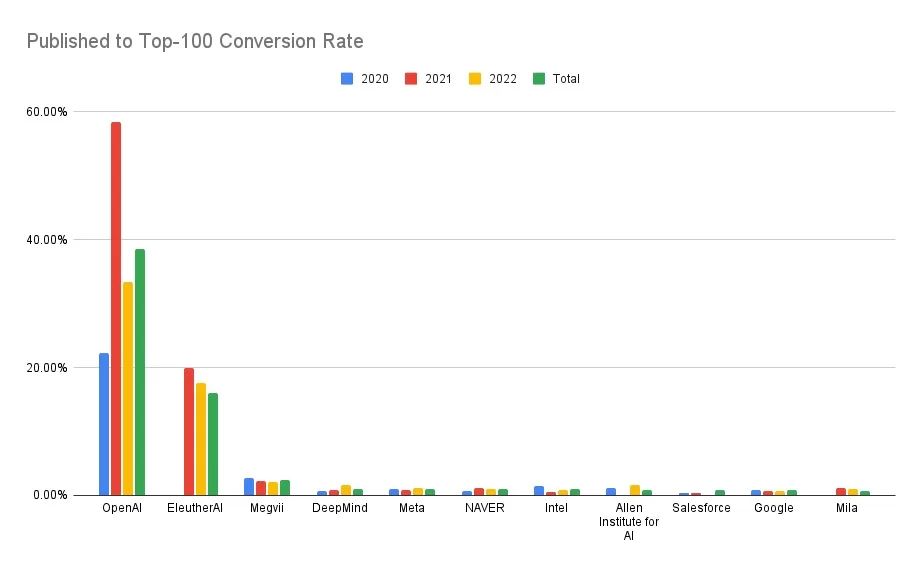

A OpenAI está simplesmente em uma liga própria quando se trata de transformar publicações em blockbusters absolutos

A Zeta Alpha escreveu que "Você não verá a OpenAI ou DeepMind entre as 20 primeiras em volume de publicações. Essas instituições publicam menos, mas com maior impacto." e "Agora vemos que a OpenAI está simplesmente em uma liga própria quando se trata de transformar publicações em blockbusters absolutos."

Por que essa "taxa de conversão" é importante de se olhar? O que isso significa? Uma forma simples de interpretar os dados é:

- A pesquisa da OpenAI se concentra em um campo muito estreito de IA, e eles optam por publicar um número muito limitado de artigos.

- Google ou Meta e outras empresas têm um interesse amplo em IA e estão simultaneamente pesquisando muitas áreas diferentes. E optam por publicar mais.

- Isso não tem nada a ver com a OpenAI ser boa em transformar publicações em blockbusters.

Qual forma de trabalhar é melhor? Não tenho certeza

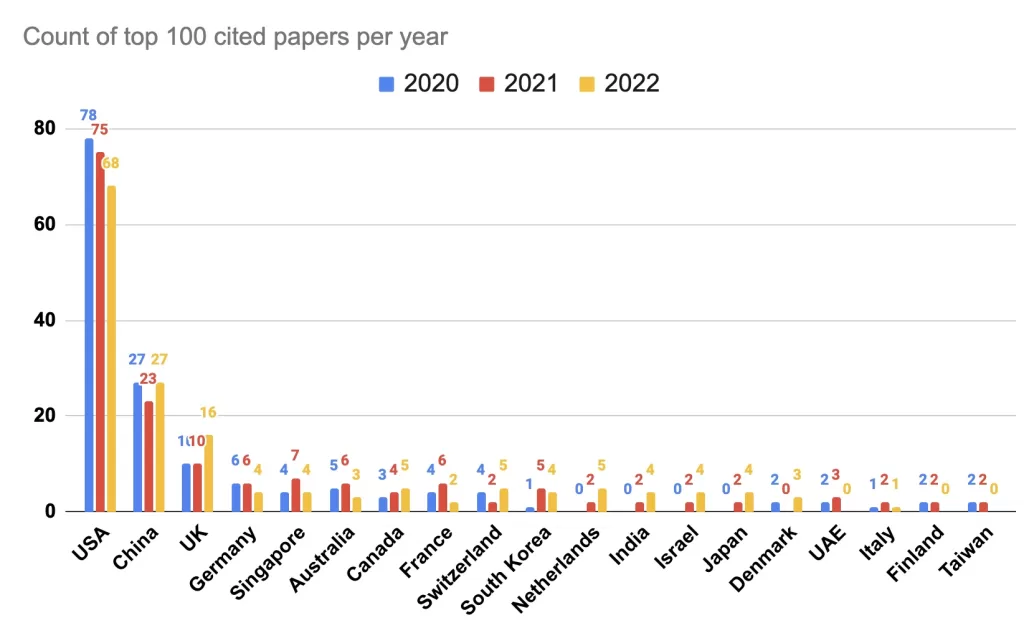

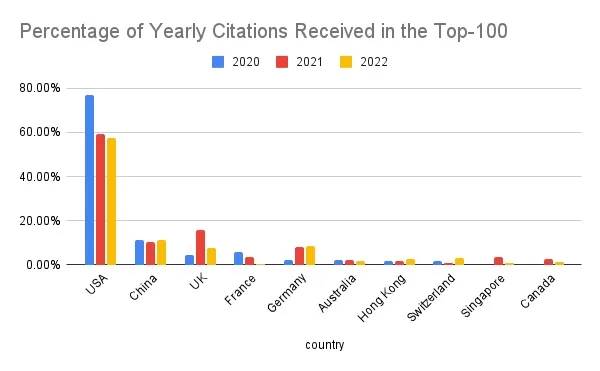

Os EUA dominam artigos de pesquisa em IA

Essa conclusão é baseada nos dois principais pontos de dados abaixo

Como mencionado acima, embora eu concorde que ter uma forte presença nos top 100 (ou 1000 ou qualquer número) artigos de IA mais citados seja um sinal sobre a força de um país em IA, não acho que deva ser o ÚNICO sinal. Deveria haver um conjunto de pontos de dados ou sinais para derivar essa conclusão.

Também por que top 100 e não top 1000? Será que é porque a metodologia da Zeta Alpha envolve verificação manual e só conseguem cobrir os top 100?

Conclusão

Mais um exemplo de como a situação real é muito mais matizada do que algumas manchetes indicam. Então, embora aprecie o esforço para simplificar a história para o público, não devemos tentar "simplificar demais." :)

O que você acha que é uma forma melhor de medir a capacidade de IA de um país? O número de artigos mais citados é suficiente, ou devemos olhar para um conjunto mais amplo de sinais? Adoraria ouvir seus pensamentos.

Abraços,

Chandler