Tinatanggal Ko na ang $200 Claude Code Plan Ko Matapos ang Dalawang Linggo sa Codex

Dalawang linggo matapos ang unang paghahambing ko, parehong may malalaking update ang dalawang tool. Hinamon ng Codex ang product strategy ko sa paraang hindi nagawa ng Claude Code. Nag-ship naman ang Claude Code ng Agent Teams at AutoMemory. Ang resulta: tinatanggal ko na ang $200/buwan na Max plan ko — at mas maganda pa ang output ko sa mas mababang gastos.

Dalawang linggo ang nakaraan, sumulat ako tungkol sa dual-wielding ng Codex at Claude Code. Mas nag-resonate ang post na iyon kaysa sa kahit anong sinulat ko — marami pala ang gumagawa ng parehong eksperimento.

Noon, malinaw ang working model ko: Claude Code para sa execution quality at QA, Codex para sa architectural reasoning at sustained plans. Parehong tool, magkaibang lakas, cross-model review para sa mahahalagang trabaho.

Dalawang linggo ang lumipas, parehong nag-ship ng malalaking update ang dalawang tool at nagbago na ang balanse. Hindi naman dramatiko — pero sapat nang isulat. (Para sa record, dina-draft ko ang post na ito sa Claude Code — hindi dahil sa loyalty, kundi dahil active pa ang billing cycle ko ngayon at ayaw kong sayangin ang perang naka-commit na. Ang ganitong praktikal na kalkulasyon ang eksaktong punto ng post na ito.)

Intense ang March 2026 para sa parehong platform. Nag-launch ang Codex ng plugins na may integrations para sa Slack, Gmail, Linear, Figma, Sentry, at iba pa — kasama ang Triggers para sa automated GitHub workflows, GPT-5.4 mini at nano models, at Windows native support. Nag-ship naman ang Claude Code ng Agent Teams (multi-agent orchestration, experimental pa), AutoMemory, Computer Use (macOS lang, Pro/Max plans), Scheduled Tasks via /loop, at mga 10 releases sa buong March. Parehong mabilis gumalaw ang dalawang platform.

Ang Newsletter Story (Bakit Hindi Lang Ito Tungkol sa Code)

Ang obserbasyon na nagbago ng pag-iisip ko ay walang kinalaman sa pagsusulat ng code.

May kumpleto akong newsletter system ang site ko — subscribe form, post CTAs, welcome email, daily cron, double opt-in, 13-locale support. Technically, gumagana ang lahat. Ang problema: zero verified subscribers.

Gumawa ako ng plan para ayusin ito: mag-extract ng lead magnet PDF mula sa course ko, i-gate ang Module 1 sa likod ng email, magdagdag ng mid-article CTAs, i-hook ang AI chatbot sa subscribe flow, i-redistribute sa YouTube at LinkedIn. Pitong bagong bagay.

Ginawa ko ang plan na ito sa Claude Code. Pakiramdam ko productive.

Tapos binigyan ko ng parehong brief ang Codex. Agad ang pushback.

Redundant ang lead magnet — libre na ang Module 1. Masyadong maraming surface nang sabay-sabay — kung itatayo mo ang lahat ng pito, hindi mo malalaman kung alin ang gumagana. Hindi infrastructure ang problema, kundi copy. Generic ang "Stay in the loop." Hindi sapat ang persuasion ng verification email. Nagdaragdag ng friction ang interest selection.

Plan ng Codex: ayusin muna ang meron na (rewrite ng copy, pagandahin ang verification email, bawasan ang friction), magdagdag ng isang bagong surface (inline blog CTA), sukatin gamit ang GA events bago pa magtayo ng iba.

Ang plan ko ay "magtayo ng mas maraming bagay." Ang plan ng Codex ay "pagandahin muna ang mga meron na, tapos subukan ang isang bagong bagay." Isang linggo ang aabutin ng plan ko na walang paraan para malaman kung ano ang gumana. Ang plan ng Codex ay puwedeng i-ship sa isang araw at eksaktong sasabihin sa iyo kung saan mag-invest next.

Kailangan kong aminin — hindi ko iyon inaasahan. Hindi dahil hindi magaling ang Claude sa strategy. Sa tingin ko, kung mas maingat akong nag-prompt — "hamunin muna ang mga assumptions ko bago mag-execute" — baka nakakuha din ako ng katulad na pushback. Pero kapansin-pansin na iba ang default reasoning style. Ang default ng GPT-5.4 ay "kwestiyunin ang premise." Ang default ni Claude ay "i-execute nang maayos ang plan."

Mahalaga ang pagkakaibang iyon para sa product decisions.

Bilis at Pag-steer

Dalawang bagay na napansin kong mas malaki ang epekto sa daily workflow kaysa sa inaasahan ko.

Bilis at token efficiency: Ang Codex na may GPT-5.4 sa high thinking ay consistent na mas mabilis kaysa sa Opus 4.6 sa high thinking para sa katulad na tasks. Mga third-party comparisons ang nagpapakita na mga 3x na mas kaunting tokens ang ginagamit ng Codex para sa katulad na trabaho — isang benchmark ang nag-measure ng 1.5 milyong tokens sa isang Figma-style task kung saan 6.2 milyon ang ginamit ni Claude. Mas "nag-iisip nang malakas" si Claude, na nagpo-produce ng mas matataas na kalidad ng reasoning pero mas mabilis maubos ang limits. Simula mga Mar 20, parang mas maraming tool calls ang ginagawa ni Opus kaysa dati — mas maraming intermediate steps bago makarating sa sagot. Hindi ko alam kung model change iyon o coincidence, pero nararamdaman.

Real-time steering: Kapag nagpadala ako ng bagong message habang nagtatrabaho ang tool — "teka, hindi doon, subukan mo ito" — halos agad itong nababasa ng Codex at nag-a-adjust. Madalas tapusin muna ni Claude Code ang kasalukuyang execution bago basahin ang correction.

Mukhang maliit na bagay iyon. Hindi. Kapag pinapanood mong pumunta sa maling direksyon ang isang agent at gusto mong i-correct, ang pagkakaiba ng "binabasa agad ang correction mo" at "binabasa pagkatapos matapos ang kasalukuyang operation" ay tumataas nang tumataas sa buong work session.

Ang SSE Bug: Isang Konkretong Halimbawa

Gumagawa ako ng bagong iOS app. Nag-produce ang Claude Code ng 40 Swift files sa lahat ng features — auth, agents, chat, frameworks, dashboard, profile. Kahanga-hanga ang coverage. Pero may isang kritikal na bug na natitira: hindi gumagana ang SSE streaming para sa real-time chat.

Ayos naman ang backend. Gumagana ang curl. Pero hindi nagfi-fire ang URLSessionDataDelegate.didReceive(data:) sa Swift client. Ilang oras na pinagsikapan ito ng Claude Code. Maraming approach, maraming debugging sessions.

Binigyan ko ng parehong problema ang Codex. Pagkatapos ng ilang attempt: commit 7f592152 — "fix(ios): restore real-time chat streaming."

Representative ba ito? Baka hindi. May magagandang araw at masamang araw ang bawat tool. Pero batay sa karanasan ko, kapag natigil ang Claude Code sa debugging loop — sumusubok ng mas matatalinong variation ng parehong approach — madalas na masirain ang deadlock kapag lumipat sa Codex dahil ibang paraan agad ng pag-frame ng problema ang GPT-5.4 mula sa simula.

Saan Pa Rin Nananalo ang Claude Code

Madaling basahin ang post na ito at mag-conclude na nauunahan na ng Codex sa lahat. Mali iyon. Humusay din ang Claude Code ngayong buwan, at may ilang advantages na lumaki pa nga.

Agent Teams. Inilunsad ito noong February at patuloy na nag-mature sa buong March. Maraming Claude Code instances na sabay-sabay na nagtatrabaho — explorer, code reviewer, implementer, test runner — na may dependency tracking at shared task lists. Experimental pa at naka-disable by default, pero kapag naka-enable, genuinely impressive. May multi-agent support din ang Codex (tumatakbo ang tasks sa isolated cloud containers), pero mas coordinated ang pakiramdam ng Agent Teams ng Claude Code. Para sa malalaking refactors na maraming file ang naaapektuhan, mas maganda ang experience sa Agent Teams sa ngayon.

AutoMemory. Awtomatiko nang nagsusulat ang Claude Code ng memory rules batay sa mga gawi mo. Pagkatapos ng ilang sessions, alam na nito ang project structure mo, naming conventions mo, at mga preference mo. Subtle pero ang cumulative effect ay nagiging mas productive ang Claude Code sessions habang tumatagal — isang bagay na hindi pa ginagawa ng Codex sessions sa ngayon.

Frontend design. Ang Claude Code na may /frontend-design plugin ay consistent na mas polished at mas design-system-aware ang UI kaysa sa Codex na may katumbas na skill. Directly ko itong sinubukan sa isang site redesign noong Mar 26. Mas maganda ang spatial composition, mas consistent ang styling, at mas cohesive ang resulta mula sa Claude. Puwedeng harness advantage ito (mas maraming context ang pinapatupad ng plugin system ni Claude sa skill), pero malinaw ang praktikal na resulta.

Kalidad ng code. Isang community analysis ng 500+ developer comments sa Reddit ang nakahanap na mas ginusto ng mga developer ang output ni Claude Code sa mga 67% ng blind comparisons — na mas malinis, mas idiomatic, at mas maayos ang structure ng code. Tugma iyon sa karanasan ko. Kapag kailangan mong maintainable ang code, hindi lang functional, may edge ang Claude Code.

Awtomatikong QA. Ito pa rin ang killer feature. Pagkatapos matapos ang trabaho, kusang nagdi-dispatch ang Claude Code ng review agents — code review, consistency checks, gap analysis — nang hindi ko sinasabi. Hindi pa ito ginagawa ng Codex. Para sa kahit anong trabaho na mas mahalaga ang correctness kaysa speed, ito lang ang dahilan para manatili ang Claude Code sa workflow.

Ang Tanong Tungkol sa Reliability

May gusto akong i-share na iniiwasan ng karamihan sa mga comparison posts.

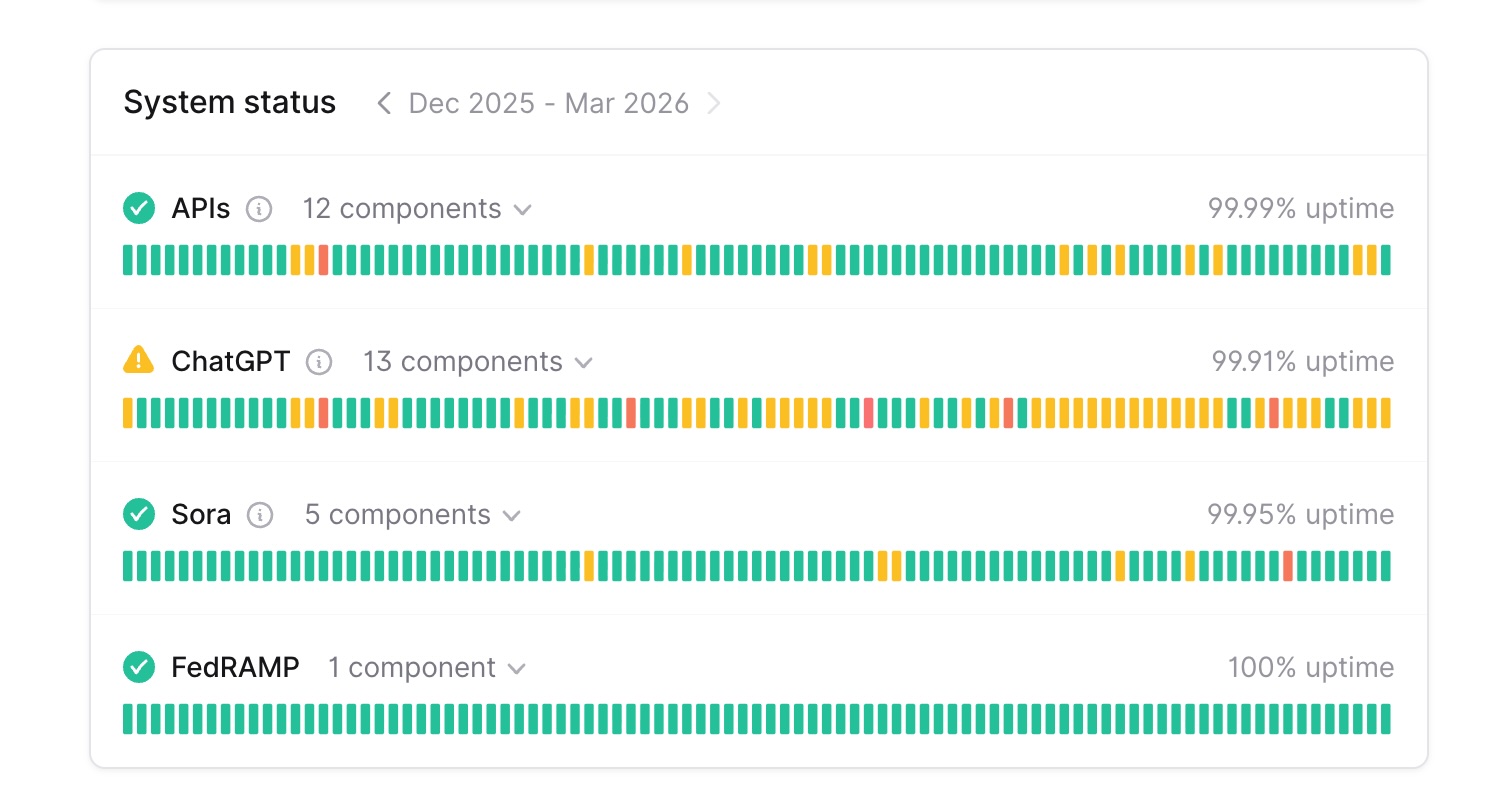

Ito ang 90-day uptime numbers mula sa parehong status pages noong late March 2026:

| Service | Anthropic | OpenAI |

|---|---|---|

| Main platform | claude.ai: 99.16% | ChatGPT: 99.91% |

| API | api.anthropic.com: 99.24% | APIs: 99.99% |

| Developer tools | Claude Code: 99.48% | — |

| Console | platform.claude.com: 99.41% | — |

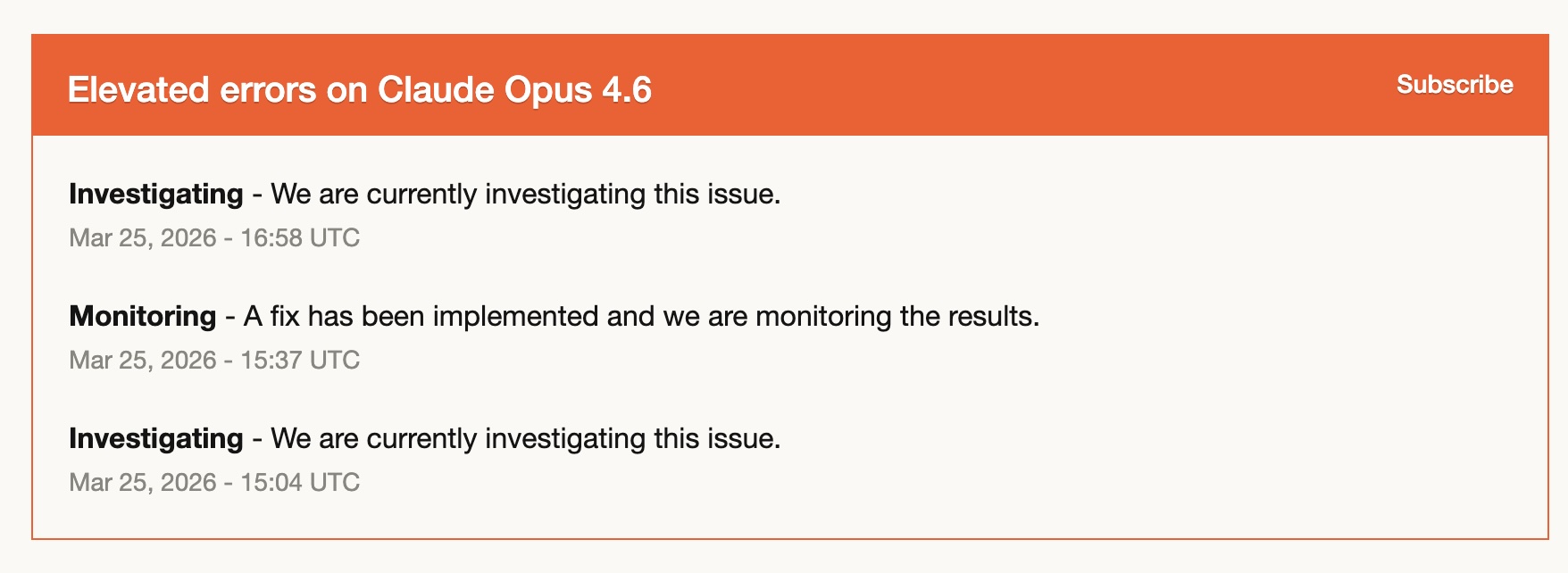

Totoo ang gap. Sa loob ng 90 araw, mga 8-10x na mas maraming downtime ang naranasan ng mga serbisyo ng Anthropic kaysa sa OpenAI. Noong Mar 25, may specific incident — "Elevated errors on Claude Opus 4.6" — na may investigating-fix-investigating cycle na tumagal ng halos dalawang oras.

Sa patas na pagtingin, hindi ito ang buong larawan. Hindi lang uptime ang reliability. Publicly na ibinunyag ng Phantom Labs ng BeyondTrust ang isang command injection vulnerability sa Codex na puwedeng nag-expose ng GitHub authentication tokens sa pamamagitan ng branch name manipulation. Naapektuhan ng flaw ang web UI, CLI, SDK, at IDE integrations — isang user-controllable branch name ang direktang ipinasa sa shell command nang walang sanitization. Na-patch ito ng OpenAI, pero paalala ito na magkaibang dimensyon ng reliability ang stability at security, at pareho silang mahalaga.

Ini-share ko ang uptime data hindi para bastusin ang Anthropic. Ginagamit ko ang Claude Code araw-araw at nananatili itong excellent. Pero para sa sinumang nagtatayo ng professional workflow sa paligid ng mga tool na ito, dapat malaman ang mga numero. At ito ang eksaktong dahilan kung bakit hindi lang "nice to have" ang dual-wielding — kapag masamang hapon ang isang service, lilipat ka at magpapatuloy sa trabaho. Tatlong beses ko itong ginawa sa dalawang linggo.

Nagsasara na ang Plugin Gap

Sa unang post ko, sinabi kong mas mature ang plugin ecosystem ng Claude Code. Totoo iyon dalawang linggo ang nakaraan. Hindi na gaanong totoo ngayon.

Nag-launch ang Codex ng plugin system nito noong Mar 27 na may integrations para sa Slack, Gmail, Google Drive, Linear, Figma, Sentry, Notion, at Hugging Face. Kasama na rin ang skills, hooks (kabilang ang SessionStart at UserPromptSubmit events), MCP servers, at plugin directory sa parehong app at CLI.

Nagco-converge na ang feature set. Pareho na silang may: plugins/skills para sa reusable workflows, hooks para sa event-driven automation, MCP server integration, at app-level integrations sa mga external services.

Kung saan pa rin nangunguna ang Claude Code: mas malalim ang existing plugin ecosystem. Mga plugins gaya ng Superpowers (structured planning), /feature-dev (guided development), at /frontend-design ay nirefined na sa loob ng ilang buwan. Mas bago ang plugin directory ng Codex at hindi pa gaanong battle-tested ang mga individual plugins.

Kung saan nauuna na ang Codex: Triggers. Puwedeng auto-respond ang Codex sa GitHub events — may dumating na issue, auto-fix ng Codex, mag-open ng PR. Bagong category iyon ng automation na hindi pa offered ni Claude Code. Para sa mga team na gusto ng autonomous engineering workflows, malaking differentiator ang Triggers.

Ang Na-update Kong Working Model

Dalawang linggo ang nakaraan, halos 60/40 Claude Code/Codex ang hatian ng trabaho ko. Malinaw ang mental model ko: abutin ang Claude Code kapag kailangan ng quality, abutin ang Codex kapag kailangan ng architectural reasoning.

Nawala na ang maayos na hatian na iyon. Pareho ko na silang ginagamit sa buong araw, nagpapalit-palit batay sa pakiramdam higit sa mga rules. Codex para sa isang task, Claude Code para sa susunod, minsan pareho ang nagrereview ng iisang plan. Malapit na sa isa't isa ang capability ng mga tool kaya hindi na gaanong mahalaga ang tanong na "alin ang dapat kong gamitin dito?" kaysa dalawang linggo ang nakaraan.

Ang nagbago ay ang economics.

$20/buwan lang ang Plus plan ng OpenAI na may lumalaki na mga limits. Mas madalas na akong umabot sa Codex — hindi dahil dramatically na mas magaling sa kahit anong bagay, kundi dahil ang kombinasyon ng bilis, token efficiency, at ang $20 na presyo ay nagtanggal ng friction. Wala nang mental calculation na "sulit ba sa Claude Code tokens ang task na ito?"

Papunta na ako sa pagbaba ng Claude Code plan ko mula sa $200/buwan na Max tier papunta sa $100/buwan na plan, posible pa ngang $20/buwan na Pro plan. Dalawang linggo ang nakaraan, pakiramdam risky iyon. Ngayon, pakiramdam praktikal. Ang trabahong kailangan kong maging excellent ang Claude Code — frontend design, Agent Teams orchestration, ang automatic QA na nakakahuli ng mga hindi ko makikita — totoong advantages iyon. Pero baka hindi kailangan ng $200/buwan kung hawak na ng Codex ang kalahati ng workload ko sa $20.

Alam kong may risks ang bet na ito. May tunay na usage limits ang $20 Claude Code tier — kapag tinamaan ko ang mga iyon habang nasa kritikal na session, pagsisisihan ko ang downgrade. At malamang na market-share play ng OpenAI ang generous $20 limits na puwedeng hindi magtagal. Pero sa ngayon, pabor sa dual-wielding ang economics.

Ang kabuuang gastos ($20 Codex + $100 o kahit $20 Claude Code) ay mas mababa pa sa binabayaran ko para sa Claude Code lang. At mas maganda ang combined output kaysa sa alinmang tool na mag-isa sa kahit anong presyo.

Iyan marahil ang pinakapraktikal na takeaway mula sa dalawang linggo ng dual-wielding: hindi lang pinapaganda ng kompetisyon ang mga tool. Pinapamura din nito ang mga ito. At kapag mas mura, kaya mong bayaran ang dalawa.

Ano ang Inaasahan Kong Susunod

Parehong pabilis nang pabilis ang dalawang platform. Kaka-launch lang ng Codex ng plugins, triggers, at Windows client. Kaka-ship lang ni Claude Code ng Agent Teams, AutoMemory, Computer Use, at Scheduled Tasks. Walang tumitigil sa dalawa.

Isang paulit-ulit na tema sa mga developer communities sa Reddit — at sa tingin ko may katotohanan — ay "mas mataas ang quality ng Claude Code pero naabot mo ang limits. Medyo mas mababa ang quality ng Codex pero mas magamit araw-araw." Nagbabago ang balanse habang pareho silang gumaganda.

Pareho pa rin ang payo ko sa unang post, pero mas malakas na ngayon: subukan ang kabila sa loob ng isang linggo. Hindi para lumipat — para magdagdag. Ang cross-model review workflow ang pinakamahusay na discovery ko pa rin. At ang operational resilience ng pagkakaroon ng dalawang tool na pinagkakatiwalaan mo ay magliligtas sa iyo sa araw na mag-down ang isa sa kanila.

Bilang isang user, ito ang pinakamagandang posibleng sitwasyon. Dalawang excellent na tool na mabilis na gumaganda, itinutulak ng bawat isa ang kabila pasulong. Napakabilis ng kompetisyon kaya hindi ko iniisip na komportableng mauuna ang kahit sinong kumpanya nang matagal — kaya nga pakiramdam ko pataas ang risk ng tumaya sa isang tool lang at pataas ang tama ng tumaya sa workflow (dual-wielding, cross-model review).

Mga Madalas Itanong

Nagbago ba ang opinyon mo mula noong unang post?

Ang pangunahing thesis — mas maganda ang dual-wielding kaysa pumili ng isa — ay lalo lang tumibay. Ang nagbago ay ang hatian (60/40 naging 50/50) at ang mga dahilan. Mas nagulat ako sa lakas ng Codex sa strategic reasoning kaysa sa mga coding improvements nito.

Mas mabilis ba ang Codex kaysa sa Claude Code?

Sa high thinking, oo — consistent na mas mabilis, at mga 3x na mas kaunting tokens ang ginagamit batay sa third-party comparisons para sa katulad na tasks. Sa default thinking, mas maliit ang gap. Para sa iterative work na madalas kang magpalitan, sumasama-sama ang bilis at token efficiency.

Dapat ba akong mag-alala sa uptime ng Claude Code?

May tunay na gap sa 90-day numbers (99.2% vs 99.9%). Kung Claude Code lang ang tool mo at may deadline ka, magkaroon ng backup plan. Pero mga 10 Claude Code releases ang nai-ship ng Anthropic sa March lang — mabilis sila mag-iterate sa features kahit nahuhuli sa reliability ang OpenAI.

Paano naman ang Codex security vulnerability?

Isang command injection flaw sa Codex ang puwedeng nag-expose ng GitHub tokens sa pamamagitan ng branch names. Natuklasan at naayos na ito. Dapat malaman, pero worth noting din na actively tinetesting ng security researchers ang mga tool na ito — na magandang bagay para sa ecosystem.

Tungkol ba talaga sa mga tool ang newsletter strategy story?

Bahagya. Magkaiba ang default reasoning styles ng iba't ibang models. Mas malamang na hamunin ng GPT-5.4 ang mga assumptions ko. Mas malamang na tulungan ni Claude na i-execute nang maayos ang plan ko. Pareho silang kapaki-pakinabang — pero para sa product strategy, madalas na mas valuable ang "tinatackle mo ba ang tamang problema?" kaysa "ito ang magandang implementation."

Aling tool ang dapat kong bilhin?

Pareho. Hindi iyon cop-out — totoong ito ang pinakamahusay na sagot. Codex sa $20/buwan plus Claude Code sa $20-100/buwan ay mas maganda ang resulta kaysa sa alinmang tool na mag-isa sa kahit anong presyo. Papunta na akong bumaba mula $200/buwan sa Claude Code papunta sa $100 o kahit $20, at dagdagan ng Codex sa $20. Bumababa ang kabuuang gastos at tumataas ang output. Sinabi ko lang, puwedeng hindi magtagal ang generous limits ng OpenAI — kaya manatiling flexible.

Iyan na muna. Kung gumagawa ka rin ng sarili mong dual-wielding experiment, gusto ko talagang marinig kung paano nagbabago ang hatian mo. Pareho bang patterns, o ibang-iba?

Cheers, Chandler