Phản ứng về bài "Bing AI Can't Be Trusted"

Tôi đã kiểm chứng lại các tuyên bố rằng Bing AI bịa đặt dữ liệu tài chính — hóa ra vấn đề bịa số liệu là có thật và tệ hơn tôi mong đợi.

Bài viết này được viết năm 2023. Một số chi tiết có thể đã thay đổi.

Hôm nay tôi tình cờ đọc bài viết Bing AI can't be trusted, và tất nhiên, nó khiến tôi tò mò. Đây là một bài viết hay với đầy đủ kiểm chứng thực tế để cho thấy rằng Bing chat mới chứa rất nhiều thông tin bịa đặt về dữ liệu thực tế. Bài viết khá ngắn, nên bạn hãy đọc thử.

Vài phản ứng nhanh từ tôi:

Vừa ngạc nhiên vừa không ngạc nhiên

Tôi nhìn chung đã biết về những hạn chế của mô hình ngôn ngữ lớn (LLM) mà ChatGPT là một trong số đó. Ba hạn chế chính là:

- Nó không lập chỉ mục web ngoài dữ liệu văn bản (như video, âm thanh, hình ảnh, v.v...)

- Bộ dữ liệu ChatGPT rất cũ (2021)

- Các mô hình này bịa đặt từ ngữ vì chúng không biết nguồn thông tin nào đáng tin cậy/có thẩm quyền hơn nguồn khác.

Vì vậy tôi đã hy vọng rằng với tích hợp Bing & OpenAI, công cụ tìm kiếm Bing có thể giải quyết tất cả hạn chế trên. Vâng, có vẻ dựa trên bài viết của Dmitri, Bing vẫn chưa giải quyết được. Còn lâu lắm.

Kiểm chứng lại bài viết

Sẽ không tốt nếu những gì Dmitri đề cập cũng không chính xác. Vì vậy tôi đã tự kiểm chứng vài điểm. Tôi bắt đầu với báo cáo tài chính của Gap vì nó có vẻ dễ kiểm tra nhất. Tôi đưa nguồn và ảnh chụp màn hình bên dưới để bạn không phải lặp lại bài tập này:

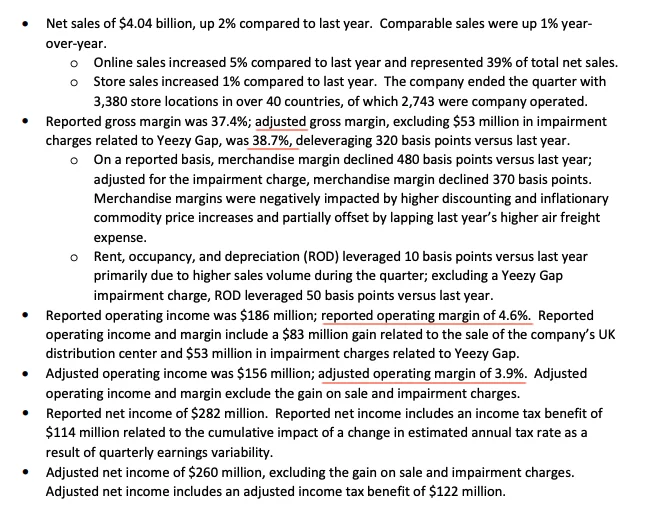

- Đây là báo cáo thu nhập Q3 2022 của Gap.

- Tôi chụp ảnh màn hình bên dưới từ báo cáo Gap và tô đỏ các số liệu chính. Dmitri đúng, Bing chat đã bịa đặt các số liệu như adjusted gross margin, operating margin, v.v...

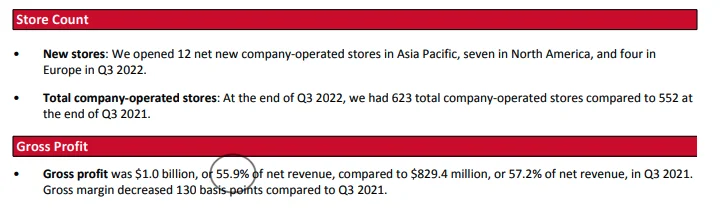

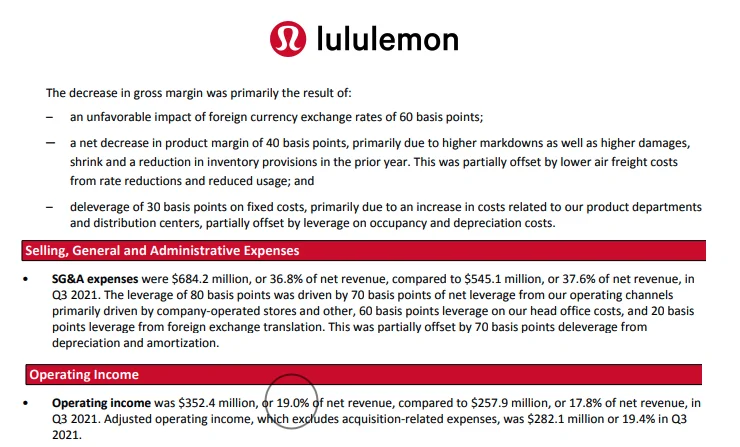

Còn số liệu Lululemon thì sao?

- Đây là báo cáo tài chính Q3 2022 của Lululemon. Tương tự, tôi đã tô đỏ các số liệu chính được đề cập trong bài viết của Dmitri trong các ảnh chụp bên dưới. Ông ấy đúng, Bing search đã bịa đặt số liệu.

Còn về lịch trình Mexico City, tôi không phải chuyên gia trong chủ đề này, nên tôi không thể kiểm chứng kỹ lưỡng. Ví dụ, khi tôi tìm kiếm "Primer Nivel Night Club - Antro", tôi tìm thấy trang Facebook này. Nhưng tôi không có cách nào xác minh với 100% chắc chắn rằng các gợi ý từ Bing Search có hợp lệ hay không.

Chúng ta có thể đi đến đâu từ đây?

Có vẻ rõ ràng rằng tại thời điểm này, tích hợp Bing & OpenAI chưa thể khắc phục vấn đề mô hình ngôn ngữ lớn (LLM) bịa đặt thông tin trong quá trình hoạt động.

Tôi không đủ kỹ thuật để hiểu việc giải quyết vấn đề này khó đến mức nào. Nếu nó không chính xác đến vậy với dữ liệu thực tế, chúng ta cần cẩn thận hơn với các chủ đề chủ quan hơn như nhà hàng/thợ sửa ống nước/dịch vụ địa phương tốt nhất, tài chính cá nhân, sức khỏe, mối quan hệ, v.v.

Công bằng mà nói với Bing và OpenAI, họ đã nói trong buổi trình bày rằng họ hiểu công nghệ mới có thể sai nhiều điều, nên họ đã thiết kế giao diện "like/dislike" để người dùng dễ dàng phản hồi. Hy vọng, với nhiều phản hồi từ người dùng hơn, máy sẽ tốt hơn.

Một thuật toán kiểm chứng đầu ra LLM?

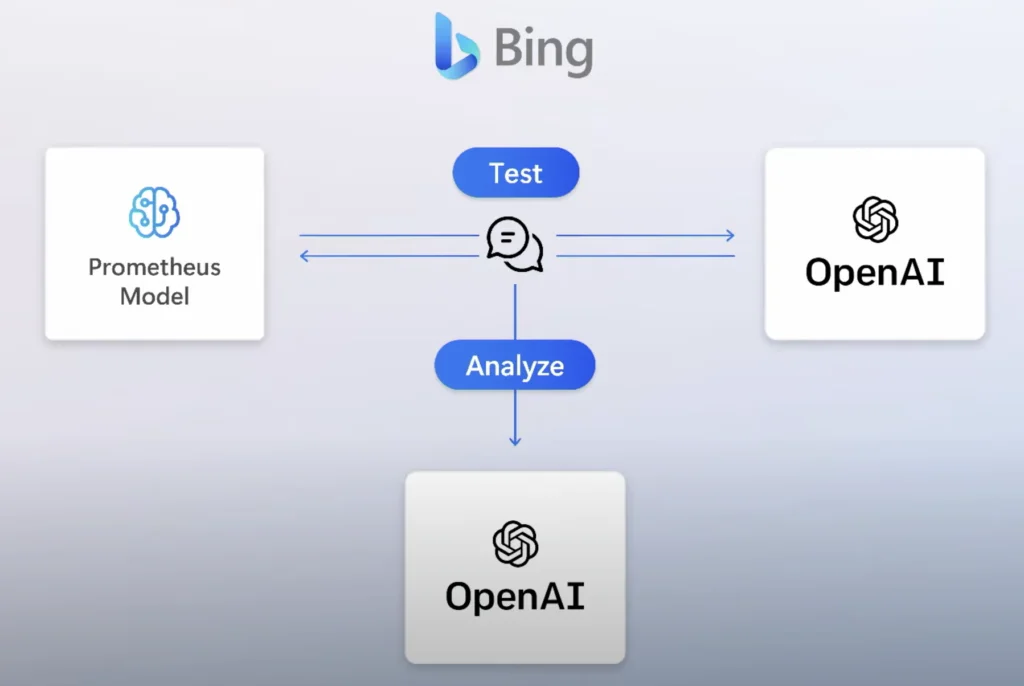

Vì LLM thường tạo ra đầu ra sai, tại sao không tạo một thuật toán để liên tục kiểm chứng đầu ra? Điều này tương tự với những gì Microsoft đã nói về thuật toán an toàn mà họ xây dựng vào Prometheus, mô phỏng prompt của kẻ xấu đến máy.

Vai trò của con người

Công nghệ này dường như đang ở giai đoạn đầu, và mặc dù tiến bộ là theo cấp số nhân, vai trò của con người rất quan trọng. Chúng ta chưa thể tin tưởng hoàn toàn vào đầu ra, ngay cả với tích hợp Bing & OpenAI. Máy có thể giúp chúng ta 50% kết quả mong muốn (ít nhiều), nhưng chúng ta cần bỏ thêm 50% còn lại.

Dường như vẫn còn đủ thời gian để chúng ta điều chỉnh, học các điểm mạnh và hạn chế của công nghệ này, và sử dụng nó hiệu quả.

Đối với các kỹ sư thiết kế các hệ thống này, có lẽ bạn cần làm tốt hơn trong việc nêu bật cho người dùng cuối các điểm dữ liệu và câu mà máy không chắc chắn. Bộ não con người thích đường tắt nên tôi chắc chắn rằng nhiều người trong chúng ta (bao gồm cả tôi) sẽ chọn con đường lười biếng và chấp nhận những gì máy nói là sự thật :P Rất khó để chúng ta cảnh giác 100% mọi lúc.

Bạn đã bao giờ bắt gặp câu trả lời do AI tạo ra mà tự tin nhưng sai không? Tôi rất muốn nghe ví dụ của bạn — càng cụ thể càng tốt.

Thân mến,

Chandler