Mỹ Hay Trung Quốc: Ai Đang Dẫn Đầu Trong Nghiên Cứu AI?

Hai phân tích lớn đưa ra kết luận trái ngược về vị trí dẫn đầu AI của Mỹ so với Trung Quốc — nhưng họ đo lường những thứ hoàn toàn khác nhau. Đây là lý do cả hai đều có thể đúng.

Gần đây tôi bắt gặp hai bài viết với tiêu đề và kết luận rất khác nhau:

- China trounces U.S. in AI research output and quality. Bài viết của Kotaro Fukuoka, Shunsuke Tabeta và Akira Okikawa, phóng viên Nikkei.

- Must read: the 100 most cited AI papers in 2022 của Zeta Alpha. Bài viết nêu "Khi chúng ta nhìn vào nguồn gốc các bài báo được trích dẫn nhiều nhất (Hình 1), chúng ta thấy rằng Hoa Kỳ tiếp tục thống trị và sự khác biệt giữa các cường quốc chỉ thay đổi nhẹ mỗi năm."

- Một trong những kết luận từ bài viết này là "Các báo cáo trước đó (link đến bài Nikkei) rằng Trung Quốc có thể đã vượt qua Mỹ trong R&D AI dường như bị phóng đại rất nhiều nếu nhìn từ góc độ trích dẫn."

Tự nhiên, điều này khiến tôi tò mò vì Nikkei là tổ chức tin tức có uy tín, và Nhật Bản là đồng minh quân sự của Mỹ. Nói cách khác, Nikkei có ít động lực để "bóp méo" sự thật có lợi cho Trung Quốc. Vì vậy tôi quyết định tìm hiểu sâu hơn.

À, hóa ra, tôi không cần tìm hiểu sâu lắm để biết rằng cả hai đều có thể đúng cùng lúc vì họ sử dụng phương pháp luận khác nhau để đưa ra kết luận. Với việc Zeta Alpha đăng bài sau và trích dẫn bài Nikkei, Zeta Alpha nên đã nêu rõ sự khác biệt trong phương pháp luận trực tiếp trong bài viết; và để độc giả tự quyết định.

Phương pháp luận khác nhau

Phương pháp Nikkei

Phương pháp Zeta Alpha

Nikkei làm việc với nhà xuất bản khoa học Hà Lan Elsevier để rà soát các bài báo học thuật và hội nghị về AI, sử dụng khoảng 800 từ khóa liên quan đến AI để thu hẹp phạm vi.

Để tạo phân tích trên, chúng tôi đã thu thập các bài báo được trích dẫn nhiều nhất mỗi năm trên nền tảng Zeta Alpha, sau đó kiểm tra thủ công ngày xuất bản đầu tiên, để đặt bài báo đúng năm.

Chúng tôi bổ sung danh sách này bằng cách khai thác các bài báo AI được trích dẫn nhiều trên Semantic Scholar với phạm vi rộng hơn và khả năng sắp xếp theo số lượng trích dẫn. Sau đó chúng tôi lấy số trích dẫn trên Google Scholar làm thước đo đại diện cho mỗi bài báo và sắp xếp để tạo top 100 cho mỗi năm.

Về số lượng, số bài báo AI bùng nổ từ khoảng 25,000 năm 2012 lên khoảng 135,000 năm 2021.

Bài viết Zeta Alpha chỉ tập trung vào top 100 bài báo mỗi năm

Cả Nikkei và Zeta Alpha sử dụng trích dẫn như chỉ báo về chất lượng bài báo.

Nhưng sự khác biệt lớn đầu tiên là Nikkei xem xét số lượng bài báo AI lớn hơn nhiều so với Zeta Alpha để đưa ra kết luận. Khi Nikkei viết, "Năm 2021, Trung Quốc chiếm 7,401 bài báo được trích dẫn nhiều nhất, vượt qua số lượng của Mỹ khoảng 70%.", họ đề cập đến top 10% bài báo, tức khoảng 13,500 bài báo năm 2021 (top 10% của khoảng 135,000 bài báo AI năm 2021).

Toàn bộ phân tích của Zeta Alpha chỉ về top 100 bài báo theo trích dẫn cho mỗi năm.

Vậy nên đây hoàn toàn không phải so sánh tương đương.

Phương pháp nào tốt hơn, Nikkei hay Zeta Alpha?

Tôi không có nền tảng sâu trong lĩnh vực AI, nên không thể nói với sự tự tin phương pháp nào tốt hơn. Tôi biết rằng chúng khác nhau.

Nếu bạn muốn trả lời câu hỏi này, tôi nghĩ bạn cần:

- Đầu tiên, xác định tiêu chí bạn sử dụng để đánh giá "tốt hơn"?

- Bao gồm nhiều bài báo hơn có nghĩa là kích thước mẫu lớn hơn nhiều và bao gồm nhiều lĩnh vực niche hơn trong AI.

- Tập trung vào top 100 bài báo có thể hợp lý nếu chúng ta nghĩ hầu hết giá trị thương mại hoặc chiến lược sẽ tích lũy cho vài bài báo/chủ sở hữu hàng đầu theo thời gian. Nhưng tôi nghi ngờ Zeta Alpha đã làm phân tích này.

- Thứ hai, tìm cách tốt hơn để định lượng giá trị hoặc tác động của mỗi bài báo thay vì chỉ sử dụng trích dẫn. Tôi biết sử dụng trích dẫn là cách thô để đánh giá chất lượng nhưng đó có phải cách tốt nhất?

- Thứ ba, mối quan hệ giữa năng lực AI của một quốc gia và phần trăm bài báo xuất bản trong top 100 hoặc top 1000 bài trích dẫn nhiều nhất trong một năm nhất định là gì?

- Ví dụ, tôi chắc rằng một số nghiên cứu tiên tiến nhất với giá trị quân sự và thương mại cao, một số phòng thí nghiệm chọn không công bố. Vì sao công bố cho người khác học, giúp đối thủ thu hẹp khoảng cách?

- Tôi có thể tiếp tục, nhưng hy vọng bạn hiểu ý tôi

Một số kết luận/tiêu đề đáng nghi ngờ

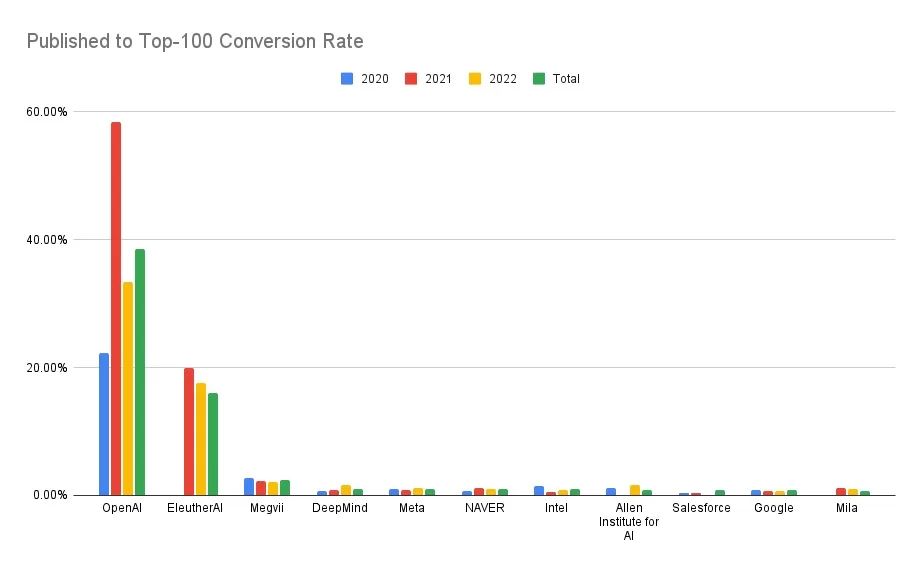

OpenAI đơn giản là ở đẳng cấp riêng khi biến bài báo thành những tác phẩm bom tấn

Zeta Alpha viết rằng "Bạn sẽ không thấy OpenAI hoặc DeepMind trong top 20 về số lượng bài báo. Những tổ chức này xuất bản ít hơn nhưng tác động cao hơn." và "Giờ chúng ta thấy OpenAI đơn giản là ở đẳng cấp riêng khi biến bài báo thành những tác phẩm bom tấn tuyệt đối."

Tại sao "tỷ lệ chuyển đổi" này quan trọng? Nó có nghĩa gì? Một cách đơn giản để diễn giải dữ liệu là:

- Nghiên cứu OpenAI tập trung vào một lĩnh vực rất hẹp của AI, và họ chọn công bố số lượng bài báo rất hạn chế.

- Google hoặc Meta và các công ty khác quan tâm đến AI rộng hơn, và họ đồng thời nghiên cứu nhiều lĩnh vực khác nhau. Và họ chọn công bố nhiều hơn.

- Điều này không liên quan gì đến việc OpenAI giỏi biến bài báo thành bom tấn.

Cách làm việc nào tốt hơn? Tôi không chắc lắm

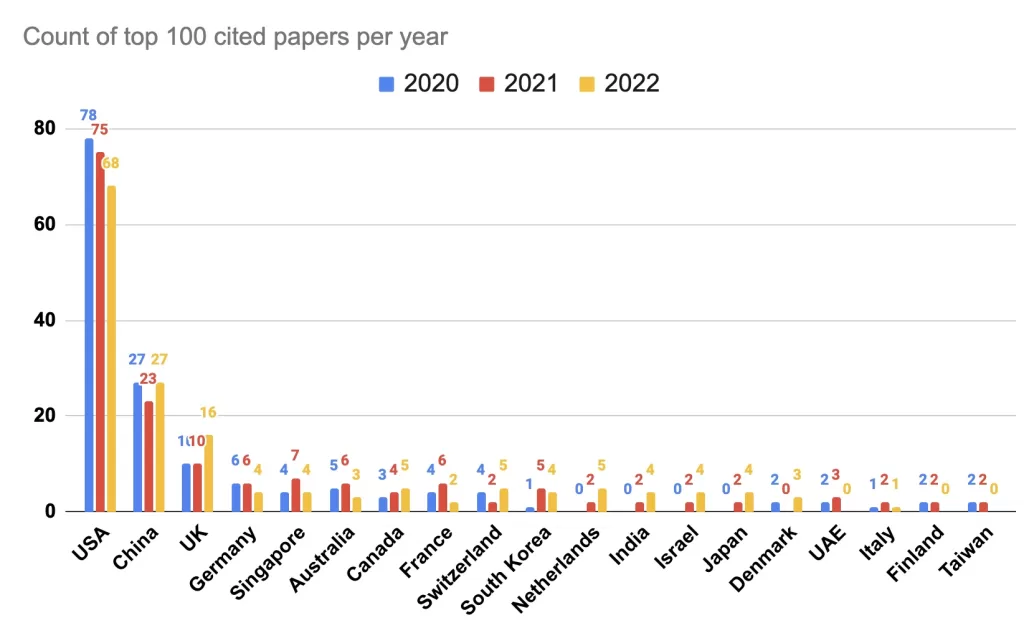

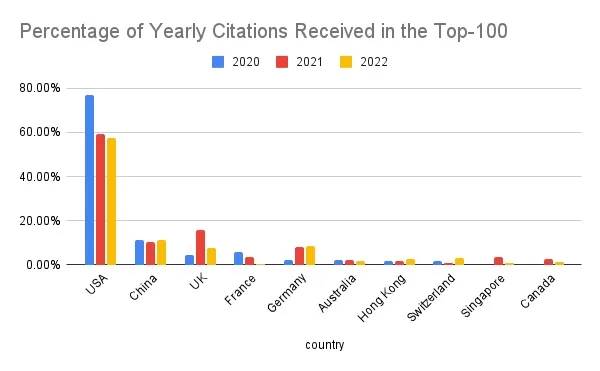

Mỹ thống trị bài báo nghiên cứu AI

Kết luận này dựa trên hai điểm dữ liệu chính dưới đây

Như đã đề cập, trong khi tôi đồng ý rằng có sự hiện diện mạnh trong top 100 (hoặc 1000 hoặc bất kỳ con số nào) bài báo AI được trích dẫn nhiều nhất là tín hiệu về sức mạnh AI của quốc gia. Tôi không nghĩ đó nên là tín hiệu DUY NHẤT. Nên có một bộ các điểm dữ liệu hoặc tín hiệu để đưa ra kết luận đó.

Ngoài ra tại sao top 100 mà không phải top 1000? Có phải vì phương pháp của Zeta Alpha liên quan đến kiểm tra thủ công nên họ chỉ có thể bao gồm top 100?

Kết luận

Đây là một ví dụ nữa về cách tình huống thực tế phức tạp hơn nhiều so với một số tiêu đề chỉ ra. Vì vậy trong khi tôi đánh giá cao nỗ lực đơn giản hóa câu chuyện cho khán giả, chúng ta không nên cố "đơn giản hóa quá mức." :)

Bạn nghĩ cách nào tốt hơn để đo năng lực AI của một quốc gia? Số bài báo được trích dẫn nhiều nhất có đủ không, hay chúng ta nên nhìn vào bộ tín hiệu rộng hơn? Tôi rất muốn nghe suy nghĩ của bạn.

Thân mến,

Chandler