KI ohne Gedächtnis ist nur ein teurer Chatbot

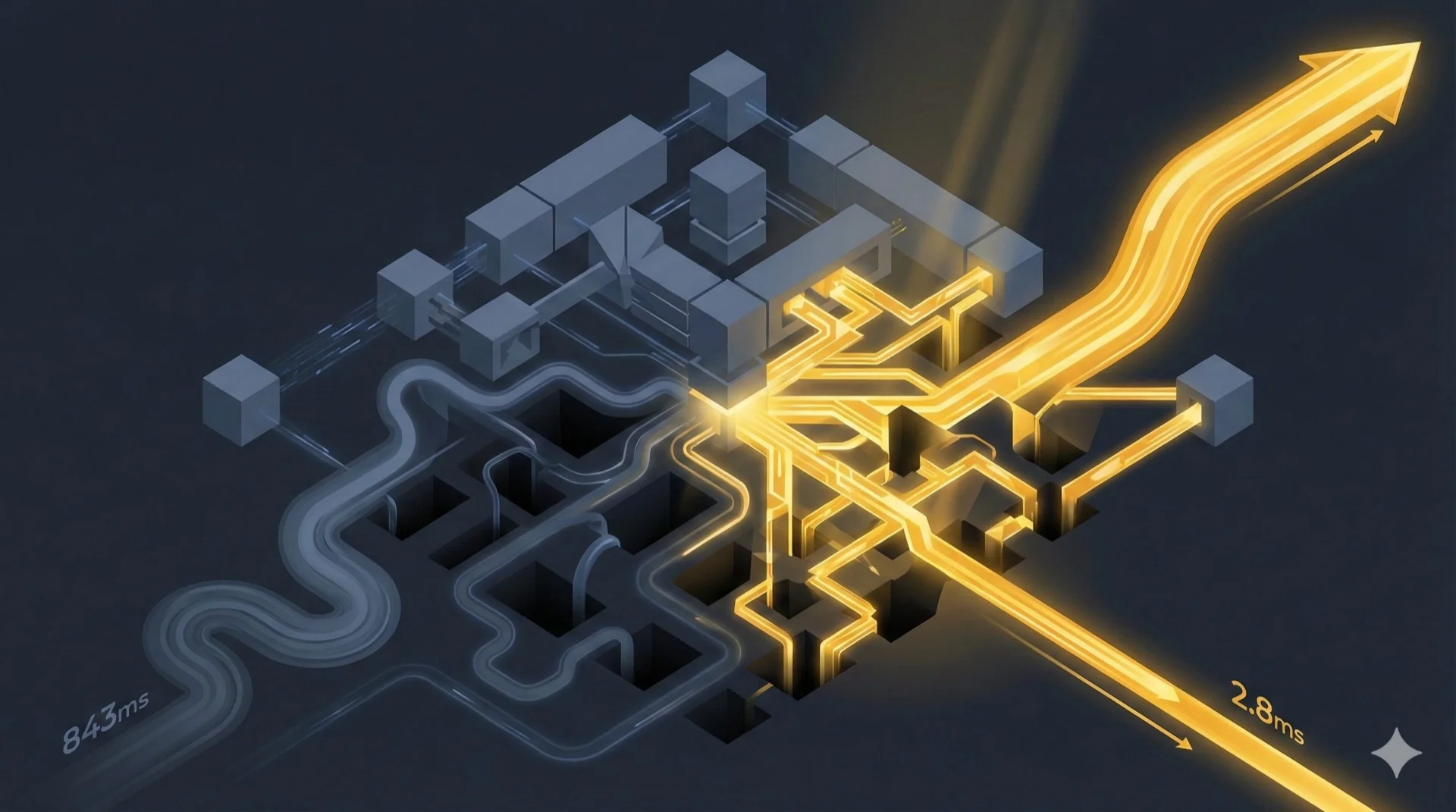

Ich habe 9 KI-Agenten gebaut, die sich zwischen Gesprächen an nichts erinnern – und Nutzer dadurch 20 bis 45 Minuten pro Woche damit verschwenden, ihren Kontext neu zu erklären. So habe ich das Problem gelöst.

Ich habe inzwischen drei KI-Produkte gebaut — Sydney (meinen persönlichen Chatbot), DIALØGUE (KI-generierte Podcasts) und STRAŦUM (eine Marketing-Intelligence-Plattform mit 9 KI-Agenten). Und es gibt eine Lektion, die ich immer wieder auf die harte Tour lerne: KI ohne Gedächtnis ist nur ein teurer Chatbot.

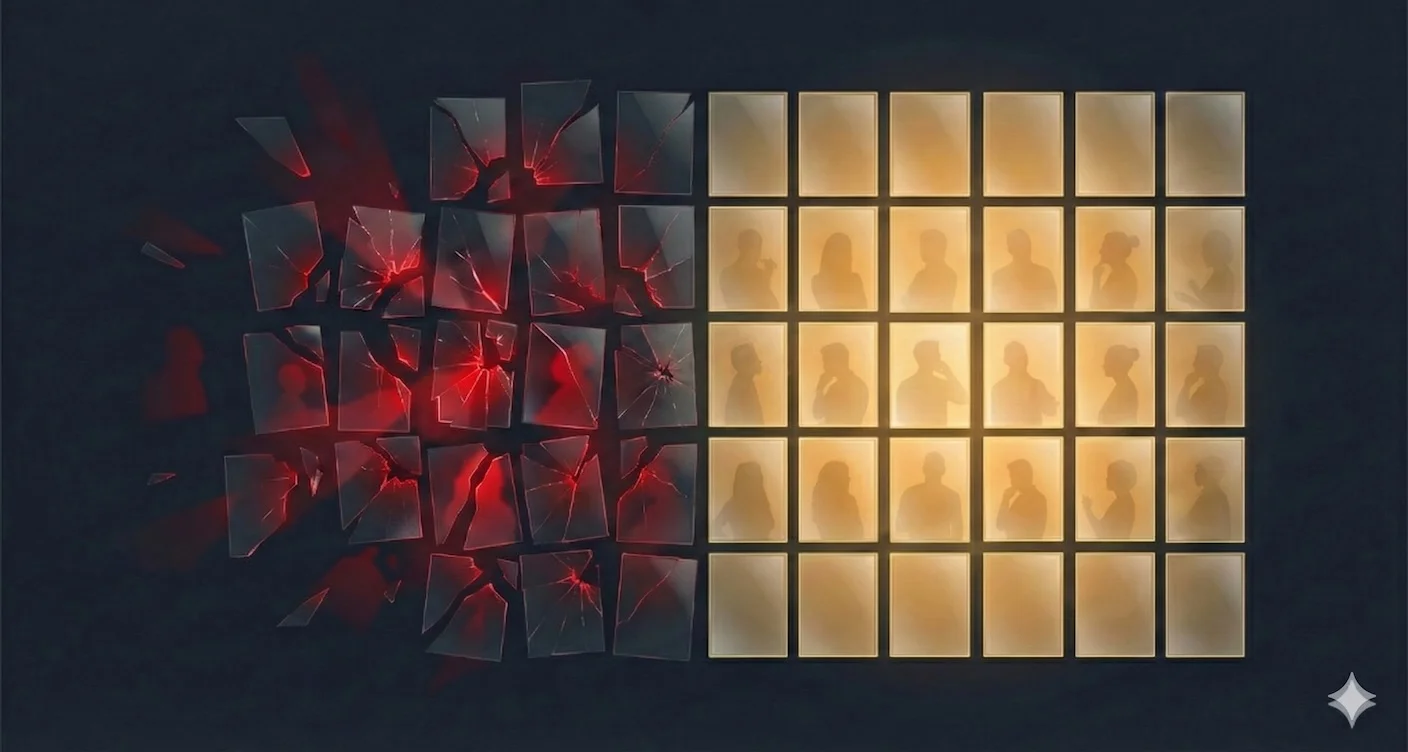

Das erste Mal hat mich das wirklich getroffen, als ich STRAŦUM noch in einer frühen Phase entwickelt hatte. Ich hatte zwei funktionierende Agenten, die echte Erkenntnisse lieferten – aber sie kommunizierten nicht miteinander. Jedes Gespräch begann von vorne.

Den Strategy Agent über deine Marktexpansionspläne informiert? Großartige Einblicke. Eine Woche später zum Content Agent gewechselt? Du musst deine Expansionsstrategie von Grund auf neu erklären. Es war wie neun brillante Kollegen zu haben, die alle an Amnesie leiden :P

Ich hatte eine Version dieses Problems schon bei Sydney erlebt. Als ich ihr RAG-System zum ersten Mal baute, konnte sie Fragen zu meinen Blog-Beiträgen beantworten, aber sie erinnerte sich nicht daran, was du ihr vor zwei Minuten gefragt hattest. Jede Frage war ein Neuanfang. Das war... na ja, irgendwie in Ordnung? Aber es fühlte sich nicht wie ein Gespräch an. Es fühlte sich an, als würde man eine Suchmaschine verhören.

Bei STRAŦUM war dieses Problem 9-mal schlimmer. Neun Agenten, null gemeinsamer Kontext.

Als ich ungefähr zwei Monate lang gebaut hatte, fand ich eine Lösung – was ich "progressives Lernen" nenne. Erzähl einem Agenten von einem Geschäftsziel, und alle neun Agenten wissen es beim nächsten Mal. Kein erneutes Erklären. Kein Kontextverlust. Ich denke, das ist das Feature, das STRAŦUM von "9 separaten Tools" in etwas verwandelt hat, das sich wirklich wie eine intelligente Plattform anfühlt.

Das ist die Geschichte, wie ich das gebaut habe. Manche meiner Schlussfolgerungen hier könnten falsch sein – ich lerne noch, was funktioniert und was nicht – aber ich möchte teilen, was ich bisher herausgefunden habe.

Das Problem: Nutzer wurden zu Dokumentationsmaschinen

Lass mich zeigen, wie frühe STRAŦUM-Gespräche tatsächlich aussahen:

Woche 1 mit dem Strategy Agent:

> Nutzer: „Wir planen, im nächsten Quartal in den europäischen Markt zu expandieren"

> Agent: [Erstellt eine umfassende Markteintragsstrategie]

Woche 2 mit dem Content Agent:

> Nutzer: „Erstelle LinkedIn-Beiträge für unsere Kampagne"

> Agent: „Welche Themen sollen diese Beiträge behandeln?"

> Nutzer: „…unsere europäische Expansion? Erinnerst du dich? Von letzter Woche?"

> Agent: „Ich habe keinen Kontext zur europäischen Expansion. Kannst du das erklären?"

Ich muss zugeben: Als ich das beim Testen zum ersten Mal sah, war ich peinlich berührt. Der Nutzer hatte uns bereits alles gesagt. Der Strategy Agent wusste es. Die Information saß direkt dort in unserer Datenbank. Wir haben einfach nicht die Punkte verbunden.

Aus meiner Erfahrung mit allen drei Produkten, die ich gebaut habe, ergibt sich dieses Muster: Nutzer haben nichts dagegen, Dinge einmal zu erklären. Sie haben etwas dagegen, Dinge nochmals zu erklären. Es gibt einen fundamentalen Unterschied zwischen „der KI etwas beibringen" und „der Sekretär der KI sein".

Ich habe grob ausgerechnet, wie viel Zeit damit verschwendet wurde:

- Durchschnittliche Wiedererklärungszeit: 2–3 Minuten pro Gespräch

- Gespräche pro Woche: 10–15 bei allen Agenten

- Verschwendete Zeit pro Nutzer: 20–45 Minuten wöchentlich

- Jährlicher Produktivitätsverlust: 17–39 Stunden pro Nutzer

Im großen Maßstab summiert sich das schnell. Für eine Plattform mit 10.000 Nutzern sind das 170.000–390.000 Stunden verschwendete Menschenzeit pro Jahr. Selbst wenn diese Zahlen um die Hälfte danebenliegen – das sind viele Menschen, die sich gegenüber einer Maschine wiederholen.

---

Die Vision: „Einem Agenten sagen, alle neun informieren"

Also begann ich nachzudenken – was wäre, wenn Agenten voneinander lernen könnten? Ich hatte so etwas schon in einer einfacheren Form bei Sydney gesehen: Sie nutzt RAG, um sich an meine Blog-Beiträge und meine Karrieregeschichte zu „erinnern". Aber STRAŦUM brauchte etwas Dynamischeres – nicht nur das Abrufen statischer Inhalte, sondern das Erfassen neuer Informationen aus Live-Gesprächen und deren Weitergabe an alle Agenten.

Die ideale Erfahrung, nach der ich strebte:

1. Nutzer bespricht Marktexpansion mit dem Strategy Agent (Tag 1)

2. Plattform erfasst automatisch die wichtigste Geschäftserkenntnis

3. Nutzer spricht mit dem Content Agent (Tag 7)

4. Content Agent kennt die Expansionspläne bereits

5. Kein erneutes Erklären. Einfach intelligenter Kontext.

Ich denke, das ist der Unterschied zwischen einem KI-Tool, das man gelegentlich nutzt, und einem, auf das man wirklich angewiesen ist. Es geht nicht um ausgefallene Features – es geht um den Teil, der sich an dich erinnert.

---

So funktioniert es: Die Nutzererfahrung

Automatisches Lernen

Das war der schwierigste Teil, um es richtig hinzubekommen. Jedes Mal, wenn du ein bedeutungsvolles Gespräch mit einem Agenten führst, versucht STRAŦUM, wichtige Geschäftserkenntnisse zu identifizieren, die es wert sind, gespeichert zu werden:

- Marktexpansionspläne

- Zielgruppenmerkmale

- Budgetbeschränkungen

- Wettbewerbspositionierung

- Markenrichtlinien

- Preisstrategien

- usw.

Du musst nichts tun. Die Plattform lernt, während du arbeitest. (Das ist zumindest das Ziel. Ich feile noch an dem Teil „Was ist es wert, gespeichert zu werden?" – dazu mehr im Abschnitt über gelernte Lektionen.)

Kanalübergreifende Intelligenz

Das ist der Teil, der mich begeistert :D Die Magie passiert, wenn du die Agenten wechselst. Die Budgetbeschränkung, die du dem Performance Agent erwähnt hast? Der Campaign Agent kennt sie, wenn er Werbeausgaben empfiehlt. Die Marktexpansion, die du mit dem Strategy Agent besprochen hast? Der Content Agent berücksichtigt sie in seinen Messaging-Empfehlungen.

Neun Agenten. Ein gemeinsames Verständnis deines Unternehmens.

Das erinnert mich daran, wie DIALØGUE funktioniert – wenn es einen Podcast generiert, muss es sich das Expertenwissen des Nutzers, seinen bevorzugten Stil und sein Publikum merken. Anderer Kontext, gleiches Prinzip: KI, die sich an dich erinnert, ist fundamental anders als KI, die das nicht tut.

So sieht das in der Praxis aus – wenn du ein neues Gespräch beginnst, ist relevanter Kontext aus vergangenen Interaktionen automatisch verfügbar:

```python

# Jedes Agentengespräch beginnt mit deinem Geschäftskontext

async def get_business_context(org_id: str) -> str:

"""

Relevante Erkenntnisse aus früheren Gesprächen abrufen.

Jeder Agent sieht, was für dein Unternehmen relevant ist.

"""

insights = await fetch_recent_insights(org_id)

# Kontext fließt automatisch zu jedem Agenten

return build_context_summary(insights)

```

Die eigentliche Implementierung beinhaltet sorgfältige Filterung und Relevanzbewertung – aber das Prinzip ist einfach: Deine Agenten erinnern sich an das, was wichtig ist.

Vollständige Transparenz

Das habe ich auf die harte Tour gelernt: KI-Gedächtnis kann sich unheimlich anfühlen, wenn du nicht weißt, was gespeichert wird. In einem frühen Testdurchlauf zeigte ich jemandem das System, und seine erste Reaktion war: „Warte, was weiß es noch alles über mich?" Das ist nicht die Reaktion, die du willst.

Also habe ich vollständige Transparenz in das System eingebaut. Hier ist die UI-Komponente, die Nutzern erlaubt, ihre Business Intelligence einzusehen und zu kontrollieren:

```typescript

// Nutzer sehen genau, was die Plattform gelernt hat

export function BusinessIntelligenceDashboard() \{

const { insights \} = useBusinessContext();

return (

<div className="space-y-4">

<h2>Was STRAŦUM über dein Unternehmen weiß</h2>

{insights.map(insight => (

<InsightCard key={insight.id}>

<div className="flex justify-between">

<span className="font-medium">{insight.summary}</span>

<Badge>{insight.source_agent}</Badge>

</div>

<p className="text-sm text-muted">

Gelernt \{formatDate(insight.created_at)\}

</p>

<Button

variant="ghost"

onClick={() => deleteInsight(insight.id)}

>

Diese Erkenntnis entfernen

</Button>

</InsightCard>

))}

</div>

);

}

```

- Alles sehen: Ein dediziertes Dashboard zeigt genau, was die Plattform gelernt hat

- Quellenangabe: Wissen, welcher Agent was gelernt hat und wann

- Einfaches Löschen: Ein Klick, um eine Erkenntnis zu entfernen, die du nicht gespeichert haben möchtest

- Kein verstecktes Lernen: Alles ist sichtbar und überprüfbar

Nutzer vertrauen dem System, weil sie es kontrollieren.

---

Praxisbeispiele

Beispiel 1: Marktexpansion

Tag 1 – Strategy Agent:

> Nutzer: „Wir planen, im nächsten Quartal in den europäischen Markt zu expandieren, beginnend mit Deutschland und dem UK."

> Agent: [Erstellt eine umfassende Markteintragsstrategie]

*Plattform erfasst: Europäische Marktexpansion geplant, Ziel Deutschland und UK*

Tag 7 – Content Agent:

> Nutzer: „Erstelle LinkedIn-Beiträge für den nächsten Monat"

> Agent: „Ich sehe, dass du eine europäische Expansion planst. Sollen diese Beiträge dein Publikum auf deinen internationalen Launch vorbereiten?"

Kein erneutes Erklären nötig.

Beispiel 2: Budget-Bewusstsein

Tag 5 – Agent:

> Nutzer: „Unser Marketingbudget liegt bei etwa $10.000/Monat"

> Agent: [Erstellt eine Budgetallokationsanalyse]

*Plattform erfasst: Monatliches Marketingbudget ~$10.000*

Tag 15 – Campaign Planning Agent:

> Nutzer: „Sollten wir bezahlte Werbung schalten?"

> Agent: „Basierend auf deinem monatlichen Budget empfehle ich eine ausgewogene Aufteilung auf bezahlte Kanäle und Content-Erstellung..."

Budgetkontext gespeichert.

---

Die Multi-Tenant-Herausforderung

Progressives Lernen wird kompliziert, wenn du sowohl KMU als auch Agenturen bedienst.

Für KMU: Unkompliziert. Alle Erkenntnisse gehören der Organisation.

Für Agenturen: Die Erkenntnisse jedes Kunden müssen vollständig isoliert bleiben. Eine Agentur, die Kunde A und Kunde B betreut, darf nie erlauben, dass die Strategie von Kunde A versehentlich die Empfehlungen für Kunde B beeinflusst.

# Agenturkontext ist immer kundenbezogen

def get_insights_for_conversation(org_id: str, client_id: str | None):

"""

KMU: client_id ist None, alle Org-Erkenntnisse sichtbar

Agenturen: client_id filtert auf spezifischen Kunden

"""

if client_id:

# Agenturnutzer arbeitet an spezifischem Kunden

# Erkenntnisse von Kunde A fließen NIE in Kontext von Kunde B

return fetch_client_insights(org_id, client_id)

else:

# KMU-Nutzer, alle Org-Erkenntnisse verfügbar

return fetch_org_insights(org_id)

Das ist keine Feature – es ist eine Vertrauensanforderung. Ein einziges Datenleck, und Agenturnutzer verlieren dauerhaft das Vertrauen.

Wir haben stark in Datenisolierung auf jeder Ebene investiert – Anwendungslogik, Datenbankrichtlinien und umfangreiche Tests. Die Business Intelligence von Kunde A bleibt bei Kunde A. Immer.

---

Warum das einen echten Vorteil schafft

Ich möchte ehrlich sein: Ich bin kein SaaS-Stratege. Ich bin ein Entwickler, der 18 Jahre in der Werbung gearbeitet hat, bevor er programmieren lernte. Aber aus meiner Erfahrung beim Aufbau von drei KI-Produkten denke ich, dass progressives Lernen aus einigen Gründen einen echten Vorteil schafft.

Steigende Renditen

Je länger Nutzer die Plattform verwenden, desto intelligenter wird sie. Jedes Gespräch fügt Kontext hinzu. Jede Erkenntnis macht zukünftige Gespräche besser.

Traditionelle KI-Tools: Gleiche Erfahrung an Tag 1 und Tag 100.

Progressives Lernen: Tag 1 = gut. Tag 100 = außergewöhnlich.

Ich habe dieses Muster auch bei Sydney beobachtet – ihr RAG-System bedeutet, dass sie jetzt nützlicher ist als vor sechs Monaten, einfach weil es mehr Inhalte gibt, auf die sie zurückgreifen kann. Gedächtnis wächst exponentiell.

Warum Nutzer bleiben

Sobald die Plattform dein Unternehmen tiefgreifend kennt, bedeutet ein Wechsel zur Konkurrenz, von vorne anzufangen. Du verlierst:

- Monate angesammelter Erkenntnisse

- Kontext über deine Marktstrategie

- Zielgruppenerkenntnisse, die agentübergreifend aufgebaut wurden

- Budgetbeschränkungen und Ziele

Nach 30 Tagen regelmäßiger Nutzung erfasst die Plattform den Großteil deines Geschäftskontexts. Ich denke, das ist der Grund, warum Nutzer bleiben – nicht weil sie eingesperrt sind, sondern weil ein Neustart woanders sich wirklich wie ein Rückschritt anfühlt.

Netzwerkeffekte innerhalb von Organisationen

Für Agenturen, die mehrere Kunden betreuen (und das liegt mir am Herzen – ich habe den Großteil meiner Karriere in Agenturen verbracht), multipliziert sich progressives Lernen:

- Die Erkenntnisse jedes Kunden wachsen unabhängig

- Jede Kundenbeziehung vertieft den Wert der Plattform

- Der Wert skaliert mit der Portfoliogröße

Eine Agentur mit 10 Kunden profitiert 10-mal mehr als ein Einzelnutzer.

Schwer zu replizieren

Ich könnte falsch liegen, aber ich glaube, dass der Aufbau von progressivem Lernen eine tiefe Integration erfordert über:

- KI-Antwortgenerierung

- Hintergrundverarbeitung

- Multi-Tenant-Datenisolierung

- Nutzer-Kontrollschnittstellen

- Kanalübergreifendes Kontextsharing

Das ist nichts, was man nachträglich ergänzt. Es ist von Grund auf in die Architektur eingewoben.

---

Die Geschäftsauswirkungen

Hier sind die Zahlen, die ich im Blick habe (ich versuche, dabei immer konkret zu sein):

Gesparte Zeit pro Nutzer:

- Vorher: 2–3 Minuten erneutes Erklären pro Gespräch

- Gespräche pro Woche: 10–15

- Jährlich gesparte Zeit: 17–39 Stunden pro Nutzer

Was ich für die Kundenbindung erwarte

Ich bin ehrlich – ich habe noch nicht genug Daten, um das definitiv zu beweisen. STRAŦUM befindet sich noch in der Alpha-Phase. Aber meine Hypothese, basierend auf dem, was ich bisher gesehen habe:

- Nutzer, die viele gespeicherte Erkenntnisse angesammelt haben, wechseln seltener

- Je mehr Kontext investiert wurde, desto schwerer fällt ein Neustart anderswo

- Progressives Lernen sollte direkt mit der Kundenbindung korrelieren

Ich beobachte das genau. Wenn ich falsch liege, werde ich auch darüber schreiben :P

Was das wirklich nützlich macht (jenseits der Zahlen):

- Du musst nicht mehr der Sekretär deiner KI sein

- Kontext baut sich auf natürliche Weise über die Zeit auf

- Die Plattform wird besser, je mehr du sie nutzt – ohne zusätzlichen Aufwand von dir

---

Gelernte Lektionen (auf die harte Tour)

Das sind keine theoretischen Erkenntnisse – das sind Fehler, die ich tatsächlich gemacht habe.

1. KI-Gedächtnis erfordert Nutzerkontrolle

Frühe Versionen fühlten sich wie Überwachung an. Ich zeigte es einem Freund, und seine genauen Worte waren: „Das ist gruselig." Nicht das Feedback, das du haben möchtest.

Die Lösung: Vollständige Transparenz. Alles zeigen. Nutzer alles löschen lassen. Kein verstecktes Lernen.

Ergebnis: Nutzer vertrauen dem System, weil sie es kontrollieren. (Das hätte ich wissen sollen – ich hatte dasselbe Gespür, als ich Sydneys Gesprächsschnittstelle baute. Menschen wollen sehen, was unter der Haube passiert.)

2. Qualität vor Quantität

Mein erster Instinkt war, alles zu speichern. Jeden Satz. Jedes Detail. Ich bin ein „mehr Daten ist besser"-Mensch – 18 Jahre in der Analytics werden dich so formen. Aber es war überwältigend und unfokussiert.

Die Lösung: Nur hochkonfidente, strategisch relevante Erkenntnisse erfassen. Qualität schlägt Quantität.

Ergebnis: Fokussierter Kontext, der Gespräche tatsächlich verbessert.

3. Weniger Kontext ist oft besser

Das hat mich überrascht. Zu viel Kontext in Gespräche einzuspeisen, machte Antworten langsam und unkonzentriert. Es stellt sich heraus, dass Claude, wenn man ihm eine Wand voller Hintergrundinformationen gibt, versucht, auf alles zu verweisen – selbst wenn das meiste davon nicht relevant ist.

Die Lösung: Sorgfältig kuratieren. Nur einbeziehen, was für das aktuelle Gespräch relevant ist.

Ergebnis: Schnellere Antworten, fokussiertere Empfehlungen. Ich arbeite noch daran, die richtige Balance zu finden.

4. Multi-Tenant-Isolierung ist nicht verhandelbar

Ein einziger Bug in der Datenisolierung könnte das Nutzervertrauen dauerhaft zerstören. Aus der Agenturwelt weiß ich, wie ernst Kundenvertraulichkeit ist. Eine Agentur, die Kunde A und Kunde B betreut, darf niemals einen Datenleck zwischen ihnen haben.

Die Lösung: Defense in Depth. Mehrere Isolierungsschichten. Umfangreiche Tests.

Ergebnis: Null Cross-Client-Leckagevorfälle. (Das ist ein Bereich, in dem ich keine Kompromisse eingehe – die Isolierung muss perfekt sein.)

---

Wann macht KI-Gedächtnis Sinn?

Wenn du ein KI-Produkt baust und überlegst, ob du in Gedächtnis investieren sollst, hier ist meine ehrliche Einschätzung. Progressives Lernen macht Sinn, wenn:

✅ Du mehrere KI-Berührungspunkte hast, die von gemeinsamem Kontext profitieren könnten

✅ Nutzer wiederholte Interaktionen haben über Tage/Wochen/Monate

✅ Kontext Wert aufbaut (Geschäftsstrategie, Präferenzen, Einschränkungen)

✅ Nutzer zu halten wichtiger ist als neue zu gewinnen

✅ Du Organisationen bedienst (Teams, Agenturen, Unternehmen)

❌ Lass es bleiben, wenn:

- Einzelne Interaktionen ohne Wiederholung

- Kontext baut keinen Wert auf

- Datenschutzbedenken überwiegen den Komfort

- Du nicht in ordentliche Datenisolierung investieren kannst (und ich meine wirklich investieren – das ist nichts, was du halbherzig angehen solltest)

---

Abschließende Gedanken

Progressives Lernen hat STRAŦUM von „9 separaten KI-Agenten" in etwas verwandelt, das sich wirklich wie eine intelligente Plattform anfühlt. Nutzer sagen es einmal. Das System erinnert sich (oder bis sie es löschen).

Ich denke, das ist der Unterschied zwischen einem Tool und einer Plattform. Zwischen einer Transaktion und einer Beziehung. Zwischen „ich nutze das manchmal" und „ich kann ohne das nicht arbeiten." Aber ich stehe noch am Anfang dieser Reise – STRAŦUM ist in der Alpha-Phase, und ich lerne jede Woche Neues darüber, was funktioniert.

KI-Gedächtnis aufzubauen war schwer. Multi-Tenant-Isolierung hat die Komplexität erhöht. Das Multi-Tenancy-Fundament, auf dem das alles aufbaut, war sein eigenes Abenteuer – von der Architekturentscheidung an Tag 2 bis zum vollständigen Neuaufbau an Tag 67. Aber das Ergebnis? Eine Plattform, die mit der Nutzung intelligenter wird.

Einem Agenten sagen. Alle neun informieren.

Ich bin neugierig – wenn du KI-Produkte baust, hast du das Gedächtnisproblem angegangen? Welche Ansätze haben bei dir funktioniert? Ich bin wirklich interessiert, weil ich noch herausfinden möchte, was es wert ist, gespeichert zu werden, und was Rauschen ist. Lass es mich wissen.

---

Selbst ausprobieren

Über progressives Lernen zu lesen ist eine Sache. Es zu erleben ist eine andere.

STRAŦUM befindet sich derzeit in einem privaten Alpha. Ich arbeite mit einer kleinen Gruppe von KMU-Gründern und Agenturteams zusammen, um die Erfahrung vor dem öffentlichen Launch zu verfeinern.

Wenn du es leid bist, deinen Geschäftskontext KI-Tools immer wieder neu erklären zu müssen, die sich von Sitzung zu Sitzung an nichts erinnern, würde ich mich freuen, wenn du es ausprobierst.

Was du bekommst:

- Vollständiger Zugang zu allen 9 KI-Agenten

- Progressives Lernen, das sich tatsächlich an dein Unternehmen erinnert

- Direkten Draht zu mir für Feedback und Feature-Anfragen

Ich nehme neue Alpha-Nutzer fortlaufend auf. Die Plätze sind begrenzt – ich möchte in dieser Phase jedem persönliche Aufmerksamkeit schenken.

Viele Grüße,

Chandler