Was Agenturen von AI wirklich brauchen, ist nicht mehr Content

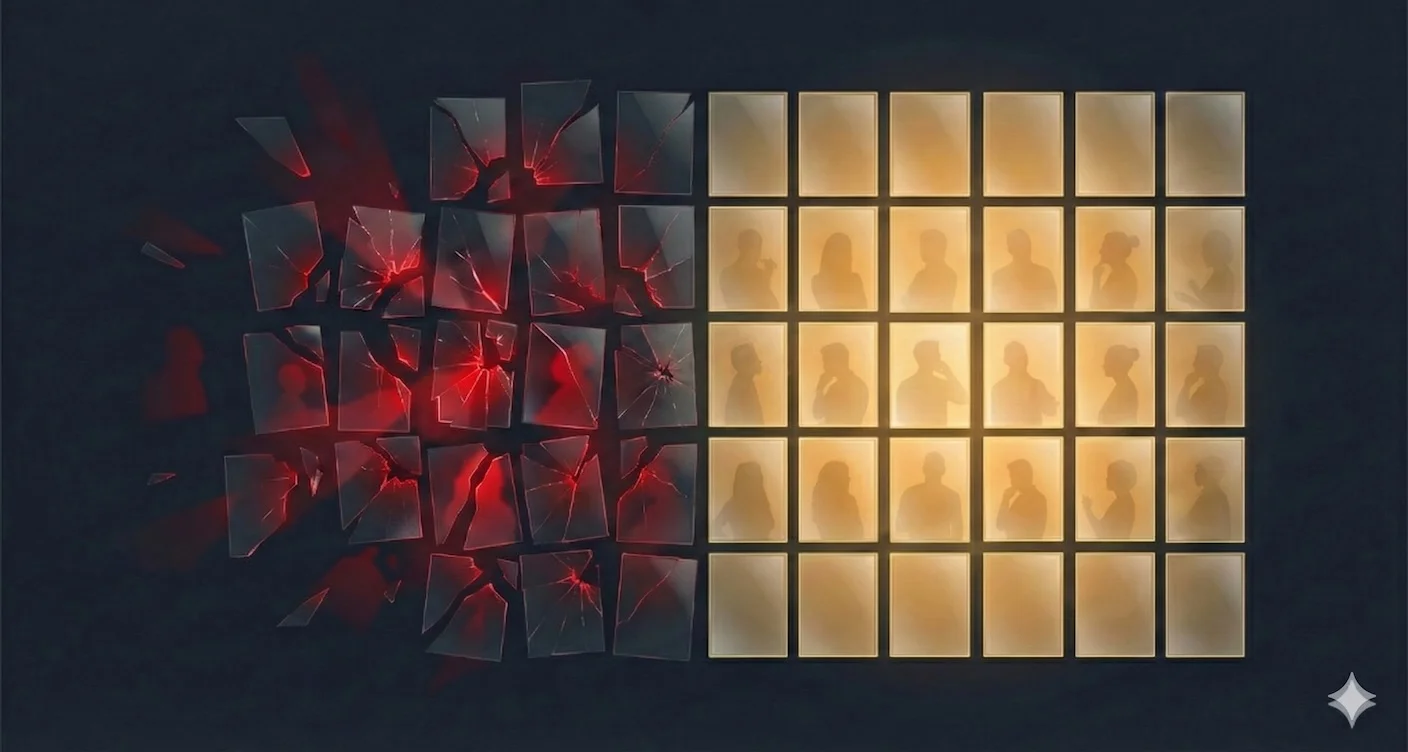

Ich sehe immer wieder, wie AI-Tools Agenturen Content-Volumen verkaufen. Aber wenn du jemals echte Kundenbeziehungen gesteuert hast, weißt du, dass das schwierigere Problem Vertrauen ist: Isolation, Berechtigungen, Kontext und eben nicht das Denken eines Kunden in die Arbeit eines anderen lecken zu lassen.

Ich wusste, dass ich das Falsche baute, als ich mich dabei erwischte, wie ich mir einen Agenturinhaber vorstellte, der sich über "50 LinkedIn-Post-Ideen in 10 Sekunden" freut.

Nicht weil Content-Ideen nutzlos wären. Das sind sie nicht.

Sondern weil du, wenn du jemals echte Zeit in Agenturen verbracht hast, weißt, dass das nicht der beängstigende Teil des Jobs ist.

Der beängstigende Teil ist Vertrauen.

Es ist der Account Manager, der sich fragt, ob ein System versehentlich Client A und Client B vermischen könnte.

Es ist der Stratege, der denkt: "Kann ich das auf einem Competitive Account sicher einsetzen?"

Es ist der Agenturinhaber, der eine viel weniger sexy Frage stellt, als jede AI-Homepage beantworten will:

Was passiert, wenn dieses Ding die Intelligence eines Kunden in die Arbeit eines anderen Kunden leakt?

Diese Frage ist viel wichtiger als "wie viele Captions kann es generieren?"

Ich glaube, ein großer Teil des AI-Software-Marktes missversteht Agenturen immer noch, weil er die eigentliche Arbeit missversteht. Agenturen leiden nicht primär unter einem Mangel an Worten. Sie leiden unter Komplexität:

- mehrere Clients

- mehrere Brands

- mehrere interne Rollen

- mehrere Freigabeebenen

- mehrere Versionen von "wer darf was sehen"

Wenn also ein AI-Vendor auftaucht und sagt: "Gute Nachrichten, jetzt könnt ihr schneller mehr Content machen", will ein Teil von mir sagen: Habt ihr jemals wirklich in einem Agentur-Workflow gesessen?

Denn je mehr ich STRAŦUM baute, desto klarer wurde: Agenturen brauchen zuerst nicht mehr Content.

Sie brauchen bessere Infrastruktur für Vertrauen.

Das Problem der Agentur ist nicht Volumen. Es ist Risiko.

Ich glaube, das lässt sich am leichtesten verstehen, wenn du jemals Verantwortung für Client-Arbeit mit echten Stakes hattest.

Wenn du nur eine Brand betreust, ist das Leben einfacher. Deine Notizen sind deine Notizen. Deine Positionierungsarbeit bleibt in einer Spur. Deine Fehler tun immer noch weh, aber sie sind wenigstens lokal.

Agenturen leben dort nicht.

Agenturen jonglieren mit:

- unterschiedlichen Brand Voices

- unterschiedlichen Kategorien

- unterschiedlichen Approval Chains

- unterschiedlichen Definitionen von Erfolg

- Clients, die sogar miteinander konkurrieren können

Das bedeutet, dass die Kosten eines Fehlers nicht "wir haben einen mittelmässigen Draft erstellt" sind.

Manchmal sind die Kosten:

- wir haben dem falschen Client das Falsche geschickt

- wir haben den falschen Kontext im falschen Workspace offengelegt

- wir haben die Plattform unsicher wirken lassen

- der Client fragt sich jetzt, was hinter den Kulissen sonst noch sloppy ist

Und sobald ein Client beginnt, diese letzte Frage zu stellen, befindest du dich bereits in teurem Terrain.

Darum werde ich skeptisch, wenn Agentur-AI fast vollständig über Output-Beispiele verkauft wird. Eine Demo von generiertem Content beweist, dass das Modell Content generieren kann. Gut. Aber für Agenturen ist der wichtigere Beweis architektonisch.

Zeig mir:

- wo die Daten liegen

- wie Client-Kontext isoliert ist

- wer auf was zugreifen kann

- ob Freigaben eingebaut sind

- ob die Arbeit eines Clients die eines anderen kontaminieren kann

Das ist die Product Story, die Agenturen wirklich interessiert, auch wenn sie in einem Launch-Video deutlich weniger Spaß macht.

Ich glaube, mein Werbe-Background hat mir das schneller klargemacht

Vielleicht weil ich aus der Werbung komme, habe ich nie wirklich an die Geschichte geglaubt, dass "Content der Bottleneck" für Agenturen sei.

Versteh mich nicht falsch: Agenturen produzieren absolut Content. Eine Menge davon. Und ja, dort gibt es echte Effizienzgewinne.

Aber was Agenturarbeit schwierig macht, ist meistens nicht das Fehlen eines ersten Drafts.

Es ist das Operating Environment um den Draft herum.

Wer hat ihn reviewed? Für welchen Client ist das? Welcher Kontext hat diese Empfehlung geformt? Wurde sie mit den richtigen Brand-Constraints generiert? Hat jemand versehentlich die falschen Annahmen wiederverwendet? Wer darf das freigeben?

Wenn du in-house bist, ist ein Teil davon immer noch wichtig.

Wenn du eine Agentur bist, ist all das jeden Tag wichtig.

Darum habe ich ziemlich früh im Leben von STRAŦUM eine Entscheidung getroffen, die sich leicht unangemessen anfühlte: Ich begann fast sofort, Multi-Tenancy zu bauen. Im Grunde an Tag 2. Was rückblickend entweder diszipliniert oder leicht wahnsinnig war, je nachdem, wie wohlwollend du bist.

Zu diesem Zeitpunkt hatte ich erst einen funktionierenden Agent. Client-Isolation so früh zu bauen, fühlte sich verfrüht an.

Es stellte sich auch als richtig heraus.

Denn sobald du Agenturen klar siehst, merkst du: Sie sind nicht einfach "SMEs mit mehr Nutzern". Sie haben ein fundamental anderes Operating Model.

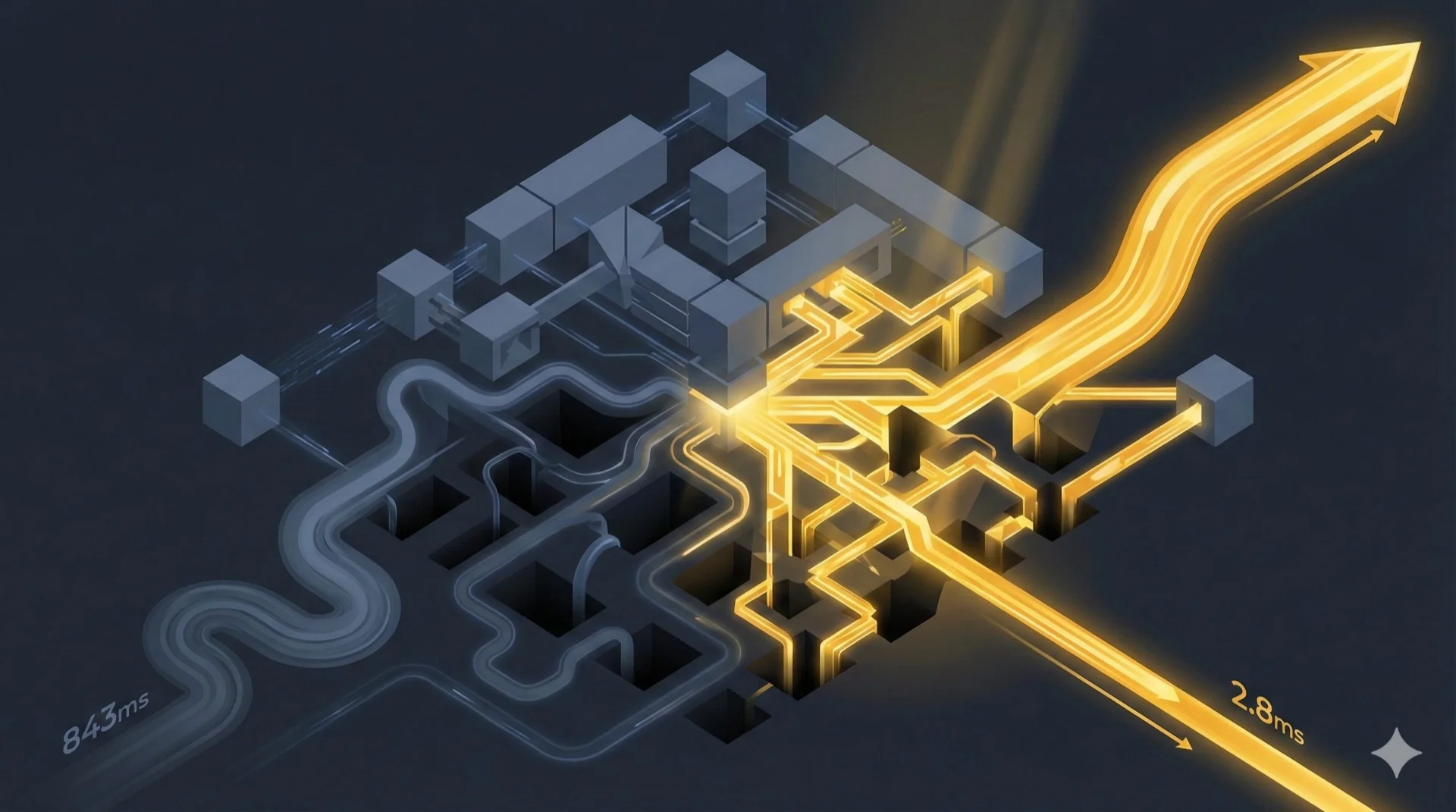

Der Tag, an dem mir klar wurde, dass org_id mich nicht retten würde

Meine erste Version von Multi-Tenancy war die klassische optimistische Builder-Version.

Füge org_id überall hinzu.

Schreibe deine Policies.

Vertraue den Filtern.

Nenn es erledigt.

Das funktioniert für überraschend viel Software. Es gibt dir auch die beruhigende Illusion, dass du Isolation gelöst hast, obwohl du in Wahrheit nur Basic Scoping gelöst hast.

Für STRAŦUM war das nicht genug.

Denn Agenturen hatten nicht nur eine organisationale Ebene. Sie hatten Clients unter der Organisation. Und jeder Client brauchte seinen eigenen Kontext, seine eigenen Outputs, seine eigene Historie und eigene Sicherheitsgrenzen.

Das bedeutete, dass ich versuchte, zwei unterschiedliche Datenmodelle in einen mentalen Shortcut zu pressen:

- SME: eine Org, ein Business-Kontext

- Agency: eine Org, mehrere Client-Kontexte innerhalb derselben Org

Du kannst das eine Zeit lang in Application Logic faken. Leute machen das. Aber je länger ich es mir ansah, desto klarer wurde mir, dass ich ein System baute, das korrekt aussehen konnte, strukturell aber immer noch zu vertrauensselig war.

Das ist eine schlechte Kombination.

Es brauchte einen Rebuild, um es richtig hinzubekommen. Separates Routing. Separate Schema-Logik. Mehr Guardrails auf Datenbankebene. Expliziteres Context Handling. Weniger "denk einfach daran, überall korrekt zu filtern".

Nervig? Ja.

Wert? Ebenfalls ja.

Wobei ich ehrlich sein muss — selbst nach dem Rebuild habe ich Wochen später noch eine Lücke gefunden, bei der Nutzer, die bestimmten Clients zugewiesen waren, über einen anderen Query-Pfad trotzdem Daten anderer Clients sehen konnten. Die Architektur war besser, aber nicht vollständig. Ich bin immer noch nicht ganz sicher, dass alles wirklich dicht ist.

Denn Agenturvertrauen sollte nicht davon abhängen, dass ein Entwickler sich um 23:30 Uhr an jeden einzelnen if/else-Branch erinnert.

AI macht das Vertrauensproblem schlimmer, nicht besser

Ich glaube, das ist der Teil, den die Kategorie immer noch zu klein spielt.

AI ist nicht einfach nur eine weitere UI-Schicht über Agenturarbeit. Sie verändert das Risikoprofil, weil du jetzt ein System hast, das Kontext synthetisieren kann, nicht nur speichern.

Das ist mächtig.

Und genau deshalb sind schlechte Grenzen inakzeptabel.

Wenn ein AI-System Zugriff auf den falschen Kontext hat, legt es nicht nur Rohdaten offen. Es kann sie remixen. Es kann still und leise dazu führen, dass die Insights von Client A in die Strategie von Client B einfliessen. Es kann Isolationsfehler in polished Outputs verwandeln, was ehrlich gesagt schlimmer ist als ein sichtbarer Bug, weil es schwerer zu erkennen ist.

Darum machen mich General-Purpose-AI-Tools in Agenturumgebungen nervös, wenn Menschen anfangen, sie casual über mehrere Accounts hinweg zu verwenden.

Eine Weile lang kommst du damit durch.

Dann merkt eines Tages jemand, dass die Sprache vertraut klingt.

Oder eine Empfehlung enthält ein Wettbewerbs-Framework, das in diesem Workspace nicht hätte sein dürfen.

Oder ein Client sieht etwas, das ihn fragen lässt, ob eure Systeme überhaupt compartmentalized sind.

Sobald dieser Zweifel in die Beziehung eintritt, reparierst du keinen Content-Workflow mehr. Du reparierst Glauben.

Viel Glück dabei, das mit ein paar zusätzlichen Blog-Captions hinzubekommen.

Was Agenturen stattdessen wirklich brauchen

Wenn ich das ganze AI-Theater wegnehme, glaube ich, dass Agenturen ein paar unglamouröse Dinge viel dringender brauchen:

1. Client-sichere Kontext-Isolation

Nicht nur Account Switching.

Nicht nur Ordner.

Nicht nur Copy wie "we take privacy seriously".

Echte Trennung — auf Datenbankebene, nicht auf Anwendungsebene. Ich meine separate Schemas oder separates Routing, nicht eine gemeinsame Tabelle mit einer client_id-Spalte und dem Gebet, dass jede Query korrekt filtert.

2. Rollenbewusste Berechtigungen

Unterschiedliche Menschen brauchen unterschiedliche Zugriffsebenen:

- strategist

- account manager

- approver

- client stakeholder

- admin

Ohne das fühlt sich das Tool in einer Demo vielleicht "collaborative" an und in der Realität chaotisch.

3. Approval Workflows

Agenturen sind keine Solo Creators, die Ideen direkt in die Welt schleudern. Es gibt Drafts, Kommentare, Reviews, Freigaben, Revisionen und Politik. So viel Politik :P

Wenn das AI-System das nicht respektiert, respektiert es Agenturarbeit nicht.

4. Gemeinsame Memory innerhalb der richtigen Grenze

Das ist enorm wichtig.

Innerhalb eines bestimmten Client-Kontexts sollte das System mit der Zeit definitiv schlauer werden. Genau dort wird AI nützlich. Aber dieses Compounding muss innerhalb des richtigen Zauns passieren, nicht undifferenziert über alle Arbeit hinweg.

5. Strategische Intelligence vor Execution

Wieder: nicht anti-Content. Nur anti-Content-first als komplette Story.

Agenturen brauchen Hilfe dabei zu verstehen:

- was der Client sagen sollte

- was der Client betonen sollte

- was sich im Wettbewerbsumfeld tut

- wo die Strategie schwach ist

- wie das Team sich um eine Empfehlung herum ausrichten kann

Das ist viel wertvoller, als den nächsten Stapel generischer Deliverables zu produzieren.

Darum sieht STRAŦUM am Ende so aus, wie es aussieht

Viele Produktentscheidungen in STRAŦUM ergeben mehr Sinn, wenn du sie durch diese Brille ansiehst.

Warum Progressive Learning?

Weil Agenturen Kontext ohnehin schon viel zu oft wiederholen.

Warum Multi-Tenant Routing?

Weil Client-Kontext keine höfliche Empfehlung sein kann.

Warum Approvals und Collaboration?

Weil Agenturarbeit nicht daraus besteht, dass eine Person mit einem Bot in einem Vakuum chattet.

Warum Focus auf Intelligence over Execution?

Weil Agenturen in der Regel nicht gut dafür bezahlt werden, mehr Lärm zu produzieren. Sie werden bezahlt, wenn sie Sicherheit, Richtung und bessere Entscheidungen für Clients schaffen.

Genau diese Art von AI-Produkt will ich für sie bauen.

Nicht die Variante, die sagt: "Schau, wie viel schneller du churnen kannst."

Sondern die Variante, die sagt: "Schau, wie viel sicherer und schärfer deine strategische Arbeit werden kann."

Ich sage nicht, dass ich das alles richtig gemacht habe. Ich sage, dass die Probleme spezifische architektonische Entscheidungen erzwungen haben, die die meisten General-Purpose-AI-Tools noch nicht treffen mussten — oder noch nicht treffen wollten.

Die Sache, die ich mir wuenschte, mehr AI-Vendors würden zugeben

Agency Buyer evaluieren oft gleichzeitig zwei Produkte:

- das Produkt in der Demo

- das zukünftige Problem, das dieses Produkt erzeugen könnte

Darum überzeugt glossy AI-Output allein nicht.

Der Buyer fragt nicht nur: "Kann uns das helfen?"

Er fragt auch: "Kann uns das später schaden?"

Und wenn du diese zweite Frage nicht gut beantworten kannst, ist dein wunderschön generierter Output im Wesentlichen Dekoration.

Ich glaube nicht, dass Agenturen mehr Dekoration brauchen.

Ich glaube, sie brauchen Systeme, denen sie vor Clients vertrauen können.

Das ist ein viel schwereres Produkt zu bauen.

Es ist aber auch, glaube ich, ein sehr viel ehrlicheres.

Das war's von mir.

Ich würde vor allem gern von Agenturmenschen dazu hören. Hat die AI-Tooling, die ihr gesehen habt, Risiko tatsächlich reduziert, oder vor allem nur die Menge an Content erhöht, die euer Team produzieren kann, während die echten operativen Kopfschmerzen exakt da geblieben sind, wo sie vorher schon waren?

Cheers, Chandler