¿Prepárate para una mejor experiencia de búsqueda con la integración de ChatGPT en Microsoft?

La integración de ChatGPT en Bing resuelve los problemas de datos, pero el verdadero desafío es diseñar una interfaz que sepa cuándo dar una sola respuesta frente a varias.

Este artículo fue escrito en 2023. Algunos detalles pueden haber cambiado desde entonces.

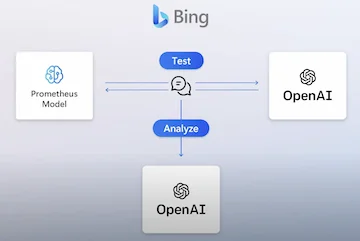

Esta semana, algunos medios informaron que Microsoft está trabajando para incorporar las funciones de ChatGPT en Bing Search. Dado que escribí sobre "¿reemplazará chatGPT a Google?" anteriormente, quiero aportar algunas reflexiones adicionales aquí.

Indexar contenido web ya no es una barrera.

Se informó que Microsoft invirtió $1 mil millones en OpenAI en 2019. Eso significa que la asociación entre las dos empresas lleva en marcha al menos tres años. Bing Search puede indexar la web obviamente, así que debemos asumir que la indexación de contenido web no es un problema si OpenAI quiere ampliar el conjunto de datos de chatGPT más allá de 2021. Dada la escala de Microsoft, también podemos asumir que su capacidad de indexación/rastreo en tiempo real debería ser bastante buena frente a la de Google.

Bing ya tiene imágenes, videos, etc... como parte de su conjunto de datos, así que de nuevo esto no será una barrera para el chatGPT de OpenAI.

Bing Search puede clasificar la fiabilidad del contenido relativamente bien

Aunque no he revisado la comparación más reciente entre los resultados de Google Search y Bing Search, es seguro decir que la brecha entre las capacidades de las dos empresas para determinar la fiabilidad de un contenido no debería ser demasiado grande. Así que, de nuevo, con la ayuda de Microsoft, encontrar la respuesta más precisa puede que no sea una gran barrera para OpenAI/chatGPT.

Un ejemplo concreto es que chatGPT no tiene datos actualizados de valoraciones de servicios, por lo que no puede responder preguntas sobre servicios locales como "mejor fontanero cerca de mí" o "mejor restaurante chino cerca de mí". Aquí es donde el conjunto de datos de Microsoft entra a ayudar.

Un problema de interfaz de usuario

Si bien se puede argumentar que la experiencia de ChatGPT es fácil de usar, no es una experiencia única para todas las consultas. En muchos casos, los usuarios quieren tener múltiples respuestas. Por ejemplo, con el mismo servicio local de antes, los usuarios a menudo quieren ver una lista de opciones adecuadas. Se puede argumentar que en esos casos, los usuarios necesitarían modificar el prompt para ChatGPT a "dame 5 opciones del mejor servicio xyz cerca de mí" frente a "el mejor servicio xyz cerca de mí."

Sin embargo, yo argumentaría que hacer esto no es suficiente. El motor de búsqueda debería ser lo suficientemente inteligente como para saber que en muchos casos no hay una única mejor respuesta ni una lista corta de mejores respuestas. La mejor respuesta depende de la situación/el contexto.

Además, tenemos hechos y tenemos opiniones. Son completamente diferentes entre sí.

Así que cómo diseñar una interfaz de usuario que sea óptima para múltiples escenarios es clave. Por ejemplo, incluso para algo tan sencillo como "receta de baguette vietnamita" :D, esto es lo que obtengo de Google, Bing y ChatGPT a enero de 2023. No es obvio cuál es mejor o si la respuesta de chatGPT es superior.

La clave entonces es cambiar dinámicamente la interfaz de resultados de búsqueda según la intención del usuario, usando machine learning. No sé qué tan fácil o difícil es hacer esto. Pero parece un paso lógico para combinar la fortaleza del estilo de respuesta única de ChatGPT con la de un motor de búsqueda.

Un asistente de lenguaje

Yo argumentaría que proporcionar respuestas desde una perspectiva de búsqueda de información pura no es por qué a la gente le gusta ChatGPT; es la capacidad de darle contexto a chatGPT y luego pedirle que complete una tarea relacionada con el lenguaje, como escribir un poema, una introducción, un ensayo, etc.

Este caso de uso es muy diferente al de un motor de búsqueda y está más relacionado con la capacidad de generar narrativas para PowerPoint o escribir en Microsoft Word. Así que, en realidad, creo que la noticia sobre Microsoft incorporando diferentes capacidades de OpenAI en la suite de Office 365 es la mejor noticia.

Los límites del lenguaje

Jacob Browning y Yann Lecun escribieron un excelente artículo sobre la IA y los límites del lenguaje en agosto de 2022, antes de que ChatGPT se abriera al público. Si bien su artículo hacía referencia a LaMDA, el contenido es esencialmente aplicable a chatGPT también o a cualquier otro modelo de lenguaje grande. El artículo es largo, así que si quieres los puntos clave, aquí están:

Un ingeniero de Google declaró recientemente que el chatbot de IA de Google, LaMDA, era una persona, lo que generó una variedad de reacciones. El chatbot, LaMDA, es un modelo de lenguaje grande (LLM) diseñado para predecir las palabras más probables que seguirán a cualquier línea de texto que se le proporcione.

Algunas personas se burlaron de la idea, mientras que otras sugirieron que la próxima IA podría ser una persona. La diversidad de reacciones pone de relieve un problema más profundo: a medida que estos LLMs se vuelven más comunes y poderosos, hay menos acuerdo sobre cómo entenderlos. El problema de fondo es la naturaleza limitada del lenguaje. Está claro que estos sistemas están condenados a una comprensión superficial que nunca se aproximará al pensamiento pleno que vemos en los humanos. Esto se debe a que el lenguaje es solo un tipo específico y limitado de representación del conocimiento. Sobresale en expresar objetos y propiedades discretas y las relaciones entre ellos, pero tiene dificultades para representar información más concreta, como describir formas irregulares o el movimiento de objetos. Existen otros esquemas de representación, como el conocimiento icónico y el conocimiento distribuido, que pueden expresar esta información de manera accesible.

El lenguaje es un método de transmisión de información de bajo ancho de banda, y a menudo es ambiguo debido a los homónimos y los pronombres. Los humanos no necesitan un vehículo perfecto para la comunicación porque compartimos una comprensión no lingüística. Los modelos de lenguaje grande (LLMs) se entrenan para captar el conocimiento de fondo de cada oración, mirando las palabras y oraciones circundantes para entender qué está pasando. Los LLMs han adquirido una comprensión superficial del lenguaje, pero esta comprensión es limitada y no incluye el saber hacer para conversaciones más complejas. Como resultado, es fácil engañarlos siendo inconsistente o cambiando de idioma. Los LLMs carecen de la comprensión necesaria para desarrollar una visión coherente del mundo.

Si bien el lenguaje puede transmitir mucha información en un formato pequeño, gran parte del conocimiento humano es no lingüístico y puede transmitirse a través de otros medios como diagramas, mapas, artefactos y costumbres sociales. Esto sugiere que una máquina entrenada solo con lenguaje no será capaz de aproximarse completamente a la inteligencia humana porque solo tiene acceso a una pequeña parte del conocimiento humano a través de un estrecho cuello de botella, y que la comprensión no lingüística profunda del mundo es necesaria para que el lenguaje sea útil. También implica que hay límites a qué tan inteligentes pueden llegar a ser las máquinas si se entrenan únicamente con lenguaje.

Eso es todo de mi parte. ¿Qué piensas? ¿Te ves cambiando de Google a un Bing impulsado por ChatGPT, o el hábito te mantiene en Google? :)

Un abrazo,

Chandler