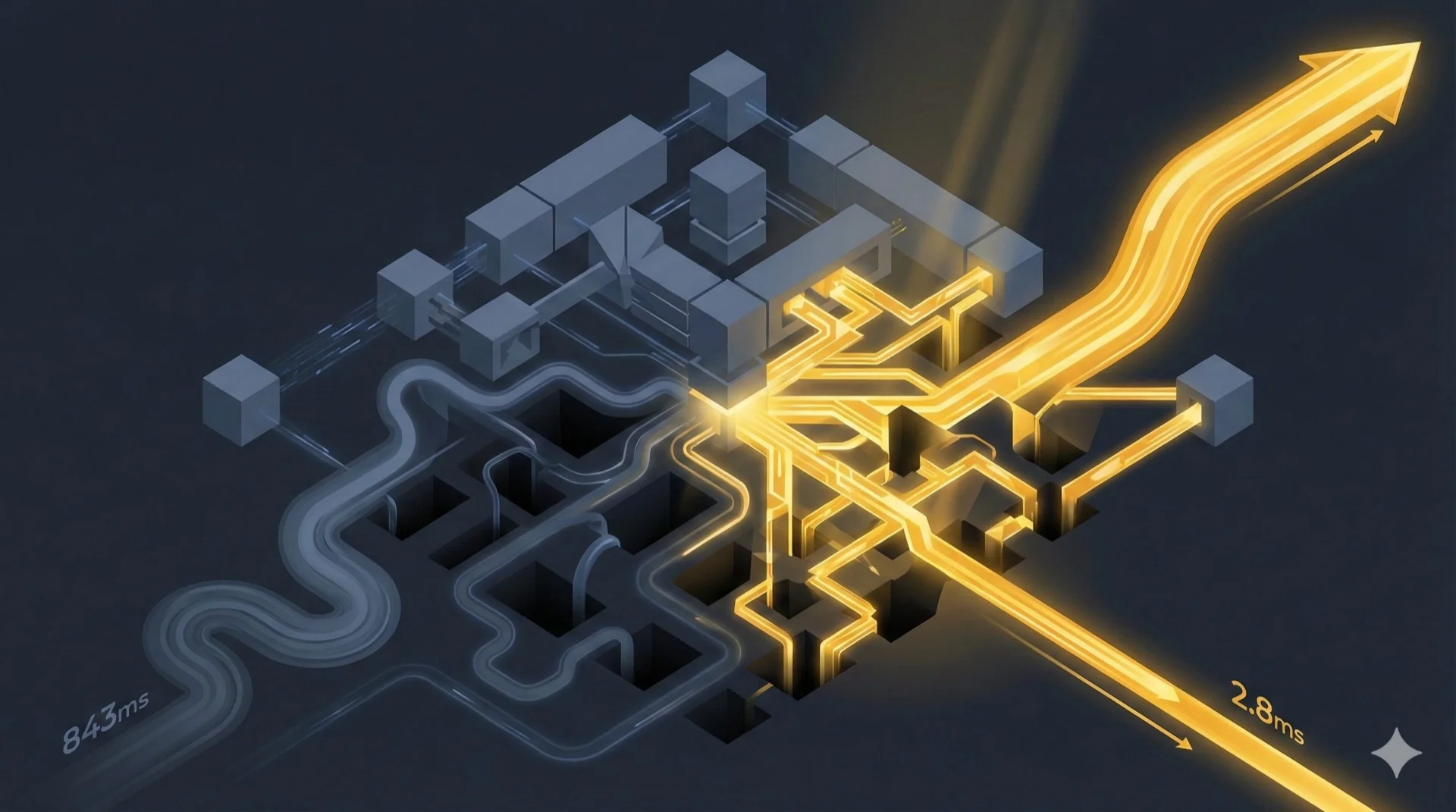

Una IA Sin Memoria Es Solo un Chatbot Caro

Construí 9 agentes de IA que olvidaban todo entre conversaciones — y los usuarios desperdiciaban entre 20 y 45 minutos semanales volviendo a explicar su negocio. Así logré que compartieran memoria.

Ya he construido tres productos de IA — Sydney (mi chatbot personal), DIALØGUE (podcasts generados por IA) y STRAŦUM (una plataforma de marketing intelligence con 9 agentes de IA). Y hay una lección que sigo aprendiendo a las malas: una IA sin memoria es solo un chatbot caro.

La primera vez que esto me golpeó de verdad fue al inicio del desarrollo de STRAŦUM. Tenía dos agentes funcionando que generaban insights realmente útiles, pero no se comunicaban entre sí. Cada conversación empezaba desde cero.

¿Le contabas al Strategy Agent tus planes de expansión de mercado? Excelentes insights. ¿Cambiabas al Content Agent la semana siguiente? Tenías que explicarle tu estrategia de expansión desde el principio otra vez. Era como tener nueve colegas brillantes que todos sufrían de amnesia :P

En realidad, ya había visto una versión de este problema con Sydney. Cuando construí por primera vez su sistema RAG, podía responder preguntas sobre mis posts del blog, pero no recordaba lo que le habías preguntado dos minutos antes. Cada pregunta era un nuevo comienzo. Era... aceptable, supongo. Pero no se sentía como una conversación. Se sentía como interrogar a un buscador.

Con STRAŦUM, este problema se multiplicó por 9. Nueve agentes, cero contexto compartido.

Para cuando llevaba unos dos meses construyendo, había dado con una solución — lo que llamo "aprendizaje progresivo". Le cuentas a un agente sobre un objetivo de negocio, y los nueve agentes lo saben la próxima vez. Sin volver a explicar nada. Sin pérdida de contexto. Creo que esta es la funcionalidad que transformó STRAŦUM de "9 herramientas separadas" en algo que realmente se siente como una plataforma inteligente.

Esta es la historia de cómo lo construí. Puede que me equivoque en algunas de las conclusiones que saco aquí — todavía estoy aprendiendo qué funciona y qué no — pero quiero compartir lo que he descubierto hasta ahora.

El Problema: Los Usuarios se Convirtieron en Máquinas de Documentación

Déjame mostrarte cómo eran las primeras conversaciones en STRAŦUM:

Semana 1 con Strategy Agent:

> Usuario: "Estamos planeando expandirnos al mercado europeo el próximo trimestre"

> Agente: [Genera una estrategia integral de entrada al mercado]

Semana 2 con Content Agent:

> Usuario: "Crea posts de LinkedIn para nuestra campaña"

> Agente: "¿Qué temas deberían cubrir estos posts?"

> Usuario: "...¿nuestra expansión a Europa? ¿Recuerdas? ¿De la semana pasada?"

> Agente: "No tengo contexto sobre la expansión a Europa. ¿Puedes explicarme?"

Tengo que admitir que cuando vi esto por primera vez durante las pruebas, me dio vergüenza. El usuario ya nos había dicho todo. El Strategy Agent lo sabía. La información estaba ahí mismo en nuestra base de datos. Simplemente no estábamos conectando los puntos.

Por mi experiencia con los tres productos que he construido, este es el patrón: a los usuarios no les importa explicar las cosas una vez. Lo que les molesta es explicarlas de nuevo. Hay una diferencia fundamental entre "enseñarle a la IA" y "ser el secretario de la IA".

Hice un cálculo rápido sobre cuánto tiempo se estaba desperdiciando:

- Tiempo promedio de re-explicación: 2-3 minutos por conversación

- Conversaciones por semana: 10-15 entre todos los agentes

- Tiempo desperdiciado por usuario: 20-45 minutos semanales

- Pérdida de productividad anual: 17-39 horas por usuario

A escala, esto se acumula rápido. Para una plataforma con 10.000 usuarios, eso son 170.000-390.000 horas de tiempo humano desperdiciado al año. Aunque esos números estén equivocados a la mitad, son... muchas personas repitiéndose ante una máquina.

---

La Visión: "Díselo a un Agente, Informa a los Nueve"

Entonces empecé a pensar — ¿qué pasaría si los agentes pudieran aprender de las conversaciones de los demás? Ya había visto algo similar funcionar de forma más simple con Sydney: usa RAG para "recordar" mis posts del blog y mi historial profesional. Pero STRAŦUM necesitaba algo más dinámico — no solo recuperar contenido estático, sino capturar nueva información de conversaciones en tiempo real y compartirla entre agentes.

La experiencia ideal que buscaba:

1. El usuario habla de expansión de mercado con Strategy Agent (Día 1)

2. La plataforma captura automáticamente el insight clave de negocio

3. El usuario habla con Content Agent (Día 7)

4. Content Agent ya sabe de los planes de expansión

5. Sin volver a explicar nada. Solo contexto inteligente.

Creo que esto es lo que marca la diferencia entre una herramienta de IA que la gente usa ocasionalmente y una en la que realmente confían. No se trata de funcionalidades sofisticadas — se trata de la parte que te recuerda.

---

Cómo Funciona: La Experiencia del Usuario

Aprendizaje Automático

Esta fue la parte más difícil de hacer bien, siendo honesto. Cada vez que tienes una conversación significativa con cualquier agente, STRAŦUM intenta identificar los insights clave de negocio que vale la pena recordar:

- Planes de expansión de mercado

- Características del público objetivo

- Restricciones presupuestarias

- Posicionamiento competitivo

- Directrices de marca

- Estrategias de precios

- etc

No tienes que hacer nada. La plataforma aprende mientras trabajas. (Bueno, ese es el objetivo. Todavía estoy afinando la parte de "qué vale la pena recordar" — más sobre eso en la sección de lecciones aprendidas.)

Inteligencia Entre Agentes

Esta es la parte que me emociona :D La magia ocurre cuando cambias de agente. ¿Esa restricción presupuestaria que le mencionaste al Performance Agent? El Campaign Agent la conoce cuando recomienda el gasto en publicidad. ¿La expansión de mercado que comentaste con Strategy? El Content Agent la tiene en cuenta en sus recomendaciones de mensajes.

Nueve agentes. Una comprensión compartida de tu negocio.

Me recuerda a cómo funciona DIALØGUE, en realidad — cuando genera un podcast, necesita recordar el área de expertise del usuario, su estilo preferido, su audiencia. Contexto diferente, mismo principio: una IA que te recuerda es fundamentalmente diferente a una que no lo hace.

Así es como se ve en la práctica — cuando inicias una nueva conversación, el contexto relevante de interacciones pasadas está disponible automáticamente:

```python

# Every agent conversation starts with your business context

async def get_business_context(org_id: str) -> str:

"""

Retrieve relevant insights from previous conversations.

Each agent sees what matters for your business.

"""

insights = await fetch_recent_insights(org_id)

# Context flows automatically to every agent

return build_context_summary(insights)

```

La implementación real implica un filtrado cuidadoso y puntuación de relevancia — pero el principio es simple: tus agentes recuerdan lo que importa.

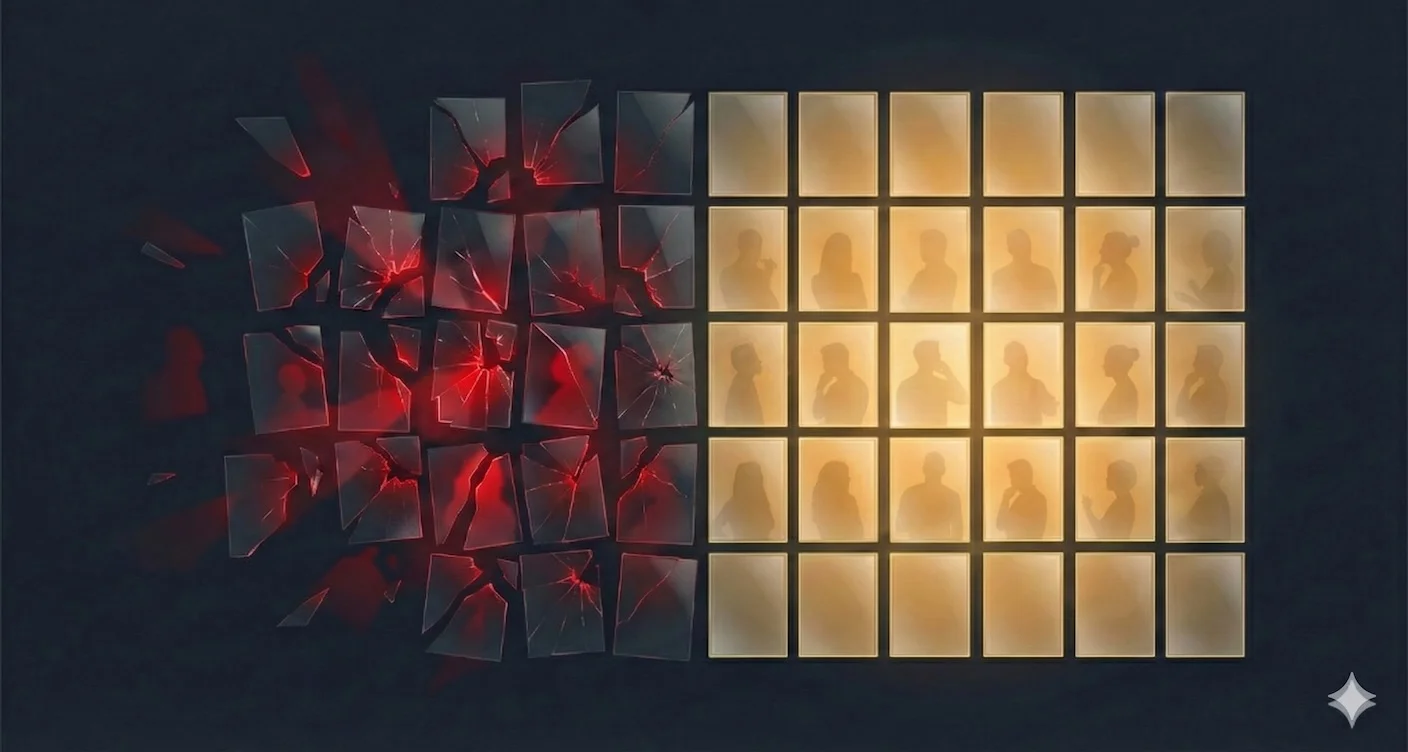

Transparencia Total

Aquí hay algo que aprendí a las malas: la memoria de la IA puede parecer invasiva si no sabes qué se está recordando. Al principio de las pruebas, le mostré el sistema a alguien y su primera reacción fue "espera, ¿qué más sabe sobre mí?" Esa no es la reacción que quieres.

Así que construí transparencia total en el sistema. Aquí está el componente de UI que permite a los usuarios ver y controlar su inteligencia de negocio:

```typescript

// Users see exactly what the platform learned

export function BusinessIntelligenceDashboard() \{

const { insights \} = useBusinessContext();

return (

<div className="space-y-4">

<h2>What STRAŦUM Knows About Your Business</h2>

{insights.map(insight => (

<InsightCard key={insight.id}>

<div className="flex justify-between">

<span className="font-medium">{insight.summary}</span>

<Badge>{insight.source_agent}</Badge>

</div>

<p className="text-sm text-muted">

Learned \{formatDate(insight.created_at)\}

</p>

<Button

variant="ghost"

onClick={() => deleteInsight(insight.id)}

>

Remove this insight

</Button>

</InsightCard>

))}

</div>

);

}

```

- Ver todo: Un panel dedicado muestra exactamente lo que aprendió la plataforma

- Atribución de fuente: Saber qué agente aprendió qué, y cuándo

- Eliminación fácil: Un clic para eliminar cualquier insight que no quieras que se recuerde

- Sin aprendizaje oculto: Todo es visible y revisable

Los usuarios confían en el sistema porque lo controlan.

---

Ejemplos del Mundo Real

Ejemplo 1: Expansión de Mercado

Día 1 - Strategy Agent:

> Usuario: "Estamos planeando expandirnos al mercado europeo el próximo trimestre, empezando por Alemania y el Reino Unido."

> Agente: [Genera una estrategia integral de entrada al mercado]

*La plataforma captura: expansión al mercado europeo planificada, con foco en Alemania y Reino Unido*

Día 7 - Content Agent:

> Usuario: "Crea posts de LinkedIn para el próximo mes"

> Agente: "Veo que estás planeando una expansión a Europa. ¿Deberían estos posts preparar a tu audiencia para tu lanzamiento internacional?"

Sin necesidad de volver a explicar.

Ejemplo 2: Conciencia del Presupuesto

Día 5 - Agente:

> Usuario: "Nuestro presupuesto de marketing es de unos $10k al mes"

> Agente: [Genera un análisis de asignación presupuestaria]

*La plataforma captura: presupuesto mensual de marketing ~$10.000*

Día 15 - Campaign Planning Agent:

> Usuario: "¿Deberíamos hacer publicidad pagada?"

> Agente: "En base a tu presupuesto mensual, recomiendo una asignación equilibrada entre canales pagados y creación de contenido..."

Contexto de presupuesto recordado.

---

El Desafío Multi-Inquilino

El aprendizaje progresivo se complica cuando atiendes tanto a pymes como a agencias.

Para pymes: Sencillo. Toda la inteligencia pertenece a la organización.

Para agencias: La inteligencia de cada cliente debe mantenerse completamente aislada. Una agencia que gestiona al cliente A y al cliente B nunca puede dejar que la estrategia del cliente A informe accidentalmente las recomendaciones del cliente B.

# Agency context is always client-scoped

def get_insights_for_conversation(org_id: str, client_id: str | None):

"""

SMEs: client_id is None, see all org insights

Agencies: client_id filters to specific client only

"""

if client_id:

# Agency user working on specific client

# client A insights NEVER leak into client B context

return fetch_client_insights(org_id, client_id)

else:

# SME user, all org insights available

return fetch_org_insights(org_id)

Esto no es solo una funcionalidad — es un requisito de confianza. Una sola filtración y los usuarios de la agencia pierden la confianza para siempre.

Invertimos mucho en el aislamiento de datos a todos los niveles — lógica de aplicación, políticas de base de datos y pruebas exhaustivas. La inteligencia de negocio del cliente A se queda con el cliente A. Siempre.

---

Por Qué Esto Crea una Ventaja Real

Quiero ser honesto sobre algo: no soy un estratega de SaaS. Soy un constructor que pasó 18 años en publicidad antes de aprender a programar. Pero por mi experiencia construyendo tres productos de IA, creo que el aprendizaje progresivo crea una ventaja real por varias razones.

Rendimientos Crecientes

Cuanto más tiempo usan los usuarios la plataforma, más inteligente se vuelve. Cada conversación añade contexto. Cada insight mejora las conversaciones futuras.

Herramientas de IA tradicionales: La misma experiencia el Día 1 y el Día 100.

Aprendizaje progresivo: Día 1 = bueno. Día 100 = excepcional.

He visto este patrón con Sydney también — su sistema RAG significa que es más útil ahora que hace seis meses, simplemente porque hay más contenido del que puede nutrirse. La memoria se acumula.

Por Qué la Gente se Queda

Una vez que la plataforma conoce tu negocio en profundidad, cambiar a un competidor significa empezar de cero. Pierdes:

- Meses de inteligencia acumulada

- Contexto sobre tu estrategia de mercado

- Insights de audiencia construidos a través de los agentes

- Restricciones presupuestarias y objetivos

Después de 30 días de uso regular, la plataforma captura la mayor parte del contexto de tu negocio. Creo que por eso la gente se queda — no porque esté atrapada, sino porque empezar de nuevo en otro lugar realmente se siente como un paso atrás.

Efectos de Red Dentro de las Organizaciones

Para las agencias que gestionan múltiples clientes (y esto me toca de cerca — pasé la mayor parte de mi carrera en agencias), el aprendizaje progresivo se multiplica:

- La inteligencia de cada cliente se acumula de forma independiente

- Cada relación con un cliente profundiza el valor de la plataforma

- El valor escala con el tamaño del portafolio

Una agencia con 10 clientes obtiene 10 veces el beneficio de un único usuario.

Difícil de Replicar

Puede que me equivoque en esto, pero creo que construir aprendizaje progresivo requiere una integración profunda en:

- Generación de respuestas de IA

- Procesamiento en segundo plano

- Aislamiento de datos multi-inquilino

- Interfaces de control de usuario

- Compartición de contexto entre agentes

No es algo que puedas añadir después. Está tejido en la arquitectura desde el principio.

---

El Impacto en el Negocio

Aquí están los números que estoy siguiendo (siempre intento ser específico con estas cosas):

Tiempo ahorrado por usuario:

- Antes: 2-3 minutos re-explicando por conversación

- Conversaciones por semana: 10-15

- Tiempo ahorrado al año: 17-39 horas por usuario

Lo Que Espero en Cuanto a Retención

Seré honesto — todavía no tengo suficientes datos para probarlo definitivamente. STRAŦUM sigue en alpha. Pero mi hipótesis, basada en lo que he visto hasta ahora:

- Los usuarios que acumulan insights guardados significativos son menos propensos a cambiar

- Cuanto más contexto se haya invertido, más difícil se vuelve empezar de nuevo en otro lugar

- El aprendizaje progresivo debería correlacionarse directamente con la retención

Estoy siguiendo esto de cerca. Si me equivoco, escribiré sobre eso también :P

Lo que hace que esto sea realmente útil (más allá de los números):

- Ya no tienes que ser el secretario de tu IA

- El contexto se acumula naturalmente con el tiempo

- La plataforma mejora cuanto más la usas — sin esfuerzo adicional de tu parte

---

Lecciones Aprendidas (A las Malas)

Estos no son insights teóricos — son errores que realmente cometí.

1. La Memoria de IA Requiere Control del Usuario

Las primeras versiones se sentían como vigilancia. Se lo mostré a un amigo y sus palabras exactas fueron "esto da miedo." No es el feedback que quieres.

La solución: Transparencia total. Mostrar todo. Dejar que los usuarios eliminen lo que quieran. Sin aprendizaje oculto.

Resultado: Los usuarios confían en el sistema porque lo controlan. (Debería haberlo sabido — tuve el mismo instinto cuando construí la interfaz de conversación de Sydney. La gente quiere ver qué pasa entre bastidores.)

2. Calidad Sobre Cantidad

Mi primer instinto fue recordar todo. Cada frase. Cada detalle. Soy de los que piensan que "más datos es mejor" — 18 años en analítica hacen eso contigo. Pero era abrumador y sin foco.

La solución: Solo capturar insights de alta confianza y estratégicamente relevantes. La calidad supera a la cantidad.

Resultado: Contexto enfocado que realmente mejora las conversaciones.

3. Menos Contexto es a Menudo Mejor

Este me sorprendió. Inyectar demasiado contexto en las conversaciones hacía que las respuestas fueran lentas y sin foco. Resulta que cuando le das a Claude una pared de información de fondo, intenta referenciar todo — incluso cuando la mayoría no es relevante.

La solución: Curar cuidadosamente. Solo incluir lo que es relevante para la conversación actual.

Resultado: Respuestas más rápidas, recomendaciones más enfocadas. Todavía estoy encontrando el equilibrio adecuado.

4. El Aislamiento Multi-Inquilino No Es Negociable

Un bug en el aislamiento de datos podría destruir la confianza del usuario permanentemente. Viniendo del mundo de las agencias, sé lo seria que es la confidencialidad del cliente. Una agencia que gestiona al cliente A y al cliente B nunca puede tener datos filtrándose entre ellos.

La solución: Defensa en profundidad. Múltiples capas de aislamiento. Pruebas exhaustivas.

Resultado: Cero incidentes de filtración entre clientes. (Esta es un área donde no me ando con rodeos — el aislamiento tiene que ser perfecto.)

---

¿Cuándo Tiene Sentido la Memoria en IA?

Si estás construyendo un producto de IA y te preguntas si invertir en memoria, aquí está mi opinión honesta. El aprendizaje progresivo tiene sentido si:

✅ Tienes múltiples puntos de contacto de IA que podrían beneficiarse del contexto compartido

✅ Los usuarios tienen interacciones repetidas a lo largo de días/semanas/meses

✅ El contexto acumula valor (estrategia de negocio, preferencias, restricciones)

✅ Retener usuarios importa más que adquirir nuevos

✅ Atiendes a organizaciones (equipos, agencias, empresas)

❌ No lo hagas si:

- Interacciones de un solo uso (sin compromiso repetido)

- El contexto no acumula valor

- Las preocupaciones de privacidad superan la conveniencia

- No puedes invertir en un aislamiento de datos adecuado (y me refiero a realmente invertir — no es algo que se hace a medias)

---

Reflexiones Finales

El aprendizaje progresivo transformó STRAŦUM de "9 agentes de IA separados" en algo que realmente se siente como una plataforma inteligente. El usuario lo dice una vez. El sistema lo recuerda (o hasta que lo eliminen).

Creo que esa es la diferencia entre una herramienta y una plataforma. Entre una transacción y una relación. Entre "lo uso a veces" y "no puedo trabajar sin esto." Pero todavía estoy al principio de este camino — STRAŦUM está en alpha y aprendo cosas nuevas sobre qué funciona cada semana.

Construir la memoria de IA fue difícil. El aislamiento multi-inquilino añadió complejidad. La base multi-inquilino sobre la que todo esto descansa fue su propia aventura — desde la decisión de arquitectura del Día 2 hasta reconstruirla completamente en el Día 67. ¿Pero el resultado? Una plataforma que se vuelve más inteligente cuanto más la usas.

Díselo a un agente. Informa a los nueve.

Tengo curiosidad — si estás construyendo productos de IA, ¿has abordado el problema de la memoria? ¿Qué enfoques te han funcionado? Me interesa genuinamente porque todavía estoy descubriendo la mejor forma de decidir qué vale la pena recordar versus qué es ruido. Cuéntame.

---

Pruébalo Tú Mismo

Una cosa es leer sobre el aprendizaje progresivo. Otra es experimentarlo.

STRAŦUM está actualmente en privado. Estoy trabajando con un pequeño grupo de fundadores de pymes y equipos de agencias para refinar la experiencia antes del lanzamiento público.

Si estás cansado de volver a explicarle tu negocio a herramientas de IA que olvidan todo entre sesiones, me encantaría que lo probaras.

Lo que obtendrás:

- Acceso completo a los 9 agentes de IA

- Aprendizaje progresivo que realmente recuerda tu negocio

- Línea directa conmigo para feedback y solicitudes de funcionalidades

Estoy aceptando nuevos usuarios alpha de forma continua. Los cupos son limitados — quiero darle atención personal a todos durante esta fase.

Un abrazo,

Chandler