Voy a cancelar mi plan de $200 de Claude Code tras dos semanas con Codex

Dos semanas despues de mi comparacion original, ambas herramientas lanzaron actualizaciones importantes. Codex desafio mi estrategia de producto de formas que Claude Code no lo hizo. Claude Code lanzo Agent Teams y AutoMemory. El resultado: voy a reducir mi plan Max de $200/mes — y estoy obteniendo mejores resultados por menos dinero.

Hace dos semanas escribi sobre usar Codex y Claude Code en paralelo. Ese post conecto mas que cualquier cosa que haya escrito — resulta que mucha gente esta haciendo el mismo experimento.

En ese momento, mi modelo de trabajo era claro: Claude Code para calidad de ejecucion y QA, Codex para razonamiento arquitectonico y planes sostenidos. Ambas herramientas, fortalezas distintas, revision cruzada entre modelos para trabajo importante.

Dos semanas despues, ambas herramientas han lanzado actualizaciones significativas y el equilibrio ha cambiado. No dramaticamente — pero lo suficiente como para valer la pena escribir al respecto. (Para que conste, estoy redactando este post en Claude Code — no por lealtad, sino porque mi ciclo de facturacion actual sigue activo y no quiero desperdiciar dinero ya comprometido. Ese tipo de calculo practico es exactamente el punto de este post.)

Marzo de 2026 fue intenso para ambas plataformas. Codex lanzo plugins con integraciones para Slack, Gmail, Linear, Figma, Sentry y mas — ademas de Triggers para flujos automatizados de GitHub, modelos GPT-5.4 mini y nano, y soporte nativo para Windows. Claude Code lanzo Agent Teams (orquestacion multi-agente, aun experimental), AutoMemory, Computer Use (solo macOS, planes Pro/Max), Scheduled Tasks via /loop, y unas 10 versiones solo en marzo. Ambas plataformas se mueven rapido.

La historia del newsletter (por que esto no se trata solo de codigo)

La observacion que cambio mi forma de pensar no tuvo nada que ver con escribir codigo.

Mi sitio tiene un sistema completo de newsletter — formulario de suscripcion, CTAs en los posts, email de bienvenida, cron diario, doble opt-in, soporte para 13 idiomas. Tecnicamente, todo funciona. El problema: cero suscriptores verificados.

Elabore un plan para arreglar esto: extraer un lead magnet en PDF de mi curso, poner el Modulo 1 detras de un email, agregar CTAs en medio de los articulos, conectar el chatbot de IA al flujo de suscripcion, redistribuir a traves de YouTube y LinkedIn. Siete cosas nuevas.

Construi este plan con Claude Code. Se sintio productivo.

Luego le di el mismo brief a Codex. El cuestionamiento fue inmediato.

El lead magnet era redundante — el Modulo 1 ya es gratis. Demasiadas superficies a la vez — si construyes las siete, no puedes saber cual funciona. El problema no es la infraestructura, es el copy. "Stay in the loop" es generico. El email de verificacion no es lo suficientemente persuasivo. La seleccion de intereses agrega friccion.

El plan de Codex: arreglar primero lo que ya existe (reescribir el copy, mejorar el email de verificacion, reducir friccion), agregar una sola superficie nueva (un CTA inline en el blog), medir con eventos de GA antes de construir cualquier otra cosa.

Mi plan era "construir mas cosas." El plan de Codex era "hacer que las cosas existentes funcionen mejor, luego probar una cosa nueva." El mio habria tomado una semana sin forma de saber que funciono. El de Codex se puede lanzar en un dia y te dice exactamente donde invertir despues.

Tengo que admitir — esto me tomo por sorpresa. No porque Claude sea malo en estrategia. Creo que si hubiera formulado el prompt con mas cuidado — "cuestiona mis suposiciones antes de ejecutar" — podria haber obtenido un cuestionamiento similar. Pero el estilo de razonamiento por defecto era notablemente diferente. GPT-5.4 por defecto tiende a "cuestionar la premisa." Claude por defecto tiende a "ejecutar bien el plan."

Esa distincion importa para decisiones de producto.

Velocidad y control en tiempo real

Dos cosas que he notado y que afectan el flujo de trabajo diario mas de lo esperado.

Velocidad y eficiencia de tokens: Codex con GPT-5.4 en pensamiento alto es consistentemente mas rapido que Opus 4.6 en pensamiento alto para tareas equivalentes. Comparaciones de terceros sugieren que Codex usa aproximadamente 3 veces menos tokens para trabajo similar — un benchmark midio 1.5 millones de tokens en una tarea tipo Figma donde Claude uso 6.2 millones. Claude "piensa en voz alta" mas, lo que produce razonamiento de mayor calidad pero consume los limites mas rapido. A partir del 20 de marzo, Opus parece estar haciendo mas llamadas a herramientas de lo habitual — mas pasos intermedios antes de llegar a la respuesta. No se si es un cambio en el modelo o una coincidencia, pero es perceptible.

Control en tiempo real: Cuando envio un mensaje nuevo mientras la herramienta esta trabajando — "espera, no por ahi, intenta esto otro" — Codex lo lee casi de inmediato y se ajusta. Claude Code tiende a terminar su ejecucion actual antes de leer la correccion.

Suena menor. No lo es. Cuando estas viendo a un agente ir por el camino equivocado y quieres corregir el rumbo, el retraso entre "lee tu correccion ahora" y "la lee despues de terminar la operacion actual" se acumula a lo largo de una sesion completa de trabajo.

El bug de SSE: un ejemplo concreto

Estaba construyendo una nueva app para iOS. Claude Code habia producido 40 archivos Swift cubriendo todas las funcionalidades — auth, agentes, chat, frameworks, dashboard, perfil. Amplitud impresionante. Pero quedaba un bug critico: el streaming SSE para chat en tiempo real no funcionaba.

El backend estaba bien. Curl funcionaba. Pero URLSessionDataDelegate.didReceive(data:) no se disparaba en el cliente Swift. Claude Code trabajo en esto durante horas. Multiples enfoques, multiples sesiones de depuracion.

Le di el mismo problema a Codex. Unos intentos despues: commit 7f592152 — "fix(ios): restore real-time chat streaming."

¿Es esto representativo? Quizas no. Toda herramienta tiene dias buenos y dias malos. Pero en mi experiencia, cuando Claude Code se queda atascado en un ciclo de depuracion — intentando variaciones cada vez mas ingeniosas del mismo enfoque — cambiar a Codex a menudo rompe el estancamiento porque GPT-5.4 enmarca el problema de forma diferente desde el inicio.

Donde Claude Code sigue ganando

Seria facil leer este post y concluir que Codex esta avanzando en todos los frentes. Eso seria incorrecto. Claude Code tambien avanzo fuerte este mes, y varias de sus ventajas de hecho han crecido.

Agent Teams. Esto se lanzo en febrero y ha ido madurando durante marzo. Multiples instancias de Claude Code trabajando en paralelo — un explorador, un revisor de codigo, un implementador, un ejecutor de tests — con seguimiento de dependencias y listas de tareas compartidas. Todavia es experimental y esta deshabilitado por defecto, pero cuando se activa, es genuinamente impresionante. Codex tambien tiene soporte multi-agente (las tareas corren en contenedores aislados en la nube), pero los Agent Teams de Claude Code se sienten mas coordinados. Para refactorizaciones grandes que tocan muchos archivos, Agent Teams es actualmente la mejor experiencia.

AutoMemory. Claude Code ahora escribe automaticamente reglas de memoria basadas en tus habitos. Despues de unas sesiones, conoce la estructura de tu proyecto, tus convenciones de nombres, tus preferencias. Es sutil, pero el efecto acumulativo es que las sesiones de Claude Code se vuelven mas productivas con el tiempo de una forma que las sesiones de Codex actualmente no logran.

Diseno frontend. Claude Code con el plugin /frontend-design sigue produciendo UI notablemente mas pulida, mas consciente del sistema de diseno, que Codex con el skill equivalente. Lo probe directamente durante un rediseno del sitio el 26 de marzo. El output de Claude tenia mejor composicion espacial, estilos mas consistentes y un resultado mas cohesivo. Puede ser una ventaja del harness (el sistema de plugins de Claude ejecuta el skill con mas contexto), pero el resultado practico es claro.

Calidad de codigo. Un analisis comunitario de mas de 500 comentarios de desarrolladores en Reddit encontro que los desarrolladores preferian el output de Claude Code en aproximadamente el 67% de las comparaciones a ciegas — destacando codigo mas limpio, mas idiomatico y mejor estructurado. Eso coincide con mi experiencia. Cuando el codigo necesita ser mantenible, no solo funcional, Claude Code tiene ventaja.

QA automatico. Sigue siendo la funcionalidad estrella. Despues de completar el trabajo, Claude Code automaticamente despacha agentes de revision — revision de codigo, verificaciones de consistencia, analisis de brechas — sin que yo lo pida. Codex aun no hace esto. Para cualquier cosa donde la correccion importa mas que la velocidad, esto solo ya mantiene a Claude Code en el flujo de trabajo.

La cuestion de la confiabilidad

Quiero compartir algo que la mayoria de los posts comparativos evitan.

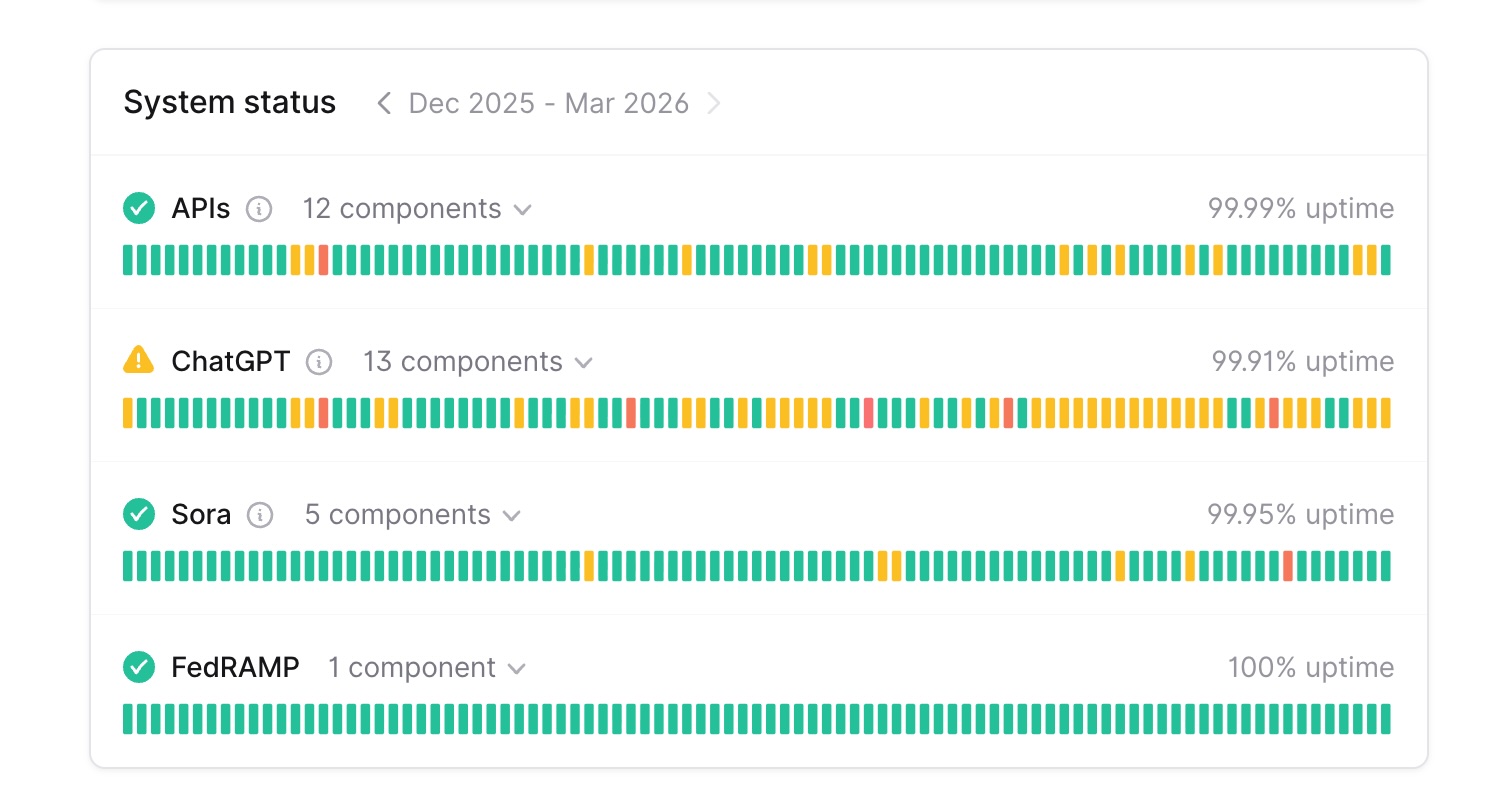

Aqui estan los numeros de uptime de 90 dias de ambas paginas de estado a finales de marzo de 2026:

| Servicio | Anthropic | OpenAI |

|---|---|---|

| Plataforma principal | claude.ai: 99.16% | ChatGPT: 99.91% |

| API | api.anthropic.com: 99.24% | APIs: 99.99% |

| Herramientas de desarrollo | Claude Code: 99.48% | — |

| Consola | platform.claude.com: 99.41% | — |

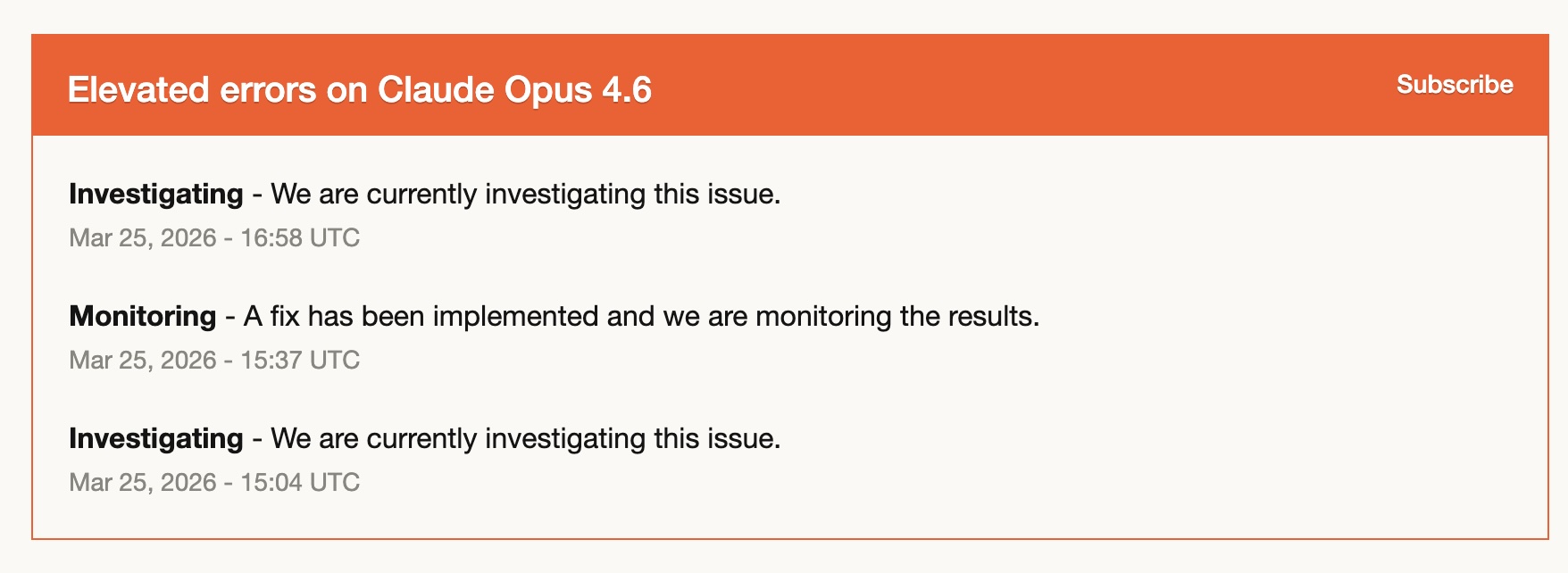

La brecha es real. En 90 dias, los servicios de Anthropic experimentaron aproximadamente 8-10 veces mas tiempo de inactividad que los de OpenAI. El 25 de marzo, hubo un incidente especifico — "Elevated errors on Claude Opus 4.6" — con un ciclo de investigando-arreglando-investigando que duro casi dos horas.

Para ser justos, esto no es la imagen completa. La confiabilidad no es solo uptime. Phantom Labs de BeyondTrust divulgo publicamente una vulnerabilidad de inyeccion de comandos en Codex que podria haber expuesto tokens de autenticacion de GitHub a traves de la manipulacion de nombres de ramas. La falla afectaba la UI web, CLI, SDK e integraciones de IDE — un nombre de rama controlable por el usuario se pasaba directamente a un comando de shell sin sanitizacion. OpenAI lo parcheo, pero es un recordatorio de que estabilidad y seguridad son dimensiones diferentes de la confiabilidad, y ambas importan.

Comparto los datos de uptime no para criticar a Anthropic. Uso Claude Code todos los dias y sigue siendo excelente. Pero para cualquiera que este construyendo su flujo de trabajo profesional alrededor de estas herramientas, vale la pena conocer los numeros. Y es exactamente por esto que usar ambas herramientas no es solo algo agradable de tener — cuando un servicio tiene una mala tarde, cambias al otro y sigues trabajando. Lo he hecho tres veces en dos semanas.

La brecha de plugins se esta cerrando

En mi post original, note que el ecosistema de plugins de Claude Code era mas maduro. Eso era cierto hace dos semanas. Es menos cierto hoy.

Codex lanzo su sistema de plugins el 27 de marzo con integraciones para Slack, Gmail, Google Drive, Linear, Figma, Sentry, Notion y Hugging Face. Ademas de skills, hooks (incluyendo eventos SessionStart y UserPromptSubmit), servidores MCP y un directorio de plugins tanto en la app como en el CLI.

El conjunto de funcionalidades esta convergiendo. Ambas herramientas ahora tienen: plugins/skills para flujos de trabajo reutilizables, hooks para automatizacion basada en eventos, integracion con servidores MCP, e integraciones a nivel de aplicacion con servicios externos.

Donde Claude Code sigue liderando: el ecosistema de plugins existente es mas profundo. Plugins como Superpowers (planificacion estructurada), /feature-dev (desarrollo guiado) y /frontend-design han sido refinados durante meses. El directorio de plugins de Codex es mas nuevo y los plugins individuales estan menos probados en batalla.

Donde Codex esta tomando la delantera: Triggers. Codex puede responder automaticamente a eventos de GitHub — llega un issue, Codex lo arregla automaticamente, abre un PR. Eso es una nueva categoria de automatizacion que Claude Code aun no ofrece. Para equipos que quieren flujos de trabajo de ingenieria autonomos, Triggers son un diferenciador significativo.

Mi modelo de trabajo actualizado

Hace dos semanas, dividi el trabajo aproximadamente 60/40 Claude Code/Codex. Tenia un modelo mental claro: recurre a Claude Code cuando necesites calidad, recurre a Codex cuando necesites razonamiento arquitectonico.

Esa division clara se ha disuelto. Ahora uso ambas a lo largo del dia, cambiando mas por instinto que por reglas. Codex para una tarea, Claude Code para la siguiente, a veces ambas revisando el mismo plan. Las herramientas estan lo suficientemente cerca en capacidad que la pregunta "¿cual deberia usar para esto?" importa menos que hace dos semanas.

Lo que cambio es la economia.

El plan Plus de OpenAI cuesta $20/mes con limites cada vez mas generosos. Me he encontrado recurriendo a Codex cada vez mas — no porque sea dramaticamente mejor en algo especifico, sino porque la combinacion de velocidad, eficiencia de tokens y ese precio de $20 elimina la friccion. No hay calculo mental de "¿vale la pena gastar tokens de Claude Code en esta tarea?"

Me inclino a reducir mi plan de Claude Code del nivel Max de $200/mes al plan de $100/mes, posiblemente incluso al plan Pro de $20/mes. Hace dos semanas, eso habria parecido arriesgado. Ahora se siente practico. El trabajo para el que necesito que Claude Code sea excelente — diseno frontend, orquestacion de Agent Teams, el QA automatico que detecta cosas que yo pasaria por alto — esas son ventajas reales. Pero puede que no requieran $200/mes si Codex maneja la mitad de mi carga de trabajo a $20.

Soy consciente de que esta apuesta tiene riesgos. El nivel de $20 de Claude Code tiene limites reales de uso — si los alcanzo durante una sesion critica, me arrepentire del downgrade. Y los generosos limites de $20 de OpenAI son probablemente una jugada de cuota de mercado que puede no durar para siempre. Pero ahora mismo, la economia favorece usar ambas herramientas.

El costo total ($20 Codex + $100 o incluso $20 Claude Code) seria menos de lo que estaba pagando por Claude Code solo. Y el output combinado es mejor que el de cualquiera de las dos herramientas por separado a cualquier precio.

Esa es quizas la conclusion mas practica de dos semanas usando ambas herramientas: la competencia no solo esta mejorando las herramientas. Las esta abaratando. Y mas barato significa que puedes permitirte ambas.

Que espero a continuacion

Ambas plataformas estan acelerando. Codex acaba de lanzar plugins, triggers y un cliente para Windows. Claude Code acaba de lanzar Agent Teams, AutoMemory, Computer Use y Scheduled Tasks. Ninguno se queda quieto.

Un tema recurrente en las comunidades de desarrolladores en Reddit — y creo que captura algo real — es que "Claude Code tiene mayor calidad pero te topas con los limites. Codex tiene calidad ligeramente inferior pero es mas usable en el dia a dia." El equilibrio cambia a medida que ambos mejoran.

Mi consejo sigue siendo el mismo que en el primer post, pero mas firme ahora: prueba la otra herramienta por una semana. No para cambiar — para agregar. El flujo de trabajo de revision cruzada entre modelos sigue siendo el mejor descubrimiento que he hecho. Y la resiliencia operacional de tener dos herramientas en las que confias te salvara el dia que una de ellas se caiga.

Como usuario, esta es la mejor situacion posible. Dos herramientas excelentes mejorando rapido, cada una empujando a la otra hacia adelante. El ritmo de la competencia es tan feroz que no creo que ninguna empresa pueda mantenerse comodamente a la cabeza por mucho tiempo — y es exactamente por eso que apostar por una sola herramienta se siente cada vez mas arriesgado y apostar por el flujo de trabajo (usar ambas, revision cruzada entre modelos) se siente cada vez mas acertado.

Preguntas frecuentes

¿Ha cambiado tu opinion desde el primer post?

La tesis central — usar ambas herramientas es mejor que elegir un ganador — solo se ha fortalecido. Lo que cambio es la division (60/40 paso a 50/50) y las razones. La fortaleza de Codex en razonamiento estrategico me sorprendio mas que sus mejoras en codigo.

¿Es Codex mas rapido que Claude Code?

Con pensamiento alto, si — consistentemente mas rapido, y comparaciones de terceros sugieren que usa aproximadamente 3 veces menos tokens para tareas equivalentes. Con pensamiento por defecto, la diferencia es menor. Para trabajo iterativo donde vas y vienes frecuentemente, la velocidad y eficiencia de tokens se acumulan.

¿Deberia preocuparme por el uptime de Claude Code?

Los numeros de 90 dias muestran una brecha real (99.2% vs 99.9%). Si Claude Code es tu unica herramienta y estas trabajando contra un deadline, ten un plan de respaldo. Pero Anthropic lanzo unas 10 versiones de Claude Code solo en marzo — estan iterando rapido en funcionalidades aunque la confiabilidad este detras de OpenAI.

¿Que hay de la vulnerabilidad de seguridad de Codex?

Una falla de inyeccion de comandos en Codex podria haber expuesto tokens de GitHub a traves de nombres de ramas. Fue descubierta y corregida. Vale la pena saberlo, pero tambien vale la pena notar que los investigadores de seguridad prueban activamente estas herramientas — lo cual es algo bueno para el ecosistema.

¿La historia de la estrategia del newsletter es realmente sobre las herramientas?

En parte. Diferentes modelos tienen diferentes estilos de razonamiento por defecto. GPT-5.4 era mas propenso a cuestionar mis suposiciones. Claude era mas propenso a ayudarme a ejecutar bien mi plan. Ambos son utiles — pero para estrategia de producto, "¿estas resolviendo el problema correcto?" a menudo es mas valioso que "aqui tienes una buena implementacion."

¿Que herramienta deberia comprar?

Ambas. No es una respuesta evasiva — es genuinamente la mejor respuesta. Codex a $20/mes mas Claude Code a $20-100/mes te da mejores resultados que cualquiera de las dos herramientas sola a cualquier precio. Me inclino a bajar de $200/mes en Claude Code a $100 o incluso $20, y agregar Codex a $20. El costo total baja y el output sube. Dicho esto, los generosos limites de OpenAI puede que no duren — asi que mantente flexible.

Eso es todo por mi parte. Si has estado haciendo tu propio experimento con ambas herramientas, me encantaria saber como esta evolucionando tu division. ¿Los mismos patrones, o algo completamente diferente?

Cheers, Chandler