Prépare-toi à une meilleure expérience de recherche avec l'intégration de ChatGPT chez Microsoft ?

L'intégration ChatGPT-Bing résout les problèmes de données, mais le vrai défi réside dans la conception d'une interface qui sait quand donner une réponse unique plutôt qu'une liste de résultats.

Cet article a ete ecrit en 2023. Certains details ont pu changer depuis.

Cette semaine, certains médias ont rapporté que Microsoft travaille à intégrer les fonctionnalités de ChatGPT dans Bing Search. Ayant écrit sur la question « ChatGPT va-t-il remplacer Google ? » dans le passé, je veux apporter ici des réflexions supplémentaires.

L'indexation du contenu web n'est plus un obstacle.

Microsoft a apparemment investi 1 milliard de dollars dans OpenAI dès 2019. Ce partenariat entre les deux entreprises dure donc depuis au moins trois ans. Bing Search peut évidemment indexer le web, nous pouvons donc supposer que l'indexation du contenu web n'est pas un problème si OpenAI souhaite étendre le jeu de données de ChatGPT au-delà de 2021. Compte tenu de l'envergure de Microsoft, on peut supposer que ses capacités d'indexation en temps réel sont également assez bonnes par rapport à celles de Google.

Bing dispose déjà d'images, de vidéos, etc. dans son jeu de données, ce qui là encore ne constituera pas un obstacle pour OpenAI/ChatGPT.

Bing Search peut évaluer la fiabilité du contenu relativement bien

Sans avoir examiné la comparaison la plus récente entre les résultats de Google Search et de Bing Search, on peut affirmer que l'écart entre les capacités des deux entreprises à déterminer la fiabilité d'un contenu ne devrait pas être trop important. Donc là encore, avec l'aide de Microsoft, trouver la réponse la plus précise ne devrait pas constituer un grand obstacle pour OpenAI/ChatGPT.

Un exemple concret : ChatGPT ne dispose pas de données de notation de services actualisées, il ne peut donc pas répondre à des questions sur les services locaux comme « meilleur plombier près de moi » ou « meilleur restaurant chinois près de moi ». C'est là que le jeu de données de Microsoft vient en aide.

Un problème d'interface utilisateur

S'il est valable d'argumenter sur la convivialité de l'expérience ChatGPT, ce n'est pas une solution universelle pour toutes les questions. Dans de nombreux cas, les utilisateurs souhaitent avoir plusieurs réponses. Par exemple, avec le même service local mentionné ci-dessus, les utilisateurs veulent souvent voir une liste de choix appropriés. On pourrait soutenir que dans ces cas, les utilisateurs doivent alors modifier leur prompt pour ChatGPT : « donne-moi 5 choix du meilleur service xyz près de moi » plutôt que « le meilleur service xyz près de moi ».

Je soutiens cependant que cela ne suffit pas. Le moteur de recherche devrait être suffisamment intelligent pour savoir que dans de nombreux cas, il n'y a pas de réponse unique ou de courte liste de meilleures réponses. La meilleure réponse dépend de la situation et du contexte.

De plus, nous avons des faits et nous avons des opinions. Ces deux catégories sont entièrement différentes l'une de l'autre.

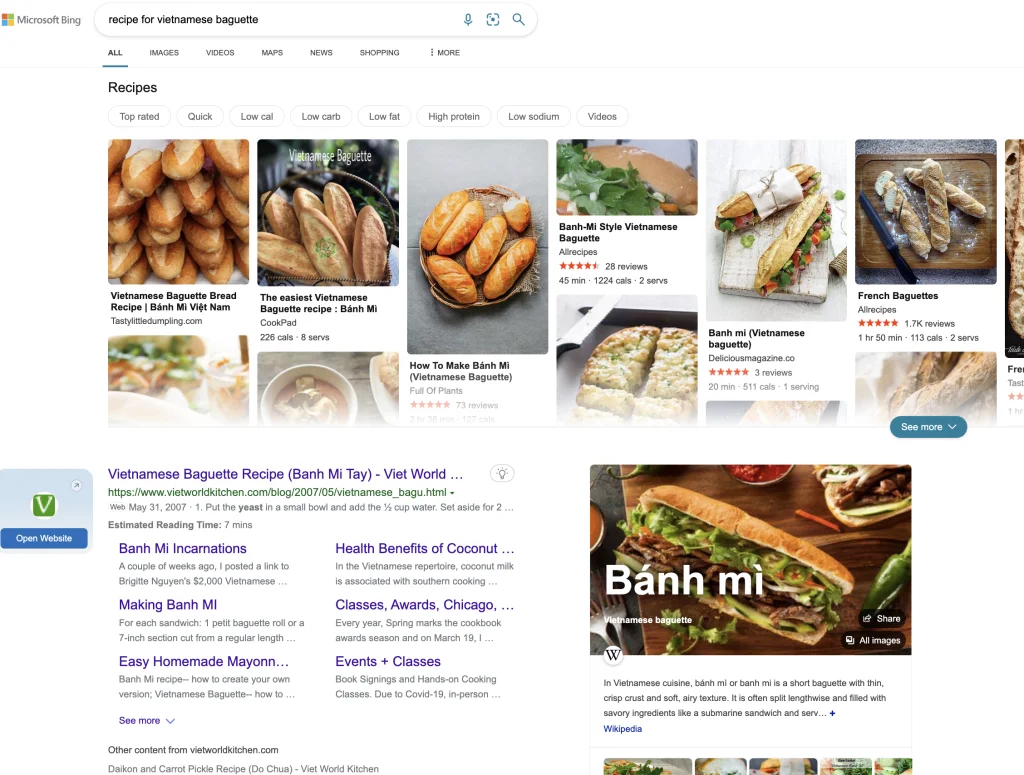

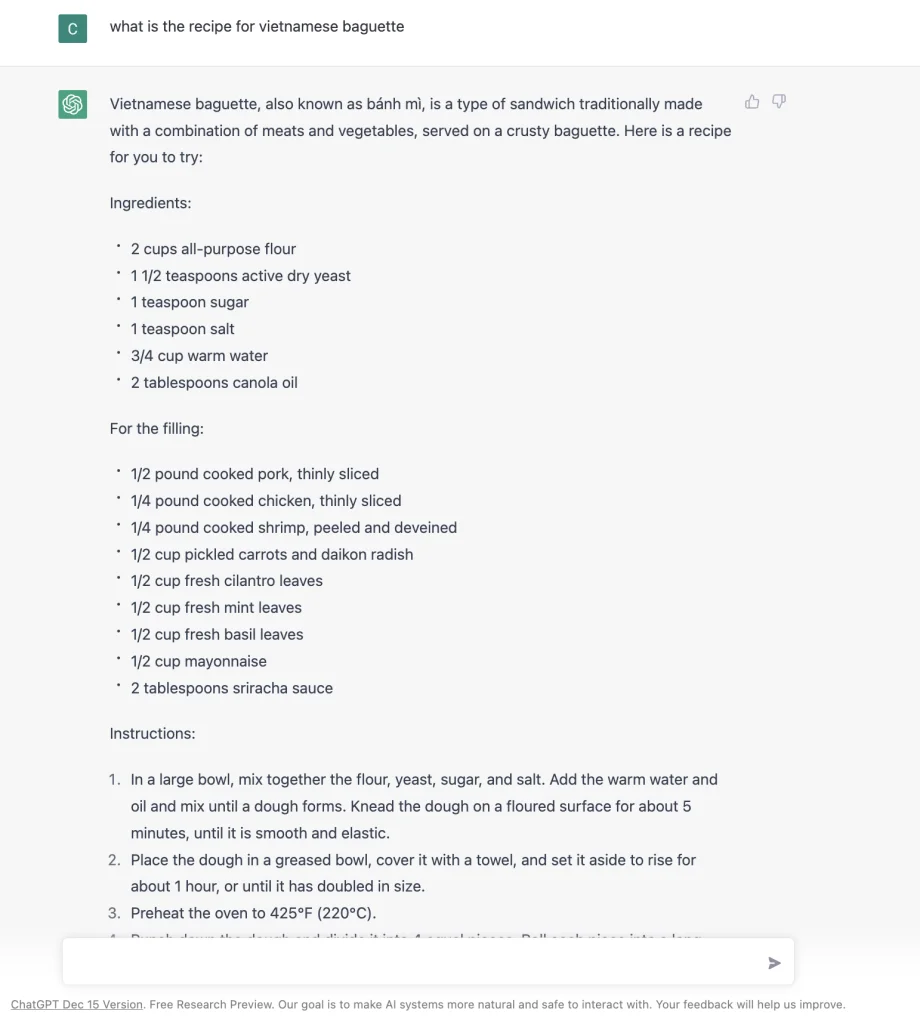

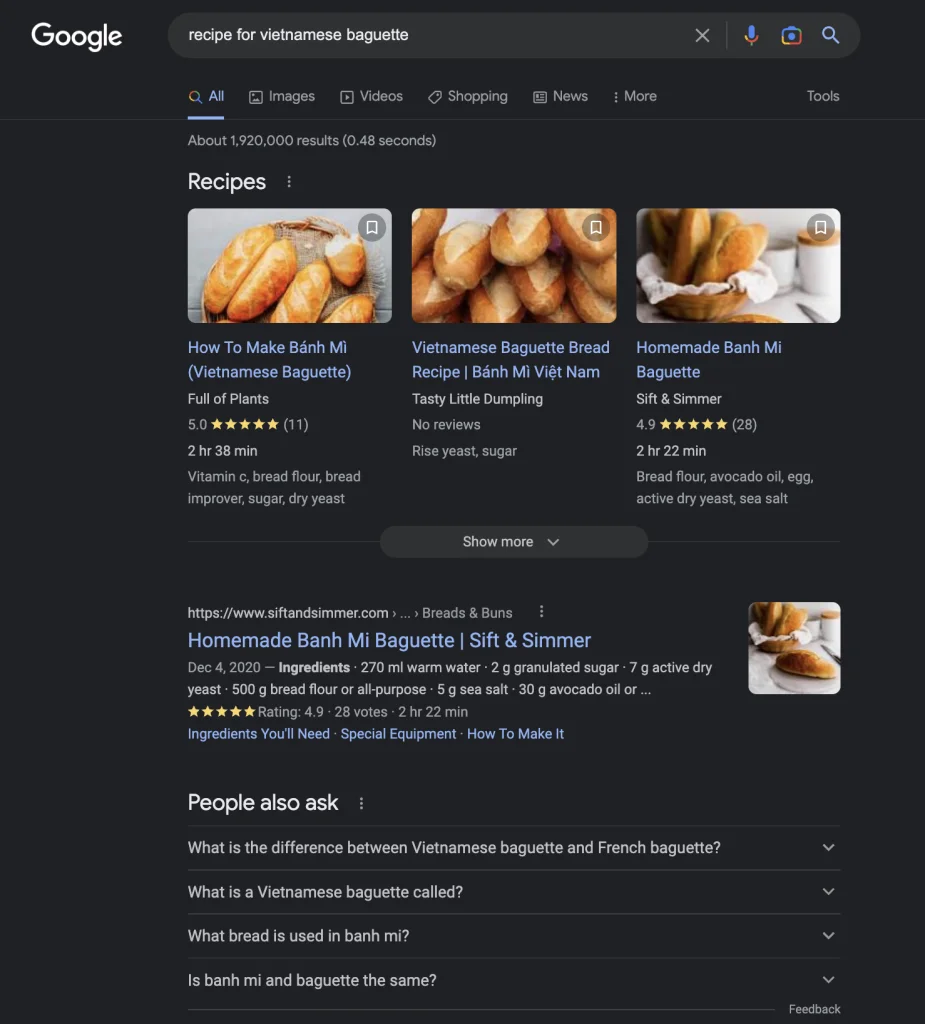

Donc, comment concevoir une interface utilisateur qui convienne à plusieurs scénarios est crucial. Par exemple, même pour quelque chose d'aussi simple que « recette de baguette vietnamienne » :D, voici ce que j'obtiens de Google, Bing et ChatGPT en janvier 2023. Il n'est pas évident de savoir lequel est meilleur ou si la réponse de ChatGPT est meilleure.

La clé est alors de modifier dynamiquement l'interface des résultats de recherche en fonction de l'intention de l'utilisateur, grâce au machine learning. Je ne sais pas si c'est facile ou difficile à réaliser. Mais cela semble être une étape logique pour combiner la force du style réponse unique de ChatGPT et d'un moteur de recherche.

Un assistant linguistique

Je soutiens que fournir des réponses dans une perspective de pure recherche d'informations n'est pas la raison pour laquelle les gens apprécient ChatGPT — c'est la capacité à donner du contexte à ChatGPT et à lui demander d'accomplir une tâche liée au langage comme écrire un poème, une introduction, un essai, etc.

Ce cas d'usage est très différent d'un moteur de recherche et est plus étroitement lié à la capacité de générer des narratives PowerPoint ou d'écrire dans Microsoft Word. Je pense donc que la nouvelle concernant Microsoft intégrant différentes capacités OpenAI dans la suite Office 365 est en réalité une meilleure nouvelle.

Les limites du langage

Jacob Browning et Yann Lecun ont écrit un excellent article sur l'IA et les limites du langage en août 2022, avant que ChatGPT soit ouvert au public. Bien que leur article référence LaMDA, le contenu s'applique essentiellement aussi à ChatGPT ou à tout autre grand modèle de langage. L'article est long, donc si tu veux les points clés, les voici :

Un ingénieur de Google a récemment déclaré que LaMDA, le chatbot IA de Google, était une personne, suscitant diverses réactions. LaMDA est un grand modèle de langage (LLM) conçu pour prédire les mots suivants les plus probables à partir de n'importe quel texte donné.

Certains ont ridiculisé l'idée, d'autres ont suggéré que la prochaine IA pourrait être une personne. La diversité des réactions souligne un problème plus profond : à mesure que ces LLM deviennent plus courants et puissants, il y a moins de consensus sur la façon de les comprendre. Le problème fondamental est la nature limitée du langage. Il est clair que ces systèmes sont condamnés à une compréhension superficielle qui n'approchera jamais la pensée complète que nous observons chez les humains. En effet, le langage n'est qu'un type de représentation de la connaissance, spécifique et limité. Il excelle à exprimer des objets discrets et des propriétés ainsi que les relations entre eux, mais peine à représenter des informations plus concrètes, comme décrire des formes irrégulières ou le mouvement des objets. Il existe d'autres schémas de représentation, comme la connaissance iconique et la connaissance distribuée, qui peuvent exprimer cette information de manière accessible.

Le langage est une méthode à faible bande passante pour transmettre des informations et est souvent ambigu en raison des homonymes et des pronoms. Les humains n'ont pas besoin d'un véhicule de communication parfait parce que nous partageons une compréhension non linguistique. Les LLM sont entraînés à capter les connaissances de fond de chaque phrase, en regardant les mots et phrases environnants pour comprendre ce qui se passe. Les LLM ont acquis une compréhension superficielle du langage, mais cette compréhension est limitée et n'inclut pas le savoir-faire pour des conversations plus complexes. Par conséquent, il est facile de les tromper en étant incohérent ou en changeant de langue. Les LLM manquent de la compréhension nécessaire pour développer une vision cohérente du monde.

Bien que le langage puisse transmettre beaucoup d'informations en format compact, une grande partie de la connaissance humaine est non linguistique et peut être transmise par d'autres moyens tels que les diagrammes, les cartes, les artefacts et les coutumes sociales. Cela suggère qu'une machine entraînée uniquement sur le langage ne pourra pas pleinement approcher l'intelligence humaine car elle n'a accès qu'à une petite partie de la connaissance humaine à travers un goulot d'étranglement étroit, et que la compréhension non linguistique profonde du monde est nécessaire pour que le langage soit utile. Cela implique également qu'il y a des limites à l'intelligence que les machines peuvent atteindre si elles sont entraînées uniquement sur le langage.

Voilà pour ma part. Qu'en penses-tu ? Est-ce que tu te vois passer de Google à un Bing propulsé par ChatGPT, ou l'habitude te maintient-elle sur Google ? :)

Cordialement,

Chandler