Réactions à « Bing AI ne peut pas être fiable »

J'ai vérifié les affirmations du fact-checker sur les données financières inventées par Bing AI — il s'avère que le problème des chiffres fabriqués est réel et pire que je ne l'espérais.

Cet article a ete ecrit en 2023. Certains details ont pu changer depuis.

Je suis tombé aujourd'hui sur cet article Bing AI ne peut pas être fiable, et naturellement, ça pique ma curiosité. C'est un bon article plein de vérifications factuelles montrant que le nouveau Bing Chat inclut beaucoup de faits inventés sur des informations factuelles. L'article est relativement court, alors vas-y et lis-le.

Voici quelques réactions rapides de ma part :

Surpris et pas surpris en même temps

Je suis généralement conscient des limitations des grands modèles de langage (LLM) dont ChatGPT fait partie. Les trois principales sont :

- Il n'indexe pas le web au-delà des données textuelles (comme les vidéos, l'audio, les images, etc.)

- La base de données de ChatGPT est vraiment ancienne (2021)

- Ces modèles inventent des mots parce qu'ils ne savent pas quelle source d'information est plus autoritaire/fiable que les autres.

J'espérais donc qu'avec l'intégration Bing & OpenAI, le moteur de recherche Bing pourrait résoudre toutes ces limitations. Eh bien, il semble que d'après l'article de Dmitri, Bing n'y est pas encore parvenu. Loin de là.

Vérifier l'article à nouveau

Ce ne serait pas génial d'apprendre que ce que Dmitri a mentionné n'était pas non plus factuellement correct. Alors j'ai effectué quelques vérifications factuelles moi-même. Je commence par les états financiers de Gap car ça semble le plus simple à vérifier. J'inclus les sources et les captures d'écran ci-dessous pour que tu n'aies pas à répéter cet exercice :

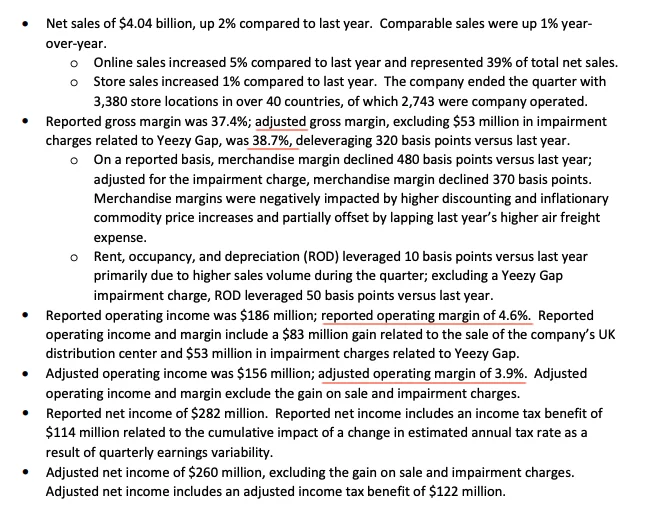

- Voici le communiqué de résultats Q3 2022 de Gap.

- J'ai pris la capture d'écran ci-dessous du relevé Gap et mis en évidence les chiffres clés en rouge. Dmitri a raison, Bing Chat a inventé des chiffres comme la marge brute ajustée, la marge opérationnelle, etc.

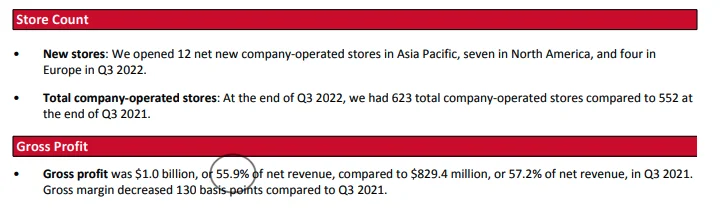

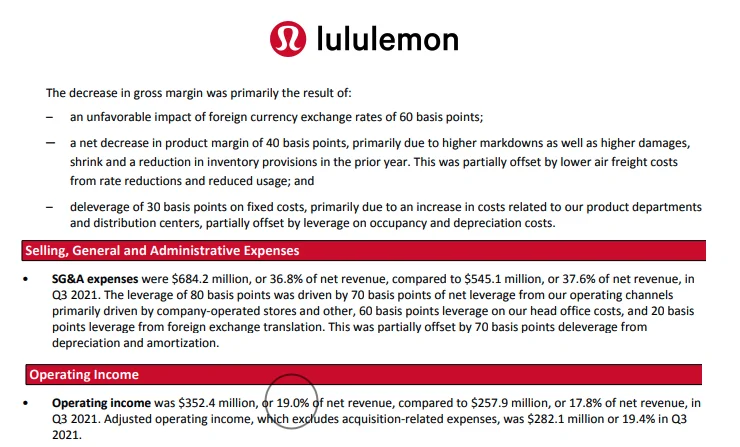

Et les chiffres de Lululemon ?

- Voici le rapport financier Q3 2022 de Lululemon. Même chose, j'ai mis en évidence les chiffres clés mentionnés dans l'article de Dmitri dans les captures d'écran ci-dessous. Il a raison, Bing Search a inventé des chiffres.

Quant à l'itinéraire Mexico City, je ne suis pas expert dans ce domaine, donc je ne peux pas vérifier avec précision. Par exemple, quand j'ai cherché « Primer Nivel Night Club - Antro », j'ai trouvé cette page Facebook. Mais je n'ai aucun moyen de vérifier à 100 % si les suggestions de Bing Search sont valides ou non.

Où aller à partir de là ?

Il semble clair qu'à ce stade, l'intégration Bing & OpenAI n'a pas encore été capable de corriger le problème des grands modèles de langage (LLMs) qui inventent simplement des choses au fur et à mesure.

Je ne suis pas assez technique pour comprendre à quel point il est difficile de résoudre ce problème. Si ça devient aussi inexact avec des données factuelles, nous devons être prudents avec des sujets plus subjectifs comme les meilleurs restaurants/plombiers/services locaux, les finances personnelles, la santé, les relations, etc.

Pour être juste envers Bing et OpenAI, ils ont bien dit lors de la présentation qu'ils comprennent que la nouvelle technologie peut se tromper sur beaucoup de choses, donc ils ont conçu l'interface « pouce en haut/pouce en bas » pour que les utilisateurs puissent leur donner facilement du feedback. Espérons qu'avec plus de retours des utilisateurs, la machine s'améliorera.

Un algorithme pour vérifier les faits des LLM ?

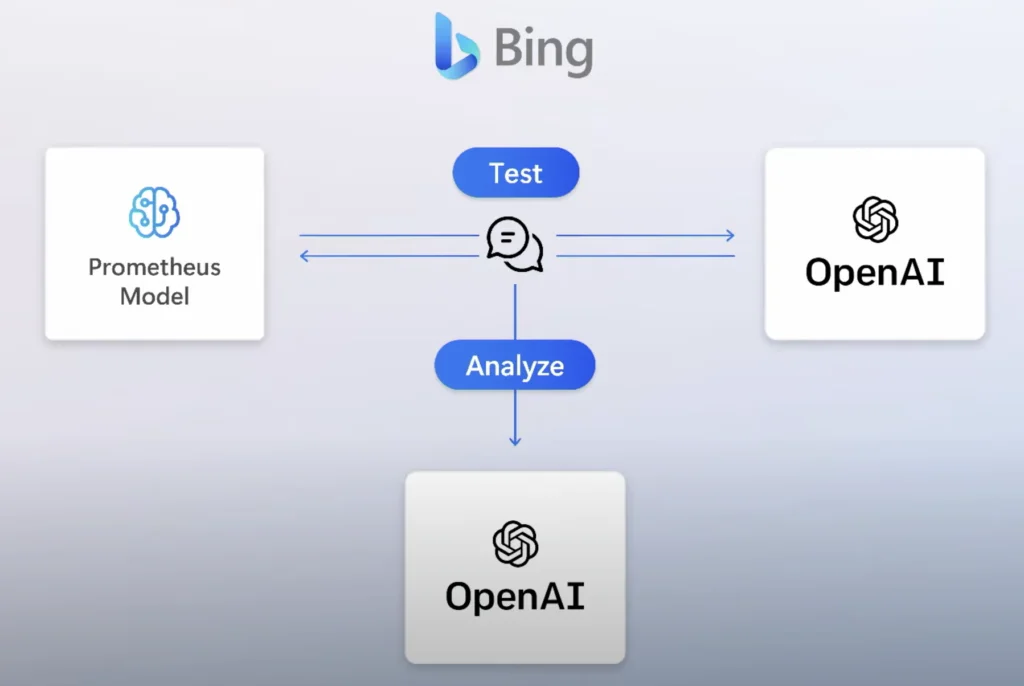

Puisque les LLM produisent souvent des résultats incorrects, pourquoi ne pas créer un algorithme pour vérifier continuellement les faits de leurs outputs ? C'est similaire à ce dont Microsoft a parlé concernant l'algorithme de sécurité qu'ils ont intégré dans Prometheus, en simulant les prompts de mauvais acteurs envoyés à la machine.

Le rôle de l'humain

Cette technologie semble être à un stade précoce, et bien que les progrès soient exponentiels, le rôle de l'humain est critique. Nous ne pouvons pas encore faire confiance aux outputs, même avec l'intégration Bing & OpenAI. La machine peut nous aider avec 50 % du résultat souhaité (plus ou moins), mais nous devons fournir les 50 % restants.

Il semble y avoir suffisamment de temps pour nous adapter, apprendre les forces et les limitations de cette technologie, et l'utiliser efficacement.

Quant aux ingénieurs qui conçoivent ces systèmes, vous avez probablement besoin de faire un meilleur travail pour mettre en évidence auprès des utilisateurs finaux les points de données et les phrases dont la machine n'est pas sûre. Nos cerveaux humains aiment les raccourcis, donc je suis sûr que beaucoup d'entre nous (moi y compris) prendront la voie facile et accepteront ce que la machine dit comme étant la vérité :P Il nous est difficile d'être constamment sur nos gardes.

As-tu déjà repéré des réponses générées par l'IA qui étaient manifestement fausses ? J'adorerais entendre tes exemples — plus ils sont précis, mieux c'est.

Cordialement,

Chandler