États-Unis ou Chine : qui mène la recherche en IA ?

Deux analyses majeures sont parvenues à des conclusions opposées sur le leadership des États-Unis vs la Chine en IA — mais elles mesuraient des choses complètement différentes. Voici pourquoi les deux pourraient avoir raison.

Récemment, je suis tombé sur deux articles avec des titres et des conclusions très différents :

- China trounces U.S. in AI research output and quality. Écrit par Kotaro Fukuoka, Shunsuke Tabeta et Akira Okikawa, journalistes du Nikkei.

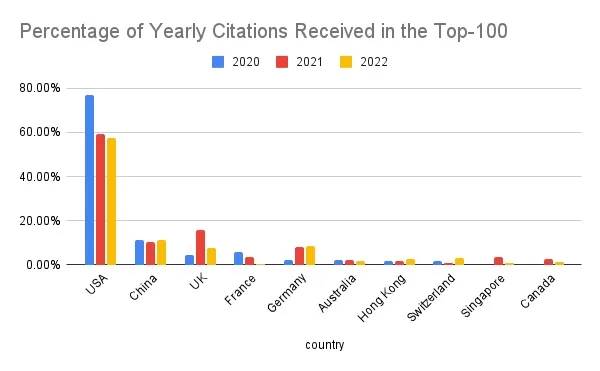

- Must read: the 100 most cited AI papers in 2022 par Zeta Alpha. L'article écrit « Quand nous regardons d'où viennent ces articles les plus cités (Figure 1), nous constatons que les États-Unis continuent de dominer et que la différence entre les grandes puissances varie légèrement d'une année à l'autre. »

- L'une des conclusions de cet article est que « Les rapports précédents (lien vers l'article Nikkei) selon lesquels la Chine aurait pu dépasser les États-Unis en R&D IA semblent être très exagérés si on la regarde du point de vue des citations. »

Naturellement, cela m'a rendu curieux car Nikkei est une organisation d'information réputée, et le Japon est un allié militaire des États-Unis. En d'autres termes, le Nikkei a peu d'incitation à « faire tourner » la vérité en faveur de la Chine. J'ai donc décidé d'approfondir.

Eh bien, il s'avère que je n'avais pas besoin de creuser beaucoup pour savoir que les deux pouvaient avoir raison en même temps car ils ont utilisé des méthodologies différentes pour tirer leurs conclusions. Étant donné que Zeta Alpha a publié son article plus tard et cité l'article du Nikkei, Zeta Alpha aurait dû souligner directement les différences dans leurs méthodologies dans l'article ; et laisser les lecteurs décider par eux-mêmes.

Méthodologies différentes

Méthodologie Nikkei

Méthodologie Zeta Alpha

Nikkei a travaillé avec l'éditeur scientifique néerlandais Elsevier pour examiner des articles académiques et de conférence sur l'IA, en utilisant environ 800 mots-clés associés à l'IA pour réduire les articles.

Pour créer l'analyse ci-dessus, nous avons d'abord collecté les articles les plus cités par an sur la plateforme Zeta Alpha, puis vérifié manuellement la date de première publication, afin de placer les articles dans la bonne année.

Nous avons complété cette liste en explorant les articles IA très cités sur Semantic Scholar avec sa couverture plus large et sa capacité à trier par nombre de citations. Nous prenons ensuite pour chaque article le nombre de citations sur Google Scholar comme métrique représentative et trions les articles par ce nombre pour obtenir le top 100 d'une année.

En regardant la quantité, le nombre d'articles IA a explosé d'environ 25 000 en 2012 à environ 135 000 en 2021.

L'article Zeta Alpha se concentre uniquement sur les 100 premiers articles de chaque année

Nikkei et Zeta Alpha utilisent tous deux les citations comme indication de la qualité de l'article.

Mais la première grande différence est que Nikkei examine un nombre beaucoup plus important d'articles IA que Zeta Alpha pour tirer leur conclusion. Quand Nikkei a écrit « En 2021, la Chine représentait 7 401 des articles les plus cités, dépassant le total américain d'environ 70 % », ils faisaient référence aux 10 % d'articles les plus cités, soit essentiellement un univers de 13 500 articles en 2021 (les 10 % supérieurs d'environ 135 000 articles IA en 2021).

Toute l'analyse de Zeta Alpha dans leur article porte sur les 100 premiers articles en termes de citations pour chaque année seulement.

Donc ce n'est vraiment pas une comparaison de pommes à pommes.

Quelle méthode est meilleure, entre Nikkei et Zeta Alpha ?

Je n'ai pas une formation approfondie dans le domaine de l'IA, donc je ne peux pas affirmer avec confiance quelle méthodologie est meilleure. Je sais qu'elles sont différentes.

Si tu veux répondre à cette question, je pense qu'il faut :

- Premièrement, définir quels critères tu utilises pour évaluer « meilleure » ?

- Couvrir un plus grand nombre d'articles signifie que la taille de ton échantillon est beaucoup plus grande et couvre beaucoup plus de domaines de niche au sein de l'IA.

- Se concentrer sur les 100 premiers articles peut avoir du sens si on pense que la plupart des valeurs commerciales ou stratégiques s'accumuleront vers les quelques premiers articles/propriétaires au fil du temps. Mais je doute que Zeta Alpha ait fait cette analyse.

- Deuxièmement, trouver une meilleure façon de quantifier la valeur ou l'impact de chaque article plutôt que d'utiliser uniquement les citations. Je sais qu'utiliser les citations est une façon brute d'évaluer la qualité, mais est-ce la meilleure façon ?

- Troisièmement, quelle est la relation entre la capacité IA d'un pays et le pourcentage de ses articles publiés parmi les 100 ou 1 000 premiers cités dans une année donnée ?

- Par exemple, je suis sûr que pour certaines recherches de pointe avec des valeurs militaires et commerciales élevées, certains laboratoires de recherche choisissent de ne pas les publier. Parce que pourquoi les publier pour que les autres apprennent, pour aider la concurrence à combler l'écart ?

- Je pourrais continuer, mais j'espère que tu comprends mon point

Certaines conclusions/titres discutables

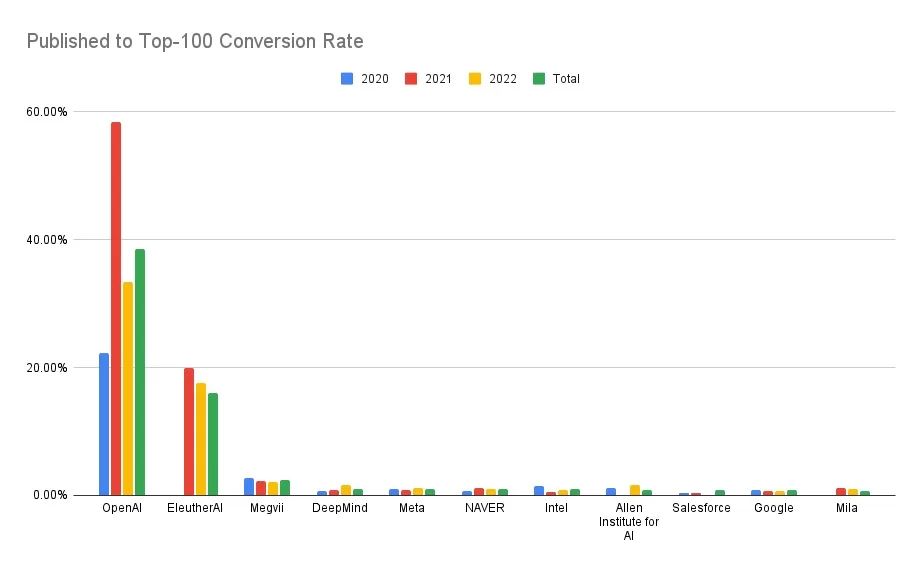

OpenAI est tout simplement dans une ligue à part quand il s'agit de transformer des publications en véritables blockbusters

Zeta Alpha a écrit cela « Tu ne verras pas OpenAI ou DeepMind parmi les 20 premiers en volume de publications. Ces institutions publient moins mais avec un impact plus élevé. » et « Maintenant nous voyons qu'OpenAI est tout simplement dans une ligue à part quand il s'agit de transformer des publications en véritables blockbusters. »

Pourquoi ce « taux de conversion » est-il important à regarder ? Qu'est-ce que ça signifie ? Une façon simple d'interpréter les données est :

- La recherche OpenAI se concentre sur un domaine très étroit de l'IA, et ils choisissent de publier un nombre très limité d'articles.

- Google ou Meta et d'autres entreprises ont un large intérêt pour l'IA, et elles recherchent simultanément de nombreux domaines différents. Et elles choisissent de publier davantage.

- Cela n'a rien à voir avec la capacité d'OpenAI à transformer des publications en blockbusters.

Quelle façon de travailler est meilleure ? Je ne suis pas sûr

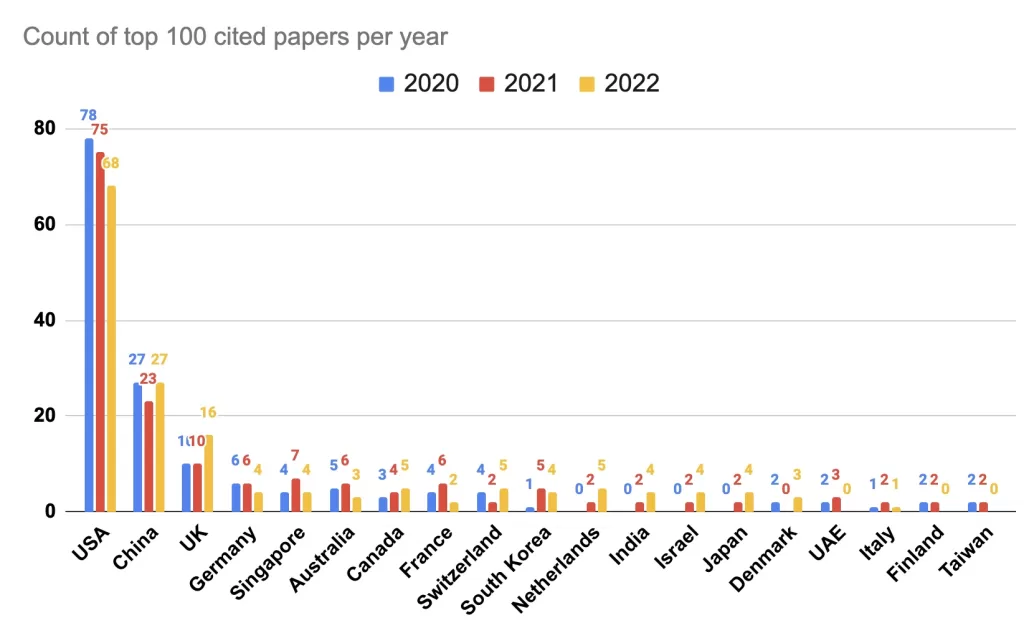

Les États-Unis dominent les articles de recherche IA

Cette conclusion est basée sur deux principaux points de données ci-dessous

Comme mentionné ci-dessus, bien que je sois d'accord qu'avoir une forte présence dans les 100 (ou 1 000 ou quel que soit le nombre) premiers articles IA cités est un signal de la force d'un pays en IA. Je ne pense pas que cela devrait être le SEUL signal. Il devrait y avoir une suite de points de données ou de signaux pour tirer cette conclusion.

Aussi, pourquoi le top 100 et pas le top 1 000 ? Est-ce parce que la méthodologie de Zeta Alpha implique une vérification manuelle donc ils ne peuvent couvrir que le top 100 ?

Conclusion

C'est un autre exemple de la façon dont la situation réelle est beaucoup plus nuancée que certains titres le suggèrent. Donc bien que j'apprécie l'effort pour simplifier l'histoire pour le public, nous ne devrions pas essayer de la « simplifier trop ». :)

Selon toi, quelle est la meilleure façon de mesurer la capacité IA d'un pays ? Est-ce que le nombre d'articles les plus cités suffit, ou devrions-nous regarder un ensemble plus large de signaux ? J'adorerais connaître ton avis.

Cordialement, Chandler