CrewAI est bon ! — Mes premières impressions

Après 10 jours à construire des podcasts générés par IA avec CrewAI, j'ai appris que si le framework est remarquablement facile à utiliser, un contenu de qualité exige encore un effort humain réel.

Je suis tombé sur CrewAI il y a quelques semaines via le cours "Practical Multi AI Agents and Advanced Use Cases with crewAI". Bien que j'aie d'abord hésité à l'essayer puisque j'utilise déjà Langgraph pour mon agent Sydney, deux choses ont suscité mon intérêt :

- J'explorais des façons de créer des podcasts à partir de zéro, en me concentrant notamment sur comment utiliser l'IA générative pour "raisonner" sur mes 15 ans de contenu de blog plutôt que de simplement copier-coller des articles. J'avais essayé NotebookLLM pour ça (qui a bien fonctionné, tu peux écouter l'épisode de podcast ici), mais je voulais plus de contrôle sur le flux de la conversation et les accroches d'ouverture.

- Je voulais apprendre quelque chose de nouveau et expérimenter avec les modèles text-to-speech d'OpenAI.

Mise à jour novembre 2025 : J'ai dépassé l'utilisation des frameworks d'agents et j'ai commencé à coder à partir de zéro avec Claude Code et Google Gemini CLI. Cela m'a donné beaucoup plus de contrôle. Mes derniers lancements sont STRAŦUM (intelligence marketing) et DIALØGUE (générateur de podcasts IA) — qui ont évolué directement à partir de cette expérience CrewAI ci-dessous.

Après environ 10 jours à jouer avec CrewAI, voici mes observations clés :

1. Les bons points

1.1 Étonnamment facile à démarrer

- La courbe d'apprentissage initiale est remarquablement courte — j'étais opérationnel en quelques heures seulement

- La configuration d'outils personnalisés (comme la récupération de contenu de mon blog en utilisant Weaviate comme magasin vectoriel) était simple. Convertir ton script de podcast en sortie audio est aussi assez facile à configurer.

- La possibilité de décrire les agents et leurs tâches en anglais simple en utilisant des fichiers YAML est puissante (Conseil pratique : l'autocomplete de Visual Studio Code est super utile ici !)

1.2 Sélection flexible des modèles

Passer d'un LLM à l'autre est aussi simple que de mettre à jour ton crew.py :

llm_openai_4o_mini = LLM(model="gpt-4o-mini", temperature=0)

llm_anthropic_35 = LLM(model="claude-3-5-sonnet-20240620", temperature=0)

llm_openai_4o = LLM(model="gpt-4o", temperature=0)

llm_gemini_15_pro = LLM(model="gemini/gemini-1.5-pro-002", temperature=0)

Tu peux ensuite assigner des modèles spécifiques à différents agents selon leurs points forts. Par exemple :

@agent

def content_researcher(self) -> Agent:

return Agent(

config=self.agents_config['content_researcher'],

llm=llm_anthropic_35,

tools=[BlogContentRetrievalTool()],

verbose=True

)

Tout cela signifie un grand contrôle sur la façon dont je veux structurer et scripter mon podcast.

1.3 Text-to-Speech : promesses et limites

Bien que l'API text-to-speech d'OpenAI soit impressionnante en termes de qualité, elle n'offre actuellement que six modèles de voix. Pour la création de podcasts, c'est assez limitant — surtout quand tu essaies de créer des conversations engageantes entre plusieurs animateurs. Le manque de variété de voix signifie que tu pourrais te retrouver avec des podcasts qui sonnent de façon similaire à d'autres utilisant la même technologie. C'est définitivement un domaine où j'espère voir des améliorations à l'avenir, que ce soit via OpenAI qui élargit ses options de voix ou via une intégration avec d'autres fournisseurs text-to-speech.

Je comprends aussi les préoccupations liées à la sécurité de l'IA, donc les différents labs IA ne se précipiteront peut-être pas pour fournir trop de modèles de voix.

2. La vérification de la réalité : ce n'est pas juste "cliquer et créer"

Au départ, je m'inquiétais que cela pourrait contribuer au flot de contenu généré par IA (ou "AI Slop") que nous voyons en ligne. Après tout, je pouvais générer un script de podcast de 15 minutes en environ 5 minutes. (Dans le cours de formation DeepLearning.AI ci-dessus, João a présenté un exemple de code de "création de contenu à grande échelle".)

Cependant, ma perspective a changé après avoir vraiment lu/examiné les premiers scripts initiaux générés.

Créer du contenu de haute qualité nécessite encore un travail considérable !

2.1 Structure réfléchie de l'équipe d'agents

J'ai dû réviser la structure de l'équipe IA plusieurs fois, en ajoutant des rôles supplémentaires, notamment le rôle d'un "vérificateur_de_faits". Mon équipe podcast actuelle comprend :

- Chercheur de contenu

- Rédacteur de script

- Vérificateur de faits

- Éditeur de script

- Producteur audio

2.2 Raffinement continu

Le succès nécessite :

- De définir soigneusement les objectifs et les tâches de chaque agent en utilisant un langage spécifique à l'industrie. Quelqu'un avec une vraie expérience dans l'industrie des podcasts peut utiliser un langage spécifique à l'industrie et peut demander à chaque agent d'effectuer une tâche très spécifique. Le résultat sera bien meilleur de cette façon.

- D'être sélectif avec l'accès aux outils (plus n'est pas toujours mieux). Il est facile pour les agents de se retrouver dans des boucles continues.

- Des règles de délégation claires entre les agents

- Des exigences de structure de sortie spécifiques

- Des critères de qualité bien définis sur "À quoi ressemble un bon travail" (j'ai même impliqué ma fille ici — c'est elle la créative ! :D).

Donc encore une fois, comme tu peux le voir, bien qu'utiliser une équipe d'agents IA aide à accélérer mon travail considérablement (au moins 5X de la recherche au script, à la vérification des faits, à la révision, à la création audio), il m'appartient encore de créer du contenu de haute qualité.

2.3 La sélection des modèles est importante

Les différents modèles LLM ont des "personnalités" distinctes et des niveaux variables de suivi des instructions. Tu dois donc expérimenter pour comprendre les points forts et les faiblesses des différents modèles et comment ils correspondent à tes besoins à chaque étape du processus.

Quelques observations :

- Les réponses API peuvent différer des réponses de l'interface web de chat pour le même modèle

- Actuellement, je préfère les modèles Anthropic pour le contenu long format via l'API. Cependant, en ce qui concerne la version web, je pense que claude-3-5-sonnet-20241022 et GPT-4o sont à parité.

- L'o1-preview d'OpenAI est mon choix privilégié pour les tâches de codage

2.4 Le feedback et la mémoire sont des facteurs déterminants

Tu dois fournir du feedback à ton équipe IA. Ils sont bons pour suivre les directions, mais ils ne savent pas ce que tu veux et ne peuvent pas lire dans tes pensées (du moins pas encore haha). La capacité de former ton équipe via le feedback est cruciale.

Avec CrewAI, c'est assez simple d'entraîner ton équipe et de donner du feedback, en exécutant simplement

crewai train -n <n_iterations> <filename> (optional)

Bien que je n'aie pas encore entièrement exploré les fonctions mémoire de CrewAI, la combinaison de feedback et de mémoire semble incroyablement puissante pour créer une sortie cohérente et de haute qualité.

3. Montre-moi les résultats !

Ok, ok — je t'entends dire "Chandler, tu as assez parlé. Montre-moi un exemple du script de podcast généré par ton équipe IA !"

Voici un exemple complet de workflow :

- Phase de recherche : Vois comment l'agent Chercheur de contenu a analysé et extrait des informations clés de mes articles de blog

- Résumé de vérification des faits : Le rapport de vérification détaillé du Vérificateur de faits

- Ébauche initiale du script : La première version de la conversation du podcast par le Rédacteur de script

- Script final peaufiné : La version raffinée de l'Éditeur de script avec un flux et un engagement améliorés

- Écoute le résultat : La version audio finale produite par l'agent Producteur audio

Chaque lien ci-dessus montre la progression du contenu brut au podcast peaufiné, démontrant comment différents agents contribuent au produit final.

Bien que j'aie encore des réflexions sur la façon dont je peux améliorer davantage l'ensemble du pipeline, j'espère que ce qui précède te donne une bonne idée de ce qui est possible.

Réflexions finales

CrewAI m'a impressionné par son équilibre entre simplicité et puissance. Bien qu'il rende la création de contenu plus accessible, ce n'est pas un bouton magique — la qualité nécessite encore une expertise, une planification soigneuse et un raffinement continu.

As-tu expérimenté avec des frameworks multi-agents comme CrewAI ou Langgraph ? J'adorerais entendre ce que tu construis avec eux — n'hésite pas à laisser un commentaire ou à me contacter.

Cordialement,

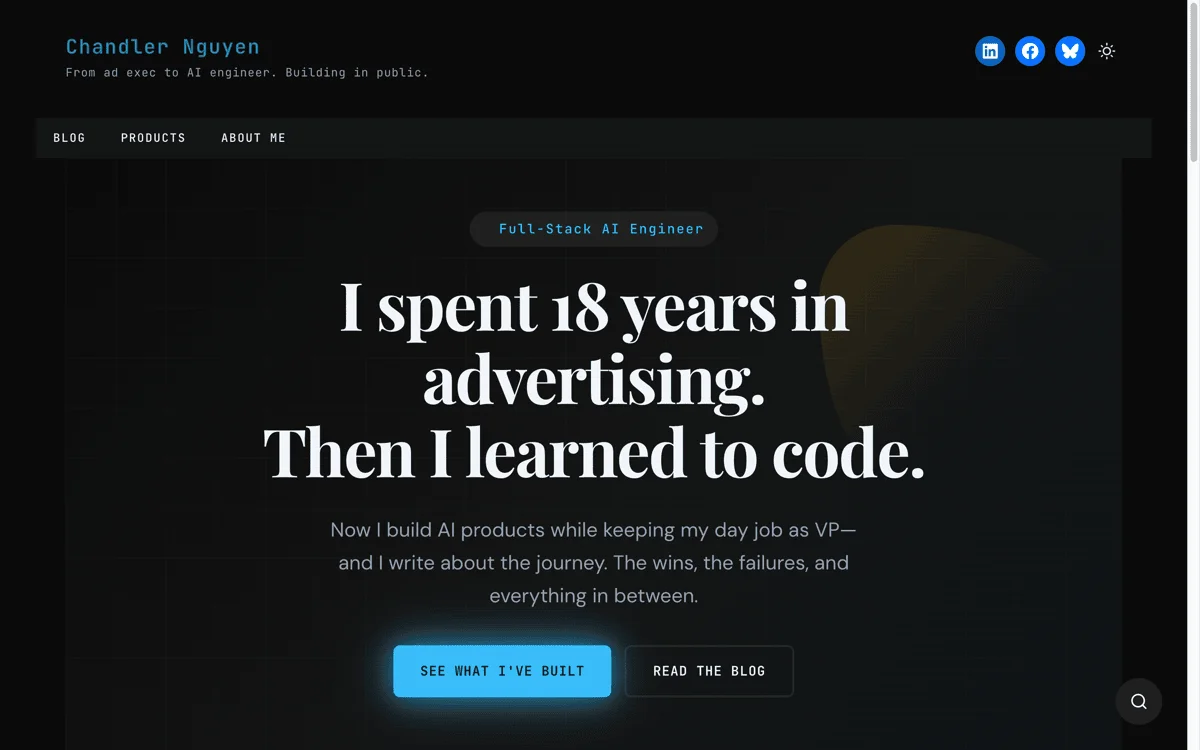

Chandler

Mise à jour janvier 2026 : Cette expérience CrewAI a finalement donné naissance à DIALØGUE — une application de production complète. La limitation vocale que j'ai mentionnée ci-dessus ? J'ai finalement opté pour Gemini TTS, ce qui m'a donné 30 voix dans 7 langues. Sacrée mise à niveau par rapport aux 6 voix d'OpenAI ! Si tu es curieux, jette un œil.