J'abandonne mon abonnement Claude Code a 200 $ apres deux semaines avec Codex

Deux semaines apres ma comparaison initiale, les deux outils ont sorti des mises a jour majeures. Codex a remis en question ma strategie produit d'une maniere que Claude Code n'avait pas fait. Claude Code a lance Agent Teams et AutoMemory. Le resultat : j'abandonne mon abonnement Max a 200 $/mois — et j'obtiens de meilleurs resultats pour moins cher.

Il y a deux semaines, j'ai ecrit sur le fait de jongler entre Codex et Claude Code. Cet article a eu plus de resonance que tout ce que j'ai ecrit — il s'avere que beaucoup de gens menent la meme experience.

A l'epoque, mon modele de travail etait clair : Claude Code pour la qualite d'execution et le QA, Codex pour le raisonnement architectural et les plans a long terme. Les deux outils, des forces differentes, une revue croisee entre modeles pour le travail important.

Deux semaines plus tard, les deux outils ont sorti des mises a jour significatives et l'equilibre a bascule. Pas de facon dramatique — mais assez pour valoir la peine d'en parler. (Pour le contexte, je redige cet article dans Claude Code — pas par loyaute, mais parce que mon cycle de facturation est encore actif et je ne veux pas gaspiller l'argent deja engage. Ce genre de calcul pratique est justement le propos de cet article.)

Mars 2026 a ete intense pour les deux plateformes. Codex a lance les plugins avec des integrations pour Slack, Gmail, Linear, Figma, Sentry, et d'autres — plus les Triggers pour des workflows GitHub automatises, les modeles GPT-5.4 mini et nano, et le support natif Windows. Claude Code a sorti Agent Teams (orchestration multi-agents, encore experimental), AutoMemory, Computer Use (macOS uniquement, plans Pro/Max), les Scheduled Tasks via /loop, et environ 10 releases rien qu'en mars. Les deux plateformes avancent vite.

L'histoire de la newsletter (pourquoi ce n'est pas juste une question de code)

L'observation qui a change ma facon de penser n'avait rien a voir avec l'ecriture de code.

Mon site dispose d'un systeme de newsletter complet — formulaire d'inscription, CTAs dans les articles, email de bienvenue, cron quotidien, double opt-in, support de 13 langues. Techniquement, tout fonctionne. Le probleme : zero abonne verifie.

J'ai elabore un plan pour corriger ca : extraire un lead magnet PDF de mon cours, mettre le Module 1 derriere un email, ajouter des CTAs en milieu d'article, connecter le chatbot IA au flux d'inscription, redistribuer via YouTube et LinkedIn. Sept nouveaux chantiers.

J'ai construit ce plan avec Claude Code. Ca avait l'air productif.

Puis j'ai donne le meme brief a Codex. La remise en question a ete immediate.

Le lead magnet etait redondant — le Module 1 est deja gratuit. Trop de surfaces en meme temps — si tu construis les sept, tu ne peux pas savoir laquelle fonctionne. Le probleme n'est pas l'infrastructure, c'est le texte. "Stay in the loop" est generique. L'email de verification n'est pas assez convaincant. La selection des centres d'interet ajoute de la friction.

Le plan de Codex : d'abord corriger ce qui existe (reecrire le texte, ameliorer l'email de verification, reduire la friction), ajouter une seule nouvelle surface (un CTA inline dans les articles), mesurer avec des evenements GA avant de construire quoi que ce soit d'autre.

Mon plan etait "construire plus de choses." Le plan de Codex etait "faire fonctionner les choses existantes, puis tester une nouveaute." Le mien aurait pris une semaine sans moyen de savoir ce qui avait marche. Celui de Codex peut etre deploye en un jour et te dit exactement ou investir ensuite.

Je dois admettre — ca m'a pris au depourvu. Pas parce que Claude est mauvais en strategie. Je pense que si j'avais prompt de maniere plus precise — "remets en question mes hypotheses avant d'executer" — j'aurais peut-etre obtenu une remise en question similaire. Mais le style de raisonnement par defaut etait nettement different. GPT-5.4 a tendance par defaut a "questionner la premisse." Claude a tendance par defaut a "bien executer le plan."

Cette distinction compte pour les decisions produit.

Vitesse et pilotage

Deux choses que j'ai remarquees qui affectent le workflow quotidien plus que prevu.

Vitesse et efficacite de tokens : Codex avec GPT-5.4 en mode thinking eleve est systematiquement plus rapide qu'Opus 4.6 en mode thinking eleve pour des taches equivalentes. Des comparaisons tierces suggerent que Codex utilise environ 3 fois moins de tokens pour un travail similaire — un benchmark a mesure 1,5 million de tokens sur une tache de type Figma la ou Claude en a utilise 6,2 millions. Claude "pense a voix haute" davantage, ce qui produit un raisonnement de meilleure qualite mais epuise les limites plus vite. Depuis environ le 20 mars, Opus semble faire plus d'appels d'outils que d'habitude — plus d'etapes intermediaires avant d'arriver a la reponse. Je ne sais pas si c'est un changement de modele ou une coincidence, mais c'est perceptible.

Pilotage en temps reel : Quand j'envoie un nouveau message pendant que l'outil travaille — "attends, pas cette direction, essaie plutot ca" — Codex le lit presque immediatement et s'ajuste. Claude Code a tendance a finir son execution en cours avant de lire la correction.

Ca peut sembler anodin. Ca ne l'est pas. Quand tu regardes un agent partir dans la mauvaise direction et que tu veux corriger le cap, le decalage entre "lit ta correction maintenant" et "la lit apres avoir fini l'operation en cours" s'accumule sur toute une session de travail.

Le bug SSE : un exemple concret

Je developpais une nouvelle app iOS. Claude Code avait produit 40 fichiers Swift couvrant toutes les fonctionnalites — auth, agents, chat, frameworks, dashboard, profil. Une ampleur impressionnante. Mais un bug critique persistait : le streaming SSE pour le chat en temps reel ne fonctionnait pas.

Le backend etait correct. Curl fonctionnait. Mais URLSessionDataDelegate.didReceive(data:) ne se declenchait pas dans le client Swift. Claude Code a travaille dessus pendant des heures. Plusieurs approches, plusieurs sessions de debug.

J'ai donne le meme probleme a Codex. Quelques tentatives plus tard : commit 7f592152 — "fix(ios): restore real-time chat streaming."

Est-ce representatif ? Peut-etre pas. Chaque outil a ses bons et ses mauvais jours. Mais d'apres mon experience, quand Claude Code se retrouve coince dans une boucle de debug — essayant des variations de plus en plus ingenieuses de la meme approche — passer a Codex casse souvent le blocage parce que GPT-5.4 formule le probleme differemment des le depart.

La ou Claude Code gagne encore

Il serait facile de lire cet article et d'en conclure que Codex prend l'avantage sur toute la ligne. Ce serait faux. Claude Code a aussi pousse fort ce mois-ci, et plusieurs de ses avantages se sont meme renforces.

Agent Teams. Lance en fevrier et en maturation tout au long de mars. Plusieurs instances de Claude Code travaillant en parallele — un explorateur, un revieweur de code, un implementeur, un lanceur de tests — avec un suivi des dependances et des listes de taches partagees. C'est encore experimental et desactive par defaut, mais quand c'est active, c'est vraiment impressionnant. Codex a aussi un support multi-agents (les taches tournent dans des conteneurs cloud isoles), mais les Agent Teams de Claude Code semblent mieux coordonnes. Pour les gros refactorings touchant de nombreux fichiers, Agent Teams offre actuellement la meilleure experience.

AutoMemory. Claude Code ecrit maintenant automatiquement des regles de memoire basees sur tes habitudes. Apres quelques sessions, il connait la structure de ton projet, tes conventions de nommage, tes preferences. C'est subtil mais l'effet cumulatif fait que les sessions Claude Code deviennent plus productives au fil du temps, d'une maniere que les sessions Codex ne font pas actuellement.

Design frontend. Claude Code avec le plugin /frontend-design produit toujours un UI nettement plus soigne et coherent avec le systeme de design que Codex avec le skill equivalent. J'ai teste ca directement lors d'un redesign du site le 26 mars. Le resultat de Claude avait une meilleure composition spatiale, un style plus constant, et un rendu plus coherent. C'est peut-etre un avantage du harness (le systeme de plugins de Claude execute le skill avec plus de contexte), mais le resultat pratique est clair.

Qualite du code. Une analyse communautaire de plus de 500 commentaires de developpeurs sur Reddit a revele que les developpeurs preferaient le code produit par Claude Code dans environ 67 % des comparaisons a l'aveugle — notant un code plus propre, plus idiomatique et mieux structure. Ca correspond a mon experience. Quand le code doit etre maintenable, pas seulement fonctionnel, Claude Code a un avantage.

QA automatique. Toujours la fonctionnalite qui tue. Apres avoir termine un travail, Claude Code envoie automatiquement des agents de revue — revue de code, verification de coherence, analyse des lacunes — sans que je le demande. Codex ne fait pas ca encore. Pour tout ce ou la correction compte plus que la vitesse, cela seul suffit a garder Claude Code dans le workflow.

La question de la fiabilite

Je veux partager quelque chose que la plupart des articles de comparaison evitent.

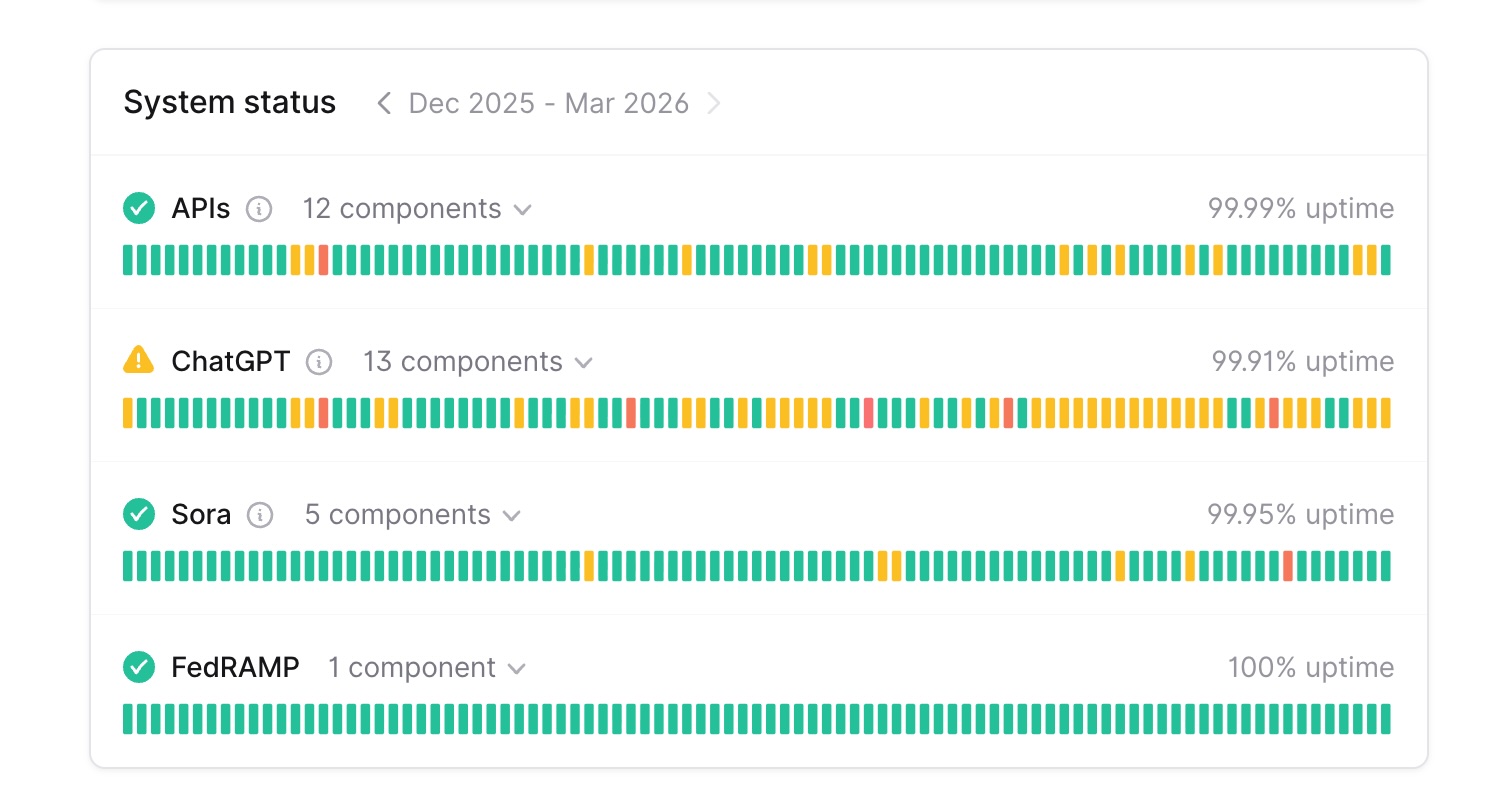

Voici les chiffres de disponibilite sur 90 jours des deux pages de statut, fin mars 2026 :

| Service | Anthropic | OpenAI |

|---|---|---|

| Plateforme principale | claude.ai : 99,16 % | ChatGPT : 99,91 % |

| API | api.anthropic.com : 99,24 % | APIs : 99,99 % |

| Outils developpeur | Claude Code : 99,48 % | — |

| Console | platform.claude.com : 99,41 % | — |

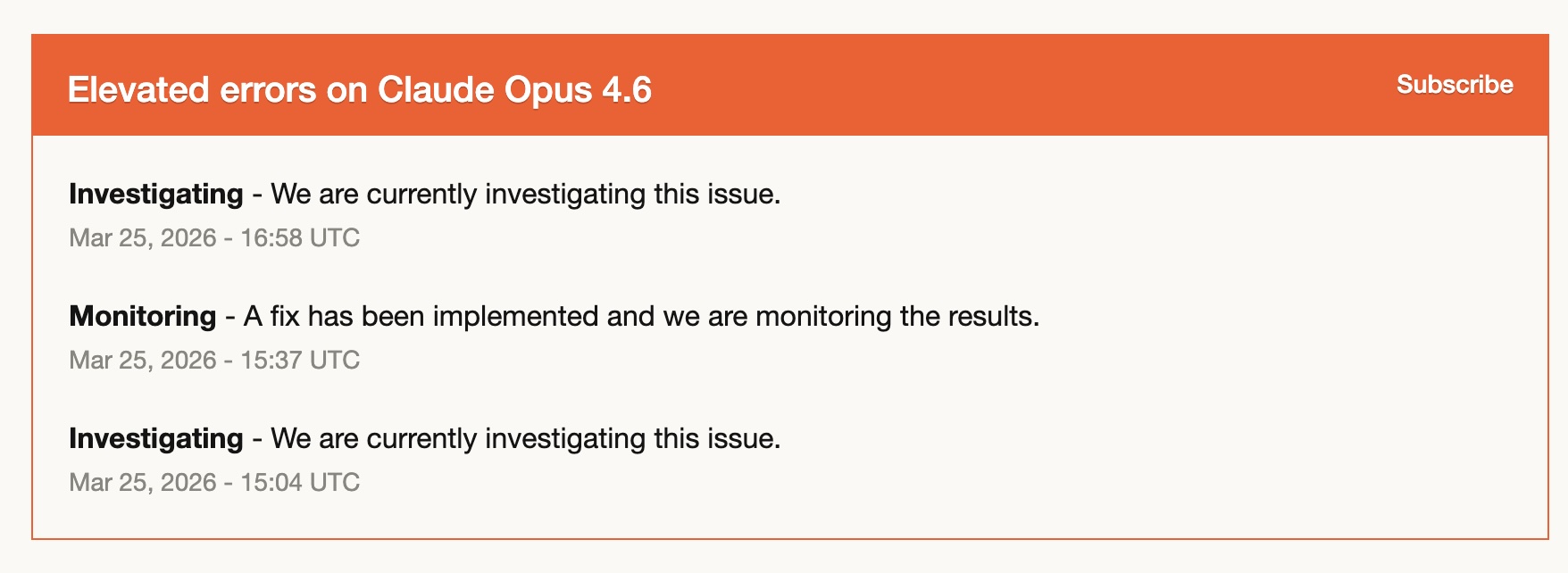

L'ecart est reel. Sur 90 jours, les services d'Anthropic ont connu environ 8 a 10 fois plus de temps d'arret que ceux d'OpenAI. Le 25 mars, il y a eu un incident specifique — "Elevated errors on Claude Opus 4.6" — avec un cycle investigating-fix-investigating qui a dure presque deux heures.

En toute justice, ce n'est pas le tableau complet. La fiabilite ne se resume pas au temps de disponibilite. Phantom Labs de BeyondTrust a divulgue publiquement une vulnerabilite d'injection de commande dans Codex qui aurait pu exposer les tokens d'authentification GitHub par manipulation des noms de branches. La faille touchait l'interface web, le CLI, le SDK et les integrations IDE — un nom de branche controlable par l'utilisateur etait passe directement dans une commande shell sans assainissement. OpenAI l'a corrige, mais ca rappelle que stabilite et securite sont des dimensions differentes de la fiabilite, et les deux comptent.

Je partage les donnees de disponibilite non pas pour taper sur Anthropic. J'utilise Claude Code tous les jours et il reste excellent. Mais pour quiconque construit son workflow professionnel autour de ces outils, les chiffres meritent d'etre connus. Et c'est exactement pourquoi jongler avec les deux n'est pas juste un luxe — quand un service a un mauvais apres-midi, tu passes a l'autre et tu continues a travailler. Je l'ai fait trois fois en deux semaines.

L'ecart des plugins se reduit

Dans mon article original, j'avais note que l'ecosysteme de plugins de Claude Code etait plus mature. C'etait vrai il y a deux semaines. Ca l'est moins aujourd'hui.

Codex a lance son systeme de plugins le 27 mars avec des integrations pour Slack, Gmail, Google Drive, Linear, Figma, Sentry, Notion et Hugging Face. Plus des skills, des hooks (y compris les evenements SessionStart et UserPromptSubmit), des serveurs MCP, et un repertoire de plugins dans l'app comme en CLI.

L'ensemble des fonctionnalites converge. Les deux outils proposent desormais : des plugins/skills pour des workflows reutilisables, des hooks pour l'automatisation evenementielle, l'integration de serveurs MCP, et des integrations au niveau de l'app avec des services externes.

La ou Claude Code garde l'avance : l'ecosysteme de plugins existant est plus profond. Des plugins comme Superpowers (planification structuree), /feature-dev (developpement guide) et /frontend-design ont ete affines pendant des mois. Le repertoire de plugins de Codex est plus recent et les plugins individuels sont moins eprouves.

La ou Codex prend de l'avance : Triggers. Codex peut repondre automatiquement aux evenements GitHub — une issue arrive, Codex la corrige automatiquement, ouvre une PR. C'est une nouvelle categorie d'automatisation que Claude Code ne propose pas encore. Pour les equipes qui veulent des workflows d'ingenierie autonomes, les Triggers font une vraie difference.

Mon modele de travail actualise

Il y a deux semaines, je repartissais le travail environ 60/40 Claude Code/Codex. J'avais un modele mental clair : prendre Claude Code quand tu as besoin de qualite, prendre Codex quand tu as besoin de raisonnement architectural.

Cette repartition nette s'est dissoute. J'utilise maintenant les deux tout au long de la journee, en basculant selon l'intuition plus que selon des regles. Codex pour une tache, Claude Code pour la suivante, parfois les deux pour revoir le meme plan. Les outils sont suffisamment proches en capacites pour que la question "lequel utiliser pour ca ?" importe moins qu'il y a deux semaines.

Ce qui a change, c'est l'economie.

Le plan Plus d'OpenAI est a 20 $/mois avec des limites de plus en plus generereuses. Je me retrouve a utiliser Codex de plus en plus — pas parce qu'il est radicalement meilleur sur un point precis, mais parce que la combinaison de vitesse, d'efficacite en tokens et de ce prix a 20 $ supprime la friction. Il n'y a plus de calcul mental du genre "est-ce que cette tache vaut le coup de bruler des tokens Claude Code ?"

Je penche vers une reduction de mon abonnement Claude Code du tier Max a 200 $/mois vers le plan a 100 $/mois, voire meme le plan Pro a 20 $/mois. Il y a deux semaines, ca m'aurait semble risque. Maintenant ca me semble pratique. Le travail pour lequel j'ai besoin que Claude Code excelle — le design frontend, l'orchestration Agent Teams, le QA automatique qui attrape ce que je raterais — ce sont de vrais avantages. Mais ils ne necessitent peut-etre pas 200 $/mois si Codex gere la moitie de ma charge de travail a 20 $.

Je suis conscient que ce pari comporte des risques. Le tier Claude Code a 20 $ a de vraies limites d'utilisation — si je les atteins pendant une session critique, je regretterai le downgrade. Et les limites genereuses d'OpenAI a 20 $ sont probablement un coup de conquete de marche qui ne durera peut-etre pas eternellement. Mais pour l'instant, l'economie favorise le double jeu.

Le cout total (20 $ Codex + 100 $ ou meme 20 $ Claude Code) serait inferieur a ce que je payais pour Claude Code seul. Et le resultat combine est meilleur que l'un ou l'autre outil utilise seul, a n'importe quel prix.

C'est peut-etre l'enseignement le plus pratique de deux semaines de double jeu : la concurrence ne fait pas que rendre les outils meilleurs. Elle les rend moins chers. Et moins cher signifie que tu peux te permettre les deux.

Ce que j'attends pour la suite

Les deux plateformes accelerent. Codex vient de lancer les plugins, les triggers et un client Windows. Claude Code vient de sortir Agent Teams, AutoMemory, Computer Use et les Scheduled Tasks. Aucun des deux ne reste immobile.

Un theme recurrent dans les communautes de developpeurs sur Reddit — et je pense que ca capture quelque chose de reel — c'est que "Claude Code est de meilleure qualite mais tu atteins les limites. Codex est de qualite legerement inferieure mais plus utilisable au quotidien." L'equilibre evolue a mesure que les deux s'ameliorent.

Mon conseil reste le meme que dans le premier article, mais en plus appuye maintenant : essaie l'autre outil pendant une semaine. Pas pour changer — pour ajouter. Le workflow de revue croisee entre modeles reste la meilleure decouverte que j'ai faite. Et la resilience operationnelle d'avoir deux outils de confiance te sauvera le jour ou l'un des deux tombe en panne.

En tant qu'utilisateur, c'est la meilleure situation possible. Deux excellents outils qui s'ameliorent rapidement, chacun poussant l'autre en avant. Le rythme de la competition est si feroce que je ne pense pas qu'une entreprise puisse rester confortablement en tete tres longtemps — ce qui est exactement la raison pour laquelle miser sur un seul outil semble de plus en plus risque et miser sur le workflow (double jeu, revue croisee entre modeles) semble de plus en plus juste.

Questions frequentes

Ton opinion a-t-elle change depuis le premier article ?

La these centrale — jongler avec les deux bat le fait de choisir un gagnant — n'a fait que se renforcer. Ce qui a change, c'est la repartition (60/40 est devenu 50/50) et les raisons. La force de Codex en raisonnement strategique m'a plus surpris que ses ameliorations en codage.

Codex est-il plus rapide que Claude Code ?

En mode thinking eleve, oui — systematiquement plus rapide, et les comparaisons tierces suggerent qu'il utilise environ 3 fois moins de tokens pour des taches equivalentes. En mode thinking par defaut, l'ecart est plus faible. Pour le travail iteratif ou tu fais beaucoup d'allers-retours, la vitesse et l'efficacite en tokens s'accumulent.

Faut-il s'inquieter de la disponibilite de Claude Code ?

Les chiffres sur 90 jours montrent un ecart reel (99,2 % vs 99,9 %). Si Claude Code est ton seul outil et que tu travailles avec un deadline, aie un plan de secours. Mais Anthropic a sorti environ 10 releases de Claude Code rien qu'en mars — ils iterent vite sur les fonctionnalites meme si la fiabilite est en retard par rapport a OpenAI.

Qu'en est-il de la vulnerabilite de securite de Codex ?

Une faille d'injection de commande dans Codex aurait pu exposer les tokens GitHub via les noms de branches. Elle a ete decouverte et corrigee. Bon a savoir, mais aussi bon de noter que les chercheurs en securite testent activement ces outils — ce qui est positif pour l'ecosysteme.

L'histoire de la strategie newsletter concerne-t-elle vraiment les outils ?

En partie. Les differents modeles ont des styles de raisonnement par defaut differents. GPT-5.4 etait plus enclin a remettre en question mes hypotheses. Claude etait plus enclin a m'aider a bien executer mon plan. Les deux sont utiles — mais pour la strategie produit, "est-ce que tu resous le bon probleme ?" est souvent plus precieux que "voici une bonne implementation."

Quel outil devrais-je acheter ?

Les deux. Ce n'est pas une pirouette — c'est sincerement la meilleure reponse. Codex a 20 $/mois plus Claude Code a 20-100 $/mois te donne de meilleurs resultats que l'un ou l'autre outil seul a n'importe quel prix. Je penche vers un passage de 200 $/mois sur Claude Code a 100 $ voire 20 $, en ajoutant Codex a 20 $. Le cout total diminue et le resultat s'ameliore. Cela dit, les limites genereuses d'OpenAI ne dureront peut-etre pas — alors reste flexible.

Voila, c'est tout pour moi. Si tu menes ta propre experience de double jeu, j'aimerais sincerement savoir comment ta repartition evolue. Les memes schemas, ou quelque chose de completement different ?

Cheers, Chandler