मैं दो हफ्ते Codex इस्तेमाल करने के बाद अपना $200 वाला Claude Code Plan छोड़ रहा हूँ

मेरी पहली तुलना के दो हफ्ते बाद, दोनों टूल्स ने बड़े अपडेट शिप किए। Codex ने मेरी प्रोडक्ट स्ट्रैटेजी को ऐसे चैलेंज किया जैसा Claude Code ने नहीं किया। Claude Code ने Agent Teams और AutoMemory शिप किया। नतीजा: मैं अपना $200/महीने का Max प्लान कम कर रहा हूँ — और कम पैसों में बेहतर आउटपुट मिल रहा है।

दो हफ्ते पहले मैंने Codex और Claude Code को एक साथ इस्तेमाल करने के बारे में लिखा था। वो पोस्ट मेरी अब तक की सबसे ज़्यादा resonate करने वाली पोस्ट रही — पता चला कि बहुत सारे लोग वही experiment कर रहे हैं।

उस वक्त मेरा working model साफ था: Claude Code execution quality और QA के लिए, Codex architectural reasoning और sustained plans के लिए। दोनों टूल्स, अलग-अलग ताकतें, और ज़रूरी काम के लिए cross-model review।

दो हफ्ते बाद, दोनों टूल्स ने बड़े अपडेट शिप किए हैं और balance शिफ्ट हो गया है। बहुत dramatically नहीं — लेकिन इतना ज़रूर कि इसके बारे में लिखना बनता है। (Record के लिए, मैं ये पोस्ट Claude Code में ड्राफ्ट कर रहा हूँ — loyalty की वजह से नहीं, बल्कि इसलिए कि मेरा current billing cycle अभी चल रहा है और जो पैसे पहले ही commit हो चुके हैं उन्हें बर्बाद नहीं करना चाहता। इस तरह की practical calculation ही इस पोस्ट का पूरा point है।)

मार्च 2026 दोनों platforms के लिए intense रहा। Codex ने plugins लॉन्च किए जिनमें Slack, Gmail, Linear, Figma, Sentry और बहुत कुछ के integrations हैं — साथ ही Triggers automated GitHub workflows के लिए, GPT-5.4 mini और nano models, और Windows native support। Claude Code ने Agent Teams (multi-agent orchestration, अभी experimental), AutoMemory, Computer Use (सिर्फ macOS, Pro/Max plans), /loop के ज़रिए Scheduled Tasks, और सिर्फ मार्च में करीब 10 releases शिप किए। दोनों platforms तेज़ी से आगे बढ़ रहे हैं।

Newsletter की कहानी (क्यों ये सिर्फ Code के बारे में नहीं है)

जिस observation ने मेरी सोच बदली, उसका code लिखने से कोई लेना-देना नहीं था।

मेरी साइट पर एक पूरा newsletter system है — subscribe form, post CTAs, welcome email, daily cron, double opt-in, 13-locale support। technically सब कुछ काम करता है। समस्या: शून्य verified subscribers।

मैंने इसे ठीक करने का एक प्लान बनाया: अपने course से एक lead magnet PDF निकालो, Module 1 को email के पीछे gate करो, mid-article CTAs लगाओ, AI chatbot को subscribe flow में hook करो, YouTube और LinkedIn से redistribute करो। सात नई चीज़ें।

मैंने ये प्लान Claude Code के साथ बनाया। productive feel हुआ।

फिर मैंने वही brief Codex को दिया। Pushback तुरंत आया।

Lead magnet redundant था — Module 1 पहले से ही free है। एक साथ बहुत सारे surfaces — अगर सातों बना लो, तो पता नहीं चलेगा कौन सा काम कर रहा है। समस्या infrastructure नहीं, copy है। "Stay in the loop" generic है। Verification email काफ़ी persuasive नहीं है। Interest selection friction बढ़ाता है।

Codex का प्लान: पहले जो है उसे ठीक करो (copy rewrite करो, verification email improve करो, friction कम करो), एक नया surface add करो (एक inline blog CTA), और कुछ भी बनाने से पहले GA events से measure करो।

मेरा प्लान था "और चीज़ें बनाओ।" Codex का प्लान था "जो पहले से है उसे बेहतर बनाओ, फिर एक नई चीज़ test करो।" मेरे प्लान में एक हफ्ता लगता और पता नहीं चलता क्या काम किया। Codex का एक दिन में ship हो सकता है और exactly बताता है अगला investment कहाँ करना है।

मुझे मानना होगा — इसने मुझे off guard पकड़ लिया। इसलिए नहीं कि Claude strategy में खराब है। मुझे लगता है अगर मैंने ज़्यादा carefully prompt किया होता — "execute करने से पहले मेरे assumptions को challenge करो" — तो शायद similar pushback मिलता। लेकिन default reasoning style noticeably अलग था। GPT-5.4 का default था "premise को question करो।" Claude का default था "plan को अच्छे से execute करो।"

Product decisions के लिए ये फ़र्क मायने रखता है।

Speed और Steering

दो चीज़ें जो मैंने notice की हैं और जो daily workflow को उम्मीद से ज़्यादा affect करती हैं।

Speed और token efficiency: Codex GPT-5.4 के साथ high thinking पर, equivalent tasks के लिए Opus 4.6 high thinking से consistently तेज़ है। Third-party comparisons suggest करती हैं कि Codex similar काम के लिए लगभग 3x कम tokens इस्तेमाल करता है — एक benchmark ने एक Figma-style task पर 1.5 million tokens measure किए जहाँ Claude ने 6.2 million इस्तेमाल किए। Claude ज़्यादा "ज़ोर से सोचता है," जिससे higher-quality reasoning आती है लेकिन limits तेज़ी से खत्म होती हैं। 20 मार्च के आसपास से, Opus ज़्यादा tool calls करता दिख रहा है — जवाब तक पहुँचने से पहले ज़्यादा intermediate steps। मुझे नहीं पता ये model change है या coincidence, लेकिन ये feel होता है।

Real-time steering: जब मैं tool के काम करते वक्त नया message भेजता हूँ — "रुको, वो direction नहीं, ये try करो" — Codex उसे लगभग तुरंत पढ़ लेता है और adjust कर लेता है। Claude Code अपना current execution पूरा करने के बाद correction पढ़ता है।

ये छोटी बात लग सकती है। लेकिन है नहीं। जब आप एक agent को गलत रास्ते पर जाते देख रहे हो और course-correct करना चाहते हो, तो "अभी correction पढ़ लेता है" और "current operation पूरा होने के बाद पढ़ता है" के बीच का lag एक पूरे work session में compound होता रहता है।

SSE Bug: एक Concrete Example

मैं एक नई iOS app बना रहा था। Claude Code ने सभी features — auth, agents, chat, frameworks, dashboard, profile — में 40 Swift files produce कर दिए। Impressive breadth। लेकिन एक critical bug बचा रहा: real-time chat के लिए SSE streaming काम नहीं कर रही थी।

Backend ठीक था। Curl काम कर रहा था। लेकिन Swift client में URLSessionDataDelegate.didReceive(data:) fire नहीं हो रहा था। Claude Code ने इस पर घंटों काम किया। Multiple approaches, multiple debugging sessions।

मैंने वही problem Codex को दिया। कुछ attempts बाद: commit 7f592152 — "fix(ios): restore real-time chat streaming."

क्या ये representative है? शायद नहीं। हर tool के अच्छे और बुरे दिन होते हैं। लेकिन मेरे experience से, जब Claude Code एक debugging loop में फँस जाता है — एक ही approach के increasingly clever variations try करता रहता है — तो Codex पर switch करने से अक्सर deadlock टूटता है क्योंकि GPT-5.4 शुरू से ही problem को अलग तरीके से frame करता है।

जहाँ Claude Code अभी भी जीतता है

इस पोस्ट को पढ़कर ये conclude करना आसान होगा कि Codex हर जगह आगे निकल रहा है। ये गलत होगा। Claude Code ने भी इस महीने ज़बरदस्त ship किया, और इसके कई advantages actually बढ़े हैं।

Agent Teams. ये फरवरी में launch हुआ और मार्च भर mature होता रहा। कई Claude Code instances parallel में काम करते हैं — एक explorer, एक code reviewer, एक implementer, एक test runner — dependency tracking और shared task lists के साथ। ये अभी experimental है और default रूप से disabled, लेकिन जब enable होता है तो genuinely impressive है। Codex में भी multi-agent support है (tasks isolated cloud containers में चलती हैं), लेकिन Claude Code की Agent Teams ज़्यादा coordinated feel होती हैं। बड़े refactors जहाँ कई files touch होती हैं, वहाँ Agent Teams currently better experience हैं।

AutoMemory. Claude Code अब automatically आपकी habits के आधार पर memory rules लिखता है। कुछ sessions के बाद, उसे आपकी project structure, naming conventions, preferences — सब पता होता है। ये subtle है लेकिन cumulative effect ये है कि Claude Code sessions time के साथ ज़्यादा productive होते जाते हैं, जो Codex sessions में अभी नहीं होता।

Frontend design. Claude Code /frontend-design plugin के साथ अभी भी noticeably ज़्यादा polished, design-system-aware UI produce करता है बनिस्बत Codex के equivalent skill के। मैंने 26 मार्च को एक site redesign के दौरान इसे directly test किया। Claude का output बेहतर spatial composition, ज़्यादा consistent styling, और ज़्यादा cohesive result था। ये शायद harness advantage है (Claude का plugin system skill को ज़्यादा context के साथ run करता है), लेकिन practical result साफ है।

Code quality. Reddit पर 500+ developer comments की एक community analysis में पाया गया कि developers ने करीब 67% blind comparisons में Claude Code का output prefer किया — cleaner, ज़्यादा idiomatic, बेहतर structured code note करते हुए। ये मेरे experience से भी match करता है। जब code को सिर्फ functional ही नहीं बल्कि maintainable भी होना चाहिए, Claude Code का edge है।

Automatic QA. अभी भी killer feature। काम पूरा करने के बाद, Claude Code automatically review agents dispatch करता है — code review, consistency checks, gap analysis — बिना मेरे पूछे। Codex अभी ये नहीं करता। जहाँ correctness speed से ज़्यादा मायने रखती है, वहाँ ये अकेला feature Claude Code को workflow में बनाए रखता है।

Reliability का सवाल

मैं कुछ ऐसा share करना चाहता हूँ जिससे ज़्यादातर comparison posts बचती हैं।

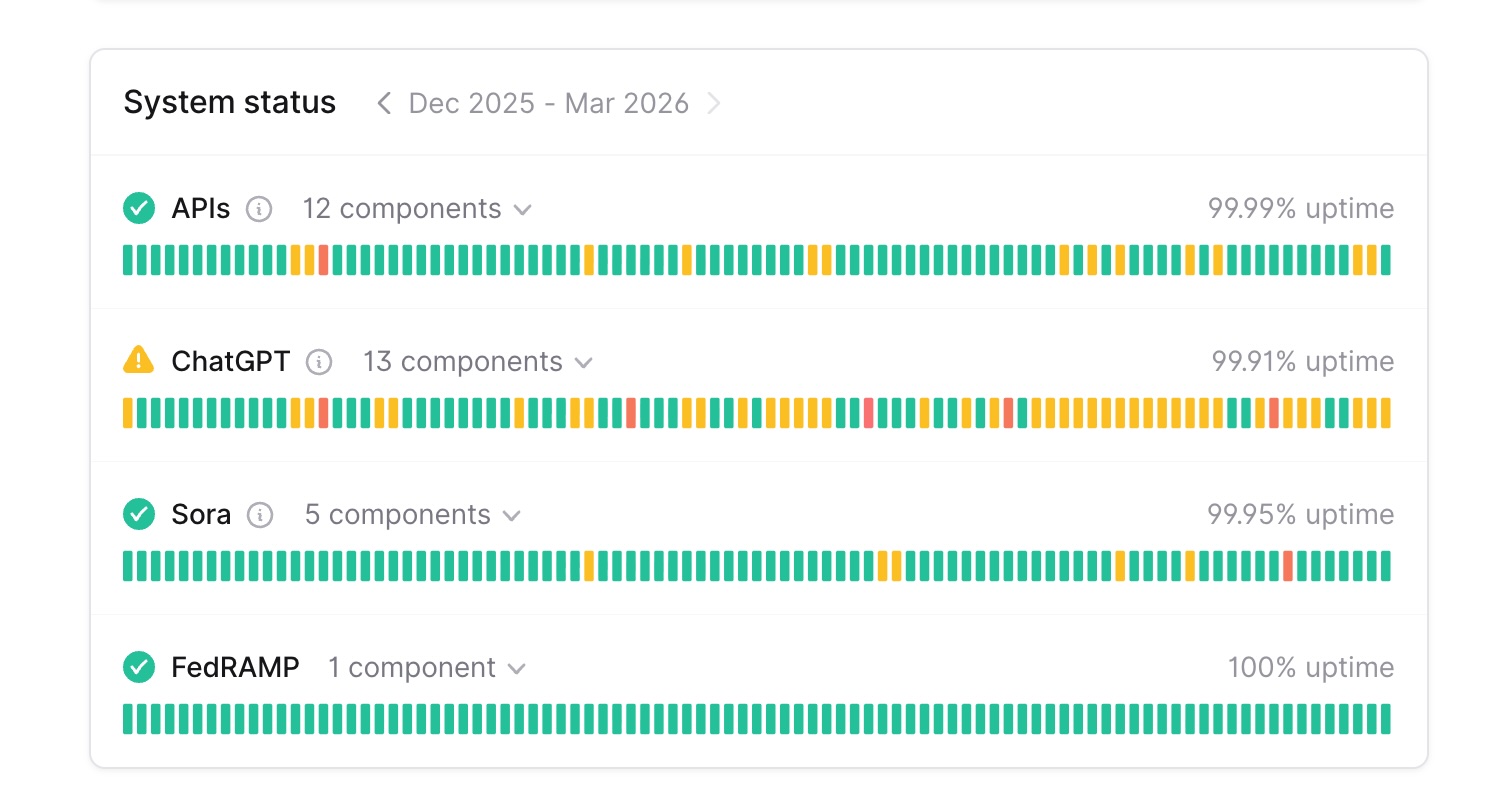

ये मार्च 2026 के अंत तक दोनों status pages से 90-day uptime numbers हैं:

| Service | Anthropic | OpenAI |

|---|---|---|

| Main platform | claude.ai: 99.16% | ChatGPT: 99.91% |

| API | api.anthropic.com: 99.24% | APIs: 99.99% |

| Developer tools | Claude Code: 99.48% | — |

| Console | platform.claude.com: 99.41% | — |

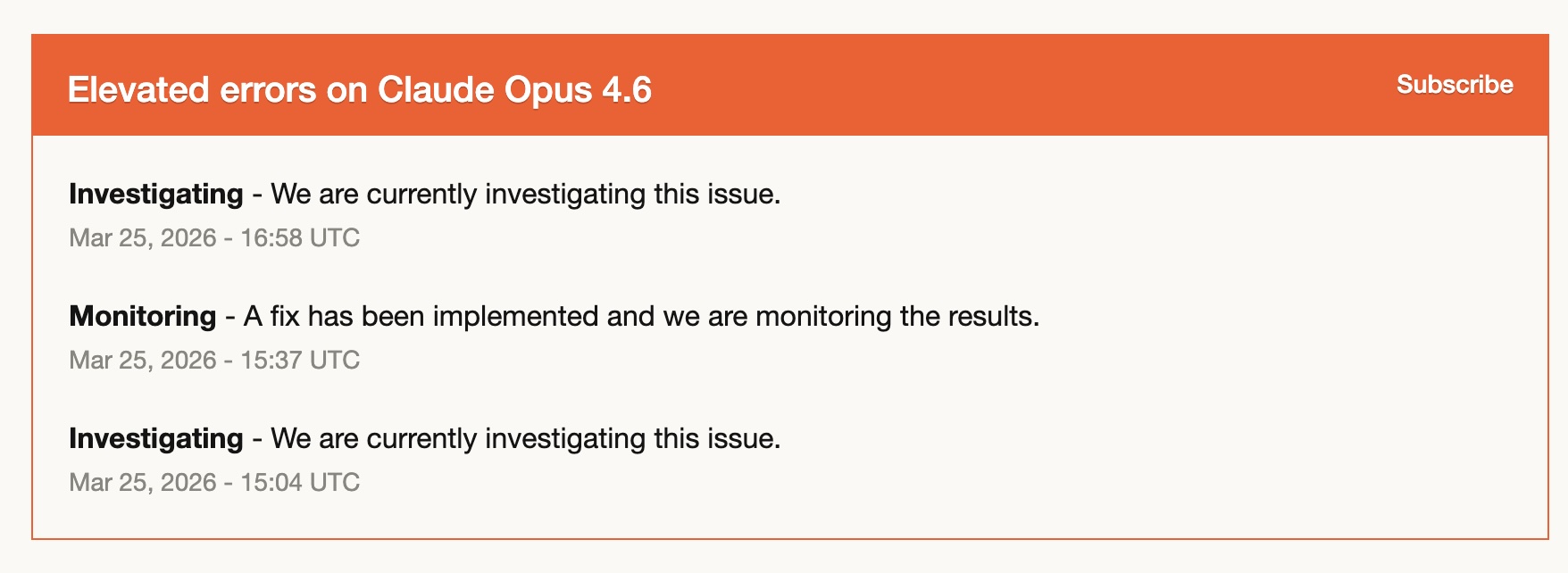

Gap real है। 90 दिनों में, Anthropic की services ने OpenAI के मुकाबले लगभग 8-10x ज़्यादा downtime experience किया। 25 मार्च को एक specific incident था — "Elevated errors on Claude Opus 4.6" — जिसमें investigating-fix-investigating cycle लगभग दो घंटे चला।

Fairness में कहूँ तो ये पूरी picture नहीं है। Reliability सिर्फ uptime नहीं है। BeyondTrust की Phantom Labs ने publicly Codex में एक command injection vulnerability disclose की जो branch name manipulation के ज़रिए GitHub authentication tokens expose कर सकती थी। ये flaw web UI, CLI, SDK, और IDE integrations को affect करता था — user-controllable branch name सीधे shell command में बिना sanitization के pass हो रहा था। OpenAI ने इसे patch किया, लेकिन ये reminder है कि stability और security reliability के अलग-अलग dimensions हैं, और दोनों matter करते हैं।

मैं uptime data Anthropic को bash करने के लिए share नहीं कर रहा। मैं Claude Code हर रोज़ use करता हूँ और ये excellent बना हुआ है। लेकिन जो लोग अपना professional workflow इन tools के इर्द-गिर्द बना रहे हैं, उनके लिए ये numbers जानना ज़रूरी है। और इसीलिए dual-wielding सिर्फ nice to have नहीं है — जब एक service की खराब afternoon हो, आप switch करके काम जारी रखते हो। मैंने दो हफ्तों में तीन बार ये किया है।

Plugin Gap कम हो रहा है

मेरी original पोस्ट में, मैंने note किया था कि Claude Code का plugin ecosystem ज़्यादा mature था। दो हफ्ते पहले ये सच था। आज कम सच है।

Codex ने 27 मार्च को अपना plugin system लॉन्च किया जिसमें Slack, Gmail, Google Drive, Linear, Figma, Sentry, Notion, और Hugging Face के integrations हैं। साथ ही skills, hooks (जिनमें SessionStart और UserPromptSubmit events शामिल हैं), MCP servers, और app और CLI दोनों में plugin directory।

Feature set converge हो रहा है। दोनों tools में अब हैं: reusable workflows के लिए plugins/skills, event-driven automation के लिए hooks, MCP server integration, और external services के साथ app-level integrations।

जहाँ Claude Code अभी भी lead करता है: existing plugin ecosystem deeper है। Superpowers (structured planning), /feature-dev (guided development), और /frontend-design जैसे plugins महीनों से refined हो रहे हैं। Codex की plugin directory नई है और individual plugins कम battle-tested हैं।

जहाँ Codex आगे निकल रहा है: Triggers. Codex GitHub events पर auto-respond कर सकता है — एक issue आता है, Codex auto-fix करता है, PR open करता है। ये automation की एक नई category है जो Claude Code अभी offer नहीं करता। जो teams autonomous engineering workflows चाहती हैं, उनके लिए Triggers एक significant differentiator है।

मेरा Updated Working Model

दो हफ्ते पहले, मैंने काम लगभग 60/40 Claude Code/Codex में split किया था। मेरे पास एक clear mental model था: quality चाहिए तो Claude Code, architectural reasoning चाहिए तो Codex।

वो neat split अब dissolve हो गया है। अब मैं दोनों को पूरे दिन use करता हूँ, rules से ज़्यादा feel के आधार पर switch करता हूँ। एक task के लिए Codex, अगले के लिए Claude Code, कभी-कभी दोनों एक ही plan review कर रहे होते हैं। दोनों tools capability में इतने करीब हैं कि "इस काम के लिए कौन सा use करूँ?" वाला सवाल अब उतना matter नहीं करता जितना दो हफ्ते पहले करता था।

जो बदला है वो economics है।

OpenAI का Plus plan $20/महीने है जिसमें increasingly generous limits हैं। मैं खुद को Codex की तरफ ज़्यादा से ज़्यादा जाते पा रहा हूँ — इसलिए नहीं कि ये किसी एक चीज़ में dramatically बेहतर है, बल्कि इसलिए कि speed, token efficiency, और उस $20 price point का combination friction हटा देता है। कोई mental calculation नहीं कि "क्या ये task Claude Code tokens burn करने लायक है?"

मैं अपने Claude Code plan को $200/महीने के Max tier से $100/महीने के plan पर लाने की सोच रहा हूँ, शायद $20/महीने के Pro plan पर भी। दो हफ्ते पहले ये risky लगता। अब practical लगता है। जिन चीज़ों में Claude Code को excellent होना ज़रूरी है — frontend design, Agent Teams orchestration, automatic QA जो वो चीज़ें पकड़ लेता है जो मुझसे छूट जातीं — वो real advantages हैं। लेकिन शायद इनके लिए $200/महीने ज़रूरी नहीं अगर Codex मेरा आधा workload $20 में handle कर ले।

मुझे पता है इस bet में risks हैं। $20 वाले Claude Code tier में real usage limits हैं — अगर critical session में hit हो गए, तो downgrade पर पछतावा होगा। और OpenAI की generous $20 limits शायद market-share play है जो हमेशा नहीं रहेगी। लेकिन अभी economics dual-wielding के favor में हैं।

Total cost ($20 Codex + $100 या $20 Claude Code भी) अकेले Claude Code के लिए जो pay कर रहा था उससे कम होगा। और combined output दोनों में से किसी भी tool के solo output से किसी भी price पर बेहतर है।

ये शायद दो हफ्तों की dual-wielding से सबसे practical takeaway है: competition सिर्फ tools को बेहतर नहीं बना रही। ये उन्हें सस्ता भी बना रही है। और सस्ता मतलब आप दोनों afford कर सकते हो।

आगे क्या उम्मीद है

दोनों platforms accelerate कर रहे हैं। Codex ने अभी-अभी plugins, triggers, और Windows client लॉन्च किया। Claude Code ने अभी Agent Teams, AutoMemory, Computer Use, और Scheduled Tasks शिप किए। कोई रुका नहीं है।

Reddit पर developer communities में एक recurring theme — और मुझे लगता है ये कुछ real capture करता है — ये है कि "Claude Code higher quality है लेकिन limits hit होती हैं। Codex slightly lower quality है लेकिन day-to-day ज़्यादा usable है।" Balance दोनों के improve होने के साथ shift होता रहता है।

मेरी सलाह पहली पोस्ट जैसी ही है, बस अब ज़्यादा strongly: दूसरे tool को एक हफ्ते के लिए try करो। Switch करने के लिए नहीं — add करने के लिए। Cross-model review workflow अब भी मेरी सबसे बड़ी discovery है। और दो tools पर भरोसा होने की operational resilience उस दिन काम आएगी जब एक down हो जाए।

एक user के तौर पर, ये सबसे बेहतरीन situation है। दो excellent tools तेज़ी से और बेहतर हो रहे हैं, हर एक दूसरे को आगे push कर रहा है। Competition की pace इतनी fierce है कि मुझे नहीं लगता कोई company लंबे समय तक comfortably आगे रह सकती है — और इसीलिए एक tool पर bet लगाना increasingly risky लगता है और workflow पर bet लगाना (dual-wielding, cross-model review) increasingly right।

अक्सर पूछे जाने वाले सवाल

क्या पहली पोस्ट से आपकी राय बदली है?

Core thesis — dual-wielding एक winner चुनने से बेहतर है — और मज़बूत हुई है। जो बदला वो split है (60/40 से 50/50 हो गया) और reasons। Codex की strategic reasoning में ताकत ने मुझे उसके coding improvements से ज़्यादा surprise किया।

क्या Codex Claude Code से तेज़ है?

High thinking पर, हाँ — consistently तेज़, और third-party comparisons suggest करती हैं कि ये equivalent tasks के लिए लगभग 3x कम tokens use करता है। Default thinking पर gap छोटा है। Iterative काम जहाँ बार-बार आगे-पीछे होता है, वहाँ speed और token efficiency का फ़र्क जमा होता जाता है।

क्या Claude Code की uptime की चिंता करनी चाहिए?

90-day numbers एक real gap दिखाते हैं (99.2% vs 99.9%)। अगर Claude Code आपका इकलौता tool है और deadline के against काम कर रहे हो, तो backup plan रखो। लेकिन Anthropic ने सिर्फ मार्च में करीब 10 Claude Code releases शिप किए — features पर तेज़ी से iterate कर रहे हैं भले ही reliability OpenAI से trailing है।

Codex security vulnerability के बारे में क्या?

Codex में एक command injection flaw था जो branch names के ज़रिए GitHub tokens expose कर सकता था। इसे discover और address कर लिया गया। जानना ज़रूरी है, लेकिन ये भी note करने लायक है कि security researchers actively इन tools को test करते हैं — जो ecosystem के लिए अच्छी बात है।

क्या newsletter strategy वाली कहानी सच में tools के बारे में है?

कुछ हद तक। अलग-अलग models के अलग-अलग default reasoning styles होते हैं। GPT-5.4 ज़्यादा likely था मेरे assumptions को challenge करने में। Claude ज़्यादा likely था मेरे plan को अच्छे से execute करने में। दोनों useful हैं — लेकिन product strategy के लिए, "क्या तुम सही problem solve कर रहे हो?" अक्सर "ये रही एक अच्छी implementation" से ज़्यादा valuable होता है।

कौन सा tool खरीदना चाहिए?

दोनों। ये cop-out नहीं है — genuinely सबसे अच्छा जवाब यही है। Codex $20/महीने पर plus Claude Code $20-100/महीने पर, किसी भी एक tool अकेले किसी भी price पर से बेहतर results देता है। मैं Claude Code पर $200/महीने से $100 या $20 तक कम करने और Codex $20 पर add करने की तरफ झुक रहा हूँ। Total cost कम होती है और output बढ़ता है। हाँ, OpenAI की generous limits शायद हमेशा न रहें — तो flexible रहो।

मेरी तरफ से बस इतना। अगर आप भी अपना dual-wielding experiment चला रहे हो, तो मैं genuinely जानना चाहूँगा कि आपका split कैसे evolve हो रहा है। Same patterns, या कुछ बिल्कुल अलग?

Cheers, Chandler