3 अप्रैल 2026 को मैंने कहा था कि मैं 30 दिनों बाद वापस आकर साफ-साफ बताऊँगा कि Claude Max छोड़ने के बाद असल में क्या हुआ।

मैं ग्यारह दिन पहले ही लौट आया हूँ।

इसलिए नहीं कि मैं impatient हूँ। बल्कि इसलिए कि pattern अब settle हो चुका है, और 2 मई तक जवाब रोककर रखना ज़्यादातर theatre होता।

Punchline पहली नज़र में गलत लगती है। Claude Code नाम का एक tool अब वह tool है जिसे मैं लगभग हर चीज़ के लिए इस्तेमाल करता हूँ, code को छोड़कर।

Short version यह है:

- GPT-5.4 वाला Codex xHigh thinking पर coding seat ले चुका है।

- Opus 4.7 वाला Claude Code xHigh पर मेरी desk की बाकी सारी seats ले चुका है।

- "सस्ता Codex" वाली कहानी उस वक्त टूट गई जब असली limits सामने आईं।

अगर मुझे इसे सबसे साफ thesis में compress करना हो, तो शायद यह होगा:

Coding से जुड़ी हर चीज़ के लिए xHigh पर Codex-GPT-5.4. बाकी सबके लिए xHigh पर Claude Code with Opus 4.7.

उन्नीस दिन पहले मैं इतनी sharp split की उम्मीद नहीं कर रहा था।

और यह जवाब मेरी उम्मीद से ज़्यादा महँगा भी निकला, और मनोवैज्ञानिक रूप से ज़्यादा revealing भी।

जो सबसे पहले टूटा, वह code quality नहीं थी

जब मैंने cancellation post लिखा, तब simple कहानी बहुत appealing लग रही थी:

- Claude Max: $200/month

- Codex / ChatGPT: $20-25/month

- execution quality gap तेज़ी से shrink कर रही थी

- OpenAI reliability ज़्यादा मजबूत दिख रही थी

वह एक आसान downgrade जैसा लग रहा था।

लेकिन वैसा नहीं था।

सबसे पहले जो टूटा, वह architecture नहीं था, plan quality नहीं थी, execution discipline नहीं थी।

वह थी limits story।

मेरी असली timeline कुछ ऐसी दिखी:

- Apr 6: मैंने monthly billing पर $25/month वाले दो ChatGPT Business seats लिए।

- Apr 6: उसी दिन से मैं workaround terms में सोचने लगा था। अगर मुझे लगभग वही coding pace रखनी है, तो शायद मुझे करीब तीन Codex-capable accounts चाहिए होंगे।

- Apr 10: कुछ दिन उस setup में रहने की कोशिश करने के बाद मेरे पास इतना evidence था कि मैं इसे ज़ोर से कह सकूँ: तीन सस्ते accounts भी वह चीज़ recreate नहीं कर पाए जो Claude Max plan अपने best पर देता था।

- Apr 12: मैंने ChatGPT Pro $100/month लिया, क्योंकि pure coding के लिए Codex जितना ज़्यादा इस्तेमाल किया, उतना ही मुझे high और xHigh reasoning पर GPT-5.4 ज़्यादा चाहिए था, कम नहीं।

यह 3 अप्रैल वाले post की पहली ईमानदार correction है।

Replacement यह नहीं था कि "$200 वाला Claude Max, $20 वाला Codex बन गया।"

असल में यह कुछ ऐसा था:

- "मुझे अब वही पुराना Anthropic plan नहीं चाहिए जो पहले चाहिए था।"

- "लेकिन मुझे cheap tier से ज़्यादा Codex capacity चाहिए।"

- "असली comparison benchmark screenshots नहीं, बल्कि real limits के नीचे workflow quality है।"

मेरा current read यह है कि OpenAI शायद limits पर aggressive इसलिए है क्योंकि उसे market share चाहिए। यह inference है, insider knowledge नहीं। अगर यह सही है, तो यह window हमेशा खुली नहीं रहेगी।

तो अगर आप अपना पूरा फैसला आज की $20 economics पर रख रहे हैं, तो कम-से-कम यह मानना चाहिए कि pricing environment tactical हो सकती है, stable नहीं।

Codex ने coding seat ले ली

सबसे बड़ी चीज़ जो मैंने सीखी, वह यह है कि xHigh thinking पर GPT-5.4 एक coding specialist जैसा लगता है।

कोई charismatic specialist नहीं।

कोई warm specialist नहीं।

और ऐसा भी नहीं कि वह आपका दोस्त बनना चाहता हो।

लेकिन specialist ज़रूर।

Codex में एक तरह की bare, no-nonsense quality है, जो मुझे उम्मीद से ज़्यादा पसंद आई। ऐसा लगता है जैसे आप किसी methodical, careful engineer के साथ काम कर रहे हैं, जो आप पर personality perform नहीं कर रहा।

लंबे workdays में यह बात मेरी उम्मीद से ज़्यादा important निकली।

मेरे लिए सबसे clear moment 17 अप्रैल था। मैंने Codex-GPT-5.4 xHigh को एक agreed plan दिया और उसे काम करने दिया। वह एक single session में तीस से पैंतालीस मिनट तक लगातार चला, plan को closely follow करते हुए, unit tests, integration tests, और browser tests local पर लिखते और चलाते हुए, बिना इस बात के कि मुझे हर मिनट उसके ऊपर बैठे रहना पड़े।

किसी और tool के साथ मुझे यह consistency नहीं मिली।

उसने Codex के बारे में मेरी सोच बदल दी। यह सिर्फ "छोटे कामों पर good enough" नहीं है। जब plan clear हो, तो यह लंबी, disciplined execution कर सकता है।

Pure coding work के लिए मैं अब लगभग हमेशा Codex पर जाता हूँ:

- architecture

- implementation

- debugging

- eval design

- test framing

- pipeline cleanup

- production-minded product logic

अप्रैल का सबसे अच्छा example Prova है।

Prova में सबसे useful काम glamorous नहीं था। वह "देखो model कितना smart है" वाला काम नहीं था। वह था:

- composable sprints evaluate करना

- onboarding logic tighten करना

- roadmap generation और assigned sprint state के बीच contradictions ढूँढना

- real user rows और actual production behavior के आधार पर product improve करना

ऐसा काम Codex पर surprisingly अच्छा बैठता है।

जब job यह हो:

- contradiction identify करो

- logic bug isolate करो

- correctness को RFC territory से अलग करो

- smallest defensible next move recommend करो

तब यह competent, thorough और sharp निकलता है।

सबसे clear examples में से एक Prova की एक production row से आया, जो एक builder-intent user की थी।

System ने:

- एक builder-intent user को

marketing_vplabel किया था table-stakes-diagnosticassign किया था- एक ऐसा roadmap generate किया था जो journey में बाद में शुरू हो रहा था

- onboarding के तुरंत बाद Context Check card दिखा दिया था

उस episode को useful बनाने वाली चीज़ सिर्फ diagnosis नहीं थी, बल्कि cross-review loop था।

Opus 4.7 मुझे पहले तीन issues तक ले गया:

- एक track-calculation bug

- एक timing bug

- एक builder-opener / RFC question

फिर GPT-5.4 ने analysis को आगे धकेला और वह contradiction पकड़ ली जो Opus miss कर गया था:

- assigned first sprint और generated roadmap पहले से ही उसी user को दो अलग truths बता रहे थे

वह matter करता था। उसने conversation को "क्या हमें Builder RFC अभी ship करना चाहिए?" से "पहले live contradiction fix करो, फिर RFC पर वापस आओ" में बदल दिया।

यह ऐसा नहीं लगा जैसे कोई model मुझे impress करने की कोशिश कर रहा हो। यह ऐसा लगा जैसे कोई senior SWE कह रहा हो: पहले current contradiction fix करो, फिर product theory पर बात करेंगे।

यह pattern इस महीने इतनी बार repeat हुआ कि अब मैं Codex को "सस्ता alternative" नहीं मानता। मैं इसे अपना primary coding instrument मानता हूँ।

Claude Code ने बाकी सारी seats ले लीं

अगर कहानी यहीं खत्म हो जाती, तो जवाब simple होता: Codex पर switch करो और आगे बढ़ो।

लेकिन ऐसा नहीं हुआ।

Opus 4.7 वाला Claude Code अभी भी उस काम में बेहतर है जहाँ output taste पर depend करती है, या जहाँ loop लंबा, iterative और context-heavy होता है।

यहीं इस post का title contradictory लगना बंद करता है और accurate लगने लगता है। Claude Code, वह CLI जिसे मैं instinct से तब उठाता था जब code लिखना होता था, अब वह tool है जिसकी तरफ मैं तब जाता हूँ जब मुझे code के अलावा कुछ करना होता है।

"Everything else" से मेरा मतलब है:

- ऐसी writing जो मेरी तरह सुनाई दे

- structure और rhythm पर iteration

- naming और positioning

- taglines और brand phrasing

- blog cover art के लिए image prompts

- logo और identity exploration

- बेहतर

/frontend-designpasses, जब काम को सिर्फ functional UI नहीं बल्कि visual judgment चाहिए - लंबे research threads, जहाँ मैं कई sessions में एक point of view build कर रहा होता हूँ

पिछले उन्नीस दिनों के अनुभव में यह बार-बार सच साबित हुआ है।

Gap सबसे ज़्यादा clear तब होती है जब feedback loop मौजूद हो।

Claude और Codex दोनों historical posts पढ़ सकते हैं, past prompts inspect कर सकते हैं, और existing work को reference की तरह use कर सकते हैं। लेकिन जब मैं multiple refinement rounds कर रहा होता हूँ, और हर कोशिश के बाद feedback दे रहा होता हूँ, Claude अब भी ज़्यादा reliably उस दिशा को समझता है जिसकी ओर मैं जाना चाहता हूँ।

यह writing पर लागू होता है।

यह image prompting पर लागू होता है।

यह naming पर लागू होता है।

सबसे clear product example Prova है। वह नाम मुझे Codex से नहीं मिला। उस तरह के काम के लिए मुझे Opus चाहिए था। Brand-language exploration की बहुत-सी चीज़ों में भी यही सच है। GPT-5.4 मुझे solid, competent answers देता है। Opus मुझे stronger creative range देता है।

यही pattern site design में भी दिखता है।

Superpowers के तहत /frontend-design workflow मुझे Opus पर GPT-5.4 की तुलना में बेहतर लगती है, जब काम design-led हो engineering-led नहीं। Codex मुझे कुछ functional देता है। Claude मुझे ज़्यादा बार कुछ ऐसा देता है जिसे मैं genuinely गर्व से ship करना चाहूँ।

तो अगर सवाल यह है:

"क्या Codex ने Claude को हर चीज़ में replace कर दिया?"

नहीं।

उसने Claude को coding seat में replace किया। हर चीज़ में नहीं।

यह distinction important है।

Familiarity real थी, और withdrawal भी

मैं करीब 13 महीनों से Claude Code इस्तेमाल कर रहा था।

इतना समय सिर्फ आपकी preference list नहीं बदलता, आपके body language of work को भी बदल देता है।

जब मैंने ज़्यादा aggressively Codex की तरफ switch किया, तो मुझे सचमुच एक तरह का withdrawal effect महसूस हुआ।

इसलिए नहीं कि Codex खराब था।

बल्कि इसलिए कि वह अलग था।

Friction points छोटे थे, लेकिन persistent:

- कुछ permission confirmations

- कुछ moments में यह feeling कि उसने एक सवाल ज़्यादा पूछ लिया

- responses का थोड़ा sterile tone

- loop में उस familiar Claude "voice" की कमी

ये objective defects नहीं हैं।

ये workflow differences हैं।

और familiarity यह बदल देती है कि आप इन्हें कैसे महसूस करते हैं।

मैं यह pretend नहीं करना चाहता कि मैंने यह transition किसी pure rational economist की तरह navigate की।

मैंने ऐसा नहीं किया।

एक point पर मैंने खुद को सिर्फ extra safety-net review pass के लिए Claude से काम कराते पकड़ा, इसलिए नहीं कि मुझे दूसरी राय चाहिए थी, बल्कि इसलिए कि वह pull मेरी अपनी "मैं साफ-साफ switch कर रहा हूँ" narrative से ज़्यादा मजबूत थी।

उसने मुझे यह सिखाया कि real dependency सिर्फ Claude की raw capability पर नहीं थी। वह safety के feeling पर भी थी जो मुझे loop में एक दूसरे intelligent system के होने से मिलती थी, जिस पर मैं अलग तरह से trust करता था।

इसी वजह से मेरे लिए final answer कभी भी "हमेशा के लिए एक चुन लो" नहीं हो सकती थी।

Workflow की psychology भी matter करती है।

Codex के अपने failure modes भी हैं

यह stretch सिर्फ Codex victories की लंबी string नहीं थी।

मुझे real issues भी मिले।

पहली चीज़ जो genuinely Codex-specific problem जैसी लगी, वह 14 अप्रैल को हुई। दो terminal sessions में मुझे यह error मिला:

{

"error": {

"message": "Unknown parameter: 'prompt_cache_retention'.",

"type": "invalid_request_error",

"param": "prompt_cache_retention",

"code": "unknown_parameter"

}

}

यह इसलिए matter करता है क्योंकि यह trust को reasoning layer पर नहीं, harness layer पर तोड़ता है।

मैंने यह भी notice किया कि Codex deployment या production touch करने जैसी चीज़ों में model को क्या करने दिया जाए, इसे लेकर ज़्यादा strict लगता है, even तब भी जब उसी session में approvals पहले ही grant हो चुकी हों।

कभी-कभी यह अच्छी बात है।

कभी-कभी annoying।

लेकिन यह real user experience का हिस्सा ज़रूर है।

एक छोटा example जो मुझे genuinely Codex side पर बेहतर लगता है: main flow interrupt किए बिना status और limits check करना। /status चला पाना बिना current work खत्म होने का wait किए, छोटी बात लगती है, लेकिन उन्नीस दिनों में ऐसी ergonomics accumulate होती जाती हैं।

यही मेरा मतलब है जब मैं कहता हूँ कि tools सिर्फ output quality में अलग नहीं हैं। वे harness feel में भी अलग हैं।

Reliability अब भी matter करती है, और अप्रैल ने Claude की मदद नहीं की

शुरुआत में switch करने में comfortable महसूस करने की एक वजह reliability भी थी।

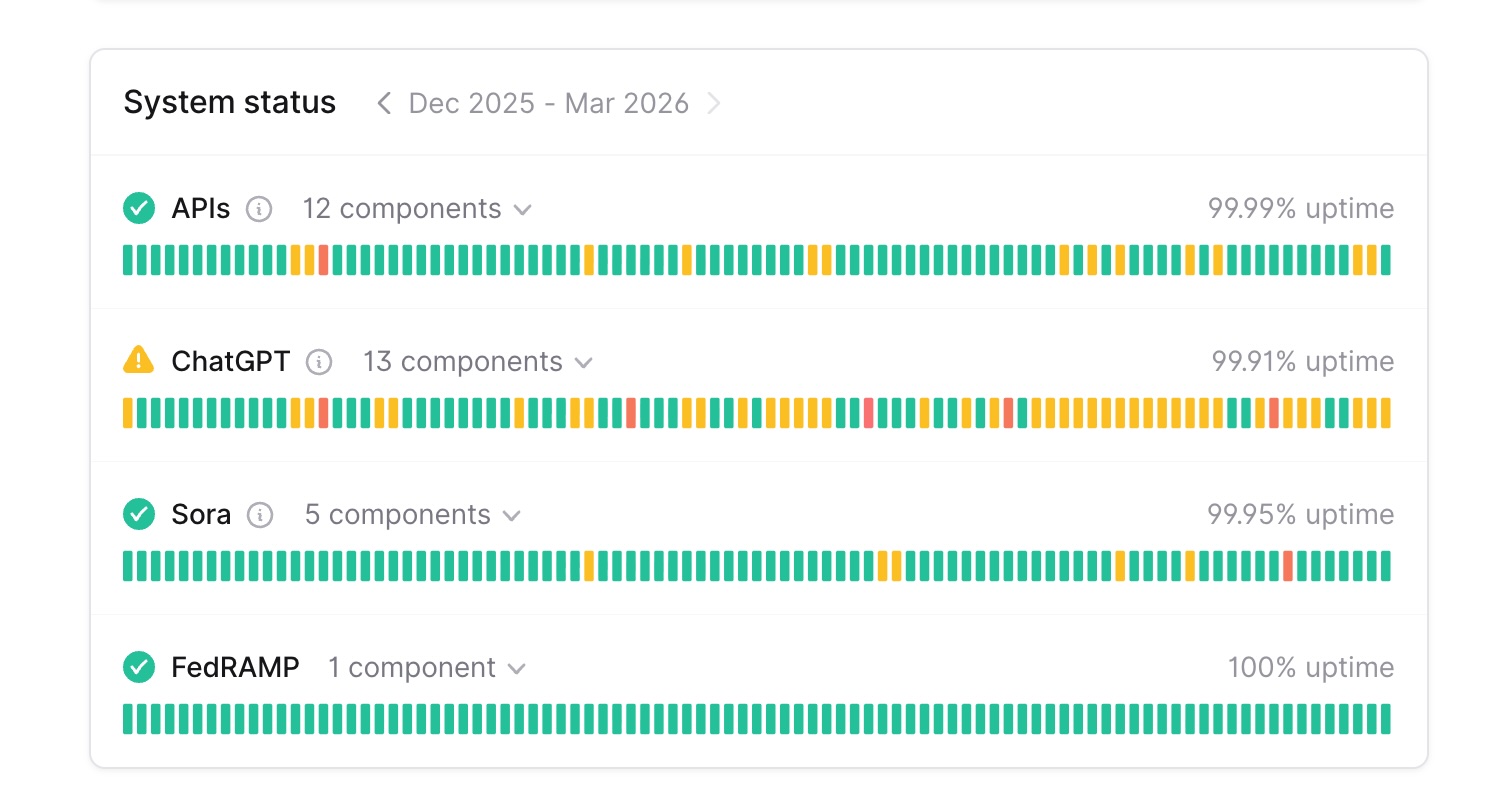

मैं 31 मार्च वाले follow-up में Anthropic और OpenAI के 90-day status gap के बारे में लिख चुका था। Broad picture अब भी matter करती है:

और फिर अप्रैल ने एक और real-world reminder जोड़ दिया।

15 अप्रैल को Claude में फिर elevated errors आए, Claude.ai, API और Claude Code तीनों पर। Login प्रभावित हुआ। API पहले recover हुई। जो Claude Code users पहले से logged in थे, वे काम करते रहे, लेकिन login कुछ समय तक broken रहा।

यह Claude की strengths को erase नहीं करता।

लेकिन यह इस practical case को मजबूत करता है कि अपना पूरा workflow एक ही vendor पर stake मत करो।

पूरे experiment से यह lesson अब भी सबसे durable lessons में से एक है:

Dual-wielding सिर्फ luxury नहीं है। यह operational resilience है।

जब एक provider की दोपहर खराब जाती है, तब भी आप ship करते रहते हैं।

Opus 4.7 ने pattern को sharpen किया, flip नहीं

Claude Opus 4.7, 16 अप्रैल को drop हुआ। इसे seriously run किए बिना कोई honest verdict publish करना fair नहीं होता।

तो मैंने लगभग तुरंत इसे Prova के एक real coding diagnostic पर लगाया।

Opus 4.7 ने मुझे एक solid first pass दिया। उसने track bug, mistimed Context Check card, और broader Builder-opener question identify की।

फिर मैंने वही diagnosis GPT-5.4 के पास critique pass की तरह भेजी, blind second opinion की तरह नहीं, बल्कि एक reviewer की तरह जो Opus की लिखी analysis पढ़ रहा था। GPT-5.4 ने वह sharper contradiction पकड़ ली जो Opus miss कर गया था: product पहले से एक first sprint assign कर रहा था, जबकि roadmap कहीं और से शुरू हो रही थी। यह सिर्फ Builder-fit issue नहीं था। यह एक live correctness problem थी।

फिर मैंने revised diagnosis वापस Opus से गुज़ारी, और वह converge हो गया।

लेकिन surprise दूसरी direction से आई।

19 अप्रैल को मैंने एक चीज़ notice की जिसकी उम्मीद नहीं थी: सरल tasks के लिए — एक short code review pass, एक छोटे change पर focused execution — xHigh पर Opus 4.7, xHigh पर Codex-GPT-5.4 से noticeably धीमा है। मैंने उल्टा expect किया था।

उस एक detail ने मेरा pattern फिर anchor कर दिया।

जहाँ Opus मेरे लिए अब भी clearly जीतता है, वह taste-heavy, iterative, long-context काम है जिसका मैंने ऊपर ज़िक्र किया। जहाँ Codex clearly जीतता है, वह deep coding diagnosis और रोज़मर्रा के fast coding turns हैं, जिनके लिए मैं पहले Claude की तरफ हाथ बढ़ाता था।

तो honest version यह है:

- ज्यादा गहरे coding analysis में Opus 4.7 अभी भी एक अच्छा first pass दे सकता है

- lighter coding turns पर अभी यह GPT-5.4 से धीमा महसूस होता है, same thinking level पर

- Apr 17 वाली continuous-execution experience के साथ मिलकर इसने coding seat को tie के करीब नहीं, बल्कि Codex की तरफ और धकेल दिया

मैं वास्तव में कहाँ आकर रुका

अगर drama, pricing screenshots, outage screenshots और social-post framing हटा दें, तो 22 अप्रैल तक मेरा working pattern यह हो चुका है:

Coding से जुड़ी हर चीज़ के लिए

मैं पहले Codex with GPT-5.4 on xHigh thinking की तरफ जाता हूँ।

क्यों:

- यह specialized लगता है

- यह methodical है

- यह careful है

- architecture और execution दोनों अच्छे से handle करता है

- यह unit, integration और browser tests के साथ एक agreed plan को तीस से पैंतालीस मिनट तक चला सकता है

- रोज़मर्रा के coding turns पर अभी यह xHigh पर Opus 4.7 से तेज़ है

- deep coding work पर इसे trust करना अब मेरे लिए आसान है

बाकी हर चीज़ के लिए

मैं Claude Code with Opus 4.7 on xHigh thinking की तरफ जाता हूँ।

अब इसमें शामिल है:

- ऐसी writing जो मेरी लगे

- cover art के लिए image prompts

- naming, positioning और brand language

/frontend-designpasses जिन्हें visual judgment चाहिए- लंबे research threads, जहाँ मैं कई sessions में point of view build कर रहा हूँ

- अपने plans को Codex को देने से पहले खुद review करना

- यह blog post

क्यों:

- यह मेरे style को बेहतर follow करता है

- feedback-driven creative iteration इसे बेहतर आती है

- brand taste और design taste में यह stronger है

- जब काम judgment हो, execution नहीं, तब मैं अब भी इसी model पर सबसे ज़्यादा trust करता हूँ

Important coding plans के लिए

मुझे cross-review loop अब भी पसंद है:

- एक से plan लो

- दूसरे से उसकी critique करवाओ

- फिर वहाँ से उसे tighten करो

यह workflow अब भी किसी एक model के first answer पर bet लगाने से ज़्यादा robust लगता है, चाहे वह model कितना भी अच्छा हो। ऊपर जिस builder-intent row की मैंने बात की, वही इसकी वजह है।

Pricing के लिए

मैं simple cheap switch पर नहीं पहुँचा।

मैं यहाँ पहुँचा:

- पुराना $200 Claude Max structure अब नहीं चाहिए

- ज़्यादा Codex capacity चाहिए, कम नहीं

- $100 वाला ChatGPT Pro coding plan के लिए ज़्यादा realistic जवाब लगा

- और code के अलावा हर चीज़ के लिए Claude loop में बना रहा

Shipping के लिए

पूरे switch का point यही था कि shipping जारी रहे। यह उन्नीस दिनों का tool benchmarking exercise नहीं था जिसके अंत में कुछ दिखाने को न हो। उसी window में Prova का Operator/Builder split live गया, Builder के लिए एक real execution lane के साथ; दो substantial blog posts निकले; और मैंने बारह locales में full translation pass भी चलाया। इस experiment ने output कम किया या नहीं, इसका जवाब है: नहीं।

अगर आपको सबसे compressed version चाहिए:

मैंने Claude Max छोड़ा, लेकिन Claude Code को अपने काम से नहीं हटाया। मैंने बस Claude Code को primary coding seat से हटाकर डेस्क का बाकी हिस्सा दे दिया।

यही सबसे सच्चा summary है जो मैं दे सकता हूँ।

तो: क्या मैं वही फैसला फिर लेता?

हाँ।

लेकिन अब मैं उसे अलग तरह से describe करता।

3 अप्रैल को framing यह थी:

"मैंने Claude Max छोड़ा है और test कर रहा हूँ कि क्या Codex उसकी जगह ले सकता है।"

22 अप्रैल तक framing कुछ ऐसी हो गई है:

"मैंने Claude Max छोड़ा, यह पाया कि अभी मेरे लिए Codex stronger coding specialist है, और अब मैं Claude Code को अपनी desk की बाकी हर चीज़ के लिए इस्तेमाल करता हूँ — जहाँ वह अब भी मेरे पास सबसे अच्छा tool है।"

यह जवाब कम binary है, simple social-post version से ज़्यादा महँगा है, और truth के कहीं ज़्यादा करीब है।

Frequently asked questions

क्या Codex ने सच में coding के लिए Claude को replace कर दिया?

मेरे लिए, हाँ। Pure coding work में Codex with GPT-5.4 on xHigh thinking मेरी default seat बन गया है। Opus 4.7 on xHigh deep diagnosis में अभी भी एक उपयोगी first pass दे सकता है, लेकिन मेरे लिए यह अब primary coding seat में नहीं है, और lighter coding turns पर यह अभी धीमा महसूस होता है।

क्या "cheap Codex" वाली कहानी टिक पाई?

पूरी तरह नहीं। जैसे ही मैंने इसे real volume पर इस्तेमाल किया, low-tier economics पूरी कहानी नहीं रही। मैं higher-paid OpenAI plan पर गया क्योंकि मुझे ज़्यादा capacity चाहिए थी, न कि इसलिए कि experiment fail हो गया।

क्या आपको अभी भी Claude चाहिए?

हाँ, अगर आपके काम में writing, design, naming, image prompting, लंबे research threads, या कोई भी taste-heavy या judgment-heavy loop शामिल है। मेरे workflow में code के अलावा बाकी सबके लिए xHigh पर Opus 4.7 default बन चुका है।

Reliability का क्या?

Reliability gap अभी भी matter करती है। अप्रैल ने इसे और reinforce किया। जवाब panic नहीं है। जवाब backup coverage है।

ग्यारह दिन पहले publish क्यों किया?

क्योंकि pattern settle हो गया। सिर्फ original headline में दिए गए exact number की इज़्ज़त करने के लिए post को 2 मई तक रोककर रखना theatre होता। ईमानदार बात यही थी कि मैं अभी क्या कर रहा हूँ, वही लिख दूँ और आगे बढ़ जाऊँ।

तो आज आप कौन-सा plan खरीदते?

अगर आपका काम mostly coding है, तो मैं Codex / GPT-5.4 को बहुत seriously देखता। अगर आपके काम में coding के साथ काफी taste-heavy creative work भी है, तो मैं Claude के बिना नहीं रहना चाहूँगा। और अगर अभी $100/month reach से बाहर है, तो $20 वाला Codex tier छोटे individual projects के लिए अब भी काम करता है — बस यह expect कीजिए कि sustained multi-project work में limits जल्दी आएँगी। मेरा खुद का जवाब अभी single-tool answer नहीं है।

यह उन्नीस दिनों बाद का ईमानदार update है।

Codex ने coding seat ले ली।

Claude Code ने बाकी सारी seats ले लीं।

और इसलिए एक tool जिसका नाम literal sense में Claude Code है, अब वह tool है जिसकी तरफ मैं तब जाता हूँ जब काम code के अलावा बाकी सब हो।

और असली lesson, एक बार फिर, यही है कि workflow fandom से ज़्यादा important है।

अगर आपने भी इस महीने ऐसा switch किया है, तो मैं सचमुच जानना चाहूँगा कि आप कहाँ आकर रुके। क्या आपके लिए एक tool outright जीत गई, या आपकी split भी और sharp हो गई?

शुभकामनाओं सहित,

Chandler