Saya Berhenti Langganan Claude Code $200 Setelah Dua Minggu dengan Codex

Dua minggu setelah perbandingan awal saya, kedua tool merilis update besar. Codex menantang strategi produk saya dengan cara yang tidak dilakukan Claude Code. Claude Code meluncurkan Agent Teams dan AutoMemory. Hasilnya: saya memangkas paket Max $200/bulan — dan mendapat output lebih baik dengan biaya lebih murah.

Dua minggu lalu saya menulis tentang dual-wielding Codex dan Claude Code. Tulisan itu mendapat respons lebih besar dari apa pun yang pernah saya tulis — ternyata banyak orang yang sedang menjalankan eksperimen yang sama.

Saat itu, working model saya jelas: Claude Code untuk kualitas eksekusi dan QA, Codex untuk penalaran arsitektural dan plan yang berkelanjutan. Dua tool, kekuatan berbeda, cross-model review untuk pekerjaan penting.

Dua minggu kemudian, kedua tool sudah merilis update signifikan dan keseimbangannya bergeser. Tidak drastis — tapi cukup untuk ditulis. (Sebagai catatan, saya menulis draf tulisan ini di Claude Code — bukan karena loyalitas, tapi karena siklus billing saya masih aktif dan saya tidak mau membuang uang yang sudah terlanjur dikeluarkan. Kalkulasi praktis semacam itu persis inti dari tulisan ini.)

Maret 2026 sangat intens untuk kedua platform. Codex meluncurkan plugins dengan integrasi untuk Slack, Gmail, Linear, Figma, Sentry, dan lainnya — plus Triggers untuk workflow GitHub otomatis, model GPT-5.4 mini dan nano, serta dukungan Windows native. Claude Code meluncurkan Agent Teams (orkestrasi multi-agent, masih eksperimental), AutoMemory, Computer Use (khusus macOS, paket Pro/Max), Scheduled Tasks via /loop, dan sekitar 10 rilis sepanjang Maret. Kedua platform bergerak cepat.

Cerita Newsletter (Kenapa Ini Bukan Cuma Soal Kode)

Observasi yang mengubah cara berpikir saya tidak ada hubungannya dengan menulis kode.

Situs saya punya sistem newsletter lengkap — form subscribe, CTA di postingan, welcome email, daily cron, double opt-in, dukungan 13 bahasa. Secara teknis, semuanya berjalan. Masalahnya: nol subscriber terverifikasi.

Saya menyusun rencana untuk memperbaiki ini: buat lead magnet PDF dari course saya, gate Module 1 di balik email, tambahkan CTA di tengah artikel, hubungkan AI chatbot ke alur subscribe, distribusikan lewat YouTube dan LinkedIn. Tujuh hal baru.

Saya menyusun rencana ini dengan Claude Code. Rasanya produktif.

Lalu saya memberikan brief yang sama ke Codex. Pushback-nya langsung.

Lead magnet itu redundan — Module 1 sudah gratis. Terlalu banyak surface sekaligus — kalau kamu bangun ketujuhnya, kamu tidak bisa tahu mana yang berhasil. Masalahnya bukan infrastruktur, tapi copy. "Stay in the loop" itu generik. Email verifikasi tidak cukup persuasif. Pilihan minat menambah friction.

Rencana Codex: perbaiki dulu yang sudah ada (tulis ulang copy, perbaiki email verifikasi, kurangi friction), tambahkan satu surface baru (inline blog CTA), ukur dengan GA events sebelum membangun yang lain.

Rencana saya adalah "bangun lebih banyak hal." Rencana Codex adalah "buat yang sudah ada bekerja lebih baik, lalu tes satu hal baru." Rencana saya butuh seminggu tanpa cara mengetahui mana yang berhasil. Rencana Codex bisa di-ship dalam sehari dan langsung memberi tahu ke mana harus investasi selanjutnya.

Saya harus mengakui — ini mengejutkan saya. Bukan karena Claude buruk dalam strategi. Saya rasa kalau saya prompt lebih hati-hati — "tantang asumsi saya sebelum mengeksekusi" — mungkin saya bisa dapat pushback serupa. Tapi default reasoning style-nya jelas berbeda. GPT-5.4 default-nya "pertanyakan premisnya." Claude default-nya "eksekusi rencana dengan baik."

Perbedaan itu penting untuk keputusan produk.

Kecepatan dan Pengendalian

Dua hal yang saya perhatikan dan ternyata mempengaruhi workflow harian lebih dari yang saya kira.

Kecepatan dan efisiensi token: Codex dengan GPT-5.4 pada high thinking secara konsisten lebih cepat dari Opus 4.6 pada high thinking untuk task yang setara. Perbandingan dari pihak ketiga menunjukkan Codex menggunakan sekitar 3x lebih sedikit token untuk pekerjaan serupa — satu benchmark mengukur 1,5 juta token untuk task bergaya Figma di mana Claude menggunakan 6,2 juta. Claude lebih banyak "berpikir keras," yang menghasilkan penalaran berkualitas lebih tinggi tapi menghabiskan limit lebih cepat. Mulai sekitar 20 Maret, Opus sepertinya melakukan lebih banyak tool call dari biasanya — lebih banyak langkah perantara sebelum sampai ke jawaban. Saya tidak tahu apakah itu perubahan model atau kebetulan, tapi cukup terasa.

Pengendalian real-time: Ketika saya mengirim pesan baru saat tool sedang bekerja — "tunggu, bukan arah itu, coba yang ini" — Codex membacanya hampir langsung dan menyesuaikan. Claude Code cenderung menyelesaikan eksekusi saat itu dulu sebelum membaca koreksi.

Kedengarannya sepele. Ternyata tidak. Ketika kamu sedang melihat agent berjalan ke arah yang salah dan ingin mengoreksi, jeda antara "membaca koreksimu sekarang" dan "membacanya setelah selesai operasi saat ini" terakumulasi sepanjang sesi kerja.

Bug SSE: Contoh Konkret

Saya sedang membangun aplikasi iOS baru. Claude Code sudah menghasilkan 40 file Swift untuk semua fitur — auth, agents, chat, frameworks, dashboard, profile. Cakupannya mengesankan. Tapi satu bug kritis tetap ada: SSE streaming untuk real-time chat tidak mau berjalan.

Backend-nya oke. Curl berhasil. Tapi URLSessionDataDelegate.didReceive(data:) tidak mau terpicu di Swift client. Claude Code bekerja pada masalah ini selama berjam-jam. Berbagai pendekatan, berbagai sesi debugging.

Saya memberikan masalah yang sama ke Codex. Beberapa percobaan kemudian: commit 7f592152 — "fix(ios): restore real-time chat streaming."

Apakah ini representatif? Mungkin tidak. Setiap tool punya hari baik dan hari buruk. Tapi dari pengalaman saya, ketika Claude Code terjebak dalam loop debugging — mencoba variasi yang makin kreatif dari pendekatan yang sama — pindah ke Codex sering memecahkan kebuntuan karena GPT-5.4 membingkai masalah secara berbeda sejak awal.

Di Mana Claude Code Masih Menang

Mudah sekali membaca tulisan ini dan menyimpulkan bahwa Codex unggul di semua aspek. Itu salah. Claude Code juga merilis banyak hal bulan ini, dan beberapa keunggulannya justru makin kuat.

Agent Teams. Diluncurkan Februari dan terus matang sepanjang Maret. Beberapa instance Claude Code bekerja paralel — explorer, code reviewer, implementer, test runner — dengan dependency tracking dan shared task lists. Masih eksperimental dan nonaktif secara default, tapi kalau diaktifkan, benar-benar mengesankan. Codex juga punya dukungan multi-agent (task berjalan di cloud container yang terisolasi), tapi Agent Teams Claude Code terasa lebih terkoordinasi. Untuk refaktor besar yang menyentuh banyak file, Agent Teams saat ini pengalaman yang lebih baik.

AutoMemory. Claude Code sekarang otomatis menulis aturan memori berdasarkan kebiasaanmu. Setelah beberapa sesi, dia tahu struktur project-mu, naming convention-mu, preferensimu. Efeknya halus tapi kumulatifnya nyata — sesi Claude Code makin produktif seiring waktu dengan cara yang belum bisa dilakukan sesi Codex saat ini.

Desain frontend. Claude Code dengan plugin /frontend-design masih menghasilkan UI yang terasa lebih polished dan sadar design system dibanding Codex dengan skill yang setara. Saya menguji ini langsung saat redesain situs pada 26 Maret. Output Claude punya komposisi spasial yang lebih baik, styling yang lebih konsisten, dan hasil yang lebih kohesif. Ini mungkin keunggulan harness (sistem plugin Claude menjalankan skill dengan lebih banyak konteks), tapi hasil praktisnya jelas.

Kualitas kode. Sebuah analisis komunitas dari 500+ komentar developer di Reddit menemukan bahwa developer lebih memilih output Claude Code di sekitar 67% perbandingan buta — mencatat kode yang lebih bersih, lebih idiomatik, dan lebih terstruktur. Itu cocok dengan pengalaman saya. Ketika kode harus maintainable, bukan hanya fungsional, Claude Code punya keunggulan.

QA otomatis. Masih killer feature. Setelah menyelesaikan pekerjaan, Claude Code otomatis dispatch review agent — code review, consistency check, gap analysis — tanpa saya minta. Codex belum punya ini. Untuk apa pun di mana kebenaran lebih penting dari kecepatan, ini saja sudah cukup untuk mempertahankan Claude Code di workflow.

Pertanyaan Soal Keandalan

Saya ingin berbagi sesuatu yang kebanyakan tulisan perbandingan hindari.

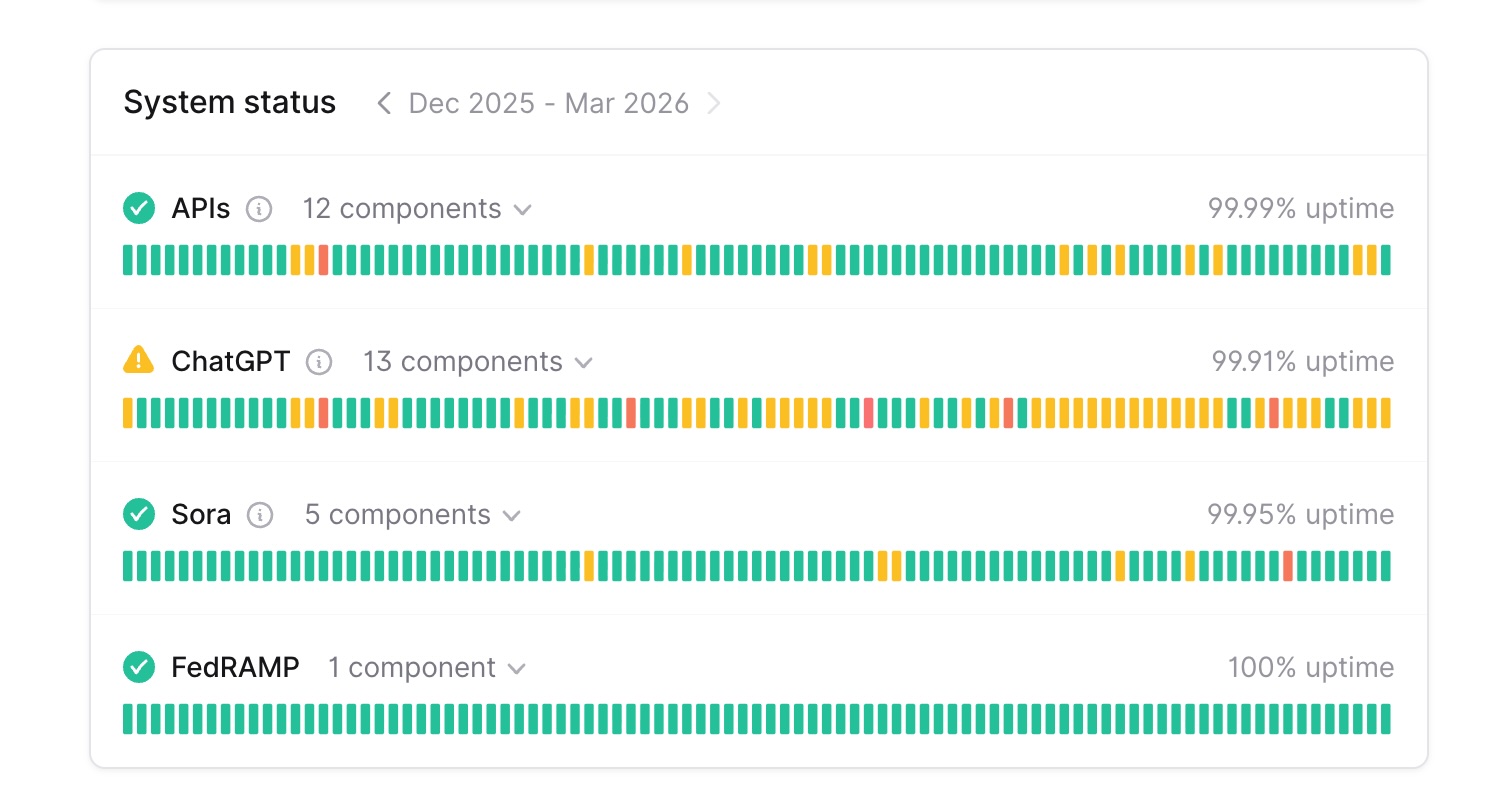

Berikut angka uptime 90 hari dari kedua status page per akhir Maret 2026:

| Layanan | Anthropic | OpenAI |

|---|---|---|

| Platform utama | claude.ai: 99,16% | ChatGPT: 99,91% |

| API | api.anthropic.com: 99,24% | APIs: 99,99% |

| Developer tools | Claude Code: 99,48% | — |

| Console | platform.claude.com: 99,41% | — |

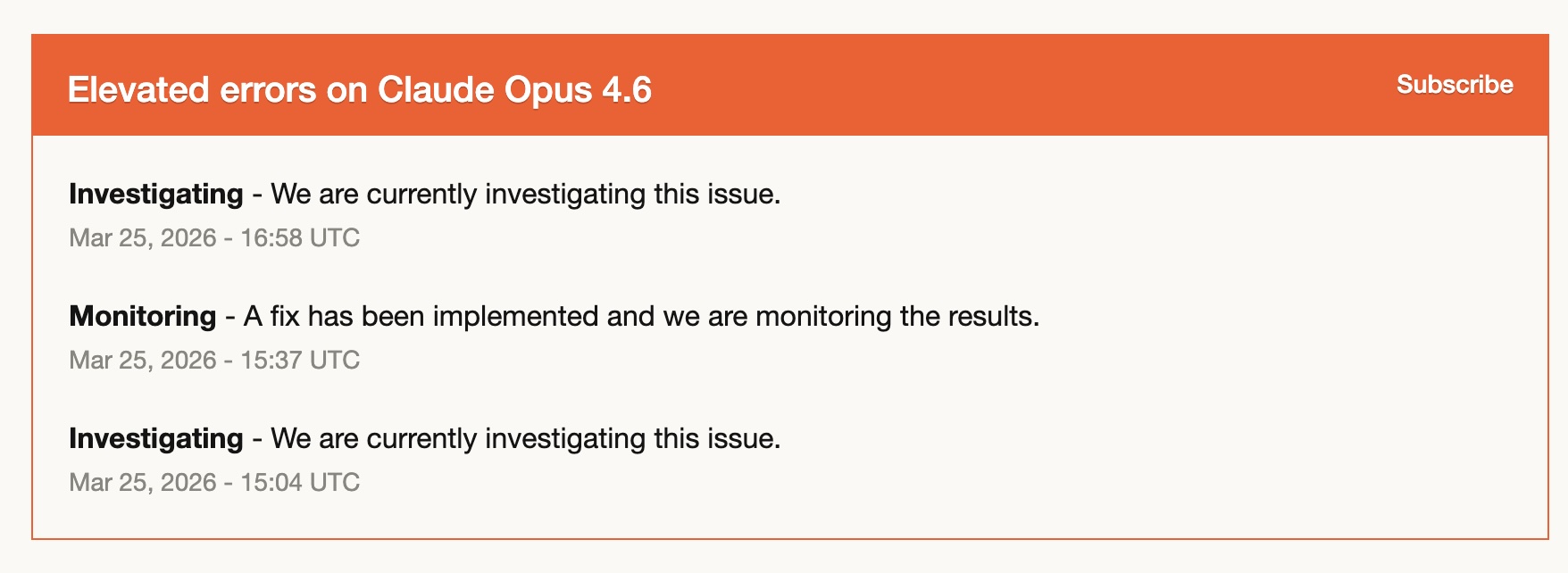

Jaraknya nyata. Selama 90 hari, layanan Anthropic mengalami sekitar 8-10x lebih banyak downtime dibanding OpenAI. Pada 25 Maret, ada insiden spesifik — "Elevated errors on Claude Opus 4.6" — dengan siklus investigating-fix-investigating yang berlangsung hampir dua jam.

Untuk adilnya, ini bukan gambaran lengkap. Keandalan bukan cuma soal uptime. Phantom Labs dari BeyondTrust secara publik mengungkapkan kerentanan command injection di Codex yang bisa mengekspos token autentikasi GitHub lewat manipulasi nama branch. Celah ini mempengaruhi web UI, CLI, SDK, dan integrasi IDE — nama branch yang bisa dikontrol pengguna langsung dimasukkan ke shell command tanpa sanitasi. OpenAI sudah menambalnya, tapi ini pengingat bahwa stabilitas dan keamanan adalah dimensi keandalan yang berbeda, dan keduanya penting.

Saya membagikan data uptime ini bukan untuk menyerang Anthropic. Saya memakai Claude Code setiap hari dan tetap sangat bagus. Tapi untuk siapa pun yang membangun workflow profesional di atas tool-tool ini, angkanya perlu diketahui. Dan inilah kenapa dual-wielding bukan sekadar nice to have — ketika satu layanan punya sore yang buruk, kamu tinggal pindah dan terus bekerja. Saya sudah melakukan ini tiga kali dalam dua minggu.

Jarak Plugin Makin Mengecil

Di tulisan awal saya, saya menyebutkan bahwa ekosistem plugin Claude Code lebih matang. Itu benar dua minggu lalu. Sekarang sudah kurang akurat.

Codex meluncurkan sistem plugin-nya pada 27 Maret dengan integrasi untuk Slack, Gmail, Google Drive, Linear, Figma, Sentry, Notion, dan Hugging Face. Plus skills, hooks (termasuk event SessionStart dan UserPromptSubmit), MCP servers, dan direktori plugin di app maupun CLI.

Fitur-fiturnya mulai konvergen. Kedua tool sekarang punya: plugins/skills untuk workflow yang bisa dipakai ulang, hooks untuk otomasi berbasis event, integrasi MCP server, dan integrasi level aplikasi dengan layanan eksternal.

Di mana Claude Code masih unggul: ekosistem plugin yang sudah ada lebih dalam. Plugin seperti Superpowers (planning terstruktur), /feature-dev (pengembangan terpandu), dan /frontend-design sudah dipoles selama berbulan-bulan. Direktori plugin Codex lebih baru dan plugin individualnya belum seteruji itu.

Di mana Codex mulai unggul: Triggers. Codex bisa otomatis merespons event GitHub — ada issue masuk, Codex otomatis memperbaiki, buka PR. Itu kategori otomasi baru yang belum ditawarkan Claude Code. Untuk tim yang menginginkan engineering workflow otonom, Triggers adalah pembeda yang signifikan.

Working Model Saya yang Diperbarui

Dua minggu lalu, saya membagi pekerjaan kira-kira 60/40 Claude Code/Codex. Saya punya mental model yang jelas: raih Claude Code kalau butuh kualitas, raih Codex kalau butuh penalaran arsitektural.

Pembagian rapi itu sudah larut. Sekarang saya memakai keduanya sepanjang hari, berganti berdasarkan intuisi lebih dari aturan. Codex untuk satu task, Claude Code untuk yang berikutnya, kadang keduanya mereview plan yang sama. Kedua tool sudah cukup dekat dalam kapabilitas sehingga pertanyaan "yang mana yang harus saya pakai untuk ini?" tidak sepenting dua minggu lalu.

Yang berubah adalah ekonominya.

Paket Plus OpenAI $20/bulan dengan limit yang makin besar. Saya mendapati diri saya makin sering meraih Codex — bukan karena dia jauh lebih baik di satu hal tertentu, tapi karena kombinasi kecepatan, efisiensi token, dan harga $20 itu menghilangkan friction. Tidak ada kalkulasi mental "apakah task ini layak membakar token Claude Code?"

Saya condong untuk menurunkan paket Claude Code dari tier Max $200/bulan ke paket $100/bulan, mungkin bahkan paket Pro $20/bulan. Dua minggu lalu, itu terasa berisiko. Sekarang terasa praktis. Pekerjaan yang butuh Claude Code untuk unggul — desain frontend, orkestrasi Agent Teams, QA otomatis yang menangkap hal-hal yang saya lewatkan — itu keunggulan nyata. Tapi mungkin tidak perlu $200/bulan kalau Codex menangani setengah workload saya di $20.

Saya sadar taruhan ini ada risikonya. Tier Claude Code $20 punya limit penggunaan yang nyata — kalau saya mentok saat sesi kritis, saya akan menyesal turun paket. Dan limit murah hati OpenAI yang $20 kemungkinan strategi merebut market share yang mungkin tidak bertahan selamanya. Tapi saat ini, ekonominya mendukung dual-wielding.

Total biayanya ($20 Codex + $100 atau bahkan $20 Claude Code) akan lebih murah dari yang saya bayar untuk Claude Code saja. Dan output gabungannya lebih baik daripada salah satu tool sendirian di harga berapa pun.

Itu mungkin takeaway paling praktis dari dua minggu dual-wielding: kompetisi bukan hanya membuat tool-nya lebih baik. Kompetisi membuatnya lebih murah. Dan lebih murah berarti kamu bisa afford keduanya.

Apa yang Saya Harapkan Selanjutnya

Kedua platform sedang berakselerasi. Codex baru saja meluncurkan plugins, triggers, dan Windows client. Claude Code baru saja merilis Agent Teams, AutoMemory, Computer Use, dan Scheduled Tasks. Tidak ada yang diam di tempat.

Sebuah tema yang terus muncul di komunitas developer di Reddit — dan menurut saya ini menangkap sesuatu yang nyata — adalah "Claude Code kualitasnya lebih tinggi tapi kamu sering mentok limit. Codex kualitasnya sedikit lebih rendah tapi lebih bisa dipakai sehari-hari." Keseimbangannya bergeser seiring keduanya membaik.

Saran saya tetap sama seperti tulisan pertama, tapi sekarang lebih kuat: coba tool satunya selama seminggu. Bukan untuk pindah — tapi untuk menambah. Workflow cross-model review masih penemuan terbaik yang pernah saya buat. Dan ketahanan operasional dari punya dua tool yang kamu percaya akan menyelamatkanmu di hari ketika salah satunya down.

Sebagai pengguna, ini situasi terbaik yang mungkin terjadi. Dua tool excellent yang makin baik dengan cepat, masing-masing mendorong yang lain maju. Laju kompetisi begitu ketat sehingga saya tidak rasa ada perusahaan yang bisa nyaman unggul untuk waktu lama — itulah kenapa bertaruh pada satu tool terasa makin berisiko dan bertaruh pada workflow-nya (dual-wielding, cross-model review) terasa makin tepat.

Pertanyaan yang Sering Muncul

Apakah pendapatmu berubah sejak tulisan pertama?

Tesis intinya — dual-wielding mengalahkan memilih pemenang — justru makin kuat. Yang berubah adalah pembagiannya (60/40 jadi 50/50) dan alasannya. Kekuatan Codex dalam penalaran strategis lebih mengejutkan saya daripada peningkatan coding-nya.

Apakah Codex lebih cepat dari Claude Code?

Pada high thinking, ya — secara konsisten lebih cepat, dan perbandingan pihak ketiga menunjukkan penggunaan token sekitar 3x lebih sedikit untuk task setara. Pada default thinking, jaraknya lebih kecil. Untuk pekerjaan iteratif di mana kamu sering bolak-balik, kecepatan dan efisiensi token itu terakumulasi.

Apakah saya perlu khawatir soal uptime Claude Code?

Angka 90 hari menunjukkan jarak yang nyata (99,2% vs 99,9%). Kalau Claude Code satu-satunya tool-mu dan kamu sedang kejar deadline, siapkan backup plan. Tapi Anthropic merilis sekitar 10 update Claude Code sepanjang Maret — mereka iterasi cepat di fitur meskipun keandalan masih tertinggal dari OpenAI.

Bagaimana soal kerentanan keamanan Codex?

Celah command injection di Codex bisa mengekspos token GitHub lewat nama branch. Sudah ditemukan dan ditangani. Perlu diketahui, tapi juga perlu dicatat bahwa security researcher aktif menguji tool-tool ini — yang merupakan hal baik untuk ekosistem.

Apakah cerita strategi newsletter benar-benar soal tool-nya?

Sebagian. Model yang berbeda punya default reasoning style yang berbeda. GPT-5.4 lebih cenderung menantang asumsi saya. Claude lebih cenderung membantu mengeksekusi rencana saya dengan baik. Keduanya berguna — tapi untuk strategi produk, "apakah kamu memecahkan masalah yang tepat?" sering lebih berharga daripada "ini implementasi yang bagus."

Tool mana yang harus saya beli?

Keduanya. Itu bukan jawaban menghindar — itu benar-benar jawaban terbaik. Codex di $20/bulan plus Claude Code di $20-100/bulan memberi hasil lebih baik daripada salah satu tool sendirian di harga berapa pun. Saya condong turun dari $200/bulan di Claude Code ke $100 atau bahkan $20, dan menambahkan Codex di $20. Total biaya turun dan output naik. Meski begitu, limit murah hati OpenAI mungkin tidak bertahan selamanya — jadi tetap fleksibel.

Itu dulu dari saya. Kalau kamu sudah menjalankan eksperimen dual-wielding sendiri, saya benar-benar ingin dengar bagaimana pembagianmu berevolusi. Pola yang sama, atau sesuatu yang sama sekali berbeda?

Cheers, Chandler