Ich kündige meinen $200 Claude Code Plan nach zwei Wochen mit Codex

Zwei Wochen nach meinem ursprünglichen Vergleich haben beide Tools große Updates geliefert. Codex hat meine Produktstrategie auf eine Weise hinterfragt, die Claude Code nicht tat. Claude Code brachte Agent Teams und AutoMemory. Das Ergebnis: Ich kürze meinen $200/Monat Max Plan — und bekomme bessere Ergebnisse für weniger Geld.

Vor zwei Wochen habe ich darüber geschrieben, Codex und Claude Code parallel einzusetzen. Dieser Beitrag hat mehr Resonanz erzeugt als alles, was ich bisher geschrieben habe — es stellt sich heraus, dass viele Leute genau das gleiche Experiment machen.

Damals war mein Arbeitsmodell klar: Claude Code für Ausführungsqualität und QA, Codex für architektonisches Denken und langfristige Pläne. Beide Tools, unterschiedliche Stärken, Cross-Model-Review für wichtige Arbeit.

Zwei Wochen später haben beide Tools bedeutende Updates ausgeliefert und die Balance hat sich verschoben. Nicht dramatisch — aber genug, um darüber zu schreiben. (Für die Aufzeichnung: Ich schreibe diesen Post in Claude Code — nicht aus Loyalität, sondern weil mein aktueller Abrechnungszyklus noch läuft und ich kein Geld verschwenden möchte, das schon gebunden ist. Genau diese Art praktischer Rechnung ist der Kern dieses Beitrags.)

Der März 2026 war intensiv für beide Plattformen. Codex hat Plugins mit Integrationen für Slack, Gmail, Linear, Figma, Sentry und mehr gestartet — dazu Triggers für automatisierte GitHub-Workflows, GPT-5.4 mini und nano Modelle sowie native Windows-Unterstützung. Claude Code lieferte Agent Teams (Multi-Agent-Orchestrierung, noch experimentell), AutoMemory, Computer Use (nur macOS, Pro/Max Pläne), Scheduled Tasks über /loop, und etwa 10 Releases allein im März. Beide Plattformen bewegen sich schnell.

Die Newsletter-Geschichte (Warum es hier nicht nur um Code geht)

Die Beobachtung, die mein Denken verändert hat, hatte nichts mit Code-Schreiben zu tun.

Meine Website hat ein komplettes Newsletter-System — Anmeldeformular, Post-CTAs, Willkommens-E-Mail, täglicher Cron, Double Opt-in, Support für 13 Sprachen. Technisch funktioniert alles. Das Problem: null verifizierte Abonnenten.

Ich entwarf einen Plan, das zu beheben: ein Lead-Magnet-PDF aus meinem Kurs extrahieren, Modul 1 hinter einer E-Mail-Anmeldung verstecken, Mid-Article-CTAs einfügen, den AI-Chatbot in den Anmeldeprozess einbinden, über YouTube und LinkedIn verbreiten. Sieben neue Dinge.

Diesen Plan habe ich mit Claude Code erstellt. Es fühlte sich produktiv an.

Dann gab ich dasselbe Briefing an Codex. Der Widerspruch kam sofort.

Der Lead Magnet war überflüssig — Modul 1 ist bereits kostenlos. Zu viele Oberflächen auf einmal — wenn du alle sieben baust, kannst du nicht erkennen, welche funktioniert. Das Problem ist nicht die Infrastruktur, sondern der Text. "Stay in the loop" ist generisch. Die Verifizierungs-E-Mail ist nicht überzeugend genug. Die Interessenauswahl erzeugt Reibung.

Codex' Plan: Zuerst reparieren, was existiert (Texte umschreiben, Verifizierungs-E-Mail verbessern, Reibung reduzieren), eine neue Oberfläche hinzufügen (ein Inline-Blog-CTA), mit GA Events messen, bevor irgendetwas anderes gebaut wird.

Mein Plan war "mehr Dinge bauen." Codex' Plan war "die bestehenden Dinge besser machen, dann eine neue Sache testen." Meiner hätte eine Woche gedauert, ohne zu wissen, was funktioniert hat. Der von Codex kann an einem Tag ausgeliefert werden und sagt dir genau, wo du als Nächstes investieren sollst.

Ich muss zugeben — das hat mich überrascht. Nicht weil Claude schlecht in Strategie ist. Ich denke, wenn ich gezielter geprompted hätte — "hinterfrage meine Annahmen bevor du loslegst" — hätte ich möglicherweise einen ähnlichen Widerspruch bekommen. Aber der Standard-Denkstil war merklich anders. GPT-5.4 fragte standardmäßig "stimmt die Prämisse überhaupt?" Claude ging standardmäßig zu "den Plan gut umsetzen."

Diese Unterscheidung ist für Produktentscheidungen wichtig.

Geschwindigkeit und Steuerung

Zwei Dinge, die den täglichen Workflow stärker beeinflussen als erwartet.

Geschwindigkeit und Token-Effizienz: Codex mit GPT-5.4 auf High Thinking ist durchgehend schneller als Opus 4.6 auf High Thinking bei vergleichbaren Aufgaben. Drittanbieter-Vergleiche deuten darauf hin, dass Codex ungefähr 3x weniger Token für ähnliche Arbeit benötigt — ein Benchmark hat 1,5 Millionen Token bei einer Figma-ähnlichen Aufgabe gemessen, wo Claude 6,2 Millionen brauchte. Claude "denkt lauter nach", was qualitativ hochwertigeres Reasoning produziert, aber die Limits schneller aufbraucht. Seit etwa dem 20. März scheint Opus mehr Tool Calls zu machen als üblich — mehr Zwischenschritte bevor die Antwort kommt. Ich weiß nicht, ob das eine Modelländerung oder ein Zufall ist, aber es ist wahrnehmbar.

Echtzeit-Steuerung: Wenn ich eine neue Nachricht sende, während das Tool arbeitet — "warte, nicht in die Richtung, versuch das hier stattdessen" — liest Codex sie fast sofort und passt sich an. Claude Code tendiert dazu, seine aktuelle Ausführung zu beenden, bevor es die Korrektur liest.

Das klingt nach einer Kleinigkeit. Ist es nicht. Wenn du einem Agenten dabei zuschaust, wie er den falschen Weg einschlägt und du den Kurs korrigieren willst, summiert sich die Verzögerung zwischen "liest deine Korrektur jetzt" und "liest sie nach Abschluss der aktuellen Operation" über eine ganze Arbeitssession.

Der SSE-Bug: Ein konkretes Beispiel

Ich baute eine neue iOS-App. Claude Code hatte 40 Swift-Dateien über alle Features hinweg produziert — Auth, Agents, Chat, Frameworks, Dashboard, Profil. Beeindruckende Breite. Aber ein kritischer Bug blieb: SSE-Streaming für Echtzeit-Chat funktionierte nicht.

Das Backend war in Ordnung. Curl funktionierte. Aber URLSessionDataDelegate.didReceive(data:) feuerte im Swift-Client nicht. Claude Code arbeitete stundenlang daran. Mehrere Ansätze, mehrere Debugging-Sessions.

Ich gab dasselbe Problem an Codex. Ein paar Versuche später: Commit 7f592152 — "fix(ios): restore real-time chat streaming."

Ist das repräsentativ? Vielleicht nicht. Jedes Tool hat gute und schlechte Tage. Aber nach meiner Erfahrung, wenn Claude Code in einer Debugging-Schleife feststeckt — und immer cleverere Varianten des gleichen Ansatzes probiert — löst der Wechsel zu Codex oft den Stillstand, weil GPT-5.4 das Problem von Anfang an anders einordnet.

Wo Claude Code weiterhin gewinnt

Es wäre leicht, diesen Beitrag zu lesen und zu schlussfolgern, dass Codex auf ganzer Linie davonzieht. Das wäre falsch. Claude Code hat diesen Monat ebenfalls ordentlich geliefert, und mehrere seiner Vorteile sind sogar gewachsen.

Agent Teams. Das wurde im Februar gestartet und ist den ganzen März über gereift. Mehrere Claude Code Instanzen, die parallel arbeiten — ein Explorer, ein Code-Reviewer, ein Implementierer, ein Test-Runner — mit Dependency-Tracking und geteilten Aufgabenlisten. Es ist immer noch experimentell und standardmäßig deaktiviert, aber wenn aktiviert, ist es wirklich beeindruckend. Codex hat ebenfalls Multi-Agent-Support (Aufgaben laufen in isolierten Cloud-Containern), aber Claude Codes Agent Teams fühlen sich koordinierter an. Für große Refactorings, die viele Dateien betreffen, sind Agent Teams derzeit die bessere Erfahrung.

AutoMemory. Claude Code schreibt jetzt automatisch Memory-Regeln basierend auf deinen Gewohnheiten. Nach ein paar Sessions kennt es deine Projektstruktur, deine Namenskonventionen, deine Vorlieben. Es ist subtil, aber der kumulative Effekt ist, dass Claude Code Sessions über die Zeit produktiver werden — auf eine Weise, die Codex Sessions derzeit nicht bieten.

Frontend-Design. Claude Code mit dem /frontend-design Plugin produziert weiterhin merklich polierter, design-system-bewusstere UIs als Codex mit der entsprechenden Skill. Ich habe das direkt während eines Site-Redesigns am 26. März getestet. Die Claude-Ausgabe hatte bessere räumliche Komposition, konsistenteres Styling und ein kohärenteres Gesamtergebnis. Das könnte ein Harness-Vorteil sein (Claudes Plugin-System führt die Skill mit mehr Kontext aus), aber das praktische Ergebnis ist eindeutig.

Code-Qualität. Eine Community-Analyse von über 500 Entwicklerkommentaren auf Reddit ergab, dass Entwickler Claude Codes Ausgabe in etwa 67% der Blind-Vergleiche bevorzugten — mit der Begründung: sauberer, idiomatischer, besser strukturierter Code. Das deckt sich mit meiner Erfahrung. Wenn der Code wartbar sein muss, nicht nur funktional, hat Claude Code einen Vorsprung.

Automatische QA. Immer noch das Killer-Feature. Nach Abschluss der Arbeit schickt Claude Code automatisch Review-Agenten los — Code Review, Konsistenzprüfungen, Gap-Analyse — ohne dass ich darum bitten muss. Das kann Codex noch nicht. Für alles, wo Korrektheit wichtiger ist als Geschwindigkeit, hält allein dieses Feature Claude Code im Workflow.

Die Zuverlässigkeitsfrage

Ich möchte etwas teilen, das die meisten Vergleichsbeiträge umgehen.

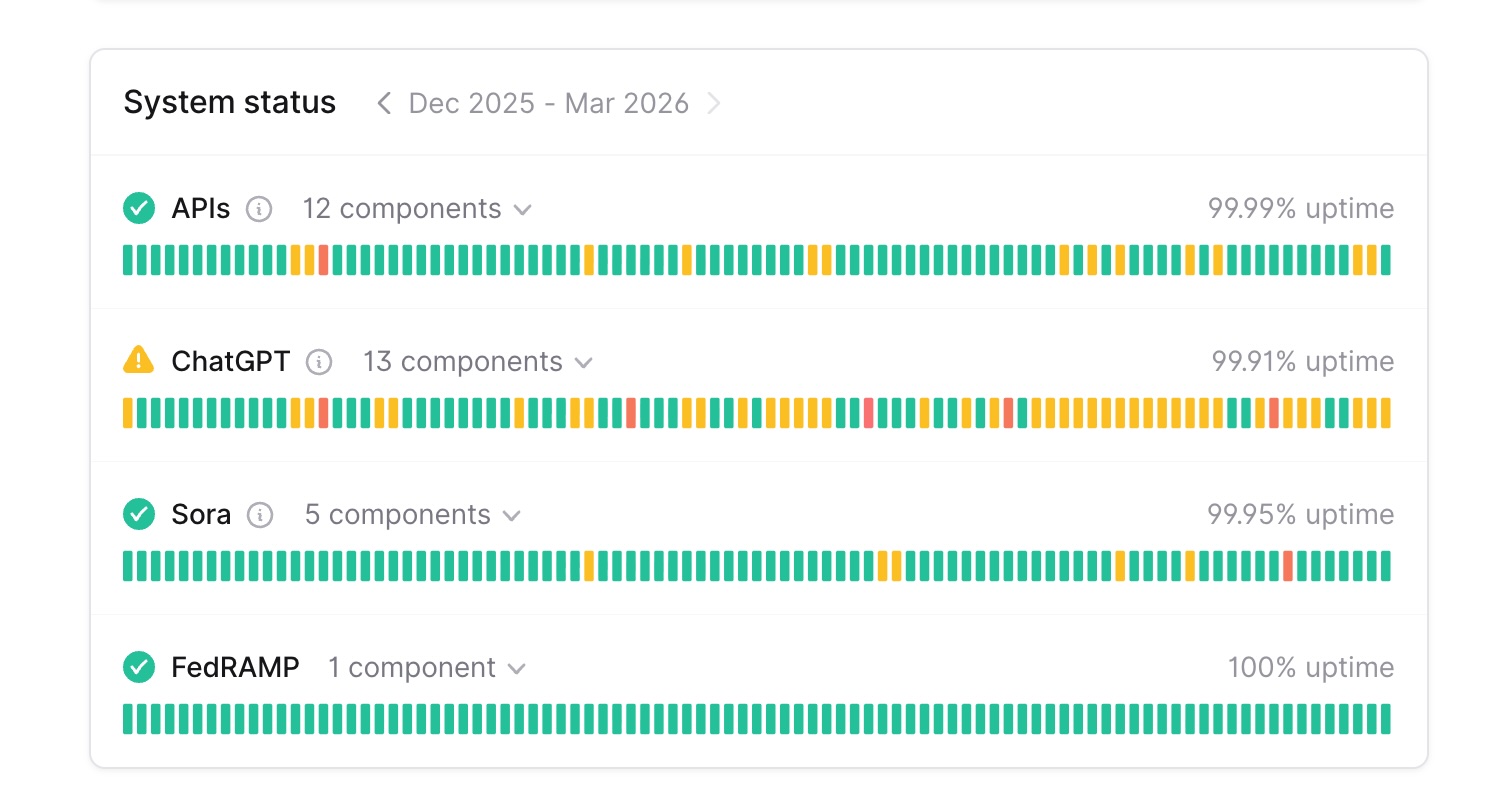

Hier sind die 90-Tage-Uptime-Zahlen von beiden Status-Seiten, Stand Ende März 2026:

| Service | Anthropic | OpenAI |

|---|---|---|

| Main platform | claude.ai: 99,16% | ChatGPT: 99,91% |

| API | api.anthropic.com: 99,24% | APIs: 99,99% |

| Developer tools | Claude Code: 99,48% | — |

| Console | platform.claude.com: 99,41% | — |

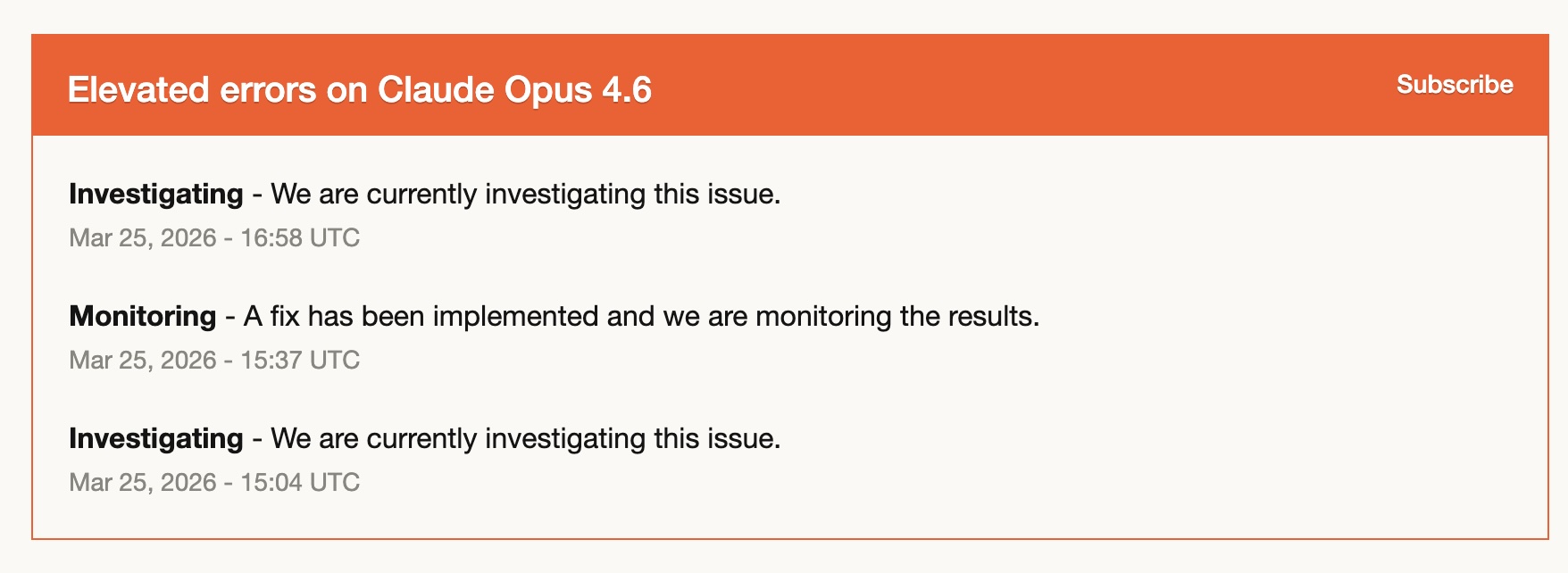

Die Lücke ist real. Über 90 Tage erlebten Anthropics Dienste ungefähr 8-10x mehr Ausfallzeit als die von OpenAI. Am 25. März gab es einen konkreten Vorfall — "Elevated errors on Claude Opus 4.6" — mit einem Investigating-Fix-Investigating-Zyklus, der fast zwei Stunden dauerte.

Fairerweise ist das nicht das ganze Bild. Zuverlässigkeit ist nicht nur Uptime. BeyondTrust's Phantom Labs hat öffentlich eine Command-Injection-Schwachstelle in Codex offengelegt, die GitHub-Authentifizierungstoken durch Branch-Name-Manipulation hätte kompromittieren können. Die Schwachstelle betraf die Web-UI, CLI, SDK und IDE-Integrationen — ein vom Nutzer kontrollierbarer Branch-Name wurde direkt in einen Shell-Befehl ohne Sanitization übergeben. OpenAI hat es gepatcht, aber es ist eine Erinnerung daran, dass Stabilität und Sicherheit verschiedene Dimensionen der Zuverlässigkeit sind, und beide zählen.

Ich teile die Uptime-Daten nicht, um Anthropic schlechtzumachen. Ich benutze Claude Code jeden Tag und es bleibt exzellent. Aber für jeden, der seinen professionellen Workflow um diese Tools herum aufbaut, sind die Zahlen wissenswert. Und genau deshalb ist Dual-Wielding nicht nur ein nettes Extra — wenn ein Dienst einen schlechten Nachmittag hat, wechselst du und arbeitest weiter. Das habe ich in zwei Wochen dreimal gemacht.

Die Plugin-Lücke schließt sich

In meinem ursprünglichen Beitrag habe ich angemerkt, dass Claude Codes Plugin-Ökosystem reifer war. Das stimmte vor zwei Wochen. Heute stimmt es weniger.

Codex startete sein Plugin-System am 27. März mit Integrationen für Slack, Gmail, Google Drive, Linear, Figma, Sentry, Notion und Hugging Face. Dazu Skills, Hooks (einschließlich SessionStart und UserPromptSubmit Events), MCP Server und ein Plugin-Verzeichnis sowohl in der App als auch in der CLI.

Die Feature-Sets konvergieren. Beide Tools bieten jetzt: Plugins/Skills für wiederverwendbare Workflows, Hooks für Event-getriebene Automatisierung, MCP-Server-Integration und App-Level-Integrationen mit externen Services.

Wo Claude Code noch führt: das bestehende Plugin-Ökosystem ist tiefgründiger. Plugins wie Superpowers (strukturierte Planung), /feature-dev (angeleitete Entwicklung) und /frontend-design wurden über Monate verfeinert. Codex' Plugin-Verzeichnis ist neuer und die einzelnen Plugins sind weniger kampferprobt.

Wo Codex voranzieht: Triggers. Codex kann automatisch auf GitHub-Events reagieren — ein Issue kommt rein, Codex fixt es automatisch, öffnet einen PR. Das ist eine neue Kategorie von Automatisierung, die Claude Code noch nicht bietet. Für Teams, die autonome Engineering-Workflows wollen, sind Triggers ein bedeutender Differenzierungsfaktor.

Mein aktualisiertes Arbeitsmodell

Vor zwei Wochen habe ich die Arbeit ungefähr 60/40 auf Claude Code/Codex aufgeteilt. Ich hatte ein klares mentales Modell: greif zu Claude Code, wenn du Qualität brauchst, greif zu Codex, wenn du architektonisches Denken brauchst.

Diese saubere Aufteilung hat sich aufgelöst. Ich benutze jetzt beide über den Tag verteilt und wechsle eher nach Gefühl als nach Regeln. Codex für eine Aufgabe, Claude Code für die nächste, manchmal beide beim Review desselben Plans. Die Tools sind nah genug in ihren Fähigkeiten, dass die Frage "welches soll ich hierfür nehmen?" weniger wichtig ist als noch vor zwei Wochen.

Was sich geändert hat, ist die Ökonomie.

OpenAIs Plus Plan kostet $20/Monat mit zunehmend großzügigen Limits. Ich ertappe mich dabei, immer häufiger zu Codex zu greifen — nicht weil es bei irgendeiner einzelnen Sache dramatisch besser wäre, sondern weil die Kombination aus Geschwindigkeit, Token-Effizienz und dem $20-Preispunkt die Reibung beseitigt. Es gibt keine mentale Rechnung mehr "ist diese Aufgabe es wert, Claude Code Tokens dafür zu verbrennen?"

Ich tendiere dazu, meinen Claude Code Plan vom $200/Monat Max Tier auf den $100/Monat Plan zu reduzieren, möglicherweise sogar auf den $20/Monat Pro Plan. Vor zwei Wochen hätte sich das riskant angefühlt. Jetzt fühlt es sich praktisch an. Die Arbeit, bei der Claude Code exzellent sein muss — Frontend-Design, Agent Teams Orchestrierung, die automatische QA, die Dinge abfängt, die ich übersehen würde — das sind echte Vorteile. Aber sie erfordern vielleicht keine $200/Monat, wenn Codex die Hälfte meiner Arbeitslast für $20 übernimmt.

Mir ist bewusst, dass diese Wette Risiken hat. Das $20 Claude Code Tier hat echte Nutzungslimits — wenn ich sie während einer kritischen Session erreiche, werde ich das Downgrade bereuen. Und OpenAIs großzügige $20-Limits sind wahrscheinlich ein Marktanteil-Manöver, das nicht ewig halten wird. Aber im Moment sprechen die Wirtschaftlichkeit für Dual-Wielding.

Die Gesamtkosten ($20 Codex + $100 oder sogar $20 Claude Code) wären weniger als das, was ich für Claude Code allein bezahlt habe. Und die kombinierte Leistung ist besser als jedes der Tools solo zu jedem Preis.

Das ist vielleicht die praktischste Erkenntnis aus zwei Wochen Dual-Wielding: der Wettbewerb macht die Tools nicht nur besser. Er macht sie auch günstiger. Und günstiger bedeutet, du kannst dir beide leisten.

Was ich als Nächstes erwarte

Beide Plattformen beschleunigen. Codex hat gerade Plugins, Triggers und einen Windows-Client gestartet. Claude Code hat gerade Agent Teams, AutoMemory, Computer Use und Scheduled Tasks ausgeliefert. Keiner steht still.

Ein wiederkehrendes Thema in Entwickler-Communities auf Reddit — und ich denke, es fängt etwas Reales ein — ist, dass "Claude Code höhere Qualität hat, aber man stößt an Limits. Codex ist etwas niedrigere Qualität, aber im Alltag besser nutzbar." Die Balance verschiebt sich, während sich beide verbessern.

Mein Rat bleibt der gleiche wie beim ersten Post, aber jetzt noch stärker: probier das andere Tool eine Woche lang aus. Nicht um zu wechseln — um es hinzuzufügen. Der Cross-Model-Review-Workflow ist immer noch die beste Entdeckung, die ich gemacht habe. Und die operative Widerstandsfähigkeit, zwei Tools zu haben, denen du vertraust, wird dich an dem Tag retten, an dem eines davon ausfällt.

Als Nutzer ist das die bestmögliche Situation. Zwei exzellente Tools, die schnell besser werden, jedes das andere vorantreibend. Das Tempo des Wettbewerbs ist so hart, dass ich nicht glaube, dass ein Unternehmen lange komfortabel vorne bleiben kann — und genau deshalb fühlt sich die Wette auf ein einziges Tool zunehmend riskant an, während die Wette auf den Workflow (Dual-Wielding, Cross-Model-Review) sich zunehmend richtig anfühlt.

Häufig gestellte Fragen

Hat sich deine Meinung seit dem ersten Post geändert?

Die Kernthese — Dual-Wielding schlägt die Wahl eines Gewinners — ist nur stärker geworden. Was sich geändert hat, ist die Aufteilung (60/40 wurde zu 50/50) und die Gründe. Codex' Stärke im strategischen Denken hat mich mehr überrascht als seine Coding-Verbesserungen.

Ist Codex schneller als Claude Code?

Bei High Thinking, ja — durchgehend schneller, und Drittanbieter-Vergleiche deuten darauf hin, dass es ungefähr 3x weniger Token für vergleichbare Aufgaben benötigt. Bei Default Thinking ist der Unterschied kleiner. Bei iterativer Arbeit, bei der man häufig hin und her wechselt, summieren sich Geschwindigkeit und Token-Effizienz.

Sollte ich mir wegen Claude Codes Uptime Sorgen machen?

Die 90-Tage-Zahlen zeigen eine reale Lücke (99,2% vs 99,9%). Wenn Claude Code dein einziges Tool ist und du unter Zeitdruck arbeitest, hab einen Backup-Plan. Aber Anthropic hat allein im März etwa 10 Claude Code Releases ausgeliefert — sie iterieren schnell bei Features, auch wenn die Zuverlässigkeit hinter OpenAI zurückbleibt.

Was ist mit der Codex Sicherheitslücke?

Eine Command-Injection-Schwachstelle in Codex hätte GitHub-Token über Branch-Namen kompromittieren können. Sie wurde entdeckt und behoben. Wissenswert, aber auch erwähnenswert, dass Sicherheitsforscher diese Tools aktiv testen — was eine gute Sache für das Ökosystem ist.

Geht es in der Newsletter-Strategie-Geschichte wirklich um die Tools?

Teilweise. Verschiedene Modelle haben verschiedene Standard-Denkstile. GPT-5.4 hat eher meine Annahmen hinterfragt. Claude hat eher geholfen, meinen Plan gut umzusetzen. Beides ist nützlich — aber für Produktstrategie ist "löst du das richtige Problem?" oft wertvoller als "hier ist eine gute Implementierung."

Welches Tool soll ich kaufen?

Beide. Das ist keine Ausrede — es ist wirklich die beste Antwort. Codex für $20/Monat plus Claude Code für $20-100/Monat gibt dir bessere Ergebnisse als jedes Tool allein zu jedem Preis. Ich tendiere dazu, von $200/Monat bei Claude Code auf $100 oder sogar $20 zu reduzieren und Codex für $20 hinzuzufügen. Die Gesamtkosten sinken und die Leistung steigt. Allerdings: OpenAIs großzügige Limits könnten nicht von Dauer sein — also bleib flexibel.

Das war's von mir. Wenn du dein eigenes Dual-Wielding-Experiment laufen hast, würde ich ehrlich gerne hören, wie sich deine Aufteilung entwickelt. Gleiche Muster, oder etwas komplett anderes?

Cheers, Chandler