Am 3. April 2026 habe ich geschrieben, dass ich in 30 Tagen zurückkomme und ehrlich erzähle, was nach der Kündigung von Claude Max tatsächlich passiert ist.

Ich komme elf Tage früher zurück.

Nicht, weil ich ungeduldig bin. Sondern weil sich das Muster bereits gesetzt hat und es bis zum 2. Mai zurückzuhalten vor allem Theater wäre.

Die Pointe klingt zunächst falsch. Ein Tool namens Claude Code ist jetzt das Tool, das ich für fast alles nutze außer für Code.

Die Kurzversion ist diese:

- Codex mit GPT-5.4 auf xHigh thinking hat den Coding-Sitz übernommen.

- Claude Code mit Opus 4.7 auf xHigh hat alle anderen Plätze an meinem Schreibtisch übernommen.

- Die Geschichte vom "billigen Codex" ist in dem Moment zerbrochen, als echte Limits ins Spiel kamen.

Wenn ich die sauberste mögliche These formulieren müsste, wäre es wahrscheinlich diese:

Codex-GPT-5.4 auf xHigh für alles, was mit Code zu tun hat. Claude Code mit Opus 4.7 auf xHigh für alles andere.

Das ist eine schärfere Trennung, als ich vor neunzehn Tagen erwartet hatte.

Und es ist auch eine teurere und psychologisch aufschlussreichere Antwort, als ich gedacht hätte.

Was zuerst zerbrochen ist, war nicht die Code-Qualität

Als ich den Kündigungs-Post geschrieben habe, war die einfache Geschichte verlockend:

- Claude Max: 200 $/Monat

- Codex / ChatGPT: 20-25 $/Monat

- die Ausführungslücke wurde schnell kleiner

- OpenAI wirkte zuverlässiger

Das sah nach einem leichten Downgrade aus.

War es aber nicht.

Das Erste, was zerbrochen ist, war weder Architektur noch Planqualität noch Ausführungsdisziplin.

Es war die Limit-Geschichte.

Meine echte Timeline sah eher so aus:

- Apr 6: Ich habe zwei ChatGPT-Business-Sitze zu 25 $/Monat pro Sitz mit monatlicher Abrechnung gebucht.

- Apr 6: Ich dachte bereits in Workaround-Kategorien. Um ungefähr dieselbe Coding-Geschwindigkeit zu halten, vermutete ich, dass ich etwa drei Codex-fähige Accounts brauchen würde.

- Apr 10: Nach ein paar Tagen in genau diesem Setup hatte ich genug Belege, um es laut auszusprechen: Drei günstige Accounts reproduzierten immer noch nicht das, was mir der Claude-Max-Plan in seinen besten Momenten gegeben hatte.

- Apr 12: Ich habe ChatGPT Pro für 100 $/Monat gekauft, weil ich mit jeder Stunde, die ich Codex für reines Coding nutzte, mehr GPT-5.4 auf high und xHigh reasoning wollte, nicht weniger.

Das ist die erste ehrliche Korrektur zum Post vom 3. April.

Der Ersatz war nicht "200 $ Claude Max werden zu 20 $ Codex".

Er war eher:

- "Ich brauche nicht mehr denselben Anthropic-Plan wie früher."

- "Ich brauche aber mehr Codex-Kapazität als die günstige Stufe liefert."

- "Der echte Vergleich ist Workflow-Qualität unter realen Limits, nicht Benchmark-Screenshots."

Meine aktuelle Lesart ist, dass OpenAI bei den Limits wahrscheinlich aggressiv ist, weil es Marktanteile will. Das ist eine Schlussfolgerung, kein Insiderwissen. Falls das stimmt, bleibt dieses Fenster womöglich nicht dauerhaft offen.

Wenn du deine ganze Entscheidung also auf die heutigen 20-$-Ökonomien aufbaust, solltest du zumindest einräumen, dass dieses Pricing-Umfeld taktisch sein könnte und nicht stabil.

Codex hat den Coding-Sitz übernommen

Die wichtigste Erkenntnis für mich ist, dass GPT-5.4 auf xHigh thinking wie ein Coding-Spezialist wirkt.

Kein charismatischer.

Kein warmer.

Und auch keiner, der unbedingt dein Freund werden möchte.

Aber eben ein Spezialist.

Codex hat eine Nüchternheit, die mir am Ende mehr gefallen hat, als ich erwartet hätte. Es fühlt sich an, als würde man mit einem sachlichen, sorgfältigen, methodischen Engineer arbeiten, der dir keine Persönlichkeit vorspielt.

Das ist an langen Arbeitstagen wichtiger, als ich dachte.

Der klarste Moment dafür war der 17. April. Ich habe Codex-GPT-5.4 auf xHigh einen abgestimmten Plan gegeben und es arbeiten lassen. Es lief dreißig bis fünfundvierzig Minuten in einer einzigen Session durch, folgte dem Plan sehr genau, schrieb und führte Unit-, Integration- und Browser-Tests lokal aus, ohne dass ich permanent darüber sitzen musste.

Ich hatte bisher kein anderes Tool, das das mit derselben Konstanz für mich getan hat.

Das hat verändert, wie ich über Codex denke. Es ist nicht nur "gut genug für kleine Tasks". Es kann lange, disziplinierte Ausführung, wenn der Plan klar ist.

Für reine Coding-Arbeit greife ich inzwischen fast immer zu Codex:

- Architektur

- Implementierung

- Debugging

- Eval-Design

- Test-Framing

- Pipeline-Cleanup

- produktnahe Logik mit Produktionsfokus

Das beste April-Beispiel ist Prova.

Der Großteil der nützlichen Arbeit in Prova war nicht glamourös. Es war nicht "schau, wie smart das Modell ist". Es war:

- komponierbare Sprints evaluieren

- Onboarding-Logik schärfen

- Widersprüche zwischen Roadmap-Generierung und zugewiesenem Sprint-Zustand finden

- das Produkt anhand echter User-Zeilen und echtem Produktionsverhalten verbessern

Genau diese Art Arbeit passt erstaunlich gut zu Codex.

Es ist kompetent, gründlich und überraschend scharf, wenn der Job ist:

- den Widerspruch identifizieren

- den Logikfehler isolieren

- Korrektheit von RFC-Territorium trennen

- den kleinsten vertretbaren nächsten Schritt empfehlen

Eines der klarsten Beispiele kam aus genau einer Prova-Produktionszeile für einen User mit Builder-Intent.

Das System hatte:

- einen User mit Builder-Intent als

marketing_vpgelabelt table-stakes-diagnosticzugewiesen- eine Roadmap erzeugt, die später in der Journey startete

- direkt nach dem Onboarding eine Context-Check-Karte gezeigt

Was diese Episode wertvoll gemacht hat, war nicht nur die Diagnose, sondern die Cross-Review-Schleife.

Opus 4.7 brachte mich zu den ersten drei Punkten:

- ein Track-Calculation-Bug

- ein Timing-Bug

- eine Builder-Opener- / RFC-Frage

Dann hat GPT-5.4 die Analyse weitergeschoben und den Widerspruch gefunden, den Opus übersehen hatte:

- der zugewiesene erste Sprint und die generierte Roadmap erzählten demselben User bereits zwei unterschiedliche Wahrheiten

Das war wichtig. Es verschob die Diskussion von "sollen wir das Builder-RFC jetzt shippen?" zu "beheb zuerst den Live-Widerspruch und komm dann zum RFC zurück".

Es fühlte sich nicht wie ein Modell an, das mich beeindrucken wollte. Es fühlte sich wie ein Senior SWE an, der sagt: Fix zuerst den aktuellen Widerspruch, dann reden wir über Produkttheorie.

Dieses Muster hat sich in diesem Monat oft genug wiederholt, dass ich Codex nicht mehr als "die günstigere Alternative" sehe. Ich sehe es als mein primäres Coding-Instrument.

Claude Code hat alle anderen Plätze übernommen

Wenn die Geschichte dort enden würde, wäre die Antwort einfach: auf Codex wechseln und weitermachen.

Genau das ist aber nicht passiert.

Claude Code mit Opus 4.7 ist weiterhin besser für Arbeit, bei der das Ergebnis von Geschmack abhängt, oder bei der die Schleife lang, iterativ und kontextschwer ist.

An diesem Punkt klingt der Titel des Posts nicht mehr widersprüchlich, sondern präzise. Claude Code, die CLI, zu der ich früher instinktiv gegriffen habe, wenn es Zeit war zu coden, ist jetzt das Tool, zu dem ich greife, wenn ich irgendetwas tun muss außer Code zu schreiben.

Mit "alles andere" meine ich:

- Schreiben, das nach mir klingen muss

- auf Struktur und Rhythmus iterieren

- Naming und Positioning

- Taglines und Brand-Wording

- Bild-Prompts für Blog-Cover

- Logo- und Identitäts-Exploration

- stärkere

/frontend-design-Durchgänge, wenn visuelles Urteil wichtiger ist als nur funktionale UI - lange Research-Threads, in denen ich über mehrere Sessions hinweg eine Sichtweise aufbaue

Aus meiner Erfahrung der letzten neunzehn Tage hat sich das immer wieder bestätigt.

Der Unterschied wird besonders sichtbar, wenn es eine Feedback-Schleife gibt.

Sowohl Claude als auch Codex können alte Posts lesen, frühere Prompts betrachten und bestehende Arbeit als Referenz nutzen. Aber wenn ich mehrere Runden Verfeinerung mit Feedback nach jedem Versuch mache, versteht Claude die Richtung, in die ich will, nach wie vor verlässlicher.

Das gilt für Writing.

Es gilt auch für Image Prompting.

Es gilt auch für Naming.

Das klarste Produktbeispiel ist Prova. Auf diesen Namen bin ich nicht mit Codex gekommen. Für diese Art Arbeit brauchte ich Opus. Dasselbe gilt für viel Brand-Language-Exploration. GPT-5.4 gibt mir solide, kompetente Antworten. Opus hat mir die stärkere kreative Spannweite gegeben.

Dasselbe Muster taucht auch im Site-Design auf.

Der /frontend-design-Workflow unter Superpowers funktioniert für mich auf Opus noch immer besser als auf GPT-5.4, wenn die Arbeit designgetrieben und nicht engineeringgetrieben ist. Codex gibt mir etwas Funktionales. Claude gibt mir häufiger etwas, das ich tatsächlich mit Stolz shippen würde.

Wenn die Frage also lautet:

"Hat Codex Claude für alles ersetzt?"

Nein.

Es hat Claude auf dem Coding-Sitz ersetzt. Nicht für alles andere.

Dieser Unterschied ist wichtig.

Vertrautheit war real, und Entzug auch

Ich hatte Claude Code ungefähr 13 Monate lang genutzt.

So ein Zeitraum verändert nicht nur deine Präferenzliste, sondern auch deine Körperhaltung bei der Arbeit.

Als ich stärker auf Codex umgestiegen bin, habe ich ganz klar eine Art Entzugseffekt gespürt.

Nicht, weil Codex schlecht war.

Sondern weil es anders war.

Die Reibungspunkte waren klein, aber hartnäckig:

- bestimmte Berechtigungsbestätigungen

- das Gefühl, dass es in manchen Momenten eine Frage zu viel stellte

- der sterile Ton der Antworten

- das Fehlen dieser vertrauten Claude-"Stimme" in der Schleife

Das sind keine objektiven Defekte.

Das sind Workflow-Unterschiede.

Und Vertrautheit verändert, wie du sie wahrnimmst.

Ich will nicht so tun, als hätte ich diesen Übergang wie ein rein rationaler Ökonom durchlaufen.

Habe ich nicht.

An einem Punkt habe ich mich dabei ertappt, Arbeit durch Claude laufen zu lassen, rein als zusätzliche Sicherheits-Review-Schleife, nicht weil ich die zweite Meinung brauchte, sondern weil der Sog stärker war als mein eigenes Narrativ vom "sauberen Wechsel".

Was es mich gelehrt hat, ist, dass die eigentliche Abhängigkeit nicht nur an Claudes Rohleistung hing. Sie hing auch am Gefühl von Sicherheit, das daher kam, noch ein anderes intelligentes System in der Schleife zu haben, dem ich auf eine andere Weise vertraute.

Deshalb war die endgültige Antwort für mich auch nie "eins für immer auswählen".

Die Psychologie des Workflows spielt ebenfalls eine Rolle.

Codex hat seine eigenen Failure Modes

Diese Phase war keine einzige lange Reihe von Codex-Siegen.

Ich bin auch auf reale Probleme gestoßen.

Das erste, das sich wie ein wirklich Codex-spezifisches Problem angefühlt hat, passierte am 14. April. Über zwei Terminal-Sessions hinweg bekam ich diesen Fehler:

{

"error": {

"message": "Unknown parameter: 'prompt_cache_retention'.",

"type": "invalid_request_error",

"param": "prompt_cache_retention",

"code": "unknown_parameter"

}

}

So etwas ist wichtig, weil es Vertrauen auf der Harness-Ebene bricht, nicht auf der Reasoning-Ebene.

Ich habe außerdem bemerkt, dass Codex strenger damit zu sein scheint, was das Modell rund um Deployments oder Berührungen mit Produktion tun darf, selbst wenn entsprechende Freigaben zuvor in derselben Session schon erteilt worden waren.

Manchmal ist das gut.

Manchmal ist es nervig.

Aber es gehört definitiv zur echten User-Erfahrung.

Ein kleines Beispiel, das ich auf der Codex-Seite tatsächlich bevorzuge: Status und Limits prüfen, ohne den Hauptfluss zu unterbrechen. /status ausführen zu können, ohne auf das Ende der aktuellen Arbeit warten zu müssen, ist eine Kleinigkeit, aber über neunzehn Tage summieren sich genau solche Ergonomie-Details.

Das meine ich, wenn ich sage, dass die Tools sich nicht nur in der Output-Qualität unterscheiden. Sie unterscheiden sich auch im Harness-Gefühl.

Zuverlässigkeit zählt weiterhin, und der April hat Claude nicht geholfen

Einer der Gründe, warum ich mich überhaupt wohl mit dem Wechsel fühlte, war Zuverlässigkeit.

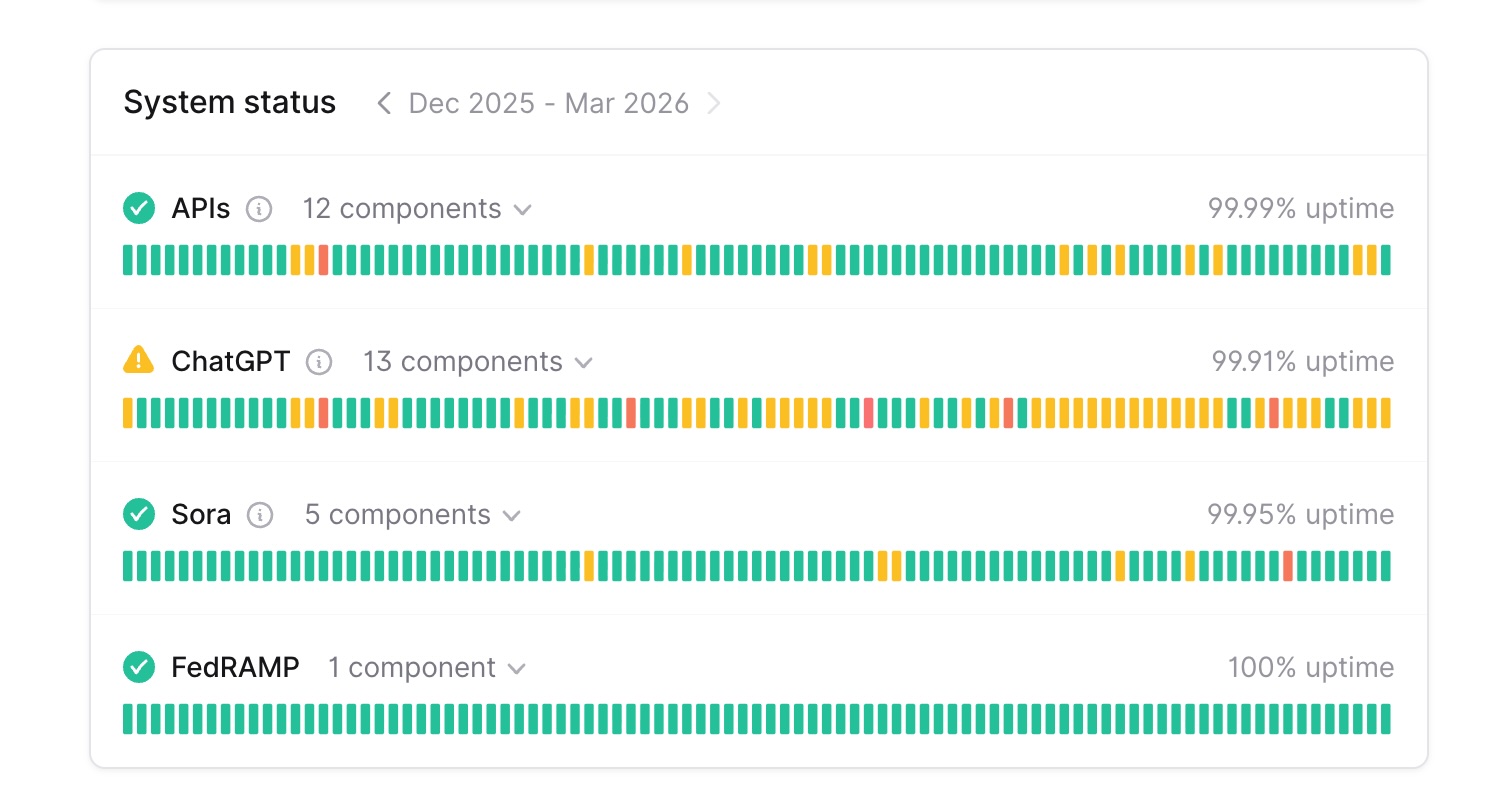

Ich hatte im Follow-up vom 31. März bereits über den 90-Tage-Statusunterschied zwischen Anthropic und OpenAI geschrieben. Das große Bild ist weiterhin relevant:

Und dann hat der April noch eine weitere Erinnerung aus der Praxis geliefert.

Am 15. April hatte Claude erneut elevated errors bei Claude.ai, der API und Claude Code. Das Login war betroffen. Die API erholte sich zuerst. Claude-Code-User, die bereits eingeloggt waren, konnten weiterarbeiten, aber das Login selbst war eine Zeit lang kaputt.

Das löscht Claudes Stärken nicht aus.

Es stärkt aber das praktische Argument, den gesamten Workflow nicht auf einen einzigen Anbieter zu setzen.

Das bleibt eine der haltbarsten Lektionen aus dem ganzen Experiment:

Zwei Tools parallel zu nutzen ist nicht nur Luxus. Es ist operative Resilienz.

Wenn ein Anbieter einen schlechten Nachmittag hat, shipst du weiter.

Opus 4.7 hat das Muster geschärft, nicht umgedreht

Claude Opus 4.7 ist am 16. April erschienen. Irgendein ehrliches Urteil zu veröffentlichen, ohne es ernsthaft ausprobiert zu haben, wäre unfair gewesen.

Also habe ich es fast sofort gegen eine echte Coding-Diagnose in Prova laufen lassen.

Opus 4.7 lieferte mir einen soliden First Pass. Es identifizierte den Track-Bug, die falsch getimte Context-Check-Karte und die größere Builder-Opener-Frage.

Dann habe ich diese Diagnose noch einmal durch GPT-5.4 als Critique Pass laufen lassen, nicht als blinde zweite Meinung, sondern als Reviewer, der Opus' schriftliche Analyse prüft. GPT-5.4 fand den schärferen Widerspruch, den Opus übersehen hatte: Das Produkt wies bereits einen ersten Sprint zu, während es gleichzeitig eine Roadmap generierte, die an einem anderen Punkt startete. Das war nicht nur ein Builder-Fit-Thema. Das war ein echtes Correctness-Problem live im Produkt.

Danach habe ich die überarbeitete Diagnose zurück durch Opus geschickt, und es konvergierte.

Die Überraschung kam aber in die andere Richtung.

Am 19. April ist mir etwas aufgefallen, womit ich nicht gerechnet hatte: Bei einfacheren Aufgaben — einer kurzen Code-Review-Runde, einer fokussierten Ausführung für eine kleine Änderung — ist Opus 4.7 auf xHigh spürbar langsamer als Codex-GPT-5.4 auf xHigh. Ich hatte eher das Gegenteil erwartet.

Dieses eine Detail hat mein Muster erneut verankert.

Wo Opus für mich weiterhin klar gewinnt, ist die geschmacksgetriebene, iterative, kontextlange Arbeit, die ich oben beschrieben habe. Wo Codex klar gewinnt, ist tiefe Coding-Diagnose und auch die schnellen alltäglichen Coding-Turns, für die ich früher zu Claude gegriffen hätte.

Die ehrliche Version lautet also:

- Opus 4.7 liefert mir bei tieferer Code-Analyse immer noch einen guten First Pass

- bei leichteren Coding-Turns wirkt es derzeit langsamer als GPT-5.4 auf demselben Thinking-Level

- zusammen mit der Continuous-Execution-Erfahrung vom 17. April hat das den Coding-Sitz weiter in Richtung Codex verschoben, statt ihn näher an ein Unentschieden zu bringen

Wo ich tatsächlich gelandet bin

Wenn man das Drama, die Pricing-Screenshots, die Outage-Screenshots und das Social-Post-Framing weglässt, dann hat sich Stand 22. April mein Arbeitsmuster so eingependelt:

Für alles, was mit Code zu tun hat

Greife ich zuerst zu Codex mit GPT-5.4 auf xHigh thinking.

Warum:

- es fühlt sich spezialisiert an

- es ist methodisch

- es ist sorgfältig

- es geht gut mit Architektur und Ausführung um

- es kann einen abgestimmten Gesamtplan mit Unit-, Integration- und Browser-Tests dreißig bis fünfundvierzig Minuten am Stück durchlaufen lassen

- bei alltäglichen Coding-Turns ist es im Moment schneller als Opus 4.7 auf xHigh

- ich kann ihm bei tiefer Coding-Arbeit inzwischen leichter vertrauen

Für alles andere

Greife ich zu Claude Code mit Opus 4.7 auf xHigh thinking.

Das umfasst jetzt:

- Writing, das nach mir klingen muss

- Bild-Prompts für Cover-Art

- Naming, Positioning und Brand-Sprache

/frontend-design-Durchgänge, die visuelles Urteilsvermögen brauchen- lange Research-Threads, in denen ich über mehrere Sessions hinweg eine Perspektive aufbaue

- meine eigenen Pläne reviewen, bevor ich sie an Codex gebe

- diesen Blog-Post

Warum:

- es folgt meinem Stil besser

- es geht besser mit feedbackgetriebener kreativer Iteration um

- es ist stärker bei Brand-Geschmack und Design-Geschmack

- es ist weiterhin das Modell, dem ich am meisten vertraue, wenn der Job Urteilskraft verlangt und nicht Ausführung

Für wichtige Coding-Pläne

Ich mag die Cross-Review-Schleife weiterhin:

- einen Plan von einem holen

- den anderen ihn kritisieren lassen

- und ihn von dort aus schärfen

Dieser Workflow fühlt sich für mich weiterhin robuster an, als auf die erste Antwort eines einzelnen Modells zu setzen, egal wie gut dieses Modell ist. Die Builder-Intent-Zeile, die ich oben beschrieben habe, ist genau der Grund, warum mir dieses Setup weiterhin gefällt.

Beim Pricing

Ich bin nicht bei einem simplen billigen Wechsel gelandet.

Ich bin hier gelandet:

- ich will die alte 200-$-Claude-Max-Struktur nicht mehr

- ich will mehr Codex-Kapazität, nicht weniger

- ich akzeptiere ChatGPT Pro für 100 $ als die realistischere Antwort für meinen Coding-Plan

- und ich halte Claude für alles, was nicht Code ist, weiter in der Schleife

Beim Shipping

Der ganze Sinn des Wechsels war, weiter zu shippen. Das waren nicht neunzehn Tage Tool-Benchmarking ohne Ergebnis. Im selben Zeitraum ging der Operator/Builder-Split von Prova live, inklusive einer echten Builder-Execution-Lane, zwei substanzielle Blog-Posts wurden veröffentlicht, und ich habe einen kompletten Translation-Pass über zwölf Locales gefahren. Die Antwort auf die Frage, ob das Experiment mich Output gekostet hat, lautet nein.

Wenn du die komprimierteste Version willst:

Ich habe Claude Max gekündigt, aber Claude Code nicht aus meiner Arbeit entfernt. Ich habe Claude Code nur vom primären Coding-Sitz wegbewegt und ihm den Rest des Schreibtischs gegeben.

Das ist die wahrste Zusammenfassung, die ich dir geben kann.

Also: Würde ich dieselbe Entscheidung noch einmal treffen?

Ja.

Aber ich würde sie heute anders beschreiben.

Am 3. April war das Framing:

"Ich habe Claude Max gekündigt und teste, ob Codex es ersetzen kann."

Am 22. April sieht das Framing eher so aus:

"Ich habe Claude Max gekündigt, festgestellt, dass Codex im Moment der stärkere Coding-Spezialist für mich ist, und nutze Claude Code jetzt für alles andere an meinem Schreibtisch — dort, wo es weiterhin das beste Tool ist, das ich habe."

Diese Antwort ist weniger binär, teurer als die einfache Social-Post-Version und deutlich näher an der Wahrheit.

Häufige Fragen

Hat Codex Claude beim Coding tatsächlich ersetzt?

Für mich ja. Bei reiner Coding-Arbeit ist Codex mit GPT-5.4 auf xHigh thinking mein Default-Sitz geworden. Opus 4.7 auf xHigh liefert mir bei tieferer Diagnose immer noch einen guten First Pass, aber es ist für mich nicht mehr der primäre Coding-Sitz und wirkt bei leichteren Turns langsamer.

Hat die Geschichte vom billigen Codex standgehalten?

Nicht wirklich. In dem Moment, in dem ich es in echtem Volumen genutzt habe, erzählte die günstige Stufe nicht mehr die ganze Geschichte. Ich bin auf einen teureren OpenAI-Plan gewechselt, weil ich mehr Kapazität wollte, nicht weil das Experiment gescheitert wäre.

Brauche ich Claude noch?

Ja, wenn deine Arbeit Writing, Design, Naming, Image Prompting, lange Research-Threads oder irgendeine andere geschmacks- oder urteilsgetriebene Schleife umfasst. Opus 4.7 auf xHigh ist in meinem Workflow zum Default für alles geworden, was nicht Code ist.

Was ist mit Zuverlässigkeit?

Der Zuverlässigkeitsabstand zählt weiterhin. Der April hat das noch verstärkt. Die Antwort ist nicht Panik. Die Antwort ist Backup-Abdeckung.

Warum elf Tage früher veröffentlichen?

Weil sich das Muster gesetzt hat. Den Post bis zum 2. Mai zurückzuhalten, nur um die genaue Zahl aus der ursprünglichen Headline zu ehren, wäre Theater gewesen. Die ehrliche Sache war, zu sagen, was ich jetzt tatsächlich tue, und weiterzugehen.

Welchen Plan würde ich heute kaufen?

Wenn dein Job hauptsächlich aus Coding besteht, würde ich mir Codex / GPT-5.4 zuerst sehr ernsthaft anschauen. Wenn deine Arbeit Coding plus viel geschmacksgetriebene Kreativarbeit umfasst, würde ich nicht ohne Claude sein wollen. Und wenn 100 $ im Monat gerade außerhalb deiner Reichweite liegen, funktioniert die 20-$-Codex-Stufe weiterhin für kleinere Einzelprojekte — rechne nur damit, unter dauerhaftem Multi-Projekt-Betrieb schneller an Limits zu stoßen. Meine eigene Antwort ist im Moment keine Ein-Tool-Antwort mehr.

Das ist das ehrliche Neunzehn-Tage-Update.

Codex hat den Coding-Sitz übernommen.

Claude Code hat alle anderen Plätze übernommen.

Deshalb ist ein Tool, das wörtlich Claude Code heißt, jetzt das Tool, zu dem ich greife, wenn die Arbeit alles außer Code ist.

Und die eigentliche Lektion ist wieder einmal: Workflow zählt mehr als Fandom.

Wenn du in diesem Monat einen ähnlichen Wechsel gemacht hast, würde ich wirklich gern wissen, wo du gelandet bist. Hat ein Tool für dich klar gewonnen, oder ist deine eigene Trennung ebenfalls schärfer geworden?

Viele Grüße,

Chandler