Por qué la memoria de la IA importa más que la elección de modelo para equipos de marketing

La mayoría de los equipos todavía preguntan qué modelo usar. Desde mi experiencia, esa ya no es la pregunta principal. Si tu sistema de AI olvida al cliente o la marca, la categoría y lo que significa un buen resultado, el modelo más inteligente del mundo sigue empezando cada conversación desde cero.

Últimamente, cuando hablo con equipos de marketing sobre IA, la pregunta que sigue apareciendo es:

"¿Qué modelo deberíamos usar?"

¿Claude? ¿GPT? ¿Gemini? ¿Algún modelo open-source ajustado con datos propios?

Entiendo por qué la gente pregunta. Suena como la pregunta estratégica. Suena como la parte que debería importar más.

Solo que ya no creo que lo sea.

Desde mi experiencia hasta ahora, la diferencia más grande generalmente no es el modelo. Es la memoria.

Si tu sistema de AI olvida todo lo importante en el momento en que el chat termina, entonces cada nueva tarea empieza con el mismo ritual costoso:

- volver a explicar el cliente o el negocio

- volver a explicar la audiencia

- volver a explicar el tono

- volver a explicar lo que ya se intentó

- volver a explicar cómo se ve algo "bueno"

En ese punto, realmente no tienes un sistema. Tienes un amnésico muy impresionante.

Y lo digo con cariño, porque yo mismo he construido algunos :P

El modelo es inteligente. El sistema sigue olvidando.

Esto es lo que se me ha hecho más claro durante el último año.

La capa de modelos sigue mejorando a un ritmo ridículo. El razonamiento mejora. Lo multimodal mejora. El coding mejora. El uso de herramientas mejora. La latencia baja. Los costos cambian. Cada pocas semanas hay un nuevo benchmark y un nuevo anuncio y otra razón para sentirse ligeramente atrasado.

Pero si quito todo eso y miro lo que realmente cambia los resultados para un equipo de marketing, la pregunta suele ser mucho más simple:

¿Recuerda la IA suficiente contexto para tomar una buena decisión sin que la briefeen desde cero cada vez?

Ese contexto rara vez es glamoroso. No son "datos propietarios" en abstracto. Generalmente son cosas como:

- qué mensajes el cliente o el equipo de liderazgo ya aprobaron

- qué ofertas tuvieron bajo rendimiento el trimestre pasado

- qué segmentos son demasiado estrechos para escalar

- qué claims legal nunca va a aprobar

- qué stakeholder necesita sentirse involucrado

- qué vistas de reporting el cliente, CMO o CFO realmente confían

- qué definiciones de éxito importan dentro de esta organización

Sin esa memoria, el modelo puede producir algo pulido. A veces muy pulido.

Pero pulido no es lo mismo que útil.

A qué me refiero con "memoria"

No me refiero solo al historial del chat.

Me refiero a una capa estructurada de contexto retenido que se acumula con el tiempo.

Desde mi punto de vista, hay al menos tres tipos de memoria que importan para equipos de marketing.

1. Memoria del cliente

Para agencias, es el contexto vivo alrededor del cliente. Para equipos in-house, es el contexto vivo alrededor de la marca, la unidad de negocio o las prioridades de liderazgo que dan forma al trabajo.

- voz de marca

- realidades de la categoría

- posicionamiento aprobado

- campañas anteriores

- preferencias de stakeholders

- restricciones conocidas

Misma arquitectura de memoria, diferente resultado.

Si estás en una agencia, esta memoria se acumula en mejor output estratégico y un costo de cambio más alto con el tiempo. Si estás in-house, se convierte en memoria organizacional y resiliencia institucional. Cuando tu mejor estratega o analista se va, ¿el conocimiento se va con ellos?

Esto es lo que un nuevo estratega normalmente aprende lentamente a través de reuniones, feedback, errores y repetición. El punto no es si lo llamas memoria del cliente o memoria organizacional. El punto es que sin estructurarlo deliberadamente, el contexto se queda atrapado en las personas en lugar del sistema.

2. Memoria operativa

Esta es la capa de "cómo trabajamos."

- checklists

- reglas específicas por canal

- criterios de QA

- sistemas de nomenclatura de campañas

- lógica de reporting

- rutas de escalación

Cuando los equipos no capturan esto, siguen redescubriendo las mismas verdades operativas. Generalmente bajo presión de deadline. Generalmente con un formato ligeramente diferente cada vez.

3. Memoria de evaluación

Esta es la más interesante para mí.

No es solo memoria de hechos. Es memoria de juicio.

¿Qué rechazó el equipo, y por qué? ¿Qué dijo el cliente, CMO o equipo de liderazgo que "no estaba del todo bien"? ¿Qué patrones aparecen en el trabajo exitoso? ¿Qué cuenta como un brief útil, un plan sólido, un reporte confiable, un setup listo para lanzar?

Esa es la capa que transforma la IA de generación de output a verdadero apalancamiento. (Esta es también una de las ideas centrales en mi curso de AI-Native Media Operations — el modelo operativo solo funciona cuando el juicio está estructurado en el sistema, no dejado al azar.)

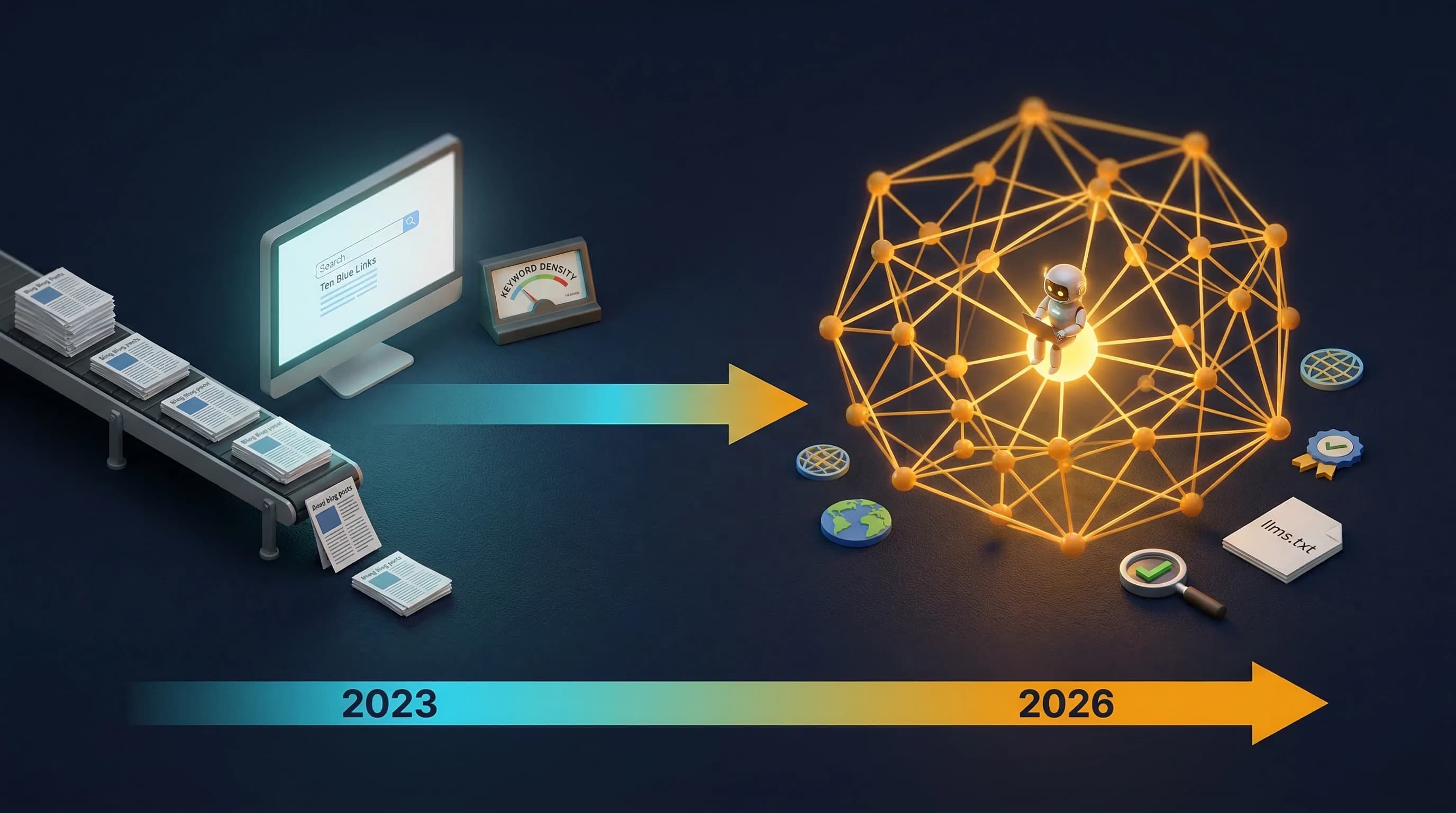

Por qué la memoria se acumula más que los modelos

Los modelos mejoran a través de los roadmaps de los proveedores.

La memoria mejora a través de tu propio trabajo.

Esa es una curva de acumulación muy diferente.

Si Anthropic u OpenAI lanzan un mejor modelo, te beneficias. Por supuesto. Y no estoy minimizando eso. Mejor razonamiento importa absolutamente.

Pero tus competidores también se benefician.

Esa es la parte que creo que la gente subestima.

Una mejora de modelo suele ser de distribución amplia. Una capa de memoria no lo es. Escribí sobre una idea relacionada en La IA eleva el piso — cuando todos tienen la misma IA, la profundidad se vuelve el diferenciador. La memoria es una forma de esa profundidad.

Tu contexto compartido de cliente u organización, tus criterios de evaluación, tus lecciones acumuladas, tus estándares operativos, tu lenguaje interno para lo que significa "bueno." Esas cosas se construyen dentro de la organización. Se afilan con el uso. Y son mucho más difíciles de copiar que "usamos el modelo más reciente."

En otras palabras:

- el modelo es ventaja rentada

- la memoria es ventaja acumulada

Quizás estoy exagerando un poco, pero no creo que mucho.

El ejemplo de marketing al que siempre vuelvo

Imagina pedirle a la IA que produzca una recomendación de campaña para un cliente o para tu propio equipo de marca.

Un modelo fuerte puede generar absolutamente una respuesta razonable. En muchos casos, una sorprendentemente buena.

Pero ¿qué pasa si no sabe:

- al CEO no le gusta el lenguaje de marca que se siente demasiado juguetón

- el equipo de ventas no confía en el volumen de MQL a menos que la calidad de oportunidad sea visible

- los últimos dos experimentos en YouTube tuvieron bajo rendimiento porque el problema real fue el desajuste de la landing page

- los mercados regionales necesitan diferentes puntos de prueba

- finanzas ya topó el crecimiento de paid social para el trimestre

La respuesta podría seguir viéndose estratégica.

Hasta podría sonar más estratégica que la verdad.

Pero desde mi experiencia, exactamente ahí es donde los equipos se meten en problemas con la IA. Confunden fluidez con inteligencia contextualizada.

El modelo suena como si entendiera el negocio. Lo que realmente entiende es la forma de una buena respuesta.

No son lo mismo.

El riesgo, por supuesto, es la mala memoria

Debo ser justo aquí.

La memoria no es automáticamente buena. La mala memoria escala malas suposiciones. La memoria obsoleta solidifica pensamiento desactualizado. La memoria sin estructura se convierte en un cajón de sastre. Y si metes todo en "contexto," el sistema se vuelve más ruidoso en vez de más inteligente.

Así que no estoy abogando por memoria infinita.

Estoy abogando por memoria curada.

Memoria útil.

La clase que ayuda a un equipo a responder:

- ¿qué debería saber la IA por defecto?

- ¿qué debería permanecer específico de la tarea?

- ¿qué debería validarse antes de reusar?

- ¿qué debería retirarse porque ya no refleja la realidad?

En otras palabras, la memoria necesita cuidado. Igual que el contenido. Igual que la estrategia.

Lo que creo que los equipos deberían construir primero

Si estuviera ayudando a un equipo de marketing a tomarse esto en serio, empezaría con un ejercicio muy poco glamoroso.

No bibliotecas de prompts. No una competencia de modelos. No "nuestro deck de estrategia de AI."

Empezaría definiendo:

- ¿Qué contexto se reusa con más frecuencia?

- ¿Qué errores se repiten porque el sistema olvida?

- ¿Qué criterios definen output aceptable?

- ¿Qué conocimiento del cliente o marca nunca debería tener que reescribirse?

Eso te dice inmediatamente qué debería almacenar tu capa de memoria.

Y una vez que esa memoria existe, las decisiones de modelo se vuelven más valiosas porque operan sobre un fundamento mucho mejor.

Esta es una de las razones por las que me he interesado más en arquitecturas de memoria compartida que en debates de modelos. Los modelos importan. Pero los sistemas sin memoria generan mucha productividad falsa.

Todo se ve rápido. Nada se acumula realmente.

Donde me deja esto

Todavía me importan los modelos. Los pruebo constantemente. Uso más de uno. Disfruto las comparaciones. Son genuinamente útiles.

Pero si me preguntaras de dónde viene la ventaja duradera de un equipo de marketing ahora, no empezaría por el modelo.

Empezaría con esta pregunta:

¿Qué recuerda tu sistema de AI después de que termina la demo impresionante?

Si la respuesta es "no mucho," entonces creo que ese es el verdadero cuello de botella.

Eso es parte del pensamiento detrás de cómo he estado construyendo STRATUM. No "un chatbot más," sino un sistema donde el contexto se acumula en lugar de desaparecer. Quizás escriba más sobre eso por separado porque sí, hay un ángulo de producto aquí, pero creo que el modelo operativo es más grande que cualquier producto individual.

Eso es todo de mi parte.

Genuinamente me gustaría saber cómo otros equipos están pensando sobre esto. ¿Pasan más tiempo eligiendo modelos o construyendo memoria? Y ¿han encontrado una forma de mantener el contexto compartido útil sin que se convierta en desorden?

Cheers, Chandler