Lo Que Las Agencias Realmente Necesitan De La AI No Es Más Contenido

Sigo viendo herramientas de AI vendiéndoles a las agencias volumen de contenido. Pero si alguna vez gestionaste relaciones reales con clientes, sabes que el problema más difícil es la confianza: aislamiento, permisos, contexto y no filtrar el pensamiento de un cliente en el trabajo de otro.

Supe que estaba construyendo lo incorrecto cuando me descubrí imaginando a un dueño de agencia emocionándose por "50 ideas de posts para LinkedIn en 10 segundos."

No porque las ideas de contenido sean inútiles. No lo son.

Sino porque si de verdad has pasado tiempo dentro de agencias, sabes que esa no es la parte aterradora del trabajo.

La parte aterradora es la confianza.

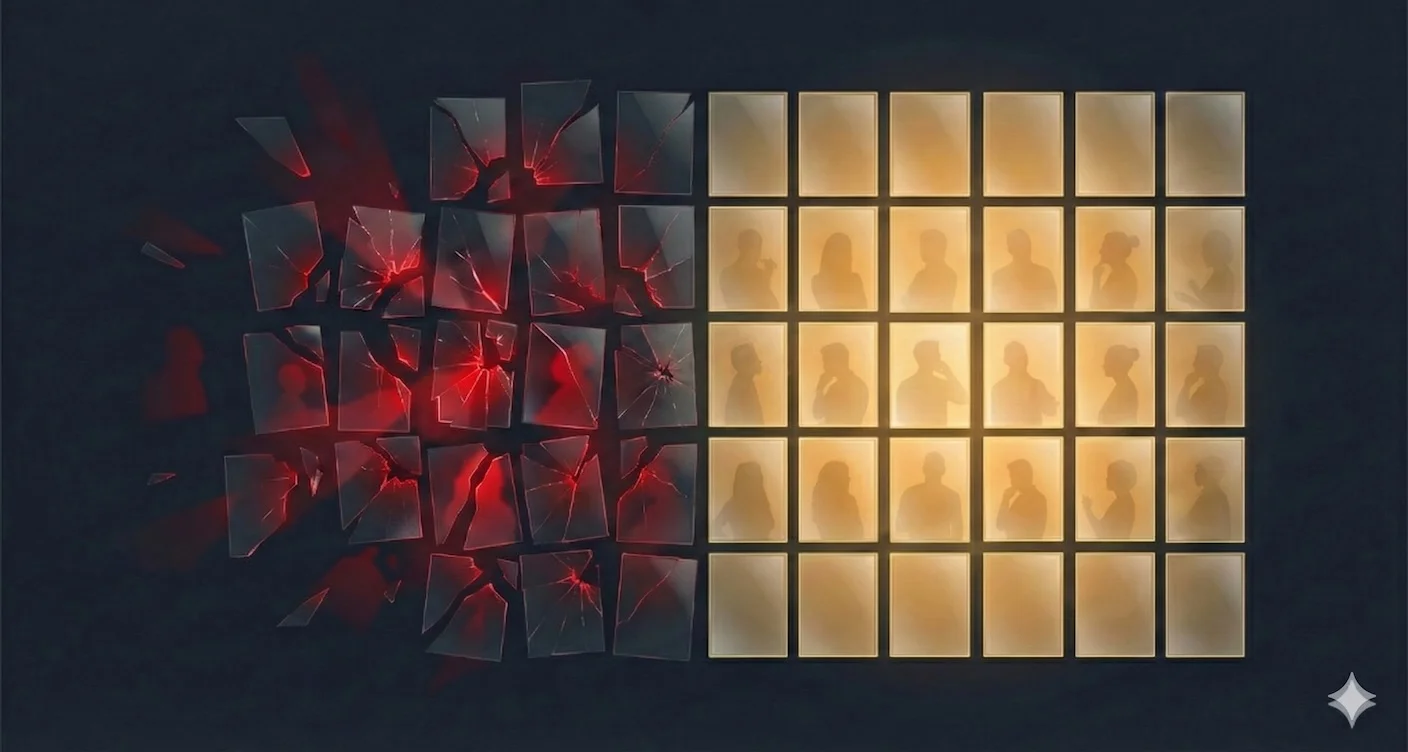

Es la account manager preguntándose si un sistema podría mezclar accidentalmente al Cliente A con el Cliente B.

Es la estratega pensando: "¿Puedo usar esto con seguridad en una cuenta competitiva?"

Es el dueño de la agencia haciendo una pregunta mucho menos sexy de lo que cualquier homepage de AI quiere responder:

¿Qué pasa si esta cosa filtra la inteligencia de un cliente dentro del trabajo de otro?

Esa pregunta importa mucho más que "¿cuántos captions puede generar?"

Creo que una gran parte del mercado de software con AI todavía entiende mal a las agencias porque entiende mal el trabajo real. Las agencias no sufren principalmente por escasez de palabras. Sufren por complejidad:

- múltiples clientes

- múltiples marcas

- múltiples roles internos

- múltiples capas de aprobación

- múltiples versiones de "quién puede ver qué"

Así que cuando un vendor de AI aparece y dice: "Buenas noticias, ahora pueden hacer más contenido más rápido", parte de mí quiere responder: ¿alguna vez te sentaste de verdad dentro de un workflow de agencia?

Porque cuanto más construía STRAŦUM, más claro me quedaba que las agencias no necesitan primero más contenido.

Necesitan mejor infraestructura para la confianza.

El Problema De Las Agencias No Es El Volumen. Es El Riesgo

Creo que esto se entiende más fácil si alguna vez tuviste responsabilidad sobre trabajo de clientes con stakes reales.

Cuando manejas una sola marca, la vida es más simple. Tus notas son tus notas. Tu trabajo de posicionamiento se queda en un solo carril. Tus errores siguen siendo dolorosos, pero por lo menos son locales.

Las agencias no viven ahí.

Las agencias están haciendo malabares con:

- distintas voces de marca

- distintas categorías

- distintas cadenas de aprobación

- distintas definiciones de éxito

- clientes que incluso pueden competir entre sí

Eso significa que el costo de un error no es "hicimos un borrador mediocre."

A veces el costo es:

- enviamos lo incorrecto al cliente incorrecto

- expusimos el contexto incorrecto en el workspace incorrecto

- hicimos que la plataforma se sintiera insegura

- el cliente ahora se pregunta qué otras cosas estarán igual de desordenadas detrás de escena

Y una vez que un cliente empieza a hacerse esa última pregunta, ya entraste en territorio caro.

Por eso me vuelvo escéptico cuando la AI para agencias se vende casi enteramente a través de ejemplos de output. Un demo de contenido generado prueba que el modelo puede generar contenido. Bien. Pero para las agencias, la prueba más importante es arquitectónica.

Muéstrame:

- dónde viven los datos

- cómo se aísla el contexto de cada cliente

- quién puede acceder a qué

- si las aprobaciones están integradas

- si el trabajo de un cliente puede contaminar el de otro

Esa es la historia de producto que realmente les importa a las agencias, aunque sea mucho menos divertida de poner en un launch video.

Creo Que Mi Background En Publicidad Hizo Que Esto Se Volviera Obvio Más Rápido

Quizá porque vengo de publicidad, nunca me creí del todo esa historia de que "el cuello de botella es el contenido" para las agencias.

No me malinterpretes, las agencias sí producen contenido. Muchísimo. Y sí, ahí hay ganancias reales de eficiencia.

Pero lo que vuelve difícil el trabajo de agencia normalmente no es la ausencia de un primer borrador.

Es el entorno operativo alrededor del borrador.

¿Quién lo revisó?

¿Para qué cliente es esto?

¿Qué contexto moldeó esta recomendación?

¿Se generó con las restricciones de marca correctas?

¿Alguien reutilizó supuestos incorrectos por accidente?

¿Quién tiene permiso para aprobarlo?

Si estás in-house, algunas de esas cosas todavía importan.

Si eres una agencia, todas importan todos los días.

Por eso tomé una decisión que se sintió un poco poco razonable al principio de la vida de STRAŦUM: empecé a construir multi-tenancy casi de inmediato. Día 2, básicamente. Lo cual, en retrospectiva, fue o bien disciplinado o bien un poco insano, según cuán generoso te sientas.

En ese momento yo solo tenía un agente funcionando. Construir aislamiento por cliente tan temprano se sentía prematuro.

También resultó ser correcto.

Porque una vez que ves con claridad a las agencias, te das cuenta de que no son simplemente "SMEs con más usuarios." Tienen un modelo operativo fundamentalmente distinto.

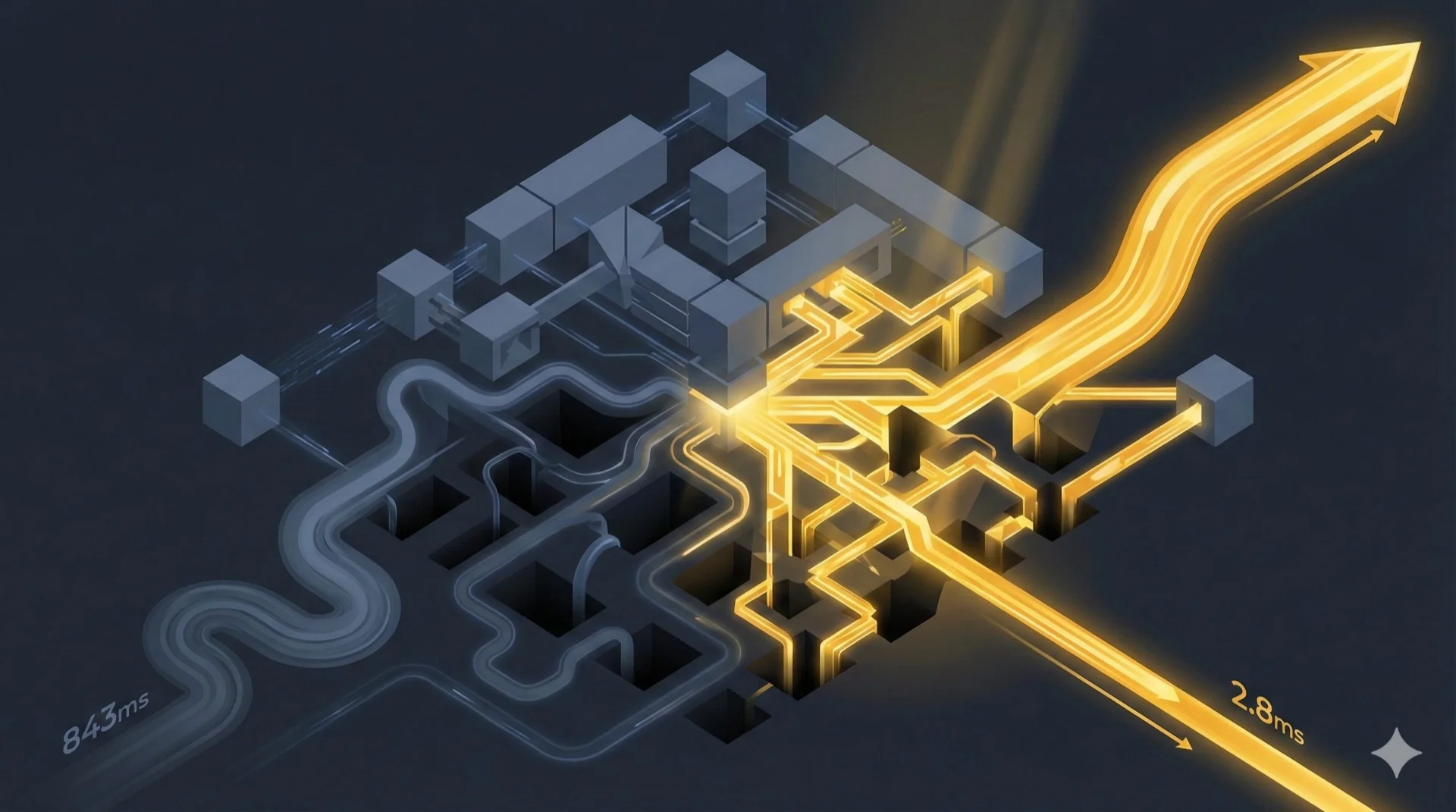

El Día En Que Me Di Cuenta De Que org_id No Me Iba A Salvar

Mi primera versión de multi-tenancy fue la versión clásica del builder optimista.

Agregar org_id a todo.

Escribir tus policies.

Confiar en los filtros.

Dar el problema por resuelto.

Eso funciona para una cantidad sorprendente de software. También te da la ilusión reconfortante de que ya resolviste el aislamiento cuando lo que en verdad resolviste fue el alcance básico.

Para STRAŦUM, no alcanzaba.

Porque las agencias no tenían solo una capa organizacional. Tenían clientes dentro de la organización. Y cada cliente necesitaba su propio contexto, outputs, historial y fronteras de seguridad.

Eso significaba que yo estaba intentando forzar dos modelos de datos distintos dentro de un atajo mental:

- SME: una organización, un contexto de negocio

- Agencia: una organización, múltiples contextos de cliente debajo

Puedes fingir esto durante un tiempo en lógica de aplicación. La gente lo hace. Pero cuanto más lo miraba, más me daba cuenta de que estaba construyendo un sistema que podía verse correcto y aun así ser estructuralmente demasiado confiado.

Esa es una mala combinación.

Hizo falta una reconstrucción para dejarlo bien. Routing separado. Lógica de schema separada. Más guardrails a nivel de base de datos. Manejo de contexto más explícito. Menos "solo recuerda filtrar correctamente en todos lados."

¿Molesto? Sí.

¿Valió la pena? También sí.

Aunque siendo honesto — incluso después de la reconstrucción, semanas después encontré otra brecha donde usuarios asignados a clientes específicos aún podían ver datos de otros clientes a través de un query path diferente. La arquitectura era mejor, pero no estaba completa. Todavía no tengo plena confianza de que sea hermética.

Porque la confianza de una agencia no debería depender de que un developer recuerde cada rama if/else a las 11:30 PM.

La AI Empeora El Problema De Confianza, No Lo Mejora

Esta es la parte que creo que la categoría todavía subestima.

La AI no es simplemente otra capa de interfaz encima del trabajo de agencia. Cambia el perfil de riesgo porque ahora tienes un sistema que puede sintetizar contexto, no solo almacenarlo.

Lo cual es poderoso.

Y también exactamente la razón por la que las fronteras débiles son inaceptables.

Si un sistema de AI tiene acceso al contexto equivocado, no solo expone datos crudos. Puede remezclarlos. Puede dejar que los insights del Cliente A informen silenciosamente la estrategia del Cliente B. Puede convertir errores de aislamiento en outputs con apariencia pulida, lo cual honestamente es peor que un bug visible porque cuesta más detectarlo.

Por eso me ponen nervioso las herramientas de AI de propósito general en entornos de agencia cuando la gente empieza a usarlas con demasiada soltura entre cuentas múltiples.

Puedes salirte con la tuya un tiempo.

Hasta que un día alguien nota que el lenguaje suena familiar.

O una recomendación incluye un framework competitivo que jamás debió estar en ese workspace.

O un cliente ve algo que lo hace preguntarse si tus sistemas están compartimentalizados de verdad.

Y una vez que esa duda entra en la relación, ya no estás arreglando un workflow de contenido. Estás reparando creencia.

Suerte haciendo eso con algunos captions extra de blog.

Lo Que Las Agencias Sí Necesitan

Si le quito toda la teatralidad de AI, creo que las agencias necesitan unas cuantas cosas poco glamorosas con mucha más urgencia:

1. Aislamiento seguro de contexto por cliente

No solo account switching.

No solo carpetas.

No solo copy de "nos tomamos la privacidad en serio".

Aislamiento real — a nivel de base de datos, no a nivel de aplicación. Me refiero a esquemas separados o enrutamiento separado, no a una tabla compartida con una columna client_id y la esperanza de que cada consulta filtre correctamente.

2. Permisos conscientes del rol

Distintas personas necesitan distintos niveles de acceso:

- strategist

- account manager

- approver

- client stakeholder

- admin

Sin eso, la herramienta puede sentirse "colaborativa" en un demo y caótica en la realidad.

3. Workflows de aprobación

Las agencias no son creadores solitarios lanzando ideas directamente al mundo. Hay borradores, comentarios, revisiones, aprobaciones, cambios y política interna. Muchísima política :P

Si el sistema de AI no respeta eso, no está respetando el trabajo de agencia.

4. Memoria compartida dentro de la frontera correcta

Esto importa muchísimo.

Dentro de un contexto de cliente determinado, el sistema sí debería volverse más inteligente con el tiempo. Ahí es donde la AI se vuelve útil. Pero tiene que componer dentro de la cerca correcta, no a través de todo el trabajo de manera indiscriminada.

5. Inteligencia estratégica antes que ejecución

De nuevo, no estoy en contra del contenido. Solo estoy en contra de que contenido primero sea toda la historia.

Las agencias necesitan ayuda para entender:

- qué debería decir el cliente

- qué debería enfatizar el cliente

- qué está pasando competitivamente

- dónde está débil la estrategia

- cómo alinear al equipo alrededor de una recomendación

Eso es mucho más valioso que producir otro montón de entregables genéricos.

Por Eso STRAŦUM Terminó Viéndose Así

Muchas decisiones de producto dentro de STRAŦUM tienen más sentido cuando las ves a través de este lente.

¿Por qué progressive learning?

Porque las agencias ya repiten contexto demasiadas veces.

¿Por qué multi-tenant routing?

Porque el contexto del cliente no puede ser una sugerencia amable.

¿Por qué aprobaciones y colaboración?

Porque el trabajo de agencia no es una persona chateando con un bot dentro del vacío.

¿Por qué enfocarse en intelligence over execution?

Porque a las agencias normalmente no les pagan bien por producir más ruido. Les pagan cuando crean confianza, dirección y mejores decisiones para sus clientes.

Ese es el tipo de producto de AI que quiero construir para ellas.

No el que dice "mira qué rápido puedes churnear."

Sino el que dice "mira qué tan más seguro y más agudo puede volverse tu trabajo estratégico."

No digo que haya hecho todo esto bien. Digo que los problemas forzaron decisiones arquitectónicas específicas que la mayoría de las herramientas de AI de propósito general aún no han tenido que tomar — o no han elegido tomar.

La Cosa Que Ojalá Más Vendors De AI Admitieran

Los compradores de agencia normalmente están evaluando dos productos al mismo tiempo:

- el producto del demo

- el problema futuro que ese producto podría crear

Por eso el output bonito de AI, por sí solo, no convence.

El comprador no solo está preguntando: "¿Esto puede ayudarnos?"

También está preguntando: "¿Esto puede dañarnos después?"

Y si no puedes responder bien esa segunda pregunta, todo tu output generado es básicamente decoración.

No creo que las agencias necesiten más decoración.

Creo que necesitan sistemas en los que puedan confiar frente al cliente.

Eso es un producto mucho más difícil de construir.

También es, creo, un producto mucho más honesto.

Eso es todo de mi parte.

Me encantaría escuchar especialmente a gente de agencia en esta. ¿La AI que han visto realmente redujo riesgo, o sobre todo aumentó la cantidad de contenido que su equipo puede producir mientras los dolores operativos de verdad siguen exactamente donde estaban?

Cheers, Chandler