Pourquoi la mémoire de l'IA compte plus que le choix du modèle pour les équipes marketing

La plupart des équipes demandent encore quel modèle utiliser. D'après mon expérience, ce n'est plus la question principale. Si ton système d'IA oublie le client ou la marque, la catégorie, et ce à quoi ressemble un bon résultat, le modèle le plus intelligent du monde recommence quand même chaque conversation à zéro.

Ces derniers temps, quand je parle d'IA avec des équipes marketing, la question qui revient sans cesse est :

"Quel modèle devrait-on utiliser ?"

Claude ? GPT ? Gemini ? Un modèle open-source fine-tuné sur vos propres données ?

Je comprends pourquoi les gens posent la question. Ça sonne comme la question stratégique. Ça sonne comme la partie qui devrait compter le plus.

Je ne pense simplement plus que ce soit le cas.

D'après mon expérience jusqu'ici, la plus grande différence ne se situe généralement pas au niveau du modèle. Elle se situe au niveau de la mémoire.

Si ton système d'IA oublie tout ce qui est important dès que le chat se termine, alors chaque nouvelle tâche commence avec le même rituel coûteux :

- réexpliquer le client ou le business

- réexpliquer l'audience

- réexpliquer le ton

- réexpliquer ce qui a déjà été testé

- réexpliquer ce à quoi ressemble du "bon" travail

À ce stade, tu n'as pas vraiment un système. Tu as un amnésique très impressionnant.

Et je dis ça avec tendresse, parce que j'en ai construit quelques-uns moi-même :P

Le modèle est intelligent. Le système oublie quand même.

C'est ce qui m'est devenu de plus en plus clair au cours de la dernière année.

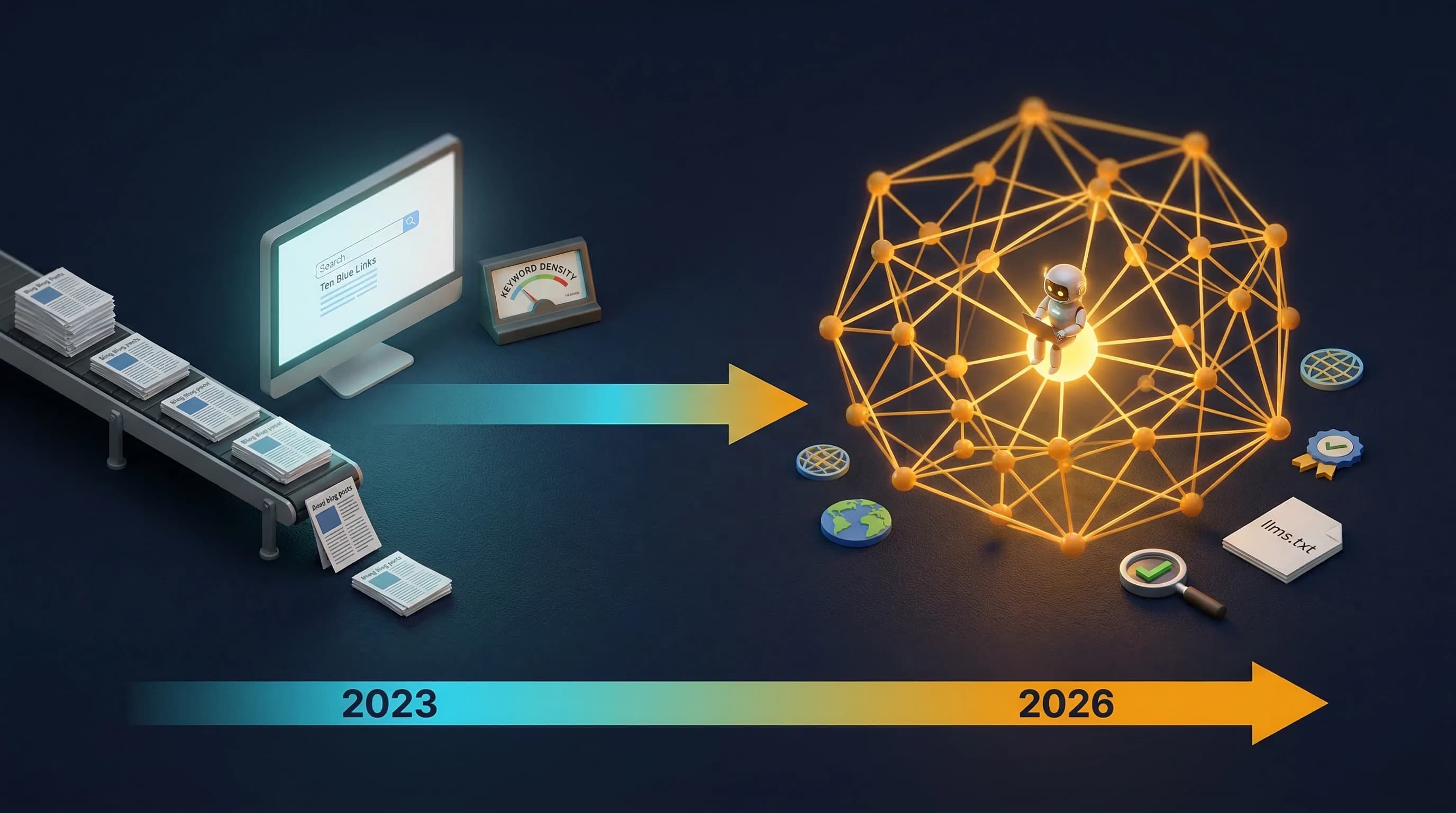

La couche modèle s'améliore à un rythme absurde. Le raisonnement s'améliore. Le multimodal s'améliore. Le coding s'améliore. L'utilisation d'outils s'améliore. La latence diminue. Les coûts évoluent. Toutes les quelques semaines, il y a un nouveau benchmark, une nouvelle annonce et une raison supplémentaire de se sentir légèrement en retard.

Mais si j'enlève tout ça et que je regarde ce qui change vraiment les résultats pour une équipe marketing, la question est souvent beaucoup plus simple :

Est-ce que l'IA retient assez de contexte pour prendre une bonne décision sans être briefée de zéro à chaque fois ?

Ce contexte est rarement glamour. Ce ne sont pas des "données propriétaires" dans l'abstrait. Ce sont généralement des choses comme :

- quels messages le client ou l'équipe dirigeante a déjà validés

- quelles offres ont sous-performé le trimestre dernier

- quels segments sont trop étroits pour scaler

- quelles affirmations le juridique n'acceptera jamais

- quel stakeholder a besoin de se sentir impliqué

- quelles vues de reporting le client, le CMO ou le CFO font réellement confiance

- quelles définitions du succès comptent au sein de cette organisation

Sans cette mémoire, le modèle peut quand même produire quelque chose de poli. Parfois très poli.

Mais poli, ce n'est pas la même chose qu'utile.

Ce que j'entends par "mémoire"

Je ne parle pas du seul historique de chat.

Je parle d'une couche structurée de contexte retenu qui se compose avec le temps.

De mon point de vue, il existe au moins trois types de mémoire qui comptent pour les équipes marketing.

1. Mémoire client

Pour les agences, c'est le contexte vivant autour du client. Pour les équipes in-house, c'est le contexte vivant autour de la marque, de l'unité commerciale ou des priorités de la direction qui façonnent le travail.

- voix de marque

- réalités de la catégorie

- positionnement approuvé

- campagnes passées

- préférences des stakeholders

- contraintes connues

Même architecture de mémoire, bénéfice différent.

Si tu es en agence, cette mémoire se compose en meilleur output stratégique et un coût de changement plus élevé au fil du temps. Si tu es in-house, elle devient mémoire organisationnelle et résilience institutionnelle. Quand ton meilleur stratège ou analyste part, est-ce que le savoir part avec lui ?

C'est le genre de choses qu'un nouveau stratège apprend normalement lentement, à travers les réunions, le feedback, les erreurs et la répétition. La question n'est pas de savoir si tu appelles ça mémoire client ou mémoire organisationnelle. La question est que sans structuration délibérée, le contexte reste piégé dans les personnes plutôt que dans le système.

2. Mémoire opérationnelle

C'est la couche "comment on travaille."

- checklists

- règles spécifiques par canal

- critères de QA

- systèmes de nomenclature des campagnes

- logique de reporting

- chemins d'escalade

Quand les équipes ne capturent pas ça, elles redécouvrent sans cesse les mêmes vérités opérationnelles. Généralement sous pression de deadline. Généralement avec un formatage légèrement différent à chaque fois.

3. Mémoire d'évaluation

Celle-ci est la plus intéressante à mes yeux.

Ce n'est pas seulement la mémoire des faits. C'est la mémoire du jugement.

Qu'est-ce que l'équipe a rejeté, et pourquoi ? Qu'est-ce que le client, le CMO ou l'équipe dirigeante a qualifié de "pas tout à fait ça" ? Quels patterns émergent du travail qui marche ? Qu'est-ce qui compte comme brief utile, plan solide, rapport fiable, setup prêt pour le lancement ?

C'est la couche qui transforme l'IA de simple génération d'output en véritable levier. (C'est aussi l'une des idées centrales de mon cours AI-Native Media Operations — le modèle opérationnel ne fonctionne que quand le jugement est structuré dans le système, pas laissé au hasard.)

Pourquoi la mémoire se compose plus que les modèles

Les modèles s'améliorent via les roadmaps des fournisseurs.

La mémoire s'améliore via ton propre travail.

C'est une courbe de composition très différente.

Si Anthropic ou OpenAI sort un meilleur modèle, tu en profites. Bien sûr. Et je ne minimise pas ça. Un meilleur raisonnement compte vraiment.

Mais tes concurrents en profitent aussi.

C'est la partie que je pense que les gens sous-estiment.

Une amélioration de modèle est souvent largement distribuée. Une couche de mémoire ne l'est pas. J'ai écrit sur une idée liée dans L'IA relève le plancher — quand tout le monde a la même IA, la profondeur devient le différenciateur. La mémoire est une forme de cette profondeur.

Ton contexte partagé de client ou d'organisation, tes critères d'évaluation, tes leçons accumulées, tes standards opérationnels, ton langage interne pour ce que "bien" signifie. Ces choses se construisent au sein de l'organisation. Elles s'affinent avec l'usage. Et elles sont bien plus difficiles à copier que "on utilise le dernier modèle."

Autrement dit :

- le modèle est un avantage loué

- la mémoire est un avantage accumulé

J'exagère peut-être légèrement, mais je ne crois pas de beaucoup.

L'exemple marketing auquel je reviens sans cesse

Imagine demander à l'IA de produire une recommandation de campagne pour un client ou pour ta propre équipe de marque.

Un modèle performant peut absolument générer une réponse raisonnable. Dans beaucoup de cas, une réponse étonnamment bonne.

Mais qu'est-ce qui se passe s'il ne sait pas que :

- le CEO déteste le langage de marque qui sonne trop ludique

- l'équipe commerciale ne fait pas confiance au volume de MQL si la qualité des opportunités n'est pas visible

- les deux derniers tests sur YouTube ont sous-performé parce que le vrai problème était le décalage de la landing page

- les marchés régionaux ont besoin de preuves différentes

- la finance a déjà plafonné la croissance du paid social pour le trimestre

La réponse pourrait quand même avoir l'air stratégique.

Elle pourrait même sonner plus stratégique que la vérité.

Mais d'après mon expérience, c'est exactement là que les équipes se mettent en difficulté avec l'IA. Elles confondent fluence et intelligence située.

Le modèle a l'air de comprendre le business. Ce qu'il comprend réellement, c'est la forme d'une bonne réponse.

Ce n'est pas la même chose.

Le risque, évidemment, c'est la mauvaise mémoire

Je me dois d'être honnête ici.

La mémoire n'est pas automatiquement bonne. Une mauvaise mémoire met à l'échelle de mauvaises hypothèses. Une mémoire obsolète fige une pensée dépassée. Une mémoire non structurée devient un bric-à-brac. Et si tu balances tout dans le "contexte," le système devient plus bruyant au lieu de plus intelligent.

Je ne plaide donc pas pour une mémoire infinie.

Je plaide pour une mémoire curatée.

Une mémoire utile.

Le genre qui aide une équipe à répondre à :

- que devrait savoir l'IA par défaut ?

- qu'est-ce qui devrait rester spécifique à la tâche ?

- qu'est-ce qui devrait être validé avant réutilisation ?

- qu'est-ce qui devrait être retiré parce que ça ne reflète plus la réalité ?

Autrement dit, la mémoire a besoin de stewardship. Tout comme le contenu. Tout comme la stratégie.

Ce que je pense que les équipes devraient construire en premier

Si j'aidais une équipe marketing à prendre ça au sérieux, je commencerais par un exercice très peu glamour.

Pas des bibliothèques de prompts. Pas un comparatif de modèles. Pas "notre deck stratégie IA."

Je commencerais par définir :

- Quel contexte est réutilisé le plus souvent ?

- Quelles erreurs se répètent parce que le système oublie ?

- Quels critères définissent un output acceptable ?

- Quel savoir client ou marque ne devrait jamais avoir à être retapé ?

Ça te dit immédiatement ce que ta couche de mémoire devrait stocker.

Et une fois que cette mémoire existe, les décisions de modèle deviennent plus précieuses parce qu'elles opèrent sur un bien meilleur socle.

C'est l'une des raisons pour lesquelles je m'intéresse de plus en plus aux architectures de mémoire partagée plutôt qu'aux débats de modèles. Les modèles comptent. Mais les systèmes sans mémoire créent beaucoup de fausse productivité.

Tout a l'air rapide. Rien ne s'accumule vraiment.

Où ça me laisse

Je m'intéresse toujours aux modèles. Je les teste constamment. J'en utilise plus d'un. J'aime les comparaisons. Ils sont genuinement utiles.

Mais si tu me demandais d'où vient l'avantage durable d'une équipe marketing aujourd'hui, je ne commencerais pas par le modèle.

Je commencerais par cette question :

Qu'est-ce que ton système d'IA retient une fois que la démo impressionnante est terminée ?

Si la réponse est "pas grand-chose," alors je pense que c'est le vrai goulot d'étranglement.

C'est en partie la réflexion derrière la façon dont je construis STRATUM. Pas "encore un chatbot," mais un système où le contexte se compose au lieu de disparaître. J'écrirai peut-être plus à ce sujet séparément parce qu'il y a un angle produit, oui, mais je pense que le modèle opérationnel est plus grand que n'importe quel produit individuel.

C'est tout pour moi.

J'aimerais sincèrement savoir comment d'autres équipes réfléchissent à ce sujet. Vous passez plus de temps à choisir des modèles ou à construire de la mémoire ? Et avez-vous trouvé un moyen de garder le contexte partagé utile sans qu'il devienne du fouillis ?

Cheers, Chandler