Codexを2週間使って、月額200ドルのClaude Codeプランを解約することにした

最初の比較記事から2週間、両ツールとも大きなアップデートがありました。 Codexは、Claude Codeにはなかった形で僕のプロダクト戦略に疑問を投げかけてきました。 Claude CodeはAgent TeamsとAutoMemoryをリリース。結果として、月額200ドルの Maxプランを解約しつつ、より少ないコストでより良いアウトプットを得ています。

2週間前、CodexとClaude Codeの二刀流について書きました。あの記事は、これまで僕が書いた中で一番反響がありました。同じ実験をしている人がたくさんいたようです。

当時の僕の使い分けは明確でした。Claude Codeは実行品質とQA、Codexはアーキテクチャの推論と長期的な計画。両方のツールをそれぞれの強みで使い分け、重要な作業はクロスモデルレビューで確認する、というものです。

2週間後、両ツールとも大幅なアップデートがあり、バランスが変わりました。劇的にではありませんが、書く価値があるくらいには。(ちなみに、この記事はClaude Codeで書いています。忠誠心からではなく、現在の請求サイクルがまだ有効で、すでに支払ったお金を無駄にしたくないからです。こういう実用的な計算こそが、この記事のポイントそのものです。)

2026年3月は両プラットフォームにとって激動の月でした。Codexはpluginsをローンチし、Slack、Gmail、Linear、Figma、Sentryなどとの連携に対応。さらにTriggers(GitHub ワークフロー自動化)、GPT-5.4 miniとnanoモデル、Windows ネイティブサポートもリリースしました。Claude CodeはAgent Teams(マルチエージェント・オーケストレーション、まだ実験段階)、AutoMemory、Computer Use(macOS限定、Pro/Maxプラン)、/loopによるScheduled Tasksをリリースし、3月だけで約10回のリリースがありました。どちらのプラットフォームも猛スピードで進化しています。

ニュースレターの話(コードの話だけではない理由)

僕の考え方を変えた気づきは、コードを書くこととは何の関係もありませんでした。

僕のサイトにはフル機能のニュースレターシステムがあります。登録フォーム、記事内CTA、ウェルカムメール、デイリーcron、ダブルオプトイン、13言語対応。技術的にはすべて動いています。問題は、認証済みの登録者がゼロだということです。

これを改善する計画を作りました。コースからリードマグネットPDFを抽出し、Module 1をメールゲートの裏に置き、記事中にCTAを追加し、AIチャットボットを登録フローに接続し、YouTubeとLinkedInで再配信する。新しいことを7つ。

この計画はClaude Codeで作りました。生産的に感じました。

次に、同じブリーフをCodexに渡しました。すぐに反論が返ってきました。

リードマグネットは冗長です。Module 1はすでに無料です。一度に多くの施策を打ちすぎです。7つ全部作ったら、どれが効いているか分かりません。問題はインフラではなく、コピーです。「Stay in the loop」はありきたりです。認証メールの説得力が足りません。興味の選択はフリクションを増やしています。

Codexの計画はこうでした。まず既存のものを直す(コピーを書き直し、認証メールを改善し、フリクションを減らす)。次に新しい施策を1つだけ追加する(インラインブログCTA)。他のものを作る前に、GAイベントで計測する。

僕の計画は「もっと作る」でした。Codexの計画は「既存のものをまず機能させてから、新しいものを1つだけ試す」でした。僕の計画は1週間かかって何が効いたか分からなかったでしょう。Codexの計画は1日でリリースでき、次にどこに投資すべきかが正確に分かります。

正直に言うと、これには不意を突かれました。Claudeが戦略に弱いからではありません。もっと丁寧にプロンプトを書いていたら、たとえば「実行する前に僕の前提を疑って」と指示していたら、似たような反論が返ってきたかもしれません。でも、デフォルトの推論スタイルが明らかに違いました。GPT-5.4は「前提を疑う」がデフォルトでした。Claudeは「計画をうまく実行する」がデフォルトでした。

この違いはプロダクトの意思決定において重要です。

スピードとステアリング

日常のワークフローに予想以上に影響する2つのことに気づきました。

スピードとトークン効率: Codex + GPT-5.4のhigh thinkingは、同等のタスクにおいてOpus 4.6のhigh thinkingよりも一貫して高速です。サードパーティの比較によると、Codexは同様の作業で約3分の1のトークンで済むようです。あるベンチマークでは、Figma風のタスクでCodexが150万トークンだったのに対し、Claudeは620万トークンを使用しました。Claudeはより「声に出して考える」ため、より高品質な推論が得られますが、制限の消費が速くなります。3月20日頃から、Opusは以前よりツール呼び出しが増えているようにも感じます。答えに到達するまでの中間ステップが多くなっています。モデルの変更なのか偶然なのかは分かりませんが、体感できるレベルです。

リアルタイムのステアリング: ツールが作業中に新しいメッセージを送った場合、たとえば「待って、その方向じゃなくて、こっちを試して」と言うと、Codexはほぼ即座に読み取って方向を調整します。Claude Codeは現在の実行を終えてから修正を読む傾向があります。

些細なことに聞こえるかもしれません。でもそうではありません。エージェントが間違った方向に進んでいるのを見ていて軌道修正したいとき、「今すぐ修正を読む」と「現在の操作が終わってから読む」のラグは、長い作業セッションを通じて積み重なっていきます。

SSEバグ:具体的な例

新しいiOSアプリを作っていました。Claude Codeは40のSwiftファイルを生成してくれました。認証、エージェント、チャット、フレームワーク、ダッシュボード、プロフィール。印象的な幅広さです。しかし、致命的なバグが1つ残っていました。リアルタイムチャット用のSSEストリーミングが動きません。

バックエンドは問題ありませんでした。curlは動きます。でもSwiftクライアントでURLSessionDataDelegate.didReceive(data:)が発火しないのです。Claude Codeはこの問題に数時間取り組みました。複数のアプローチ、複数のデバッグセッション。

同じ問題をCodexに渡しました。数回の試行後、コミット7f592152 -- "fix(ios): restore real-time chat streaming."

これは代表的な例と言えるでしょうか?そうとは限りません。どのツールにも調子の良い日と悪い日があります。ただ、僕の経験では、Claude Codeがデバッグループにはまったとき、つまり同じアプローチのますます巧妙なバリエーションを試し続けるとき、Codexに切り替えるとデッドロックが解消されることが多いです。GPT-5.4は最初から問題の捉え方が違うからです。

Claude Codeがまだ勝っているところ

この記事を読んで、Codexが全面的にリードしていると結論付けるのは簡単でしょう。でもそれは間違いです。Claude Codeもこの月に大きな進化を遂げており、いくつかのアドバンテージはむしろ拡大しています。

Agent Teams。 2月にローンチされ、3月を通じて成熟してきました。複数のClaude Codeインスタンスが並列で動きます。エクスプローラー、コードレビューアー、実装者、テストランナー。依存関係の追跡と共有タスクリストも備えています。まだ実験段階でデフォルトでは無効ですが、有効にすると本当に印象的です。Codexにもマルチエージェントサポートはあります(タスクは隔離されたクラウドコンテナで実行)が、Claude CodeのAgent Teamsの方がより協調的に感じます。多くのファイルに影響する大規模なリファクタリングでは、Agent Teamsが現時点で良い体験を提供しています。

AutoMemory。 Claude Codeは、あなたの習慣に基づいてメモリルールを自動的に書くようになりました。数セッション後には、プロジェクト構造、命名規則、好みを把握しています。微妙な変化ですが、積み重ねの効果として、Claude Codeのセッションは時間とともに生産性が上がっていきます。現時点ではCodexのセッションにはない特徴です。

フロントエンドデザイン。 /frontend-designプラグインを使ったClaude Codeは、同等のスキルを使ったCodexよりも、明らかに洗練されたデザインシステム準拠のUIを生成します。3月26日のサイトリデザイン中にこれを直接テストしました。Claudeの出力は空間構成が優れ、スタイリングの一貫性が高く、より統一感のある仕上がりでした。ハーネスの利点(Claudeのプラグインシステムがより多くのコンテキストでスキルを実行する)かもしれませんが、実用的な結果は明確です。

コード品質。 Redditでの500人以上の開発者コメントのコミュニティ分析によると、ブラインド比較の約67%で開発者はClaude Codeの出力を好みました。よりクリーンで、より慣用的で、より良い構造のコードだと評価されています。僕の経験とも一致します。コードが機能するだけでなく保守可能でなければならないとき、Claude Codeには優位性があります。

自動QA。 まだキラー機能です。作業完了後、Claude Codeは自動的にレビューエージェントをディスパッチします。コードレビュー、整合性チェック、ギャップ分析。僕が頼まなくても。Codexにはまだこの機能がありません。正確さがスピードより重要なものについては、この機能だけでClaude Codeをワークフローに残す理由になります。

信頼性の問題

ほとんどの比較記事が避けるテーマについて共有したいと思います。

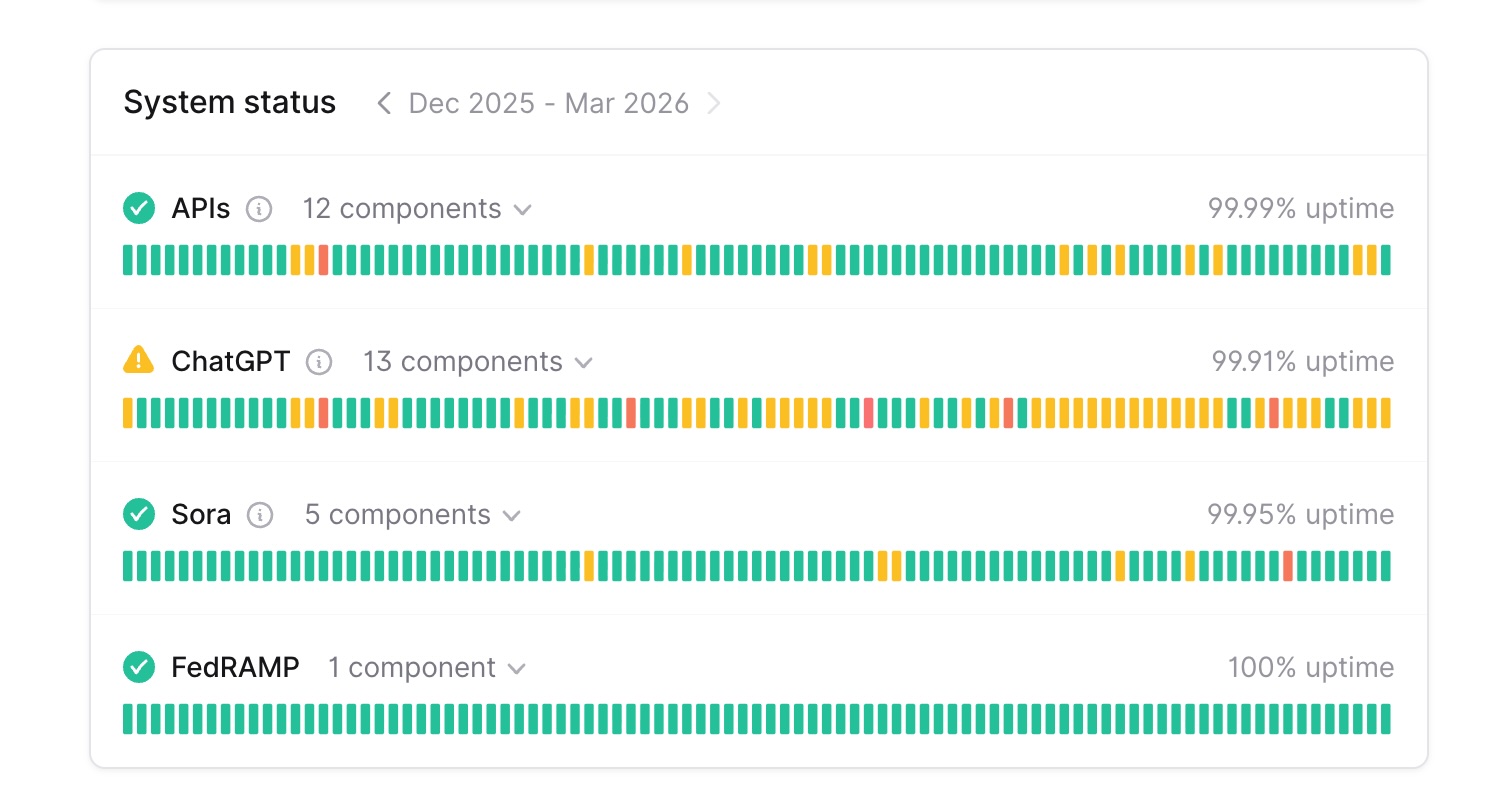

2026年3月下旬時点の、両ステータスページからの90日間の稼働率です:

| サービス | Anthropic | OpenAI |

|---|---|---|

| メインプラットフォーム | claude.ai: 99.16% | ChatGPT: 99.91% |

| API | api.anthropic.com: 99.24% | APIs: 99.99% |

| 開発者ツール | Claude Code: 99.48% | -- |

| コンソール | platform.claude.com: 99.41% | -- |

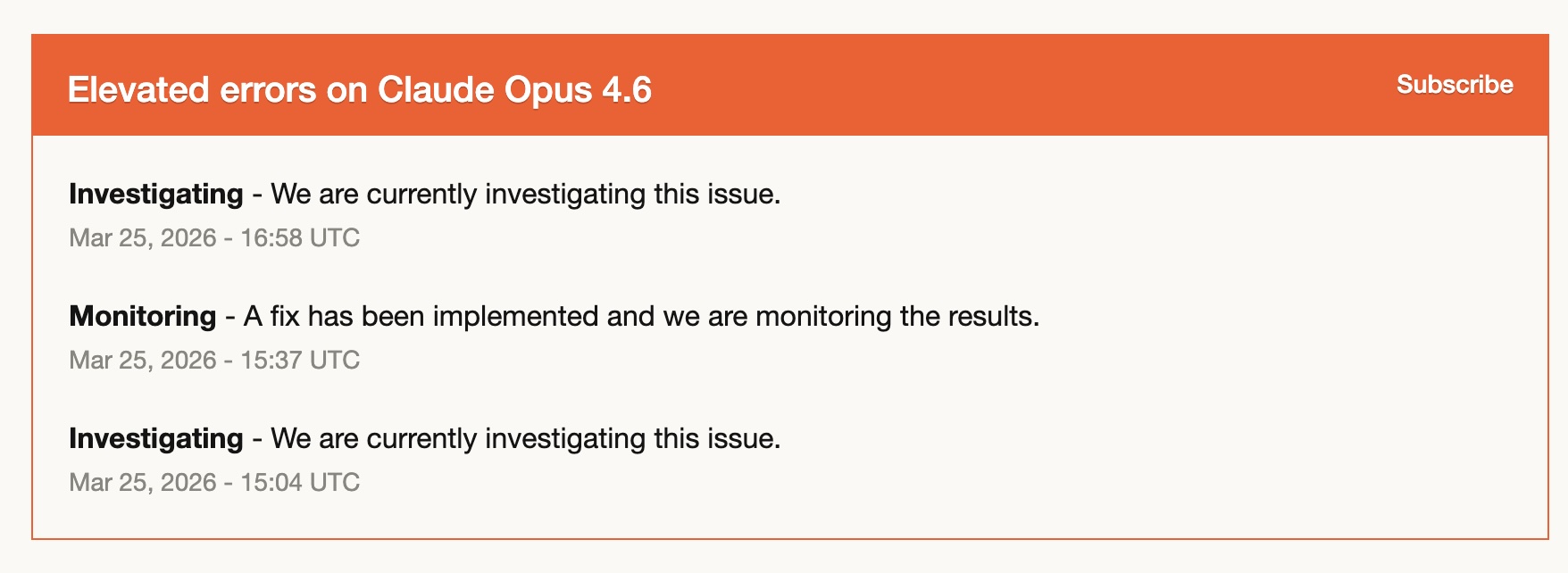

差は現実のものです。90日間で、AnthropicのサービスはOpenAIの約8-10倍のダウンタイムを経験しました。3月25日には特定のインシデントがありました。「Elevated errors on Claude Opus 4.6」で、調査-修正-調査のサイクルが約2時間続きました。

公平を期すと、これは全体像ではありません。信頼性はアップタイムだけではないのです。BeyondTrustのPhantom Labsは、Codexのコマンドインジェクションの脆弱性を公開しました。ブランチ名の操作を通じてGitHub認証トークンが漏洩する可能性がありました。この欠陥はWeb UI、CLI、SDK、IDE連携に影響しました。ユーザーが制御可能なブランチ名が、サニタイズなしでシェルコマンドに直接渡されていたのです。OpenAIは修正しましたが、安定性とセキュリティは信頼性の異なる次元であり、どちらも重要であることを思い出させてくれます。

アップタイムのデータを共有しているのは、Anthropicを批判するためではありません。僕は毎日Claude Codeを使っていますし、素晴らしいツールです。しかし、これらのツールを中心にプロフェッショナルなワークフローを構築している人にとって、数字は知っておく価値があります。そして、二刀流が単なる「あったらいいな」ではない理由がまさにこれです。一方のサービスの調子が悪い午後、もう一方に切り替えて作業を続けられます。この2週間で3回そうしました。

プラグインの差は縮まりつつある

前回の記事で、Claude Codeのプラグインエコシステムの方が成熟していると書きました。2週間前は事実でした。今日はそうとも言い切れません。

Codexは3月27日にプラグインシステムをローンチし、Slack、Gmail、Google Drive、Linear、Figma、Sentry、Notion、Hugging Faceとの連携に対応しました。さらにskills、hooks(SessionStartやUserPromptSubmitイベントを含む)、MCPサーバー、アプリとCLI両方のプラグインディレクトリも提供しています。

機能セットは収束しつつあります。両ツールとも今では、再利用可能なワークフロー用のplugins/skills、イベント駆動の自動化用のhooks、MCPサーバー統合、外部サービスとのアプリレベルの連携を備えています。

Claude Codeがまだリードしている点:既存のプラグインエコシステムの厚みです。Superpowers(構造化された計画立案)、/feature-dev(ガイド付き開発)、/frontend-designといったプラグインは数ヶ月かけて磨かれてきました。Codexのプラグインディレクトリは新しく、個々のプラグインはまだ実戦で鍛えられていません。

Codexが先行している点:Triggers。 CodexはGitHubイベントに自動応答できます。Issueが作成されると、Codexが自動で修正し、PRを開きます。これはClaude Codeがまだ提供していない、新しいカテゴリの自動化です。自律的なエンジニアリングワークフローを求めるチームにとって、Triggersは大きな差別化要因です。

アップデートされた僕の使い分けモデル

2週間前、僕はClaude Code/Codexを大体60/40で使い分けていました。明確なメンタルモデルがありました。品質が必要なときはClaude Codeを、アーキテクチャの推論が必要なときはCodexを。

そのきれいな分け方は崩れました。今では一日を通して両方を使い、ルールよりも感覚で切り替えています。あるタスクではCodex、次のタスクではClaude Code、ときには同じ計画を両方にレビューさせます。ツールの能力が十分に近いため、「これにはどっちを使うべき?」という問いは2週間前ほど重要ではなくなりました。

変わったのはコスト面です。

OpenAIのPlusプランは月額20ドルで、上限もどんどん緩やかになっています。Codexに手が伸びることが増えてきました。何か一つのことで劇的に優れているからではなく、スピード、トークン効率、そして20ドルという価格帯の組み合わせがフリクションを取り除くからです。「このタスクにClaude Codeのトークンを使う価値があるか?」という心の計算がなくなります。

Claude Codeのプランを月額200ドルのMaxティアから100ドルのプラン、あるいは20ドルのProプランに引き下げる方向に傾いています。2週間前なら、それはリスキーに感じたでしょう。今は実用的に感じます。Claude Codeに優れていてほしい作業、つまりフロントエンドデザイン、Agent Teamsのオーケストレーション、僕が見落とすものを拾ってくれる自動QA。これらは確かなアドバンテージです。でも、Codexが20ドルでワークロードの半分を処理してくれるなら、月200ドルは必要ないかもしれません。

このベットにリスクがあることは分かっています。20ドルのClaude Codeティアには実質的な利用制限があります。重要なセッション中に上限に達したら、ダウングレードを後悔するでしょう。OpenAIの寛大な20ドルの上限も、シェア獲得のための戦略であり、永遠に続くとは限りません。でも今の時点では、経済性は二刀流に有利です。

合計コスト(Codex 20ドル + Claude Code 100ドルまたは20ドル)は、Claude Code単体に払っていた金額より少なくなります。そして、組み合わせたアウトプットは、どちらのツール単体でもどの価格帯でも得られないものより優れています。

これが2週間の二刀流から得た、おそらく最も実用的なポイントです。競争はツールをより良くしているだけではありません。より安くもしています。そして安くなるということは、両方持てるということです。

今後の予想

両プラットフォームとも加速しています。Codexはplugins、triggers、Windowsクライアントをリリースしたばかり。Claude CodeはAgent Teams、AutoMemory、Computer Use、Scheduled Tasksをリリースしたばかり。どちらも立ち止まっていません。

Redditの開発者コミュニティで繰り返し見られるテーマとして、僕も何か本質的なものを捉えていると思うのですが、「Claude Codeの方が品質は高いが制限に当たる。Codexは品質がやや劣るが、日常的にはより使いやすい」というものがあります。両方が改善するにつれて、そのバランスは変わっていきます。

僕のアドバイスは最初の記事と同じですが、今はより強く言えます。もう一方のツールを1週間試してください。乗り換えるためではなく、追加するために。クロスモデルレビューのワークフローは、今でも僕が見つけた最高の発見です。そして、信頼できるツールを2つ持つ運用レジリエンスは、どちらかがダウンした日にあなたを救ってくれます。

ユーザーとして、これは最高の状況です。2つの優れたツールが急速に良くなり、互いを押し上げている。競争のペースは非常に激しく、どの企業も長く安泰でいられるとは思えません。だからこそ、1つのツールに賭けるのはますますリスキーに感じ、ワークフロー(二刀流、クロスモデルレビュー)に賭けるのはますます正しく感じるのです。

よくある質問

最初の記事から意見は変わりましたか?

コアとなる主張、つまり二刀流は勝者を選ぶより優れている、というのはさらに強くなりました。変わったのは配分(60/40が50/50に)と理由です。Codexの戦略的推論の強さは、コーディング能力の向上以上に驚きでした。

CodexはClaude Codeより速いですか?

high thinkingでは、はい。一貫して速く、サードパーティの比較では同等のタスクで約3分の1のトークンで済むことが示されています。default thinkingでは差は小さくなります。頻繁にやり取りする反復的な作業では、スピードとトークン効率の差が積み重なります。

Claude Codeのアップタイムは心配すべきですか?

90日間の数字は現実的な差を示しています(99.2% vs 99.9%)。Claude Codeが唯一のツールで、締め切りに追われている場合は、バックアッププランを持っておきましょう。ただし、Anthropicは3月だけで約10回のClaude Codeリリースを行いました。信頼性ではOpenAIに後れを取っていても、機能面では猛烈に反復しています。

Codexのセキュリティ脆弱性について

Codexのコマンドインジェクションの欠陥により、ブランチ名を通じてGitHubトークンが漏洩する可能性がありました。発見され、対処されました。知っておく価値はありますが、セキュリティ研究者がこれらのツールを積極的にテストしていることも注目に値します。これはエコシステム全体にとって良いことです。

ニュースレター戦略の話は本当にツールの話ですか?

一部はそうです。異なるモデルには異なるデフォルトの推論スタイルがあります。GPT-5.4は僕の前提に疑問を投げかける傾向がありました。Claudeは僕の計画をうまく実行する傾向がありました。どちらも有用ですが、プロダクト戦略においては「正しい問題を解いているか?」が「ここに良い実装がある」よりも価値があることが多いです。

どちらのツールを買うべきですか?

両方です。逃げの回答ではなく、本当に最善の答えです。月額20ドルのCodexと月額20-100ドルのClaude Codeの組み合わせは、どちらのツール単体でもどの価格帯でも得られない、より良い結果をもたらします。僕はClaude Codeを200ドルから100ドル、あるいは20ドルに下げて、Codexを20ドルで追加する方向に傾いています。合計コストは下がり、アウトプットは上がります。ただし、OpenAIの寛大な上限は永遠に続くとは限りません。柔軟に構えておきましょう。

以上です。もしあなた自身の二刀流実験をしているなら、あなたの使い分けがどう変化しているか、ぜひ聞かせてください。同じパターンですか、それとも全然違いますか?

Cheers, Chandler